人工智能导论-复习

[TOC]

第一章 人工智能导论

图灵(1912-1954,英国数学家):人工智能之父,机器智能思想,1950 年在其著作 《 计算机与智能 》 中首次提出“机器也能思维”。

图灵测试:通过让机器模仿人来回答某些问题,判断它是否具备智能。

人工智能的定义

人工智能就是研究如何使一个计算机系统具有像人一样的智能特征,使其能模拟、延伸和扩展人类智能。

通俗地讲,人工智能就是研究如何使得计算机会听、说、读、写、学习、推理,能够适应环境变化,能够模拟出人脑思维活动。

会听(语音识别、机器翻译等)

会看(图像识别、文字识别等)

会说(语音合成、人机对话等)

会思考(人机对弈 、定理证明等)

会学习(机器学习、知识表示等)

会行动(机器人、自动驾驶汽车等)

①专用人工智能(有了突破性进展):让人工智能专门去做一件事,比如下围棋、爬楼梯、组装设备等。

人工智能目前仅适用于特定的、专用的问题。

②通用人工智能(尚处于起步阶段):能实现包含人类水平的任务,涉及机器的持续学习;

人工智能的三大学派

①符号主义(Symbolicism)

又称逻辑主义、心理学派或计算机学派

其原理主要为物理符号系统(即符号操作系统)假设和有限合理性原理

②连接主义(Connectionism)

又称仿生学派或生理学派

其原理主要为神经网络及神经网络间的连接机制与学习算法

③行为主义(Actionism)

又称进化主义或控制论学派

其原理为控制论及感知 动作型控制系统

第二章 知识表示

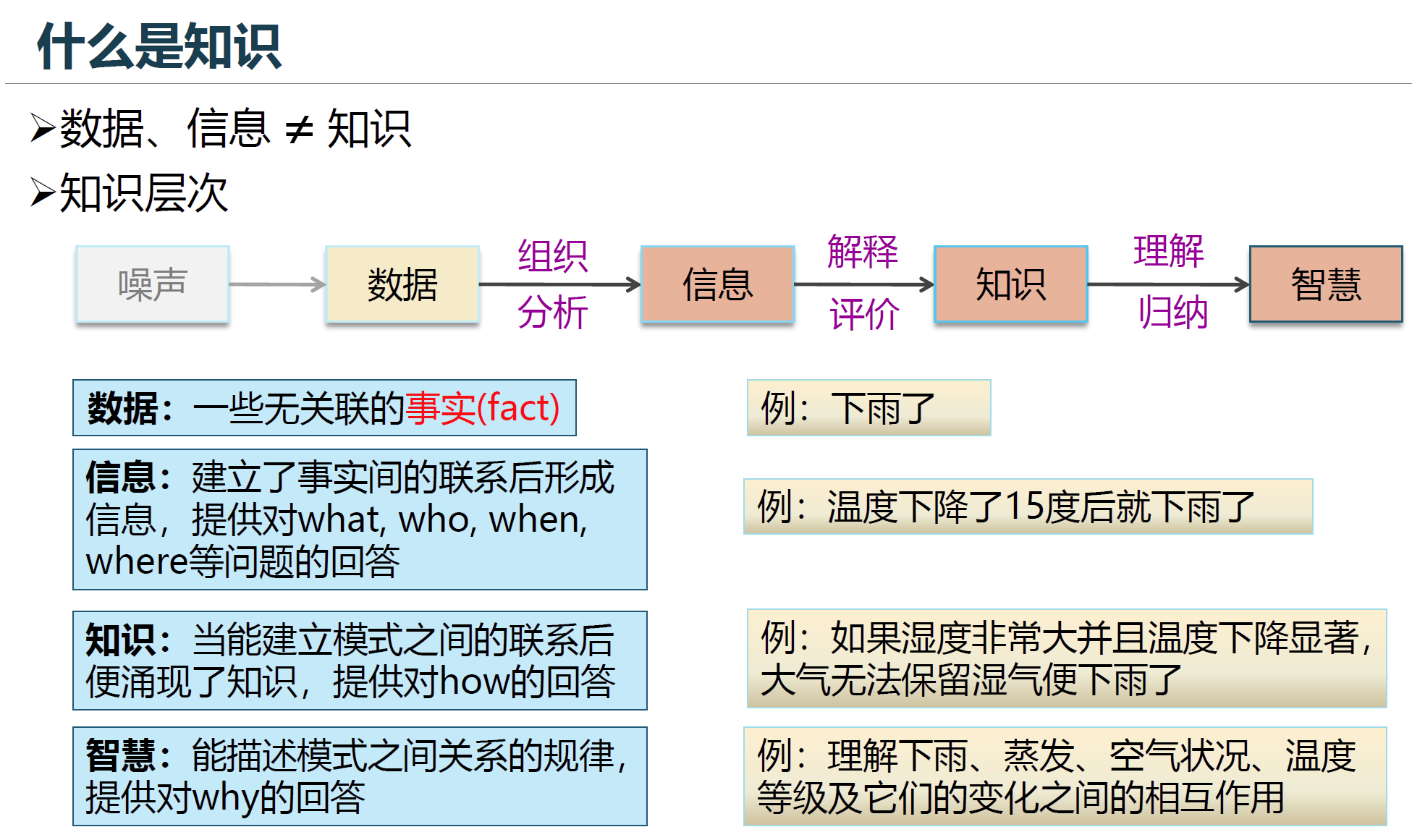

什么是知识:

知识表示的过程:非形式化的自然语言描述➡形式化的易于被计算机理解

将人类知识形式化或模型化

知识的特性:①相对正确性 ②不确定性 ③可表示性和可利用性

几种知识表示的方法

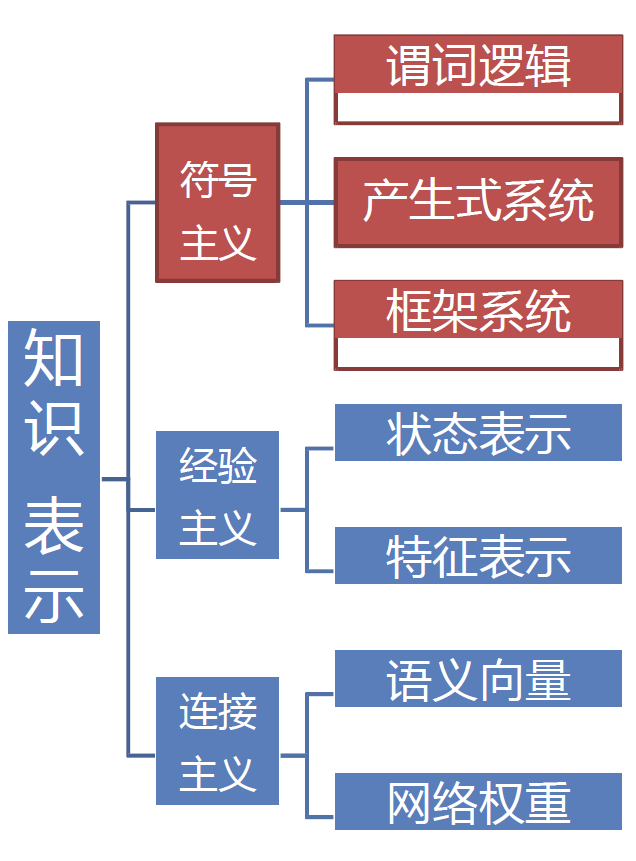

知识表示方法的三大流派:

①符号主义

早期的人工智能研究,主要采用符号主义;

符号主义的本质,是用符号体系来描述知识,再对表示得到的符号公式进行计算,从而求解问题。

②经验主义

在经验主义方法中,知识不再由人工抽象、归纳符号体系来得到,而是通过样本数据的状态、特征来间接体现;

在经验主义中,样本数据的特征表示,就对应了某种知识。智能系统通过“体验”样本特征,来获取知识。

③连接主义

在连接主义中,知识的表示更加抽象。连接主义的核心就是要模拟人类大脑神经元连接的结构;

在这种情况下,从样本数据中获得的知识,就变为神经网络中的语义向量、网络权重。

谓词逻辑表示法

经典人工智能技术主要以符号表示,符号处理为实现智能的主要手段,推理和搜索是其中的核心技术

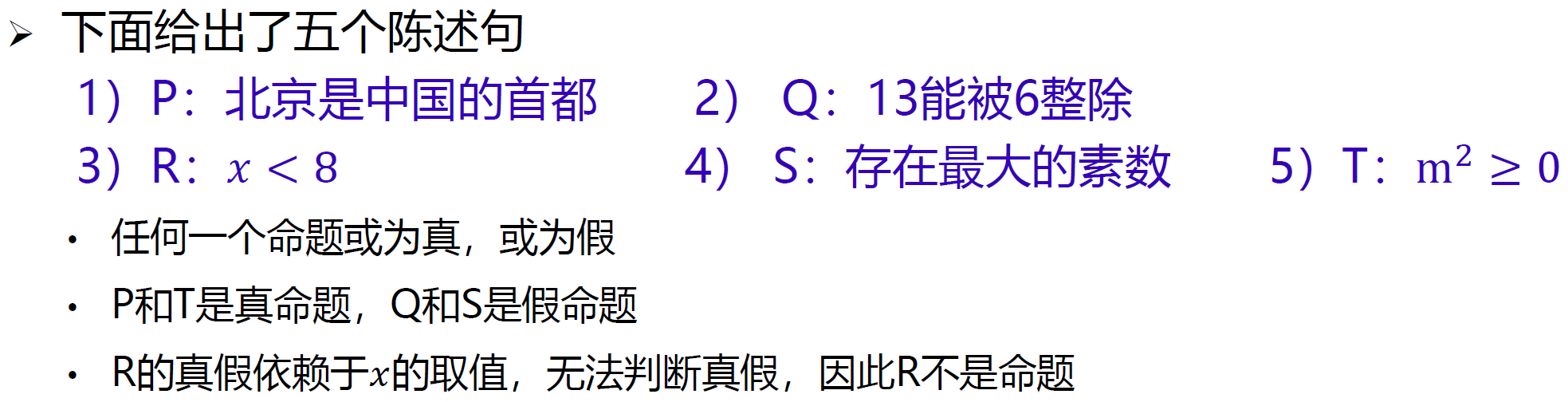

命题( proposition):一个非真(T)即假(F)的陈述句;

一个命题可以在一种情况下为真,在另一种条件下为假。

例如:

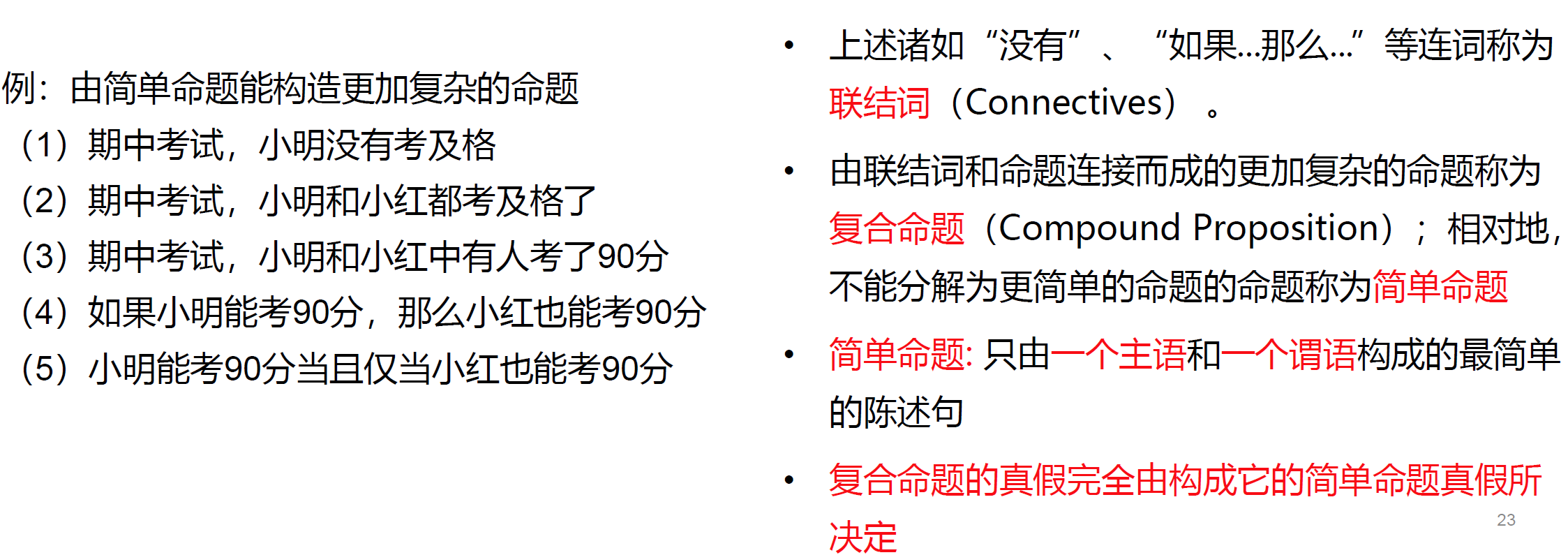

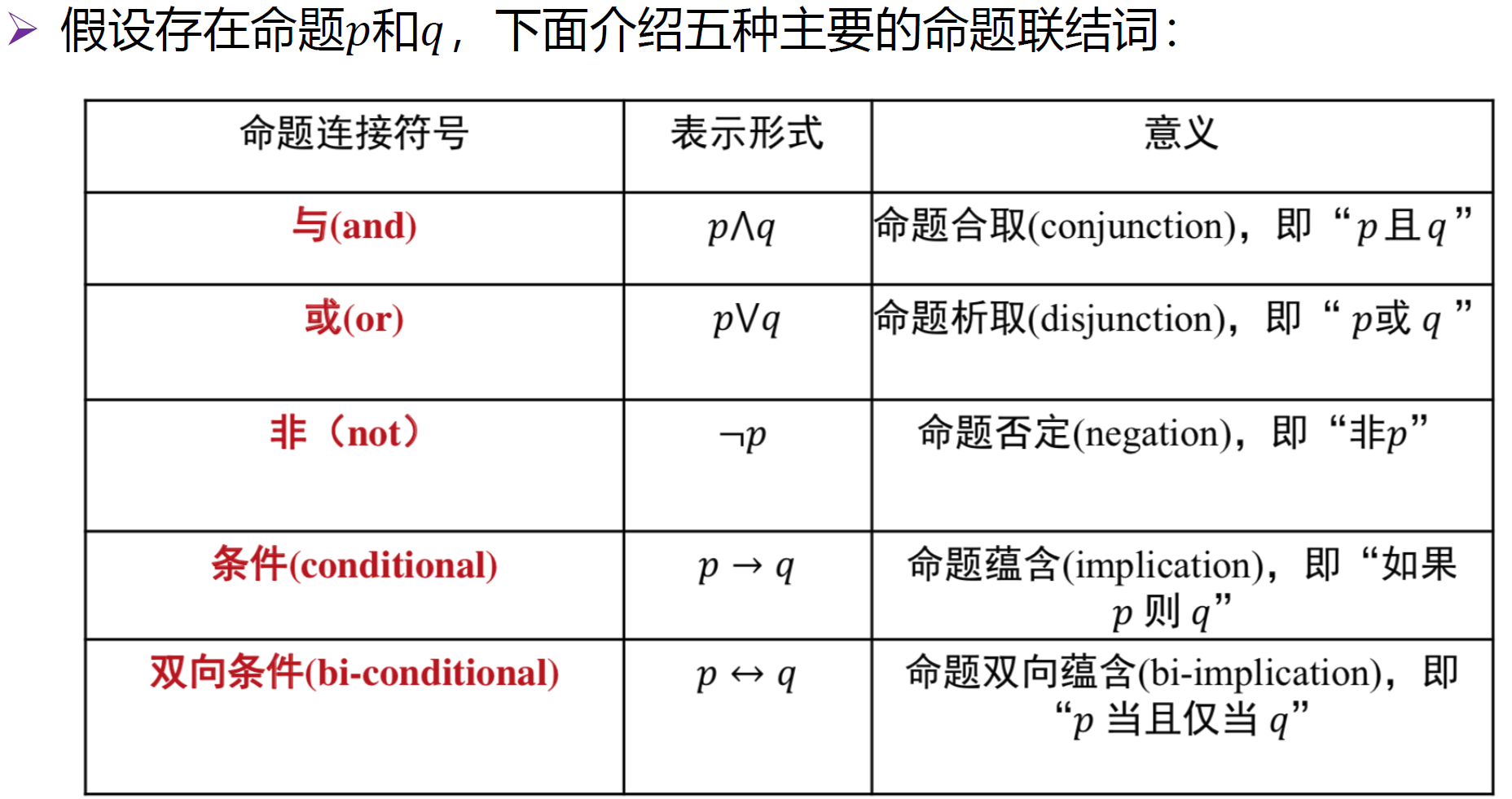

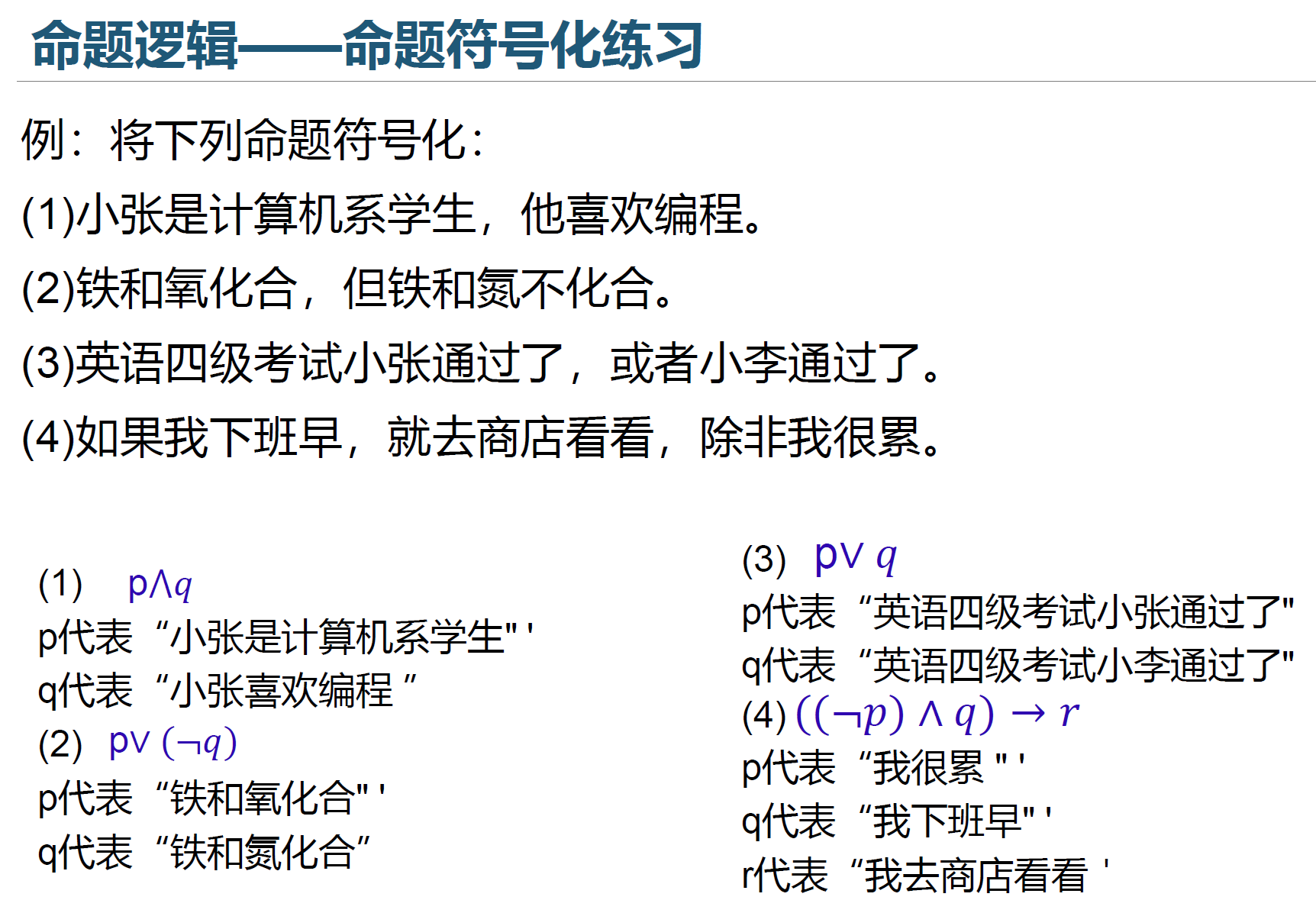

命题逻辑( Propositional Logic ):研究命题和命题之间关系的符号逻辑系统。

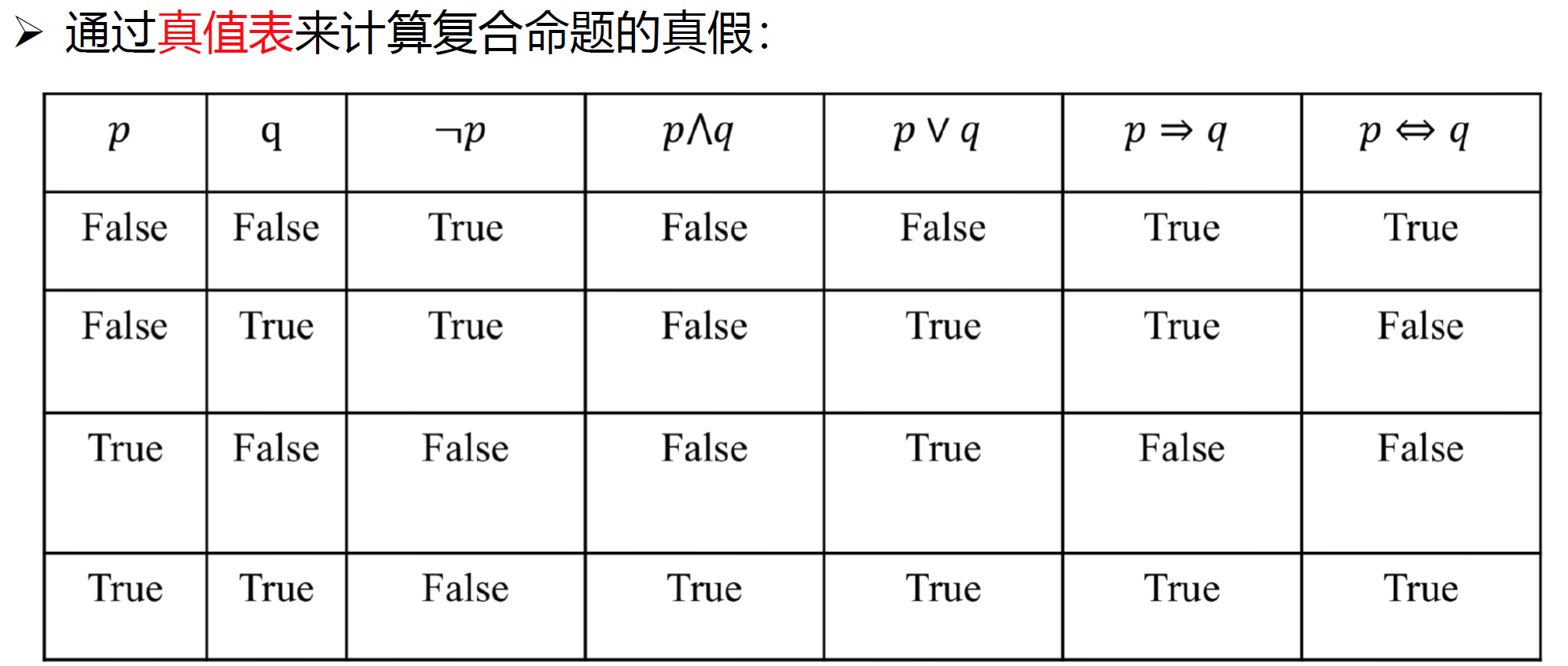

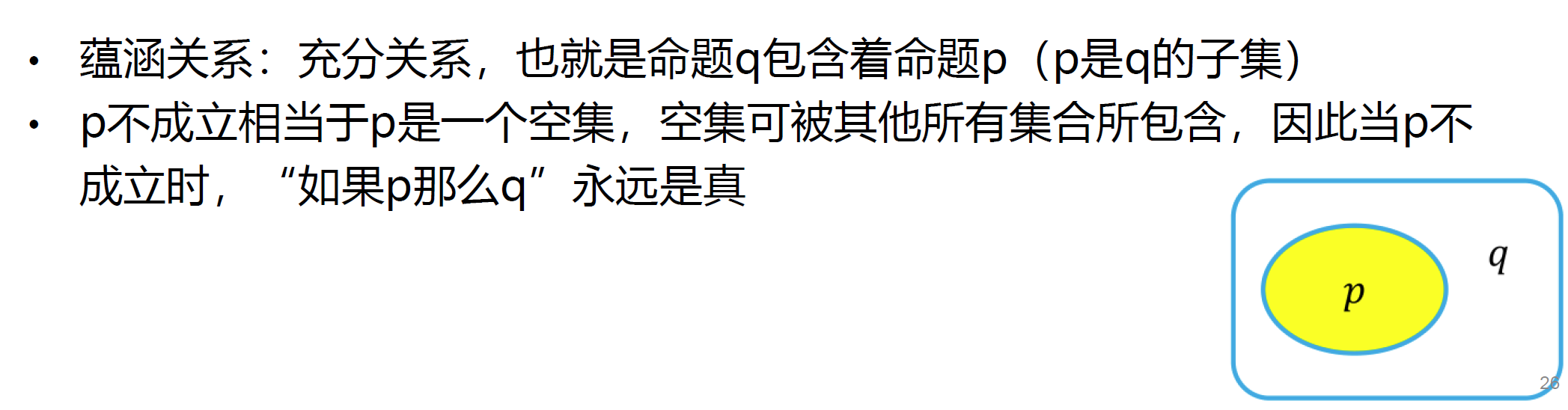

蕴含式:p→q 读作p蕴含q,称为p对q的蕴含式,p称为蕴含式的前件,q称为后件,→称为蕴含联结词

需要注意的是:真的推不出假的!所以p→q,只有p为T、q为F时才为F,别的均为真

例如:

例1.P :你努力 Q :你失败。“如果你不努力,那么你将失败”可表示为 :(非P→Q)“虽然你努力了,但还是失败了”可表示为:(P且Q)

例2.命题“如果明天不下雨,并且没有其他事情,我就去爬山”。使用 P 代表“明天下雨”, Q 代表“有其他事情”, R 代表“去爬山”。则命题可以符号化为(非P且非Q→R)

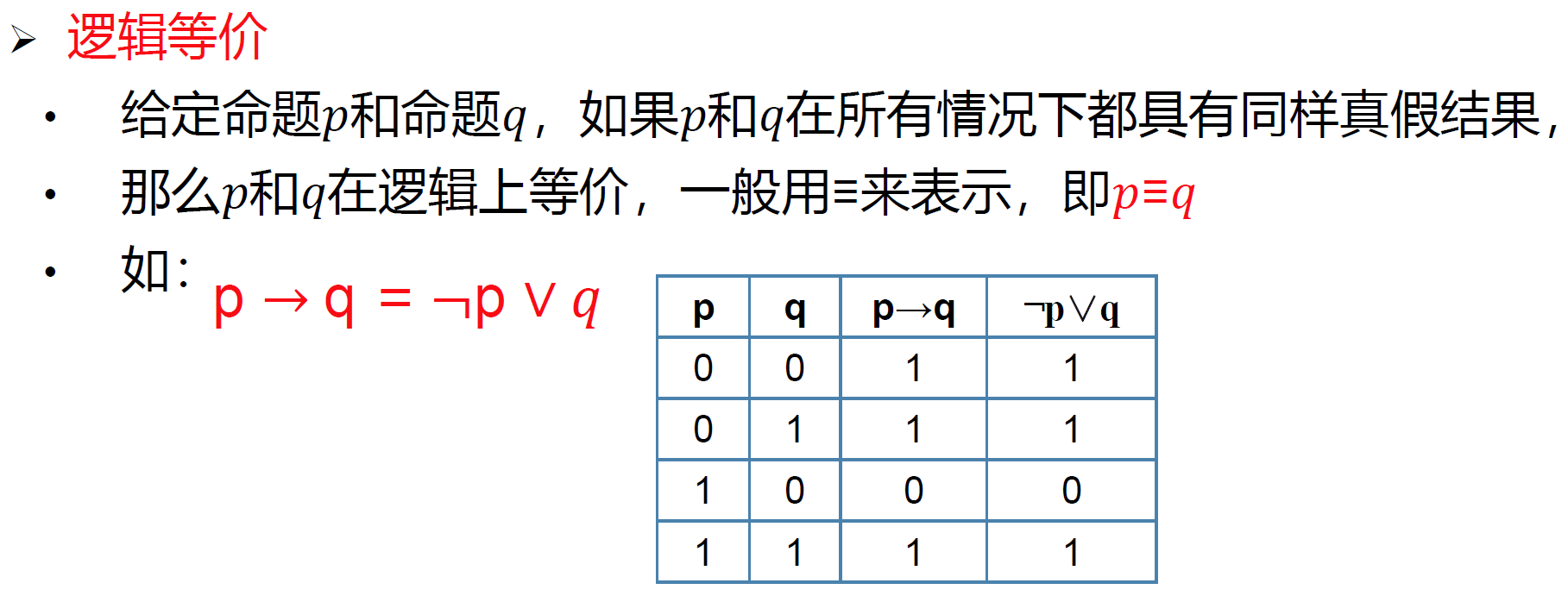

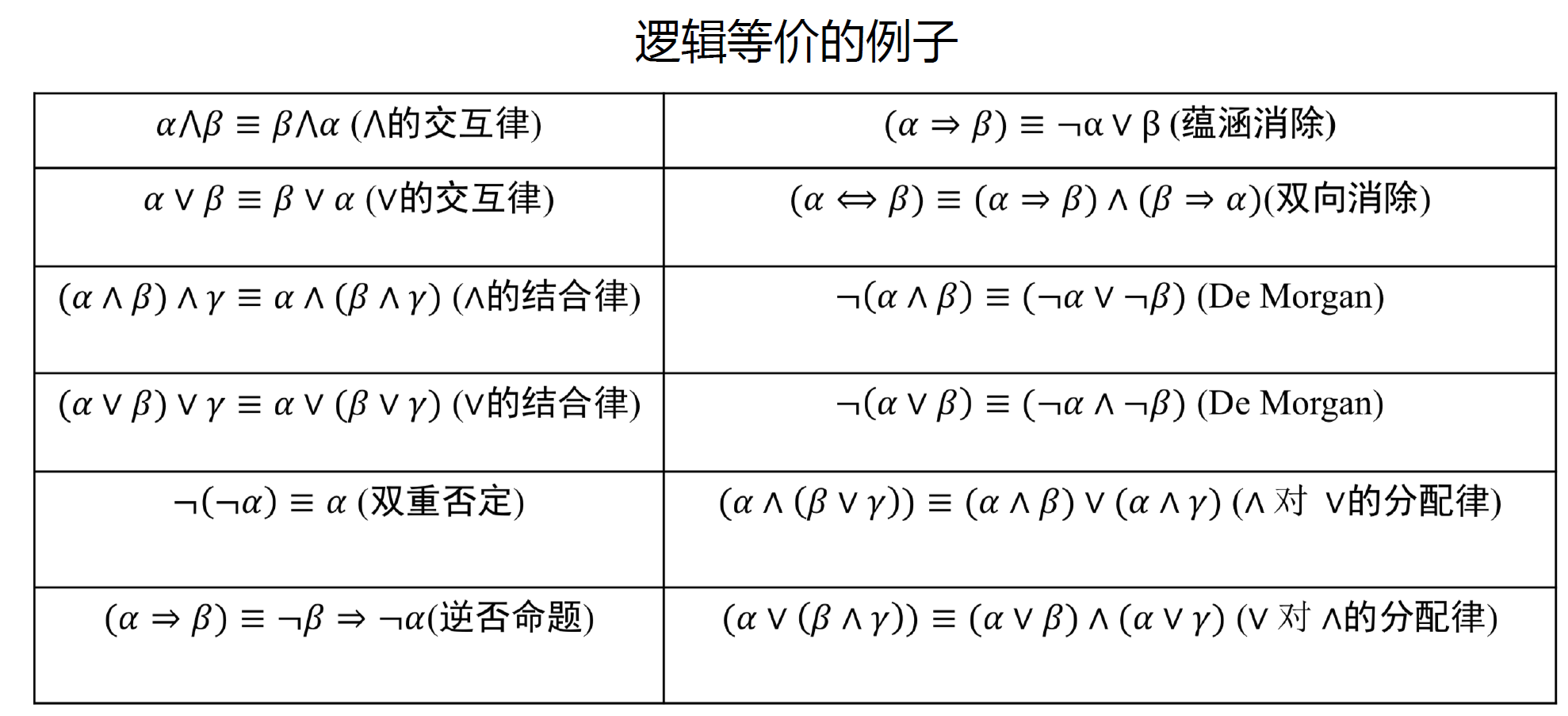

逻辑等价

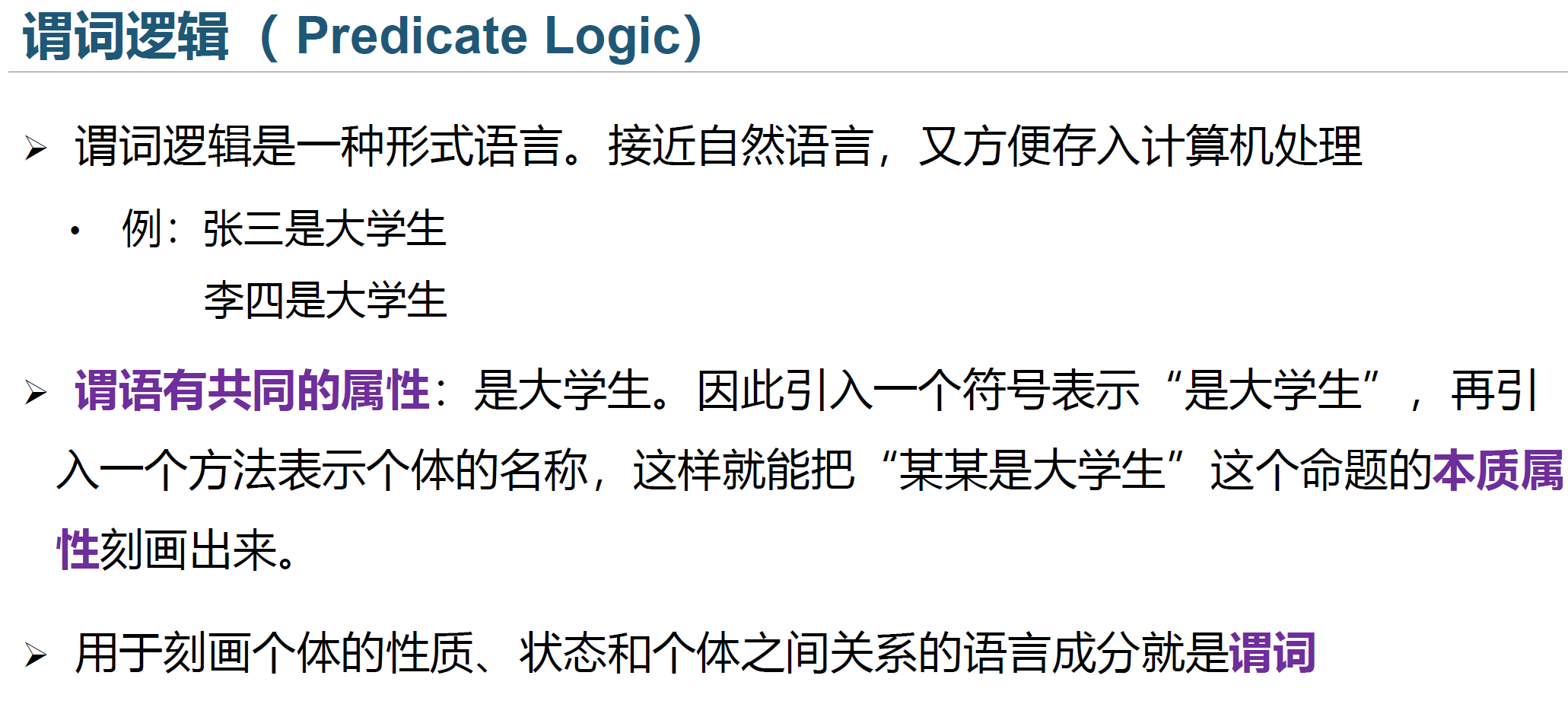

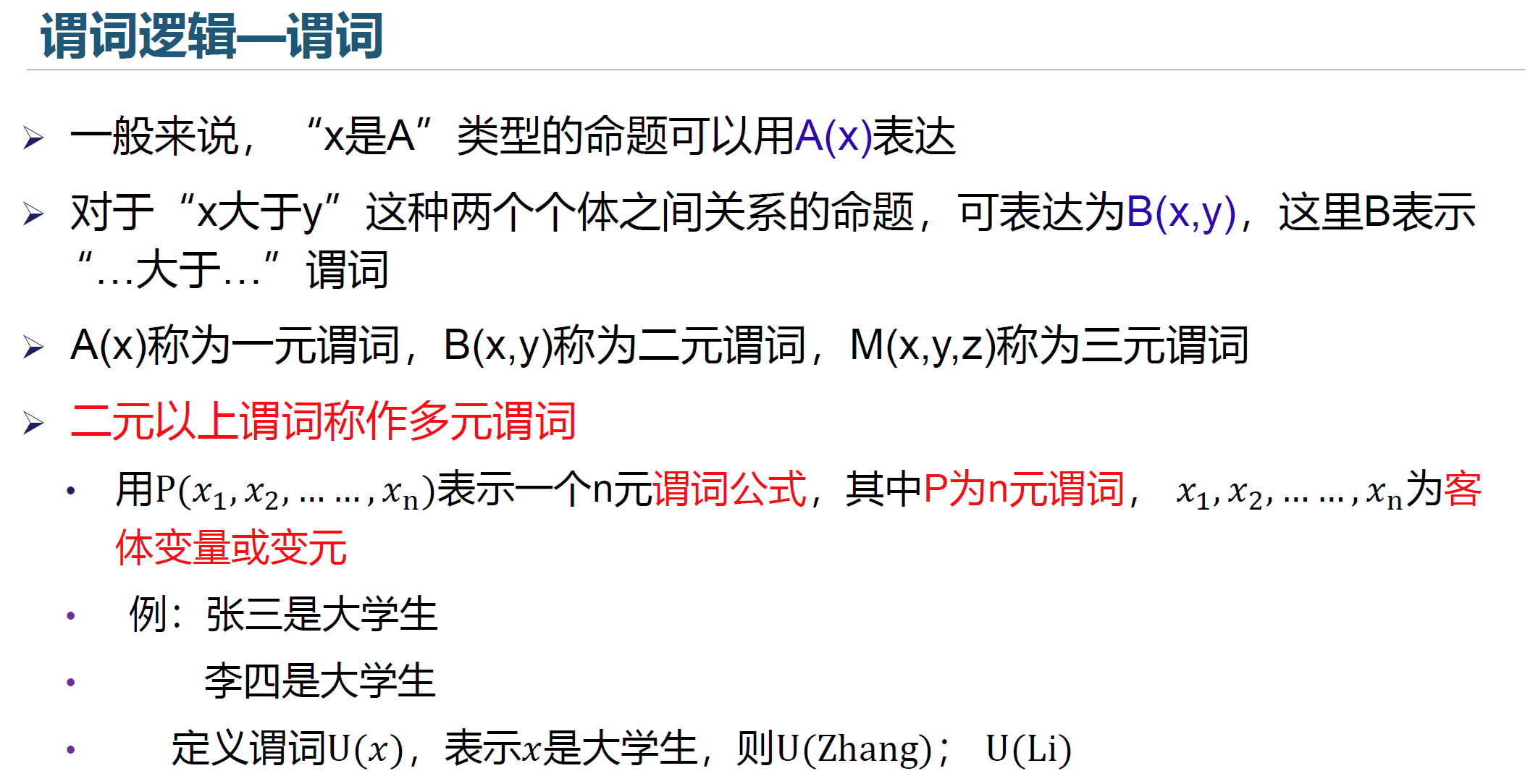

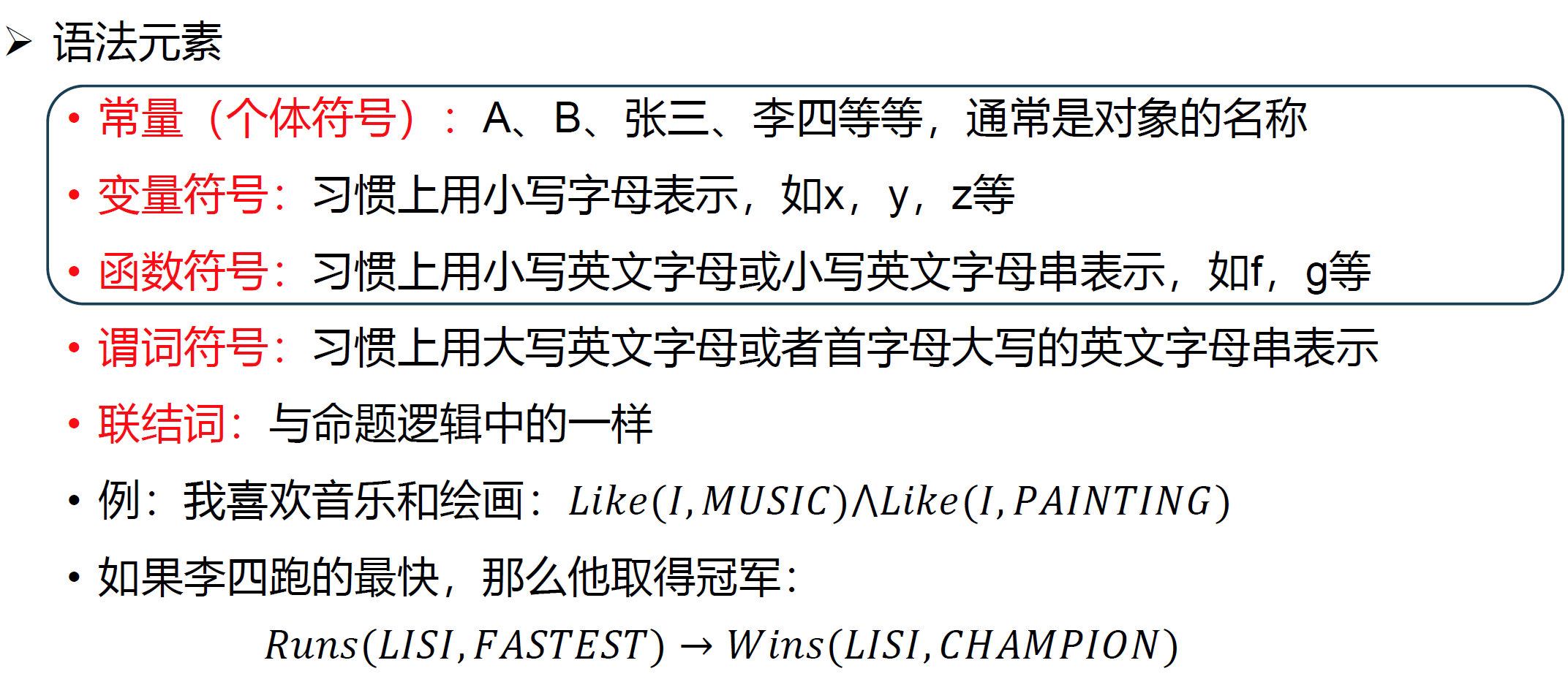

谓词逻辑(Predicate Logic)

命题逻辑虽然能够把客观世界的各种事实表示为逻辑命题,但具有很大局限性,不适合表达比较复杂的问题。

而谓词逻辑允许我们表达那些无法用命题逻辑表达的事情。

连词:

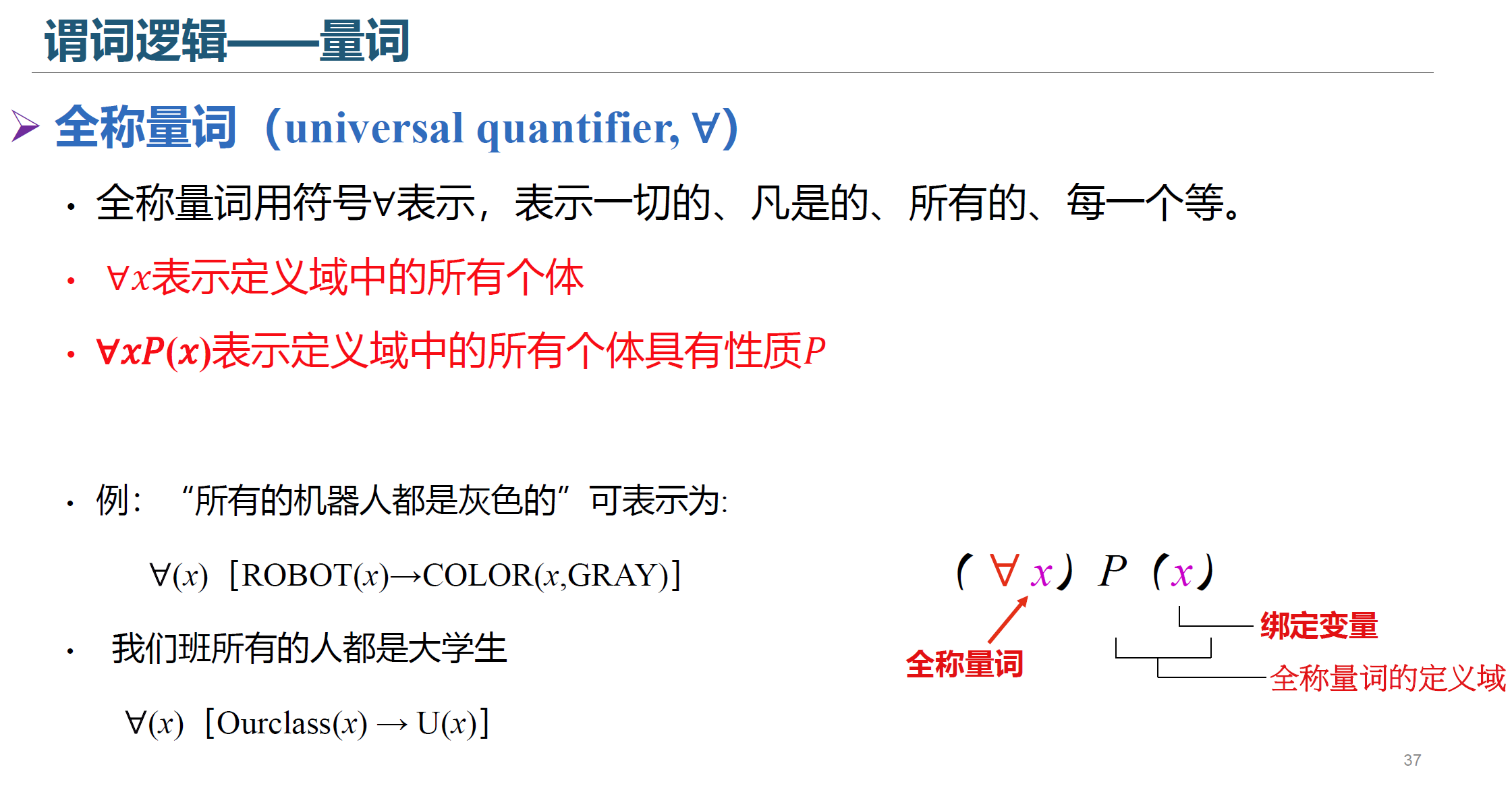

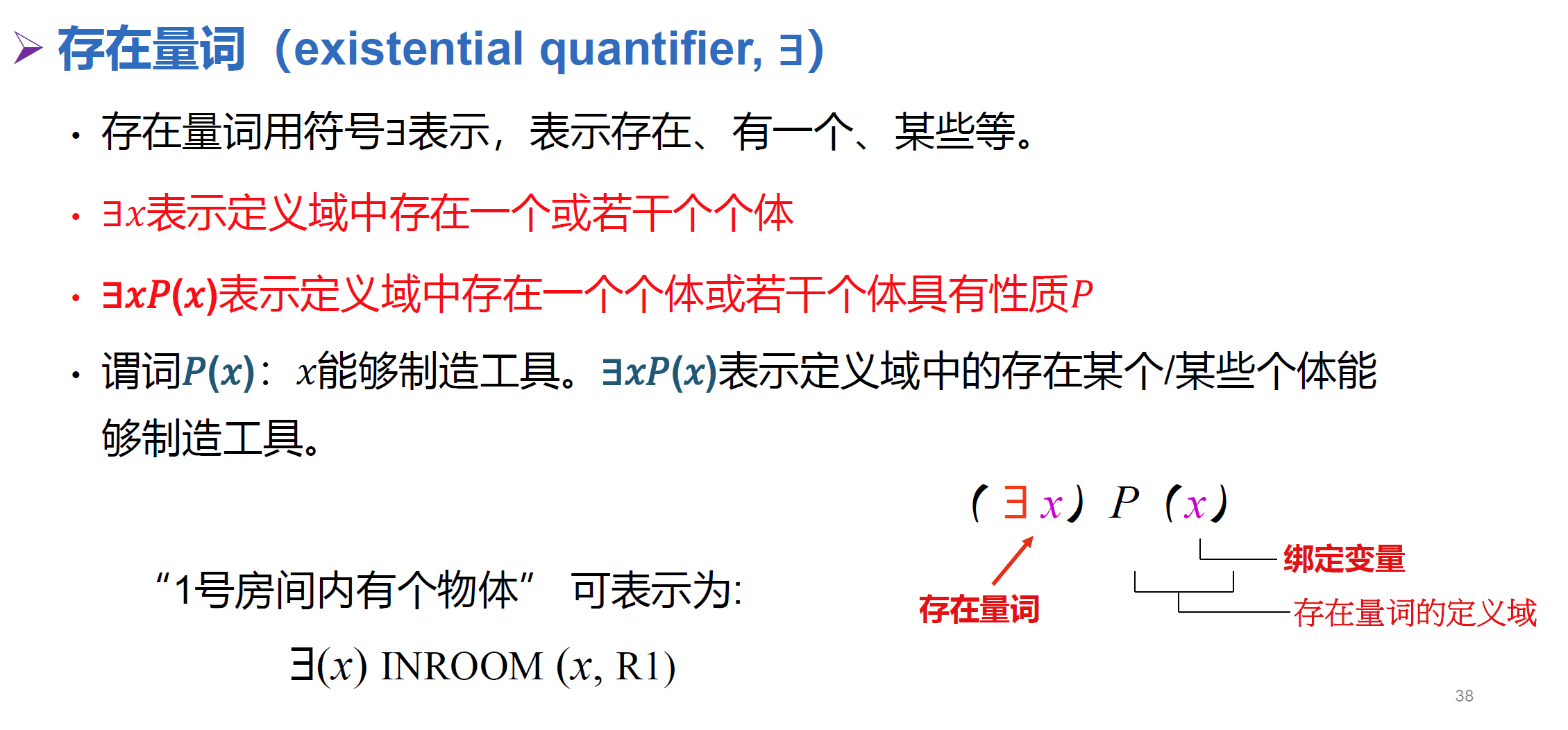

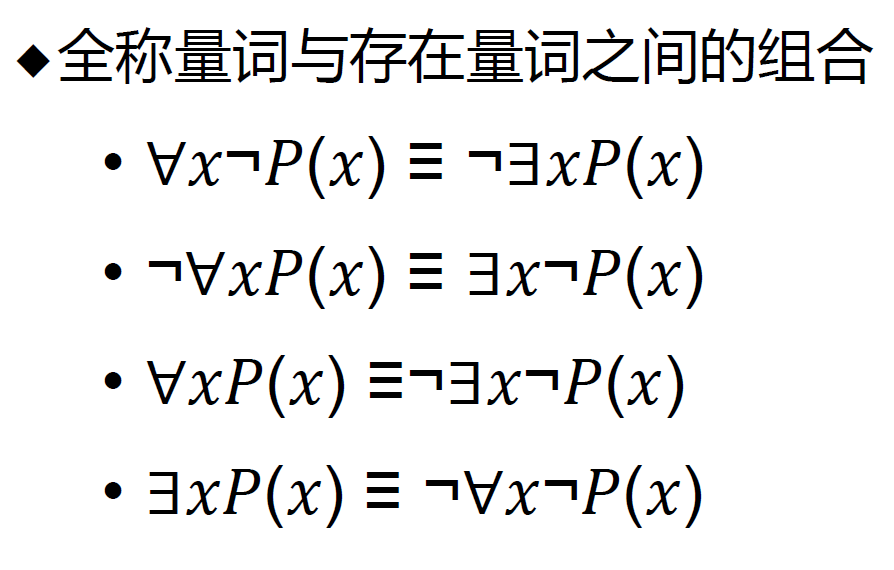

量词:

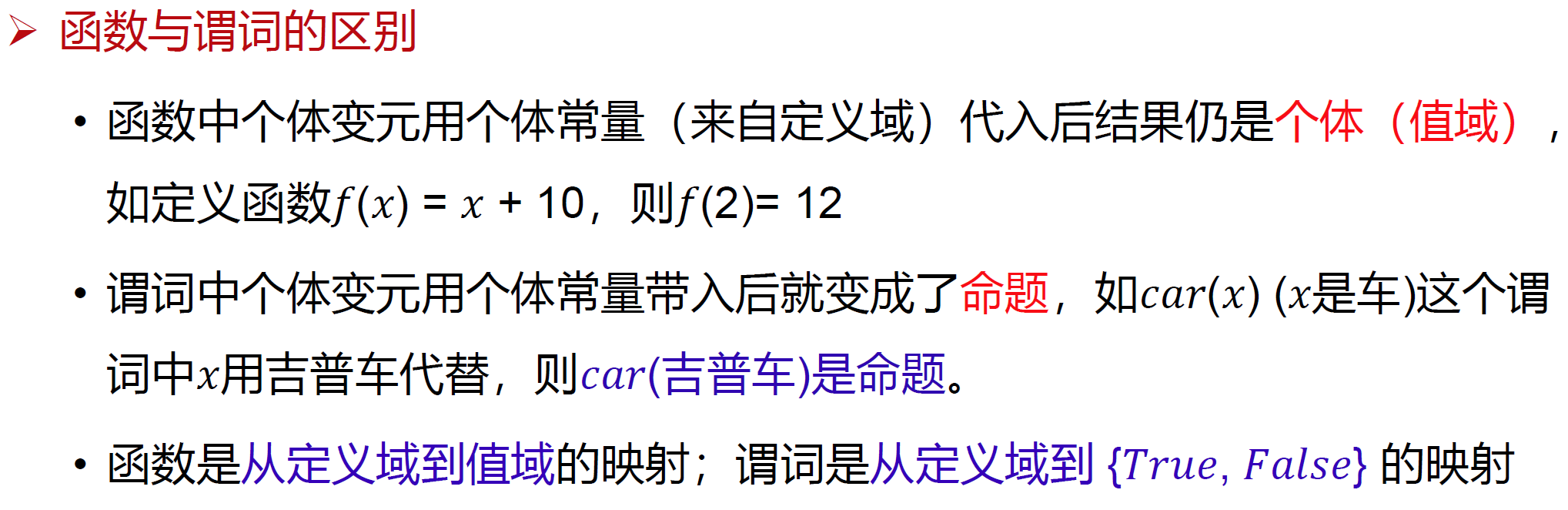

函数与谓词的区别

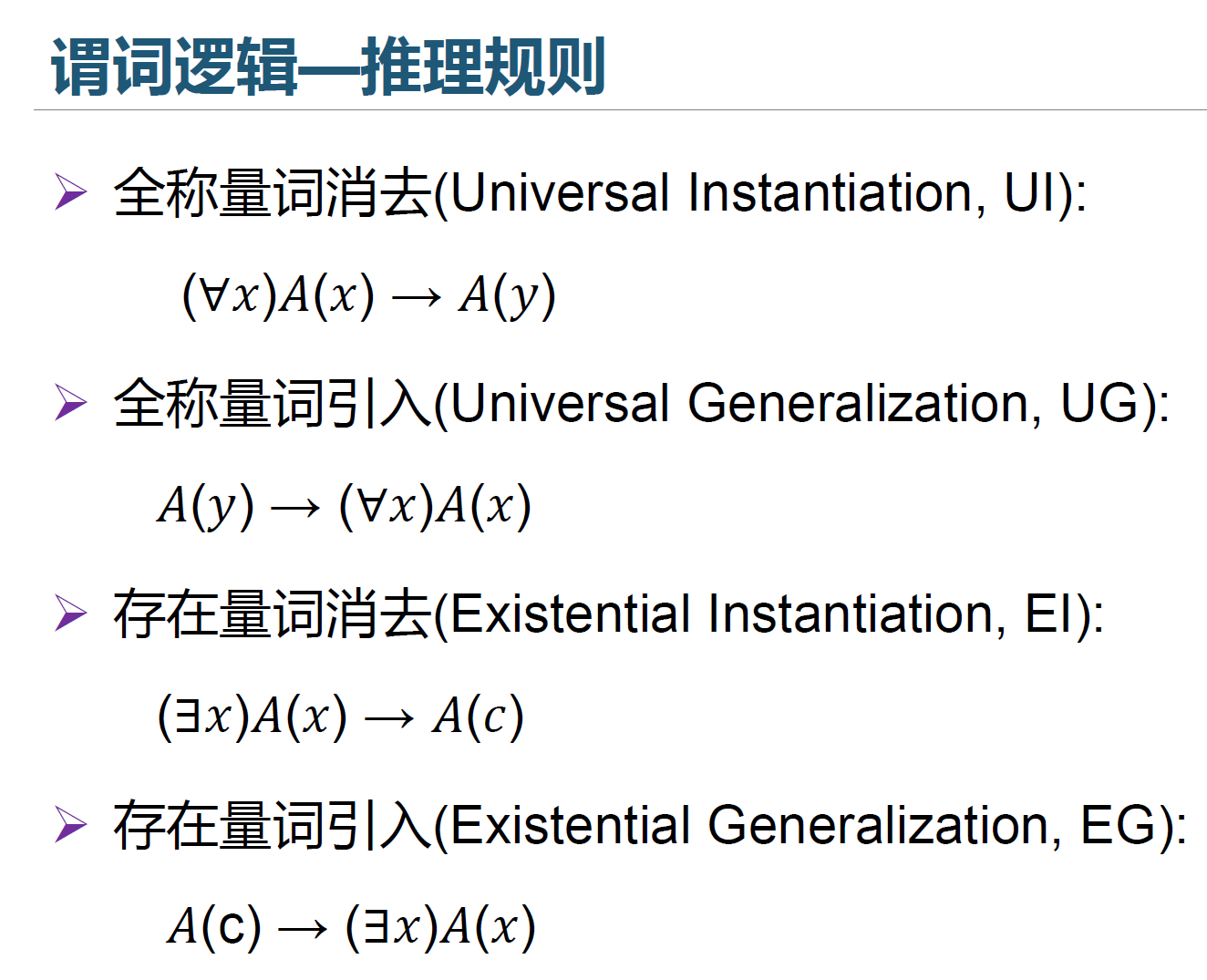

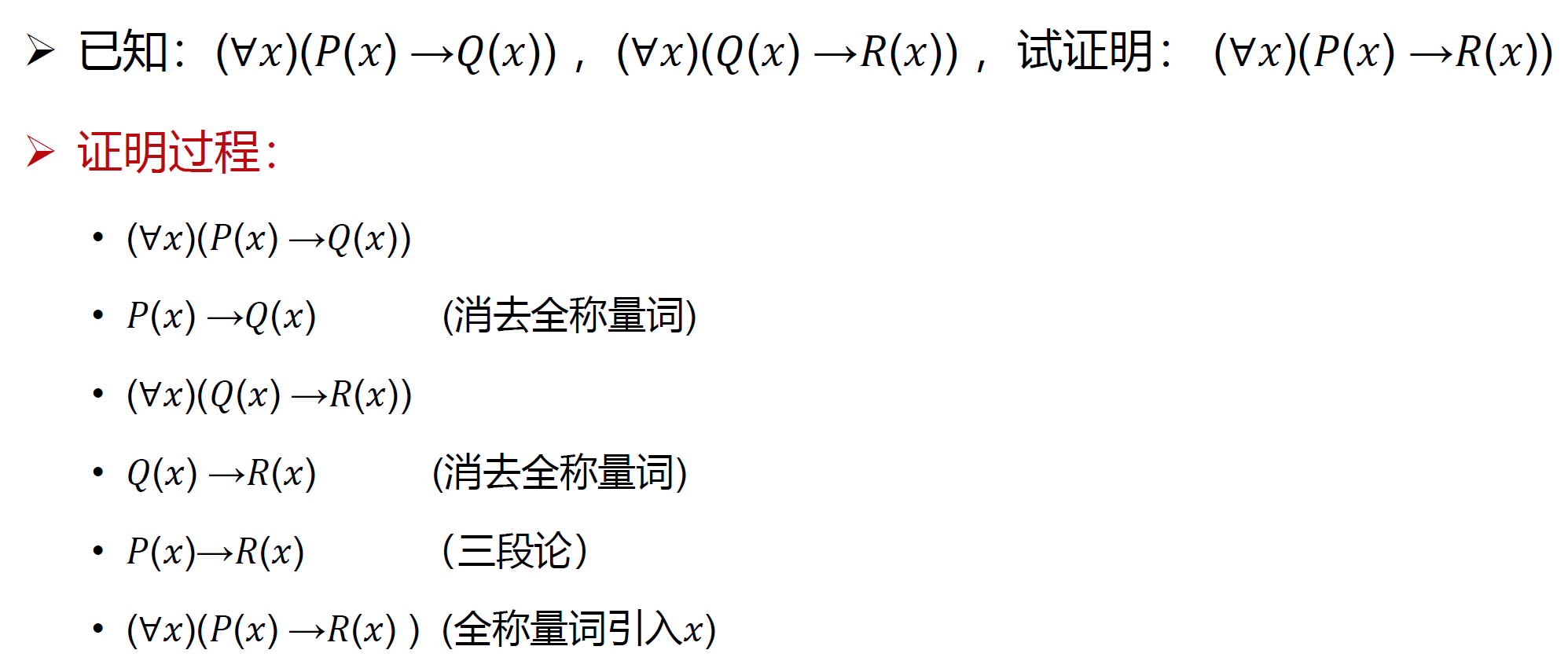

推理规则:

例如:

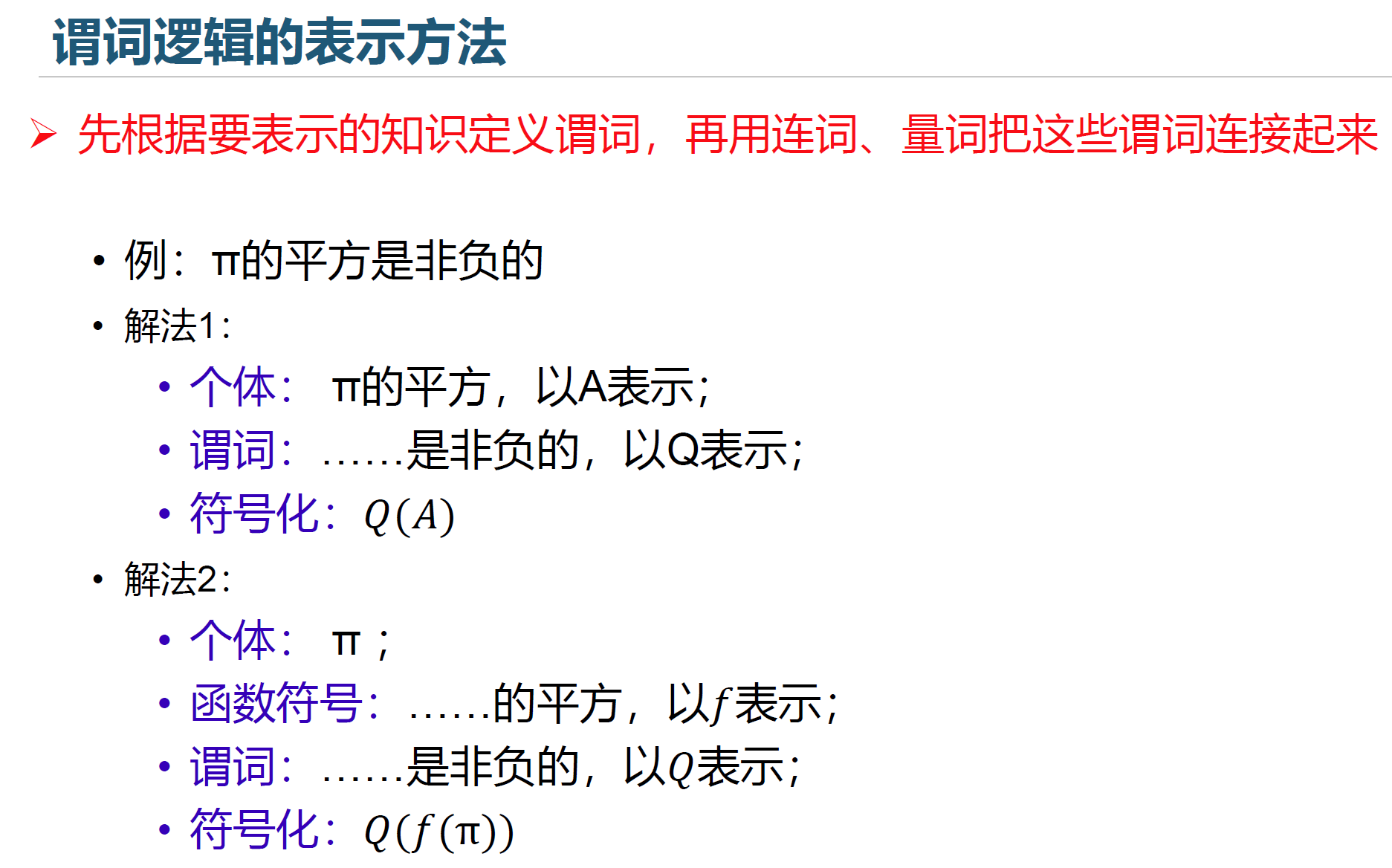

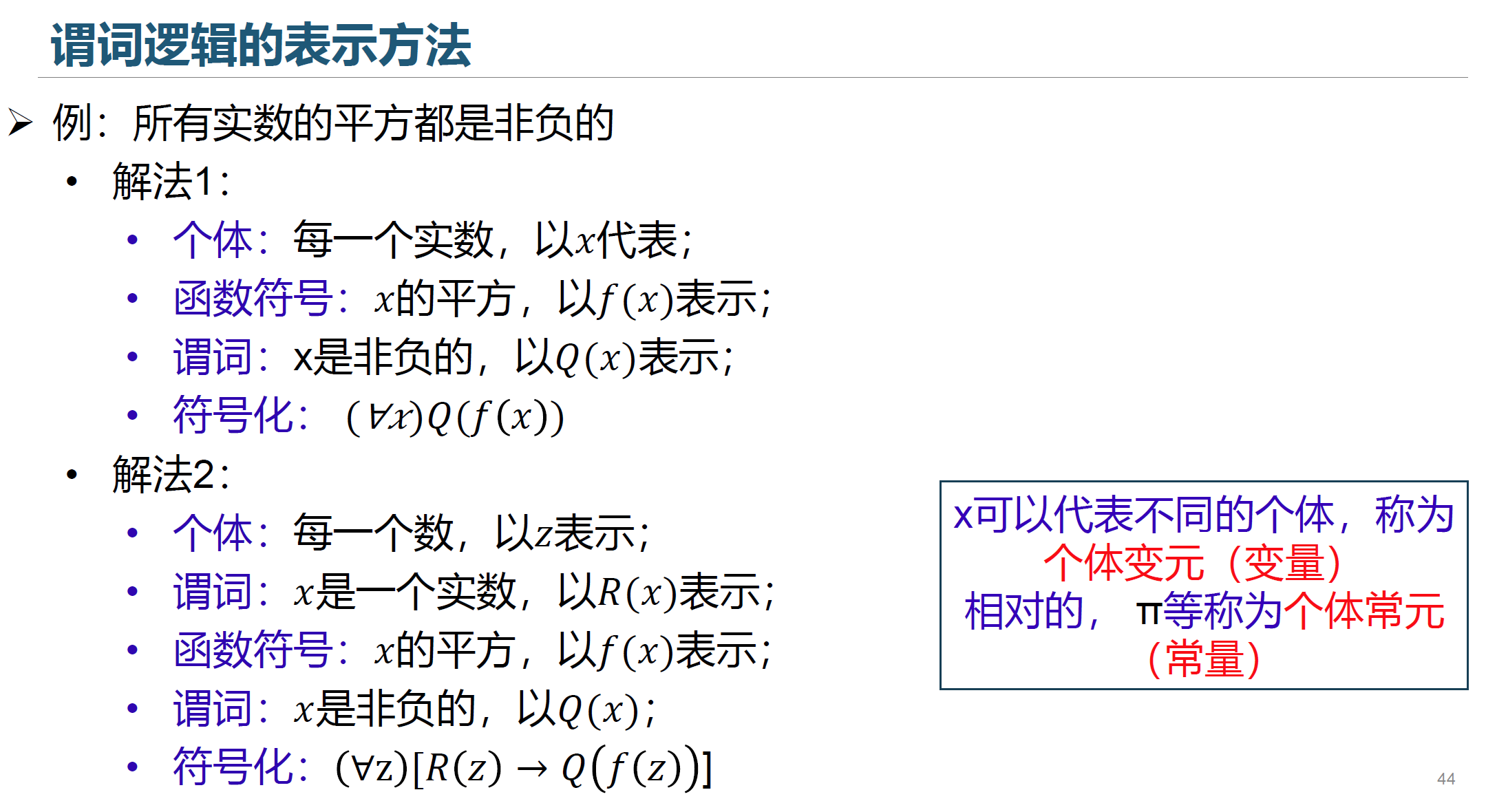

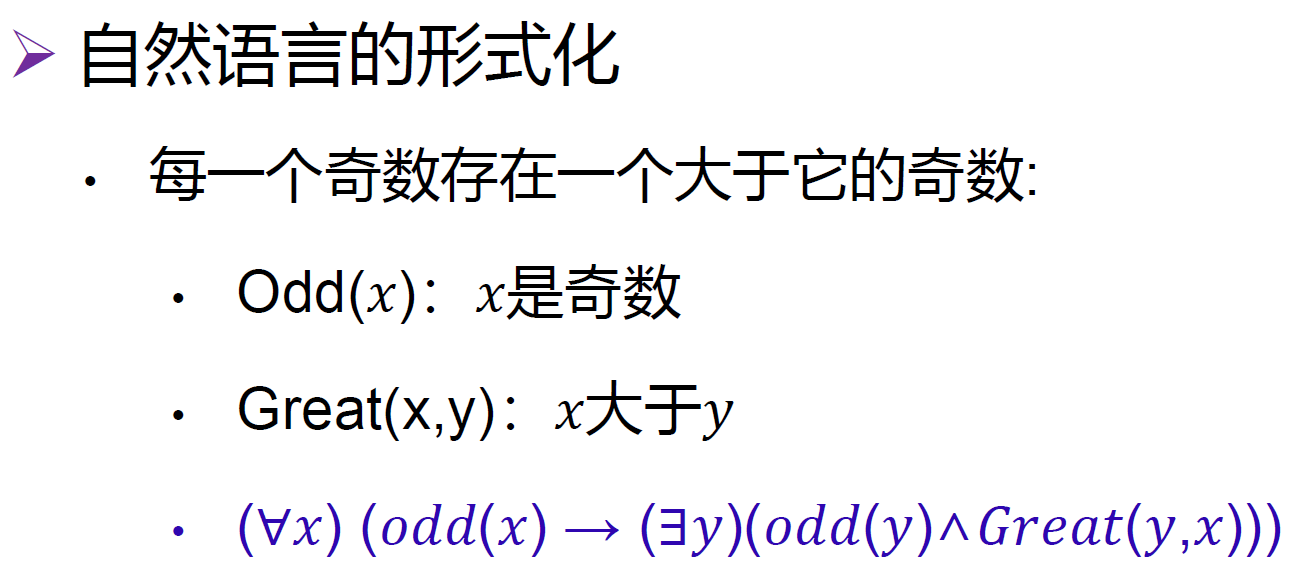

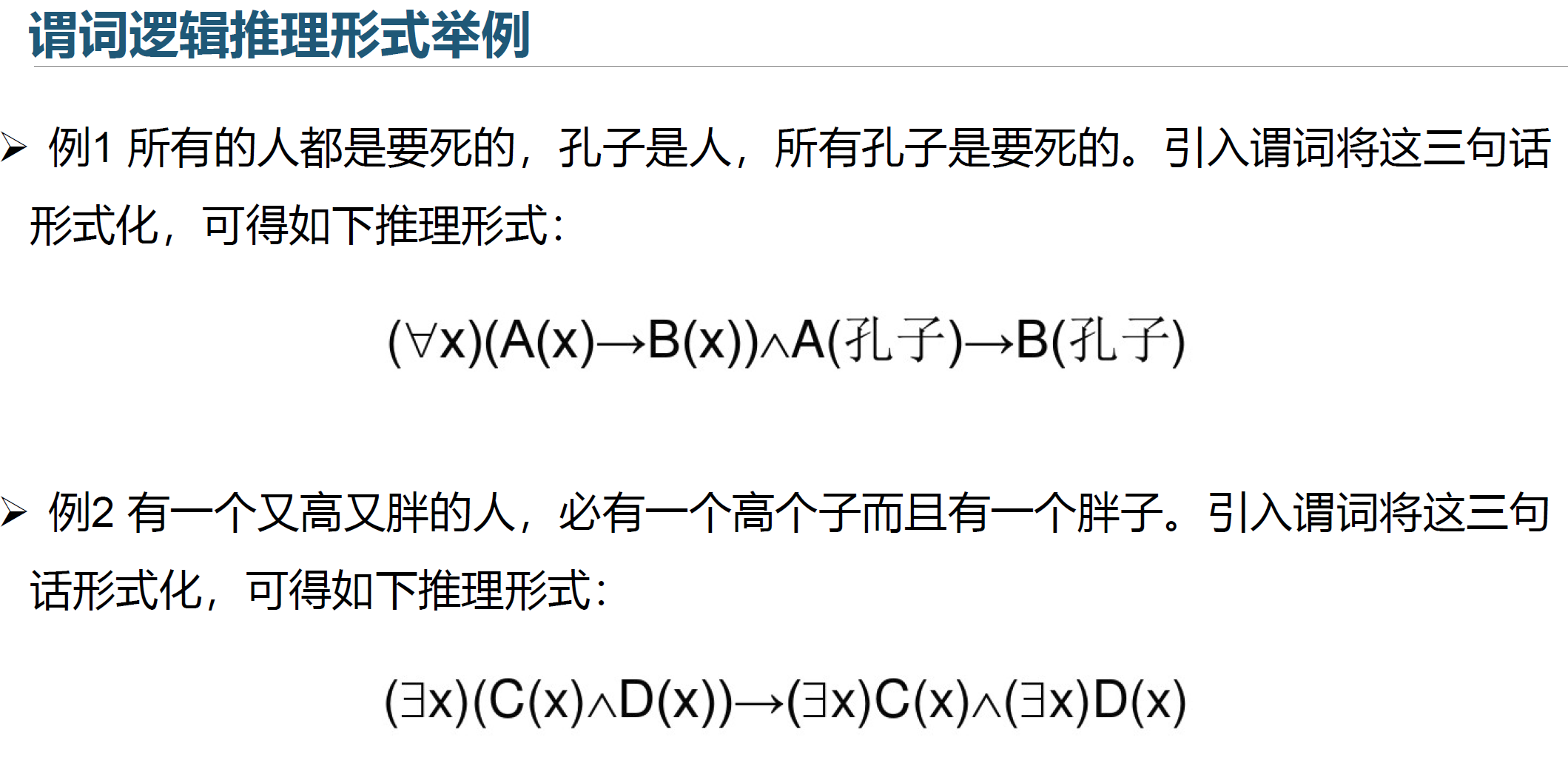

谓词逻辑的表示方法:

谓词逻辑小结

优点:自然性、精确性、容易实现

缺点、不足:①不能表示不确定性知识 ②形式过于自由、兼容性差

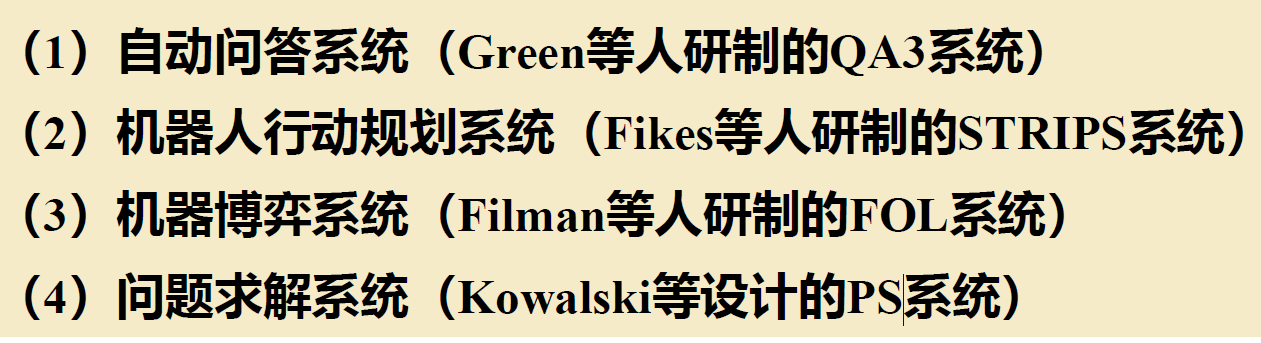

应用:

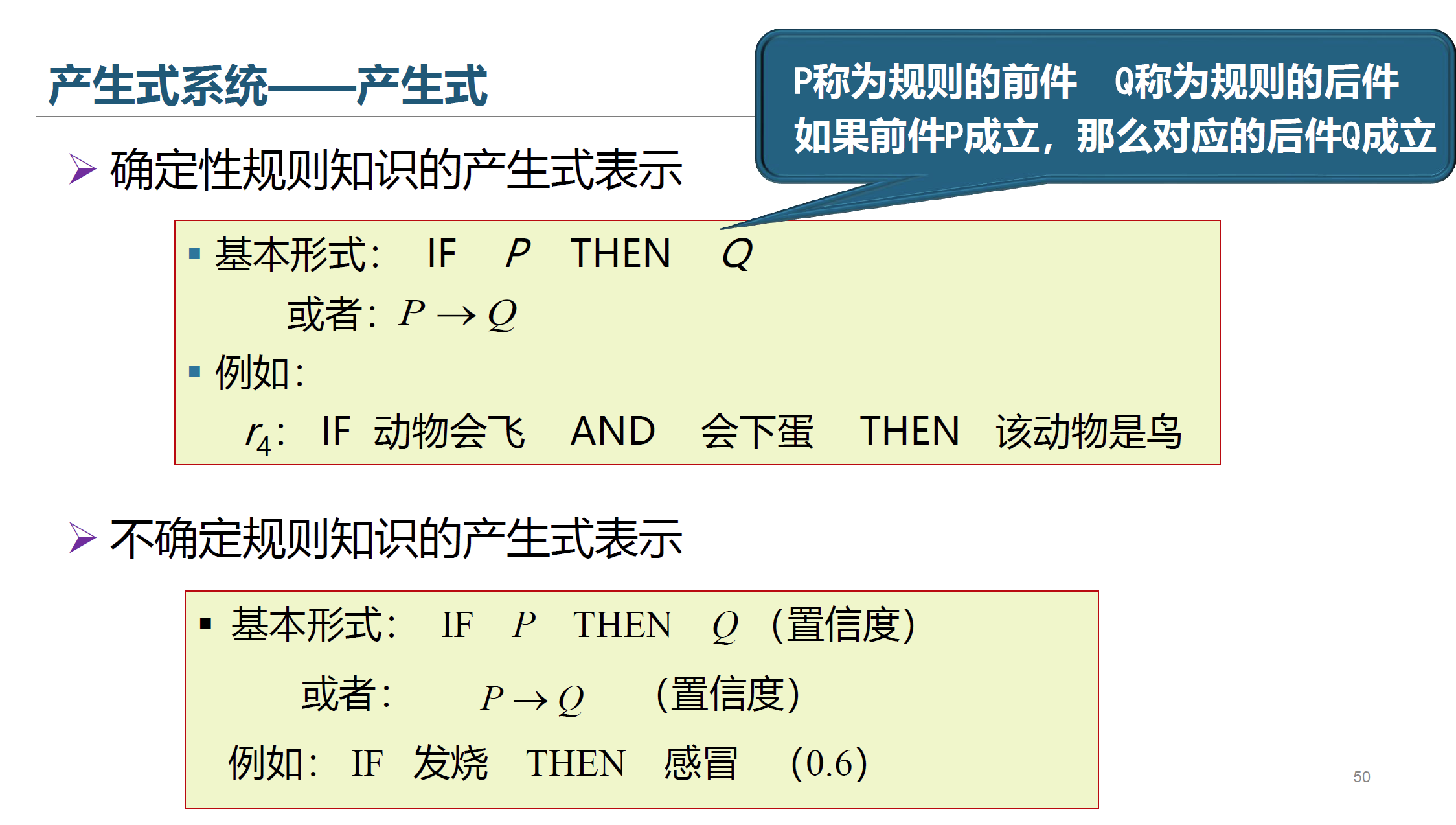

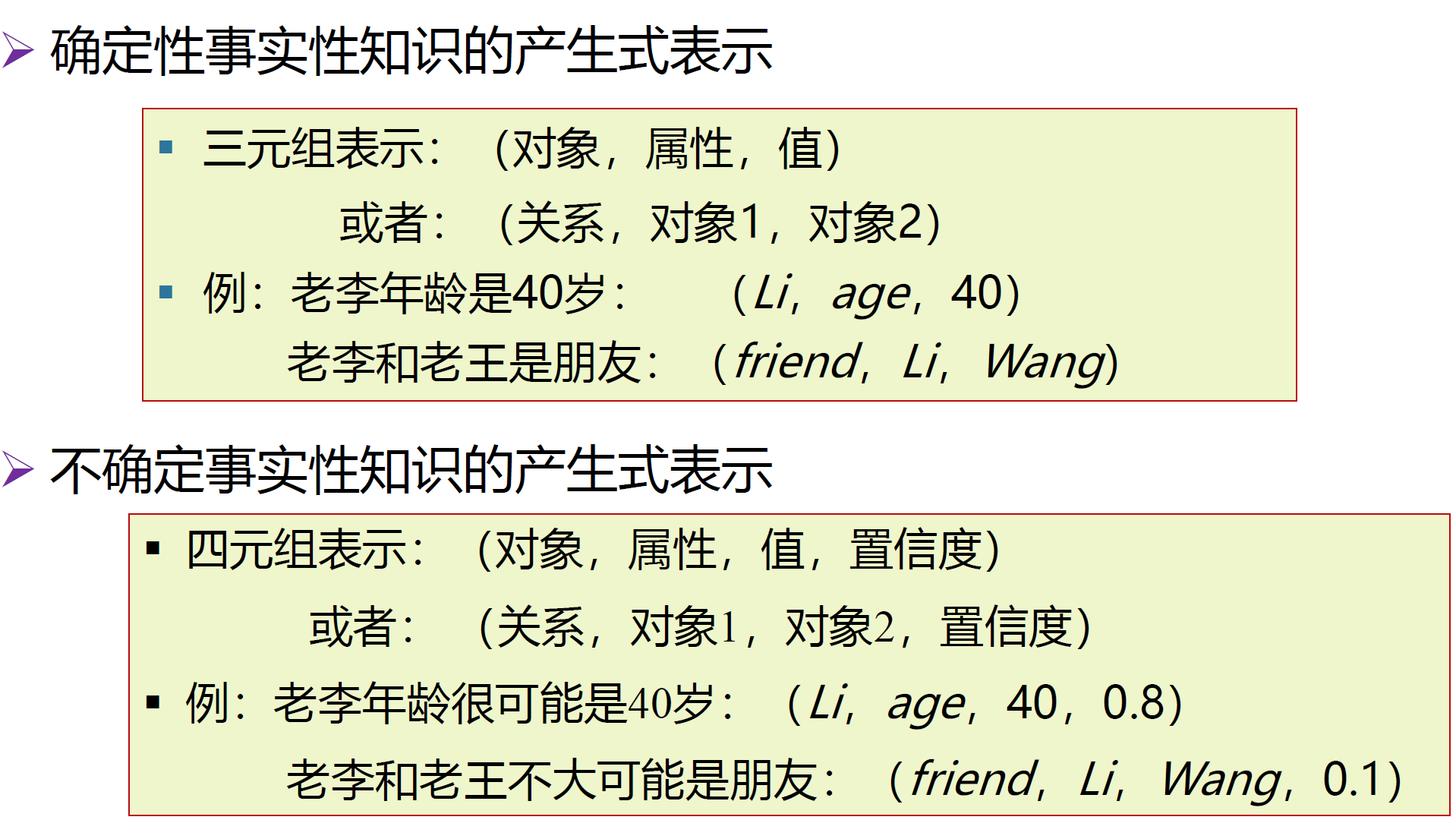

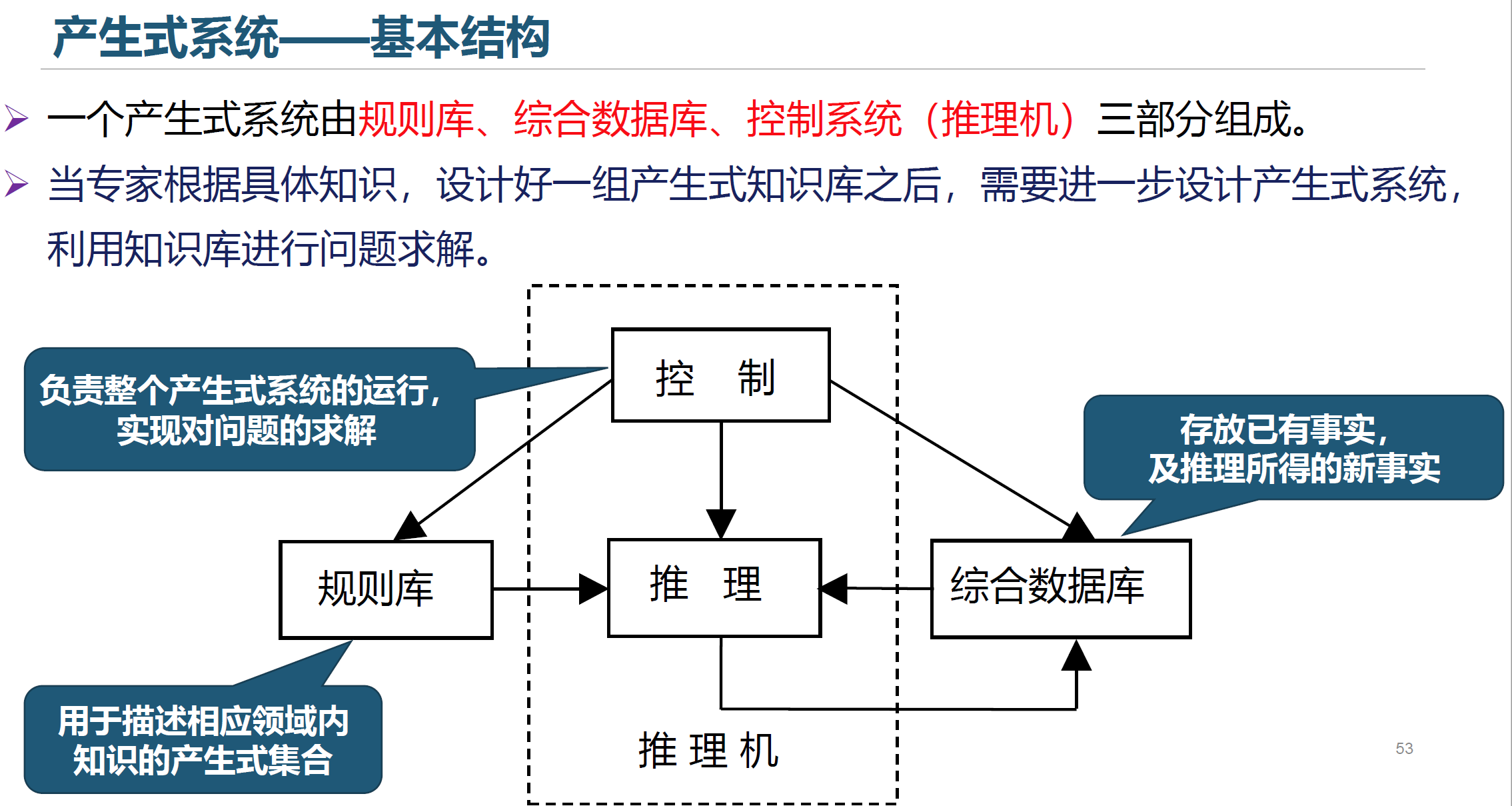

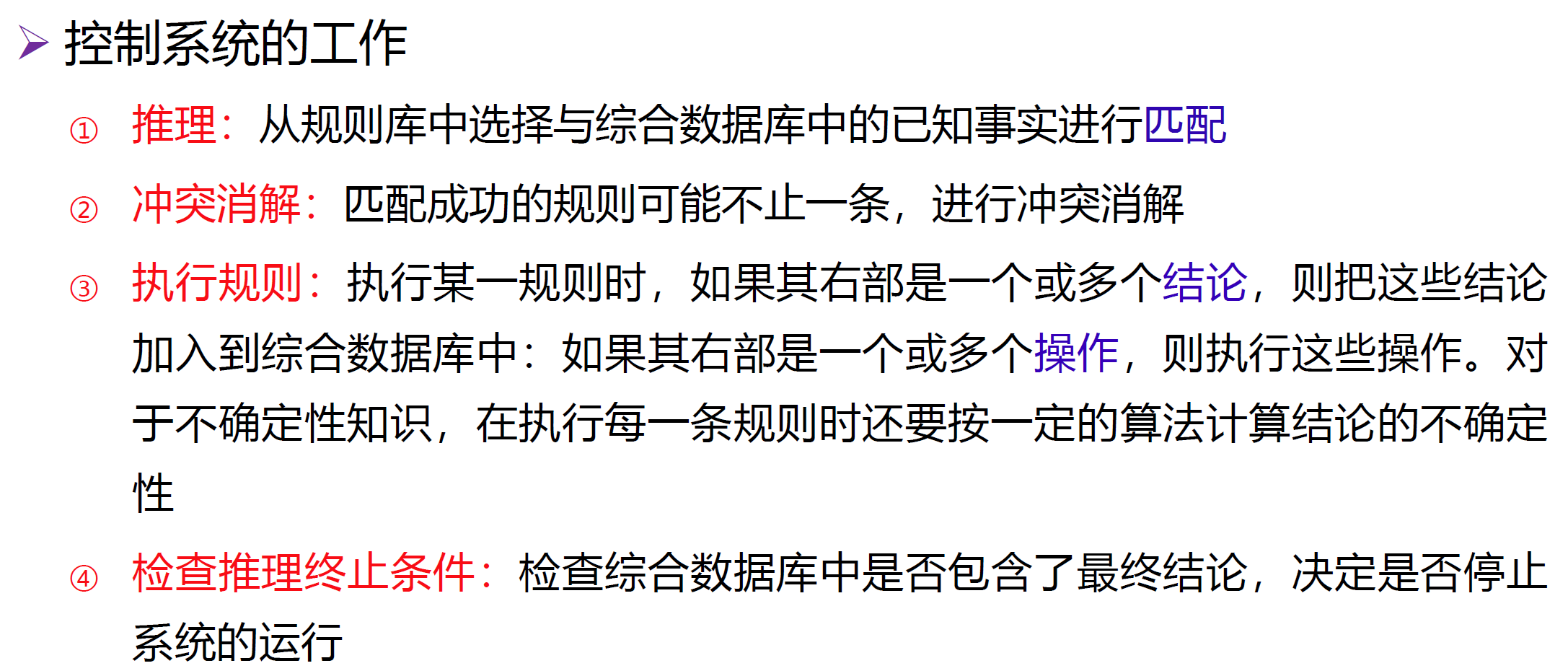

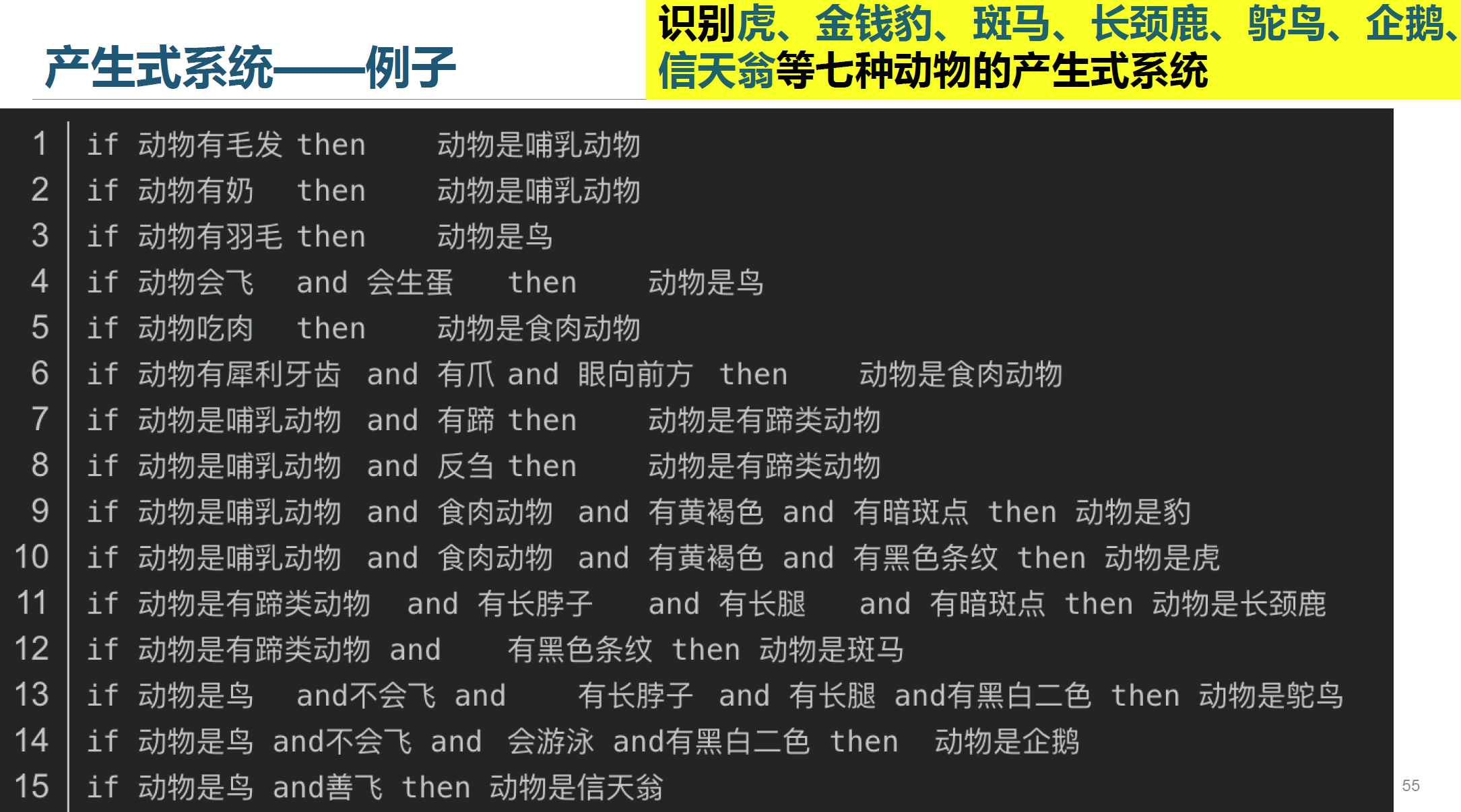

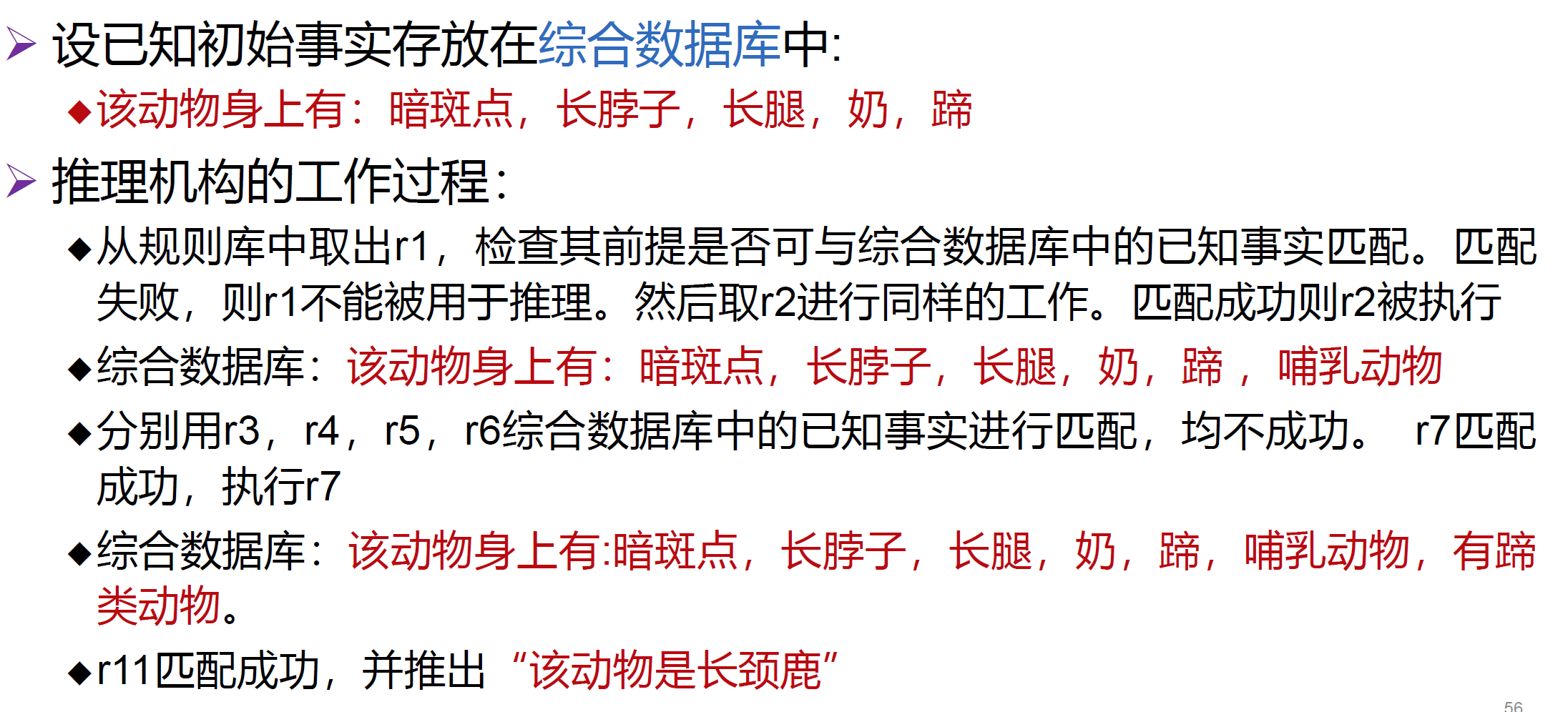

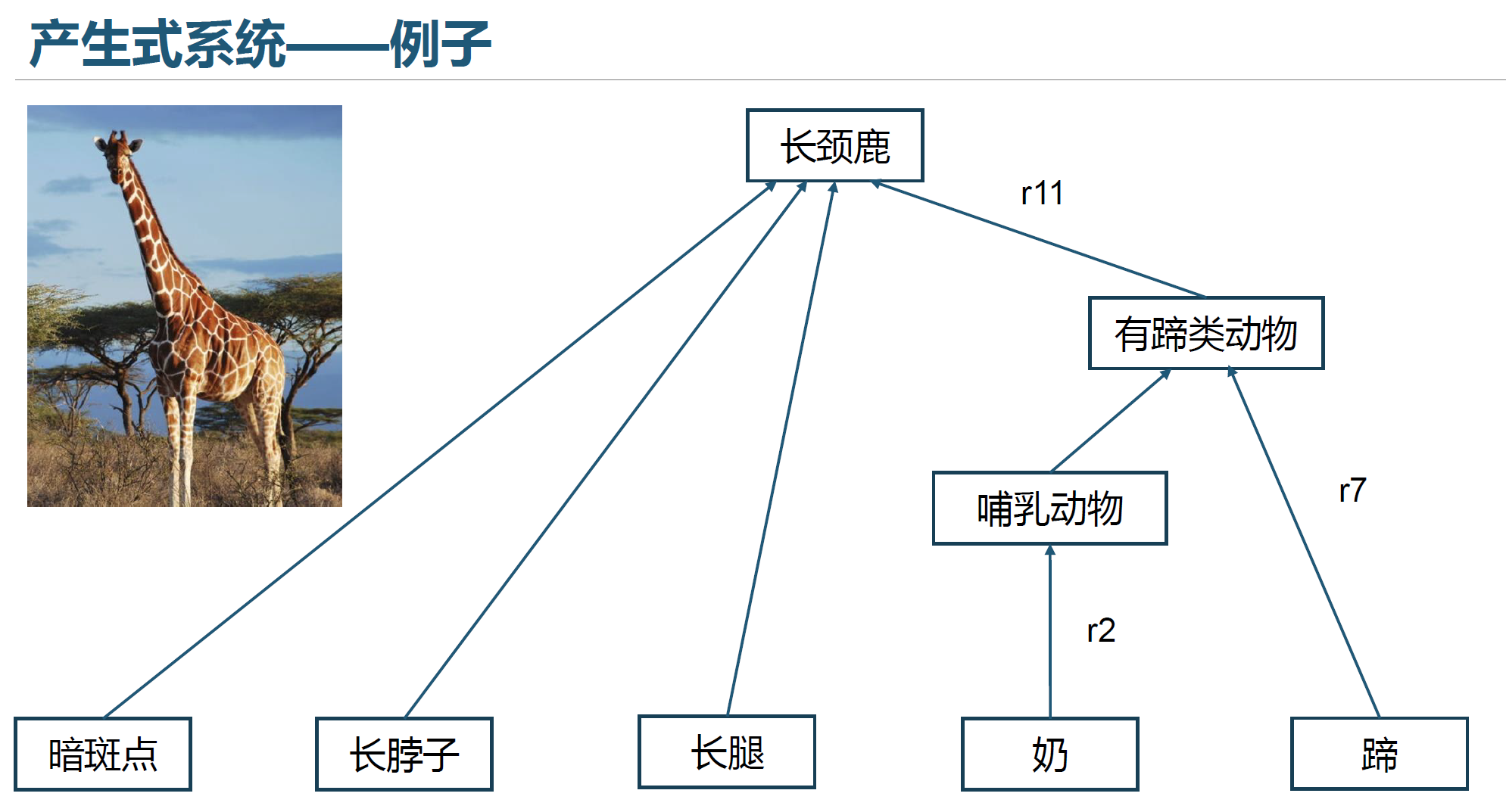

产生式表示法

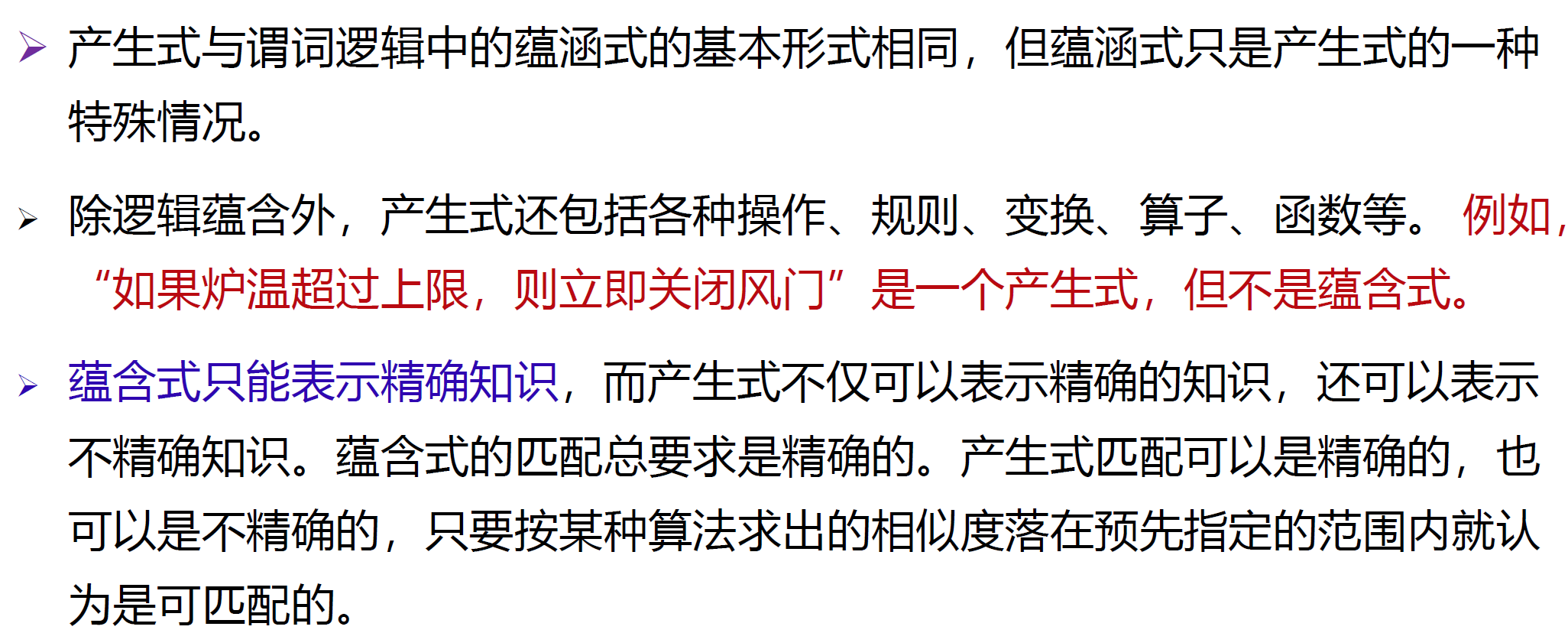

产生式和谓词逻辑中的蕴含式的区别:

例子:

产生式系统小结

优点:自然性、模块性、有效性、清晰性

缺点:效率不高、不能表达结构性知识

适合领域:

①自然性领域知识间关系不密切不存在结构关系;

②经验性及不确定性的知识,且相关领域中对这些知识没有严格 、统一的理论;

③领域问题的求解 过程可被 表示为一系列相对独立的操作 且每个操作可被表示为一条或多条产生式规则。

对人工智能发展的贡献:

专家系统

(专家系统奠基人 斯坦福大学的费根鲍尔)定义:一种智能的计算机程序,运用知识和推理来解决只有专家才能解决的复杂问题。

即: 专家系统可以模拟某个领域专家的决策能力。 如医生的诊断能力、数据分析解释能力、预测能力、判断能力等。

专家系统的局限性:

随着时代发展,人工建设专家系统的效率低、成本高,逐渐成为历史,但基于知识的人工智能方法仍然在不断进步。

近几年来成为研究热点的知识图谱,某种程度上就可以看作是大规模的知识集合。

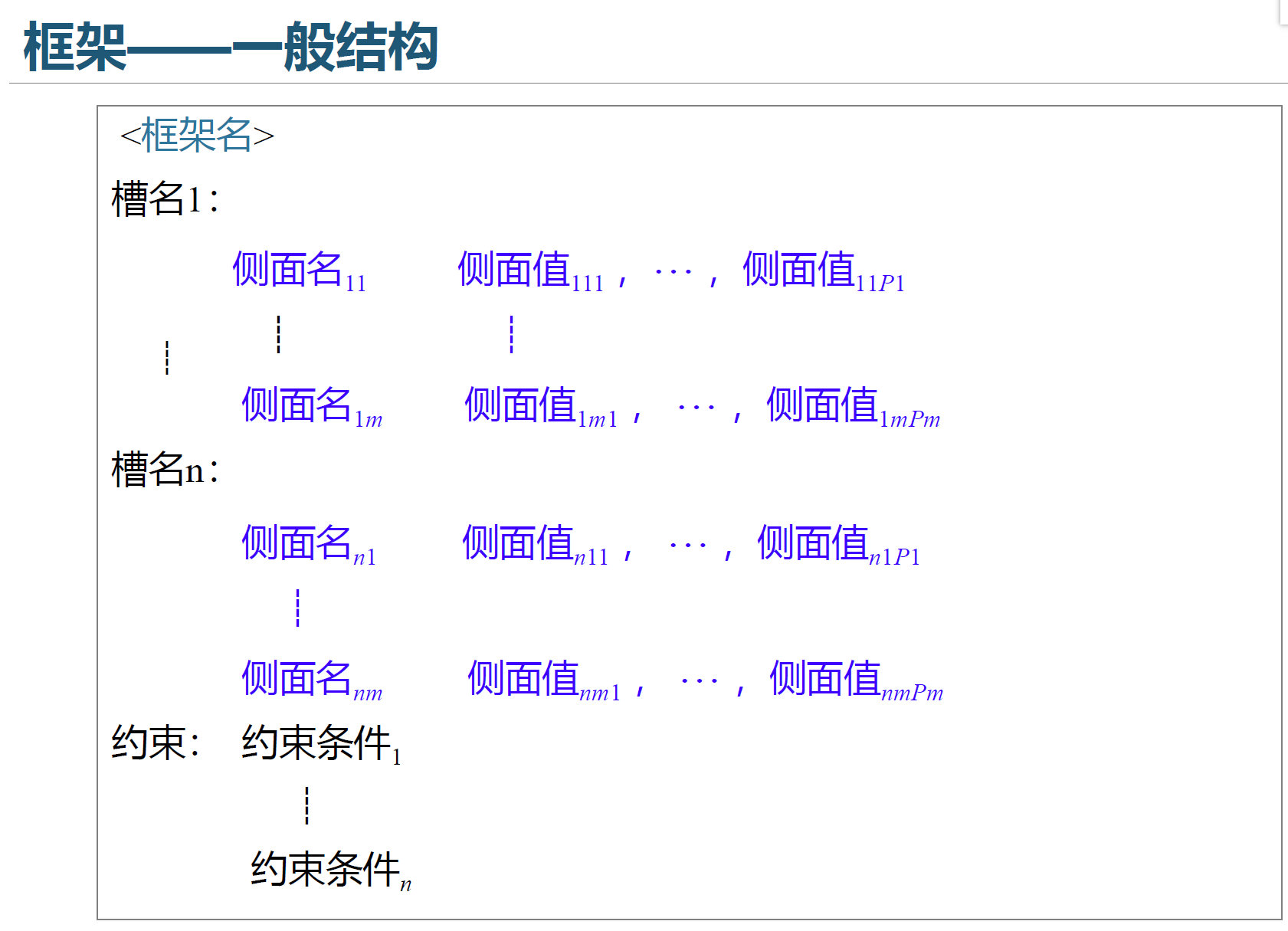

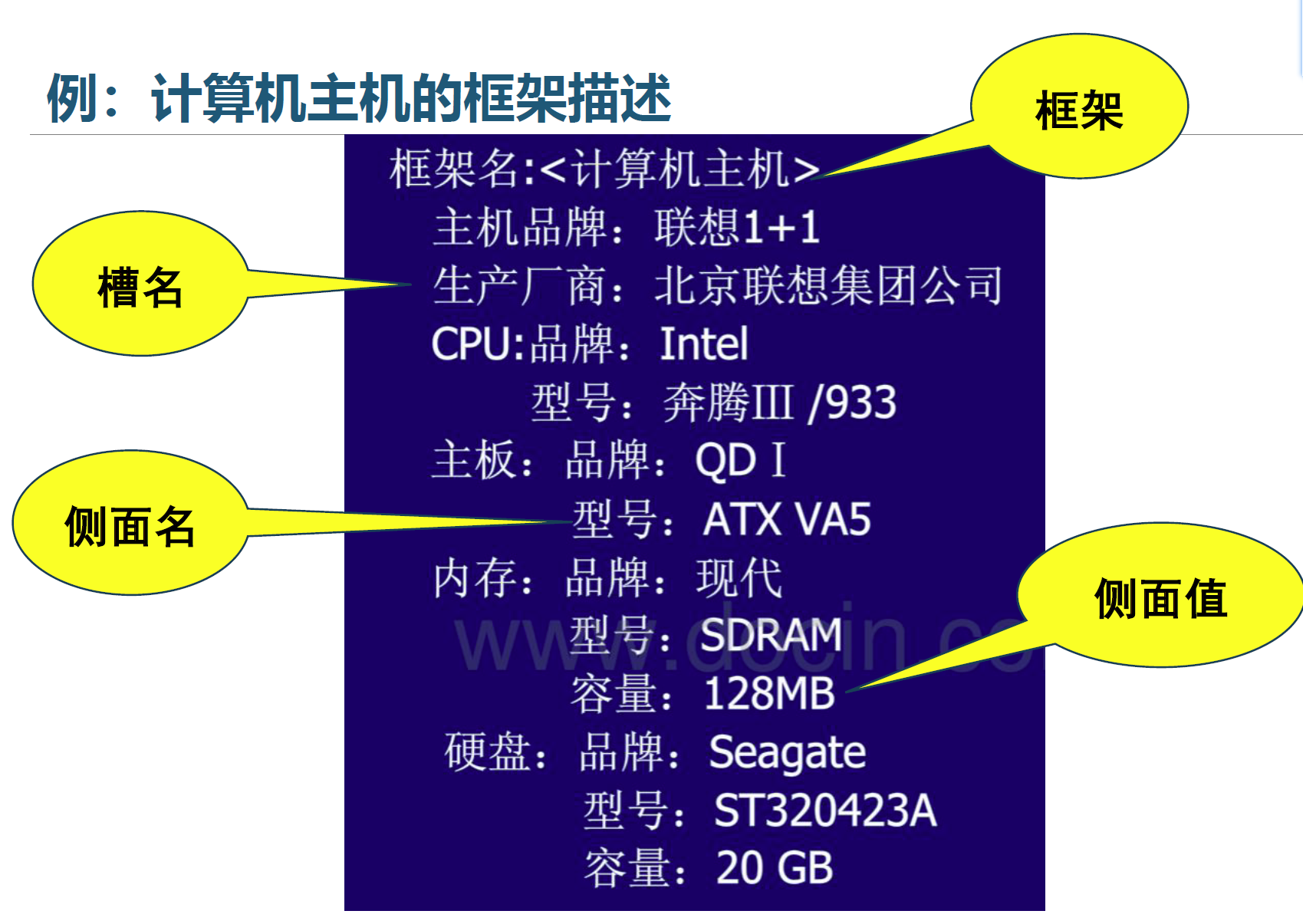

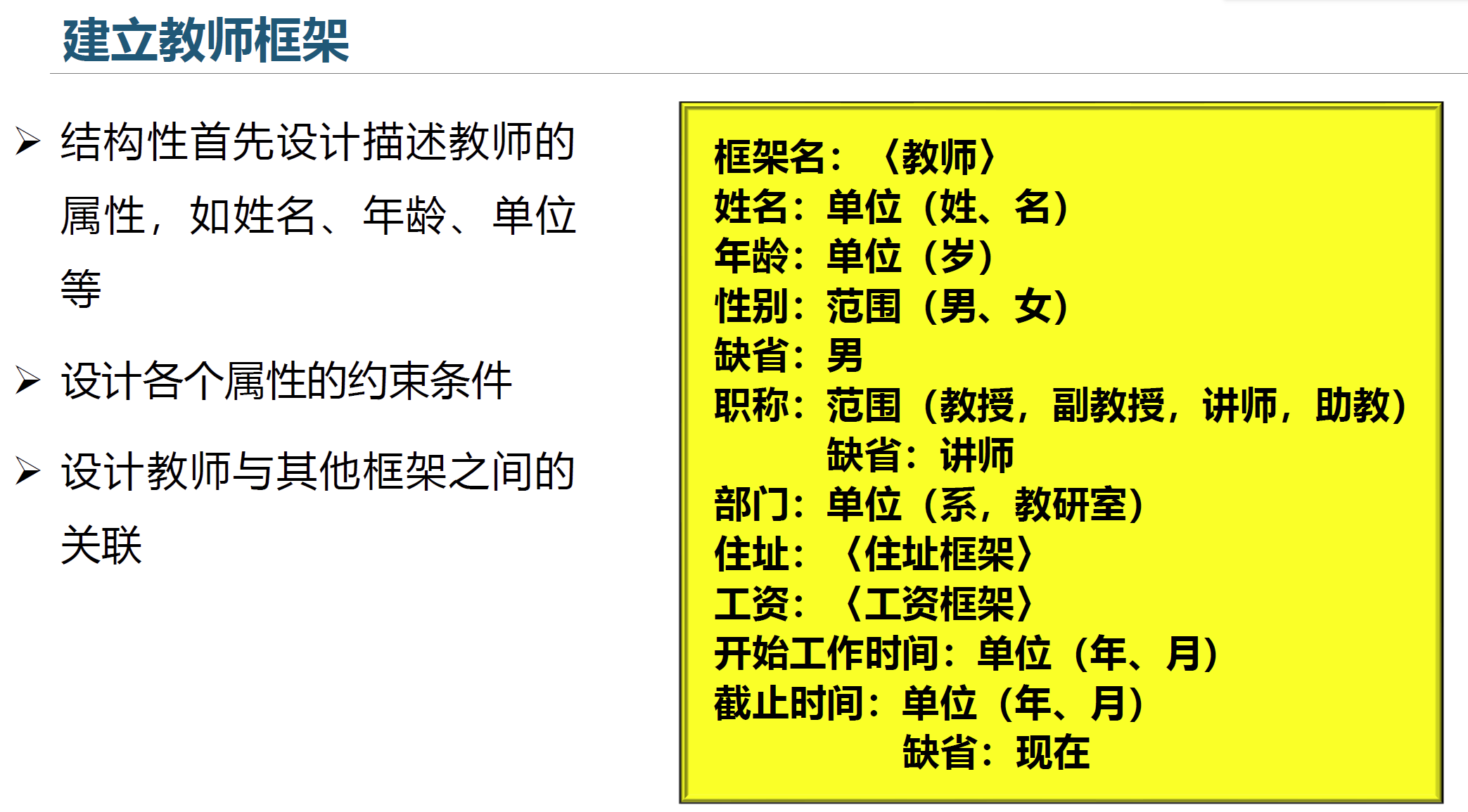

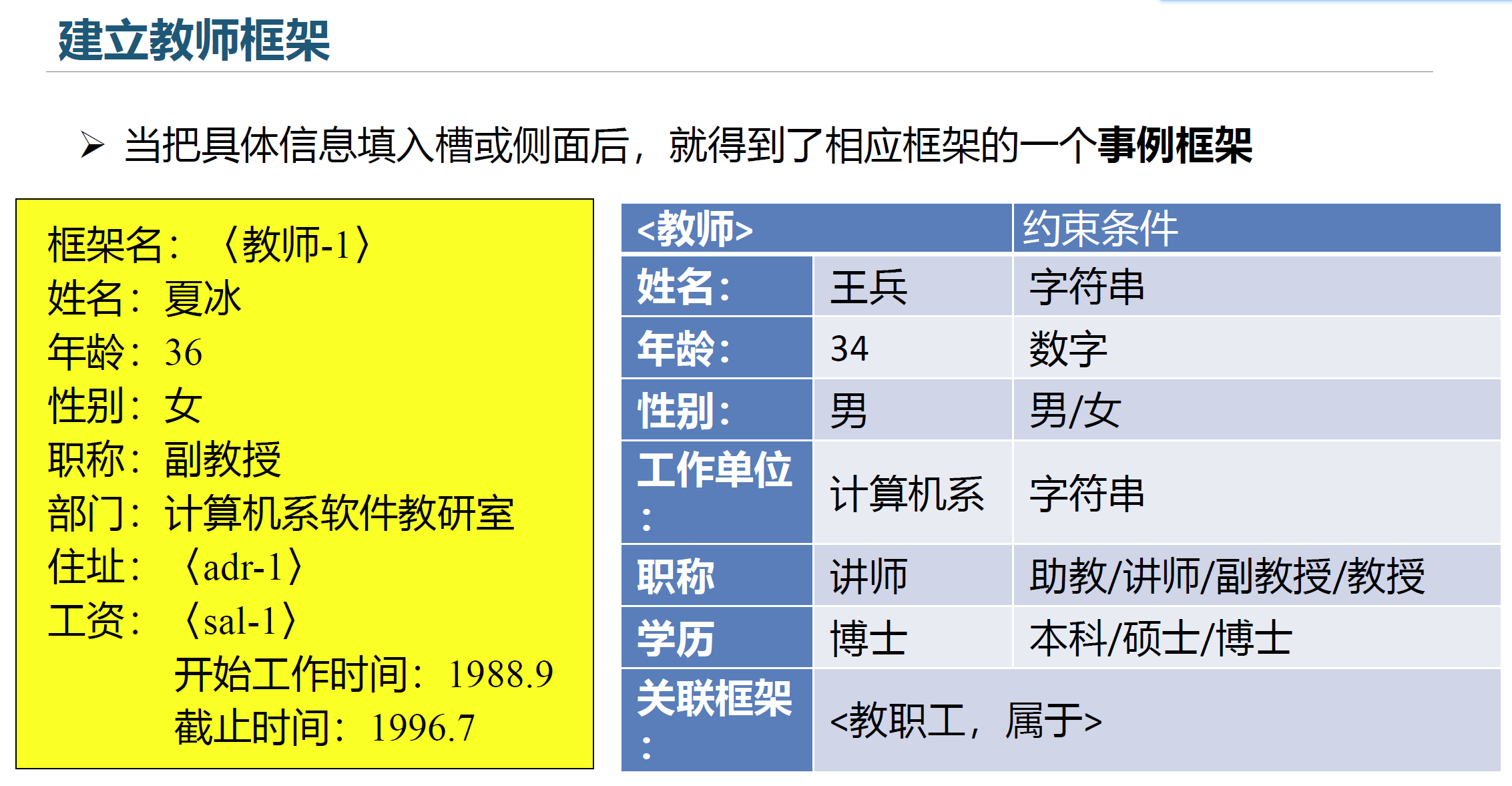

框架表示法

框架表示法:一种结构化的知识表示方法,已在多种系统中得到应用。

例如:

框架表示法特点:

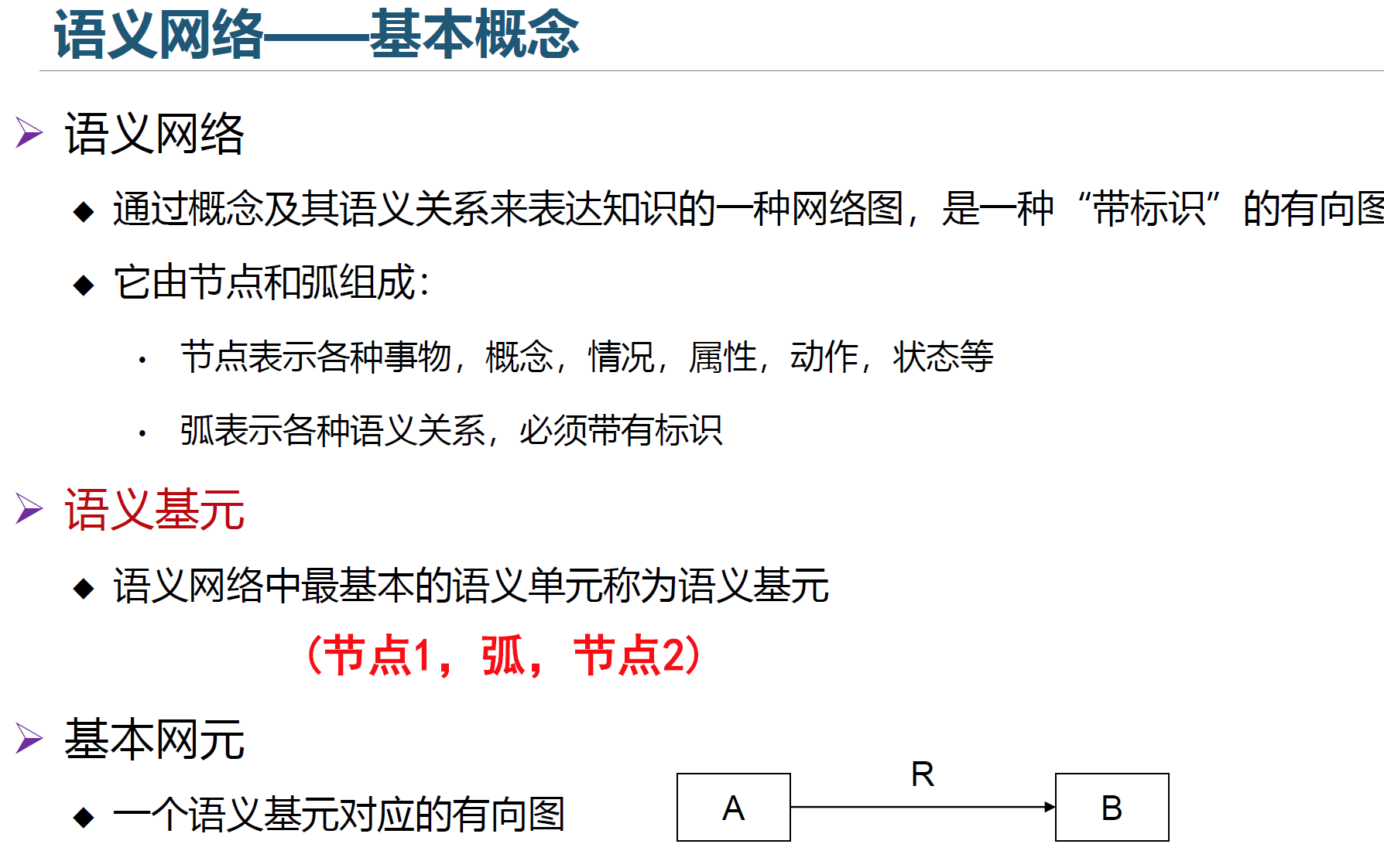

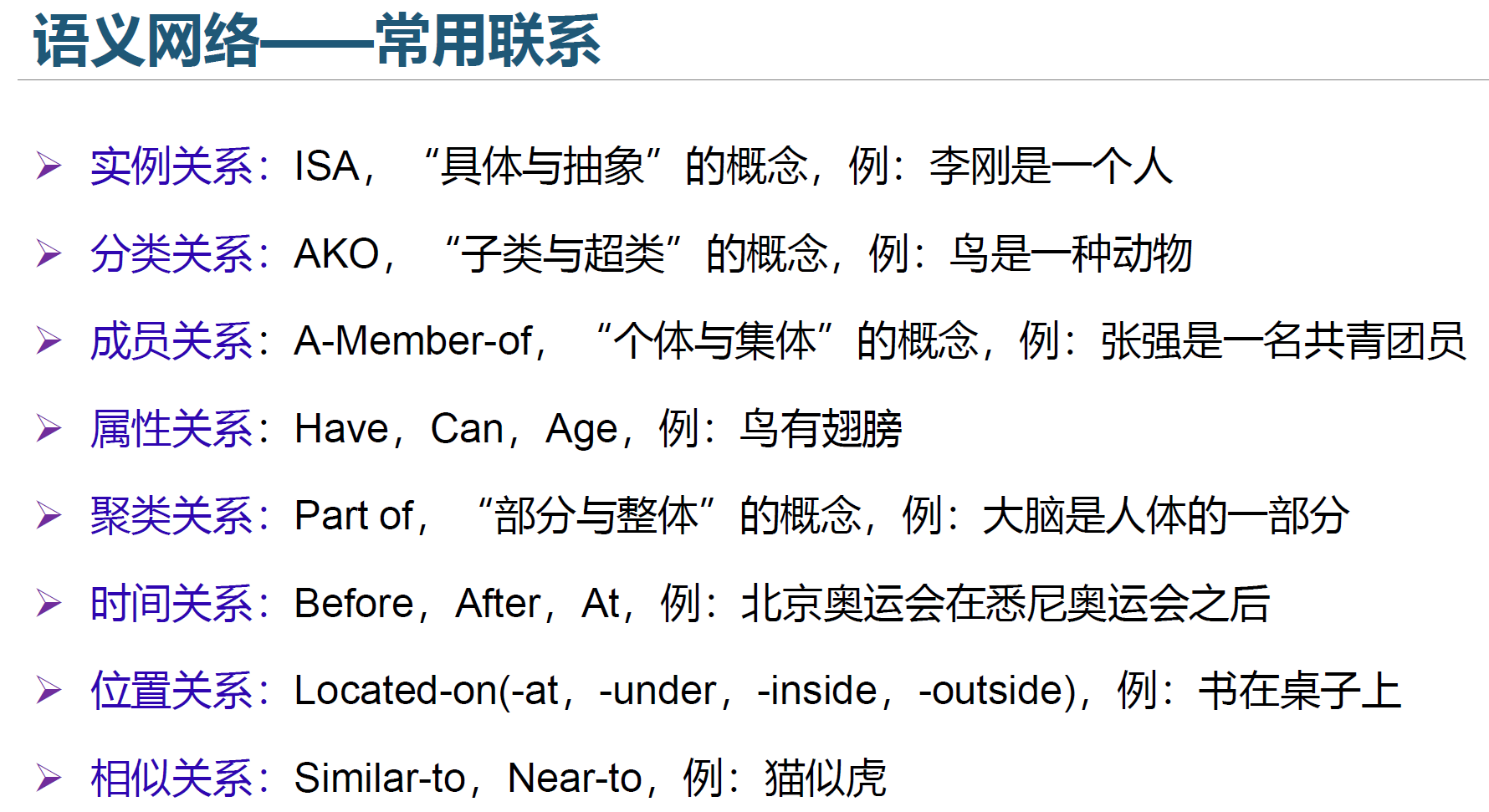

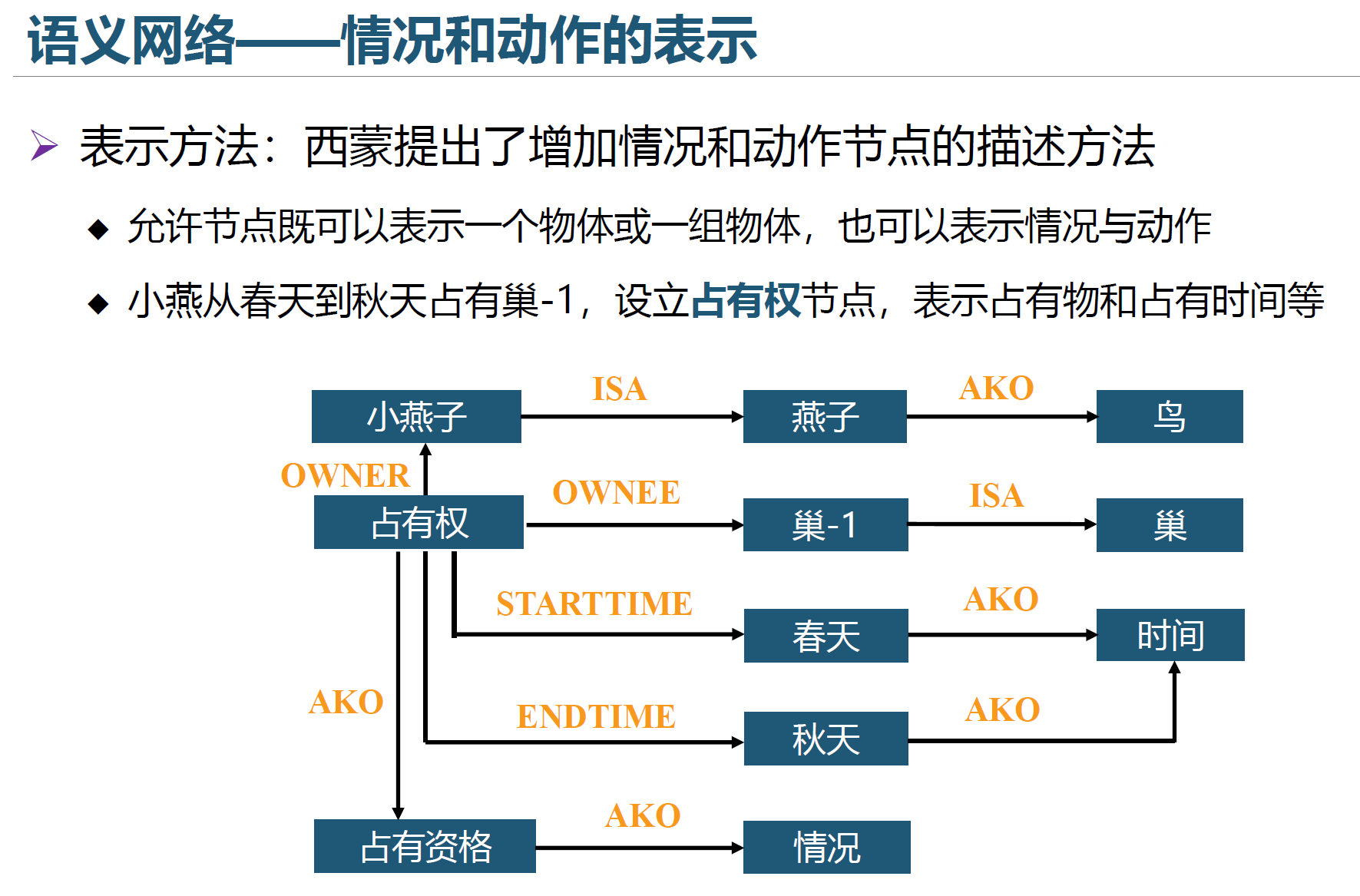

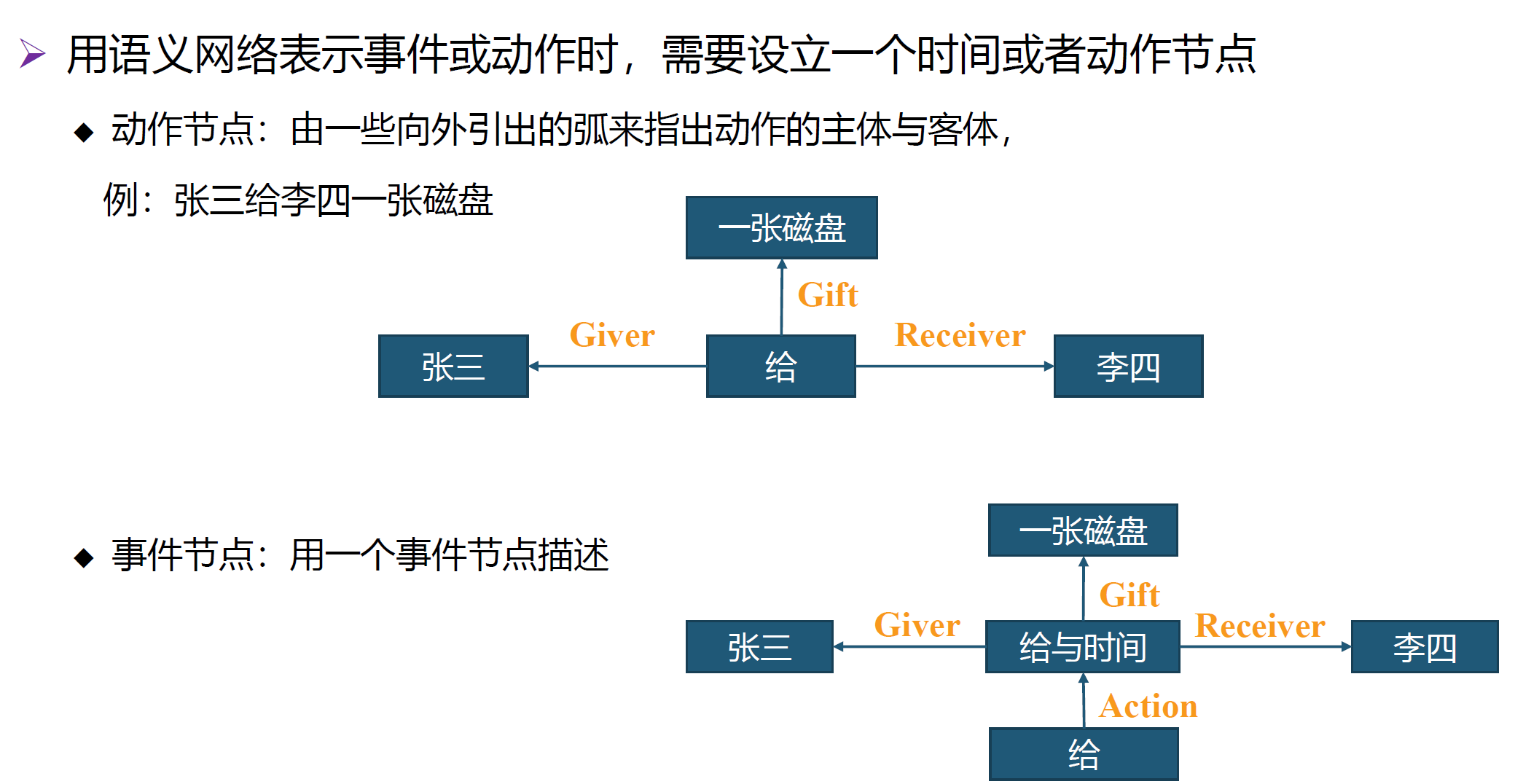

语义网络表示法

语义网络的特点

优点:结构性、联想性、自索引性、自然性;

缺点:非严格性、复杂性

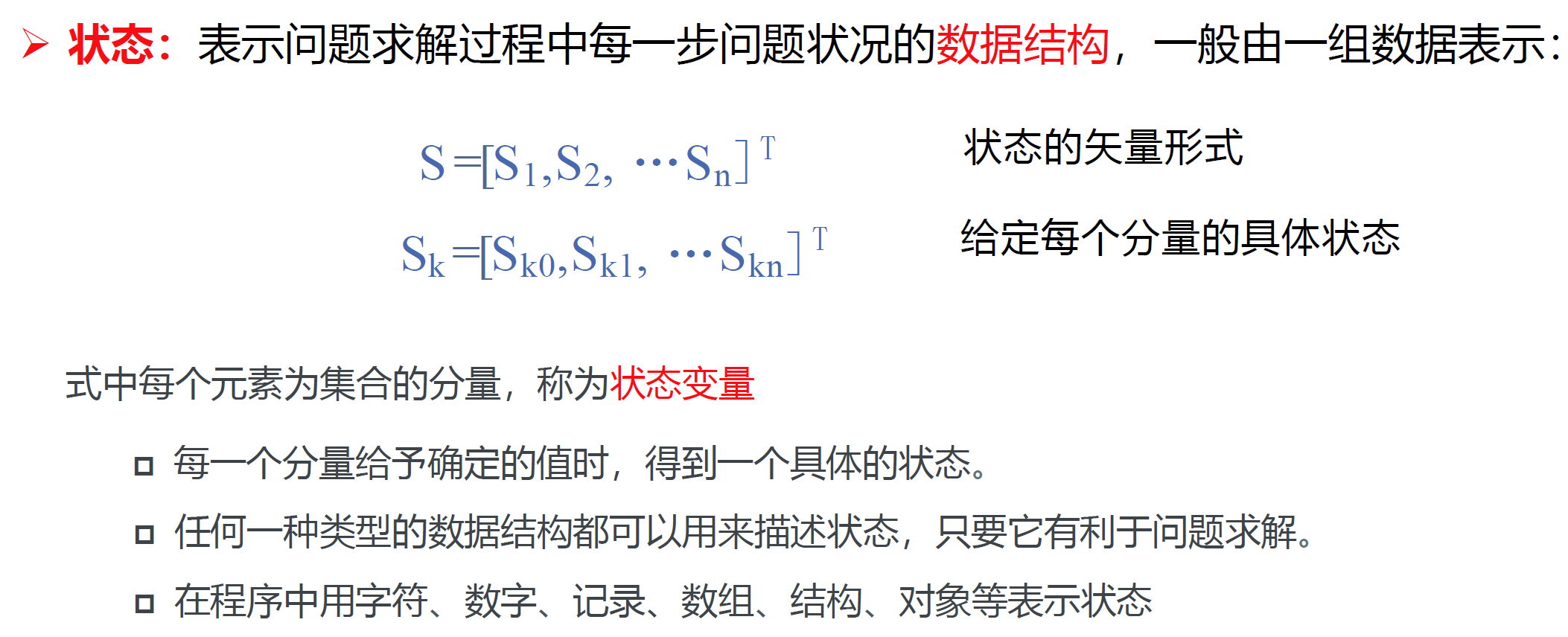

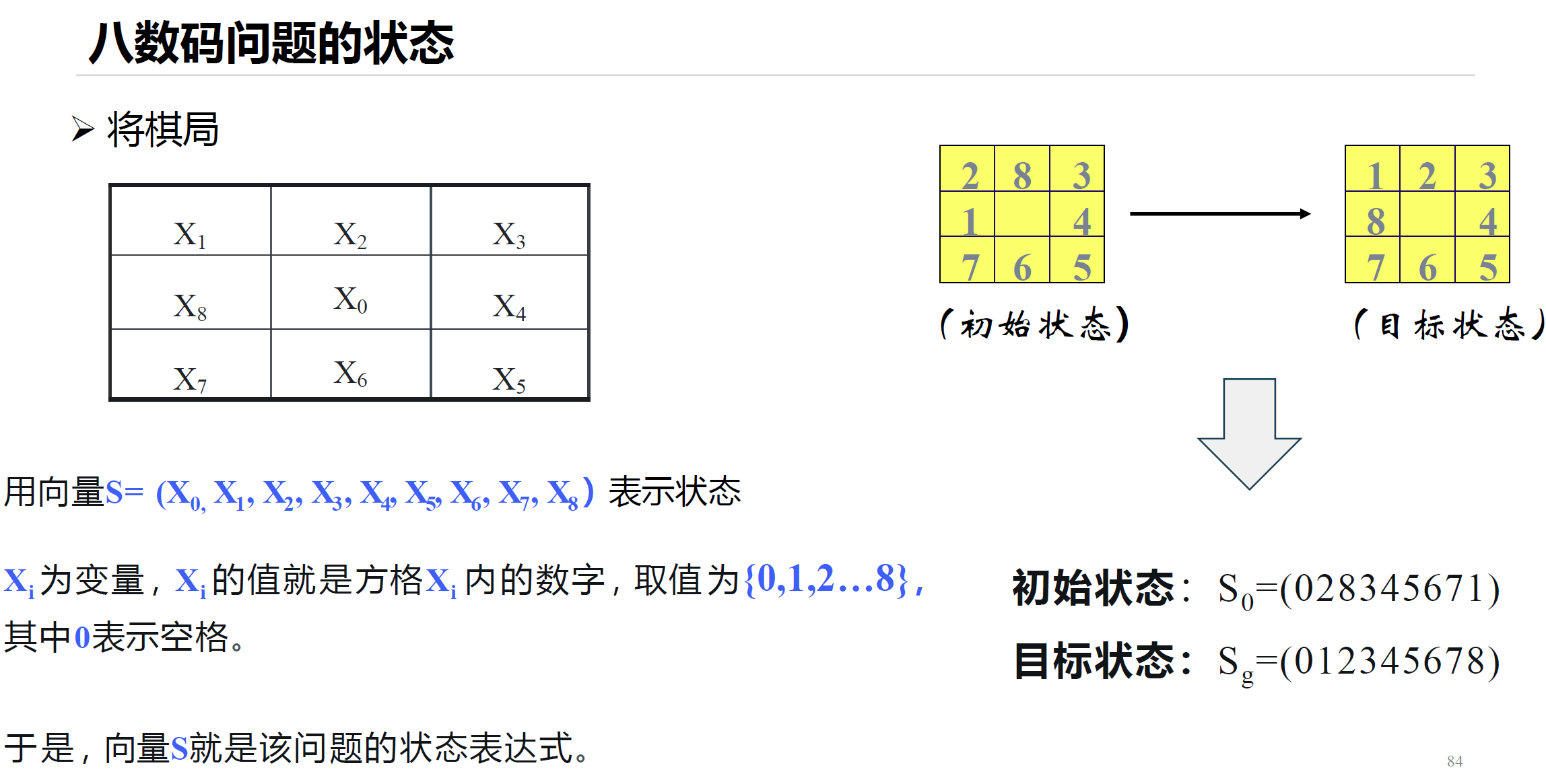

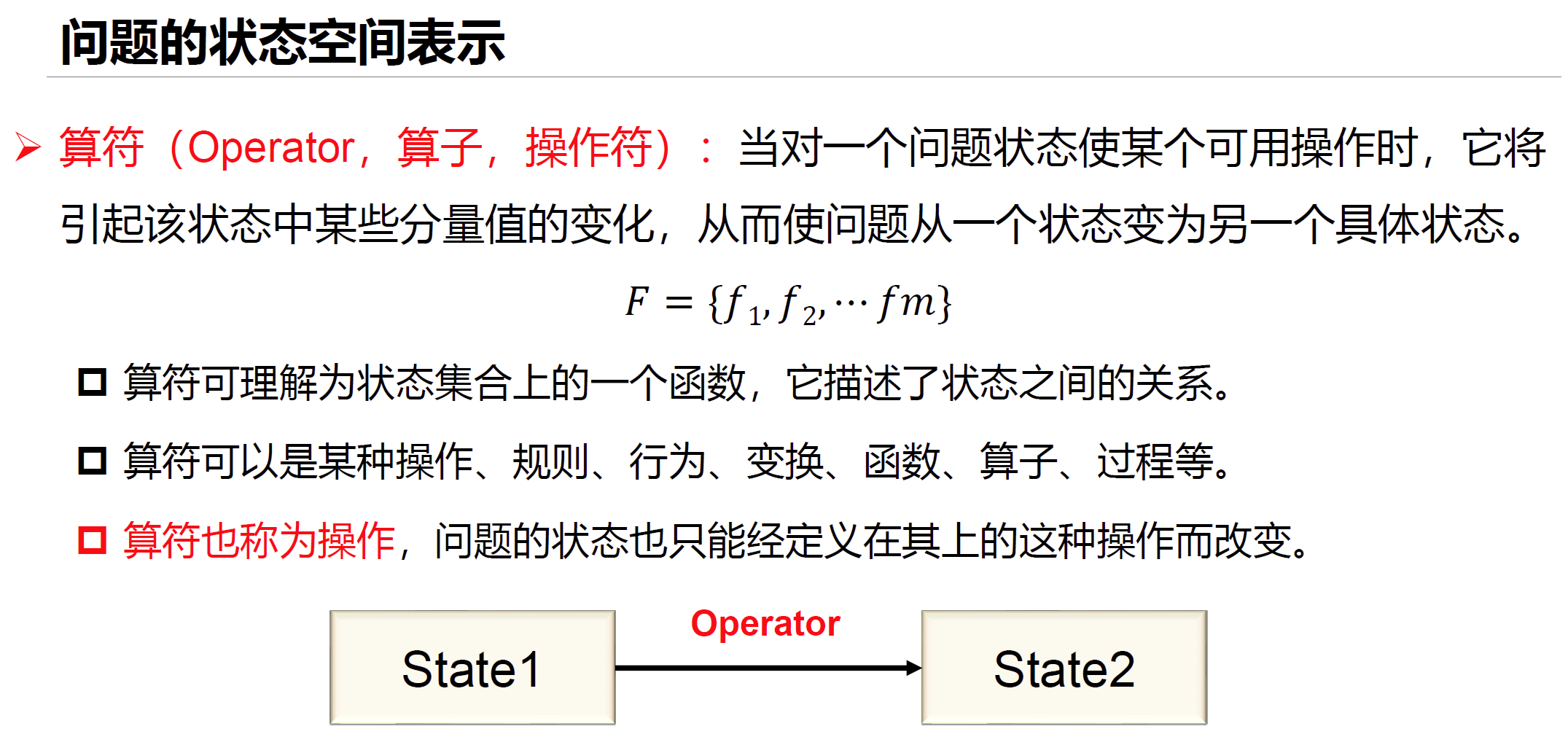

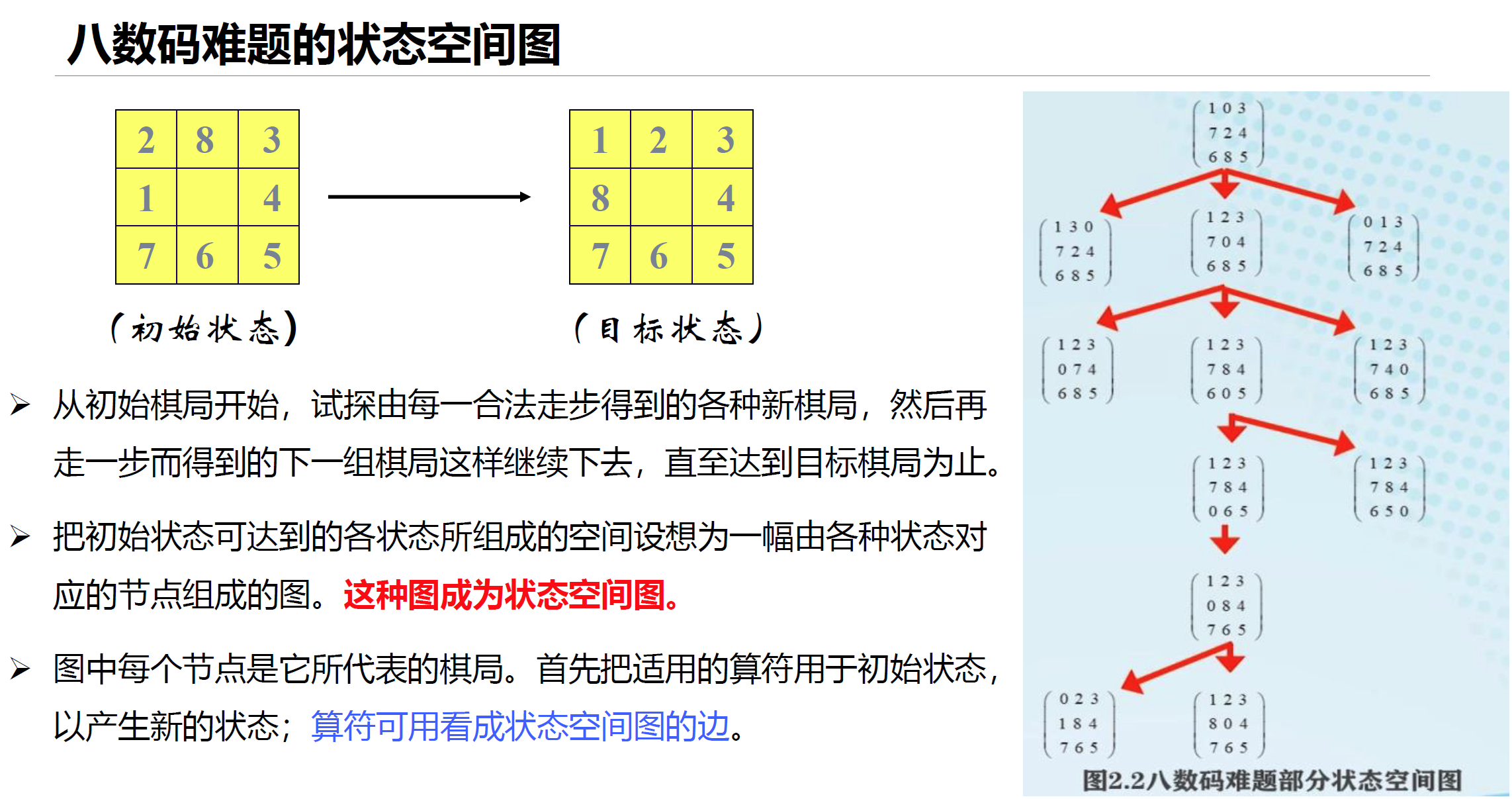

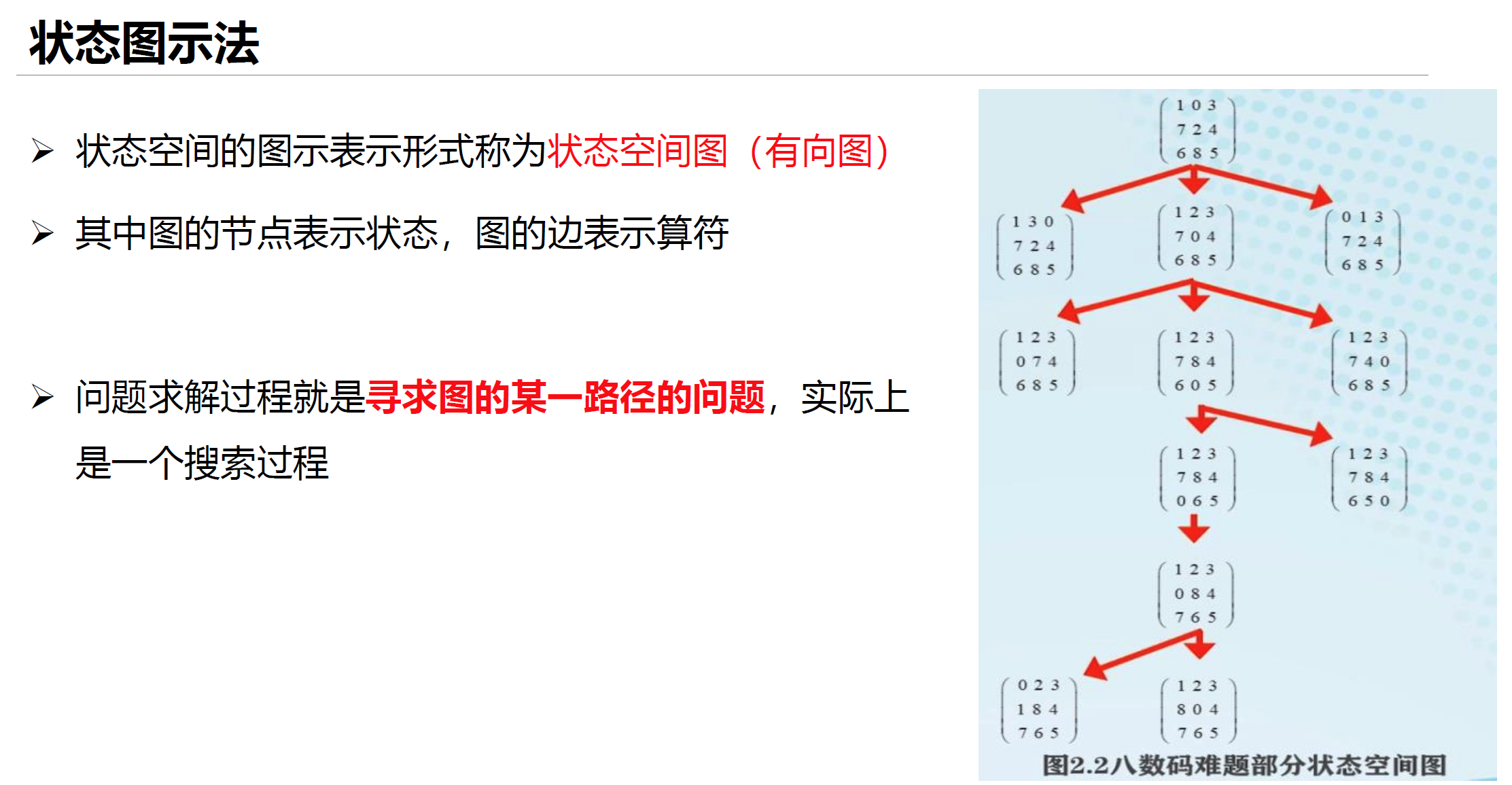

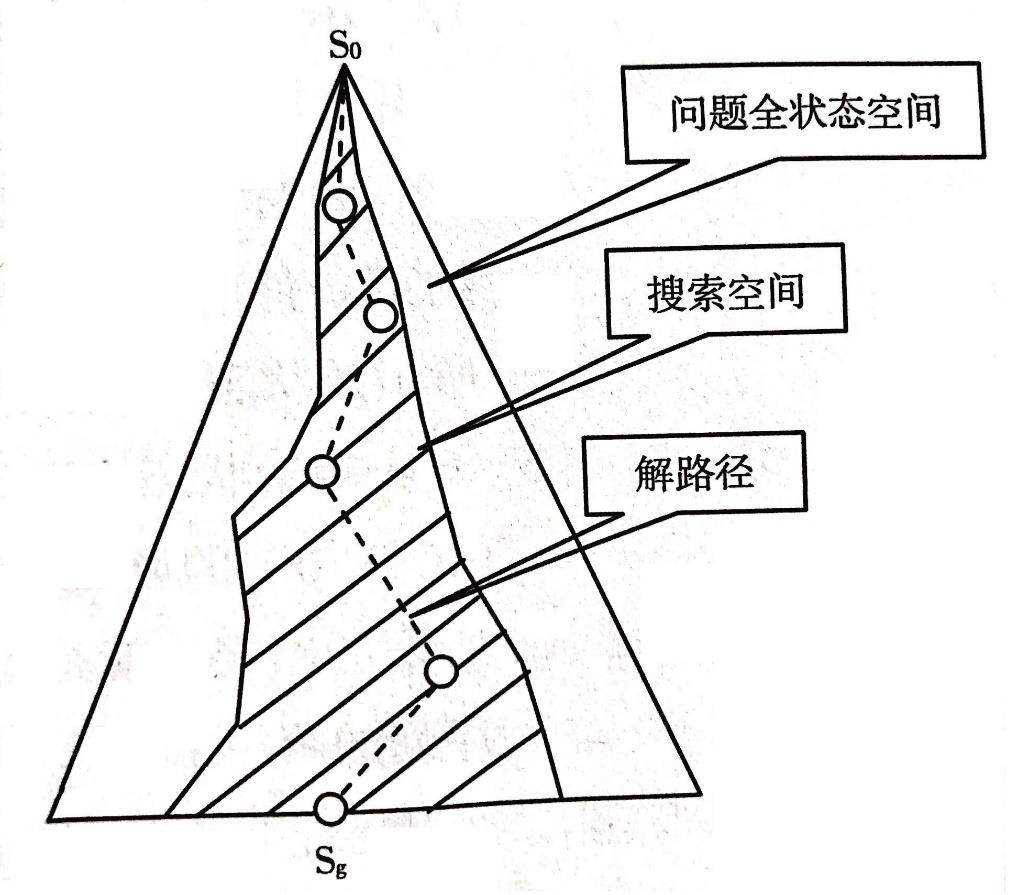

状态空间表示法

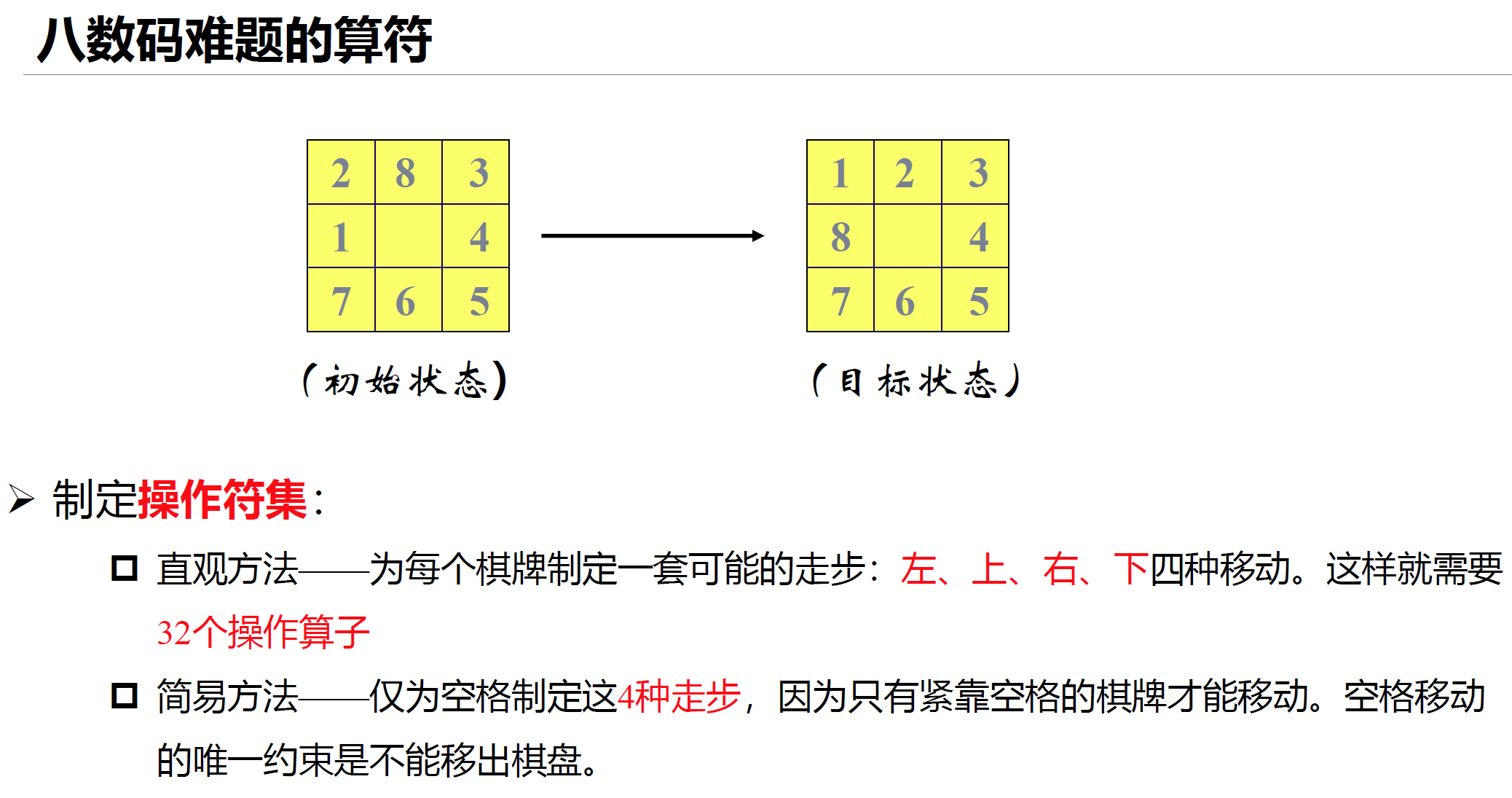

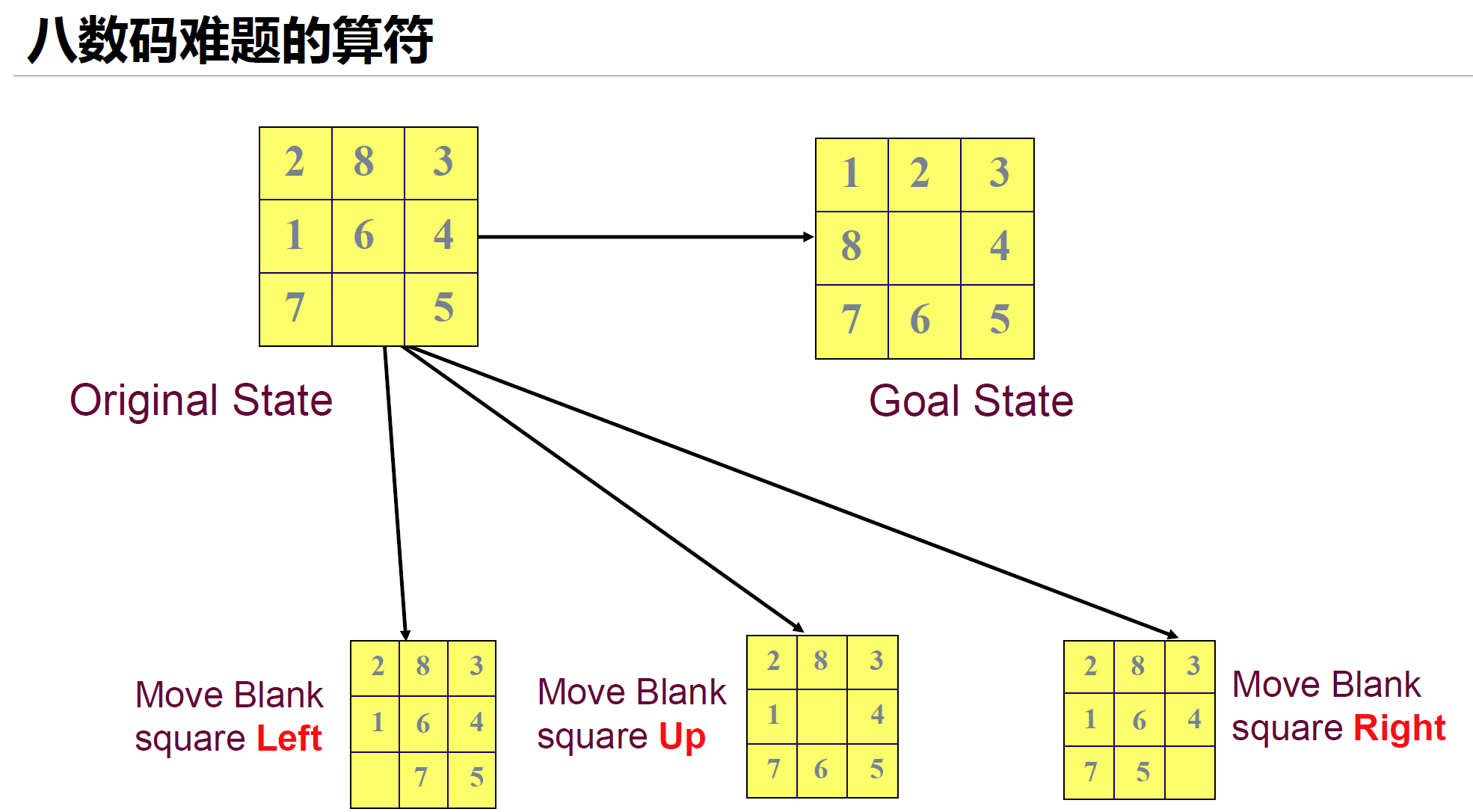

状态空间表示法: 用来表示问题及其搜索过程的一种方法,它是以状态和算符为基础来表示和求解问题的。

主要包括:

①状态

②操作

③状态空间

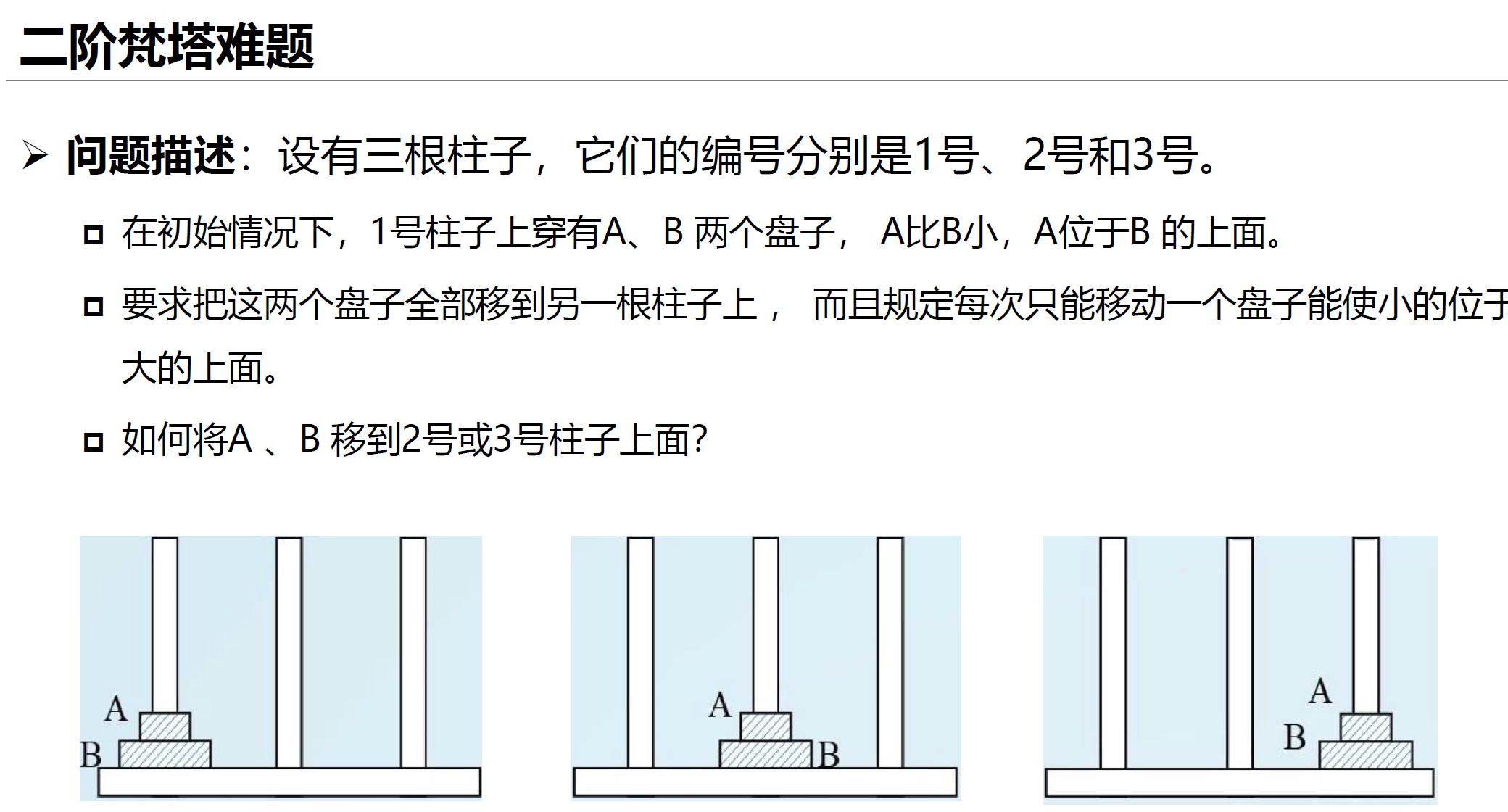

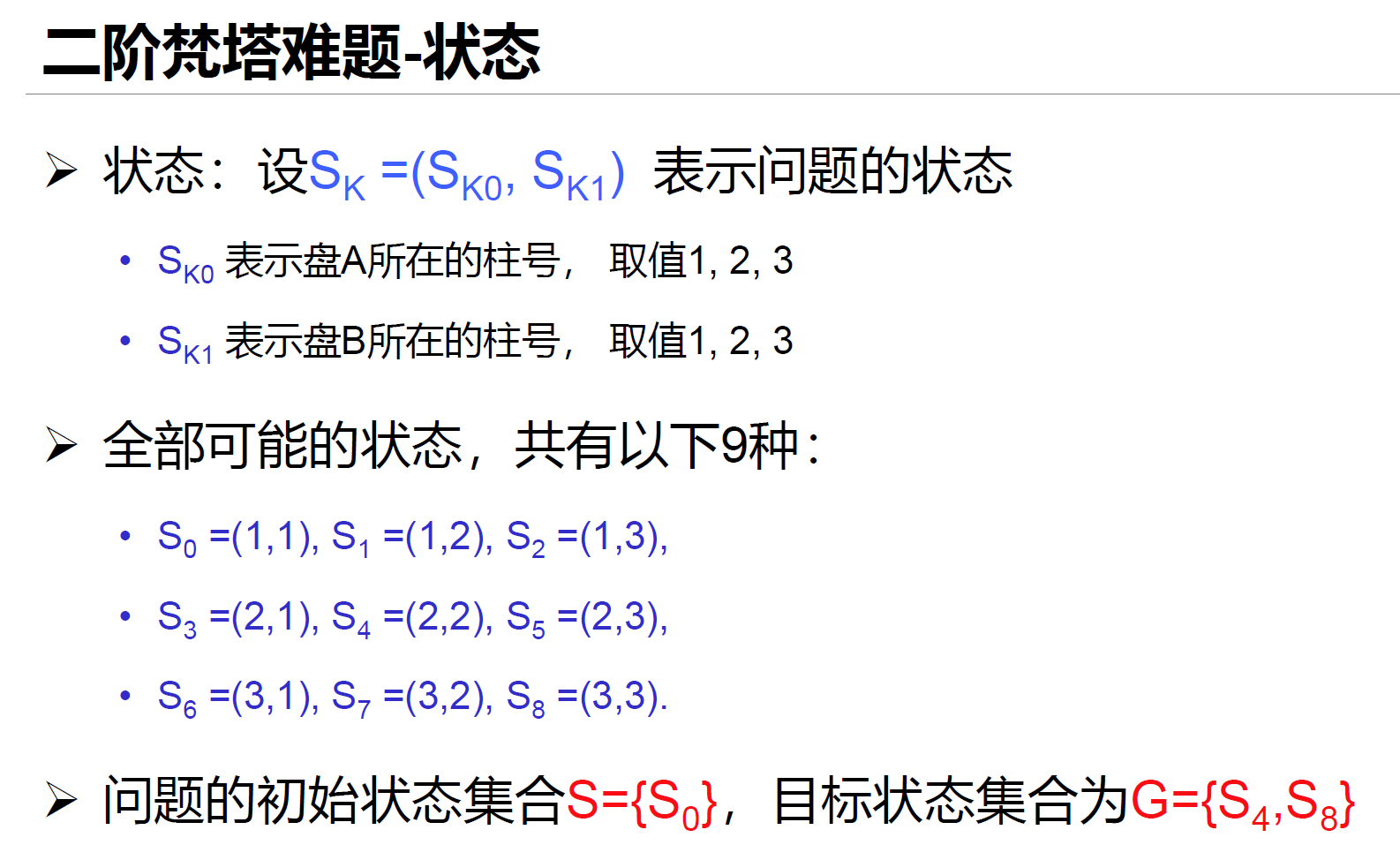

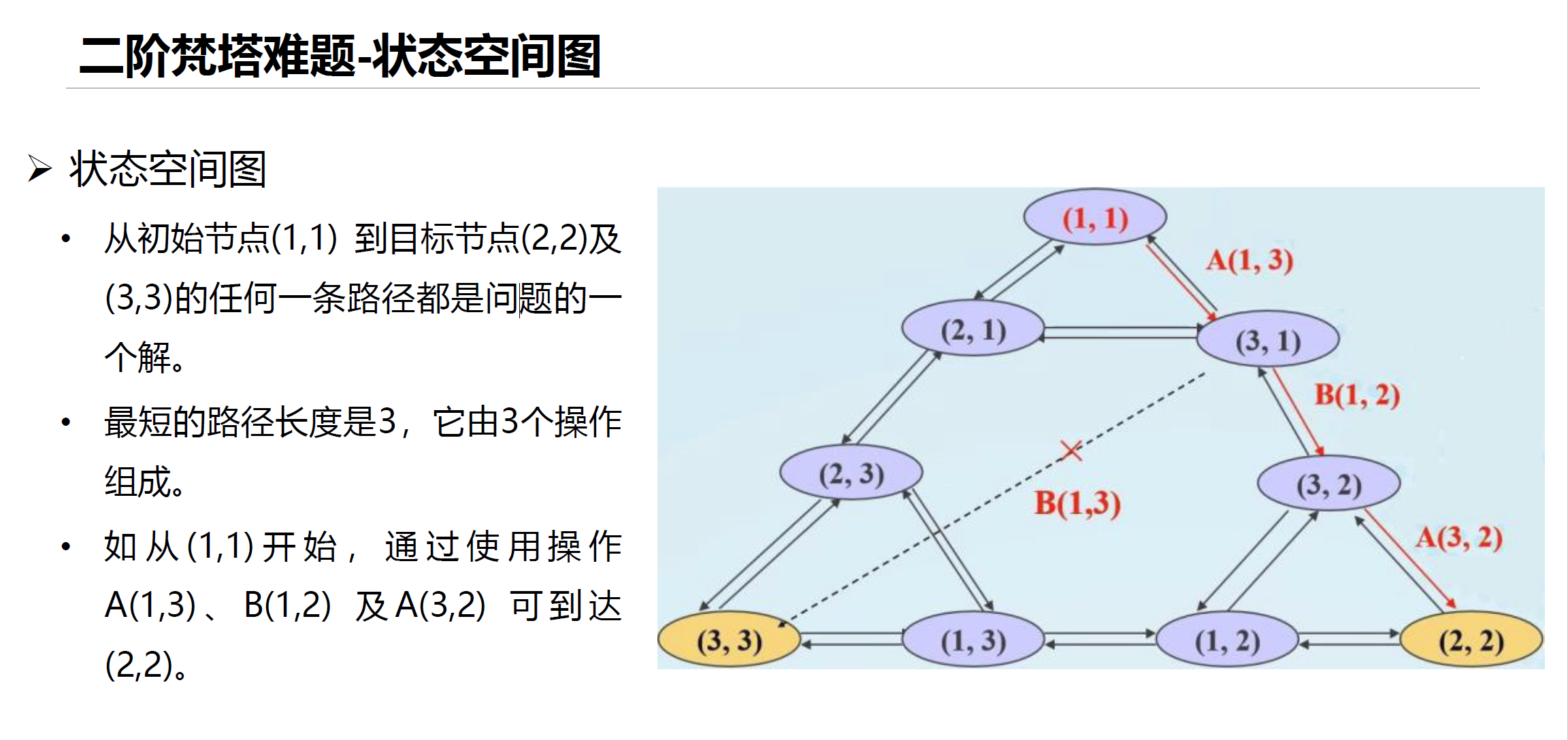

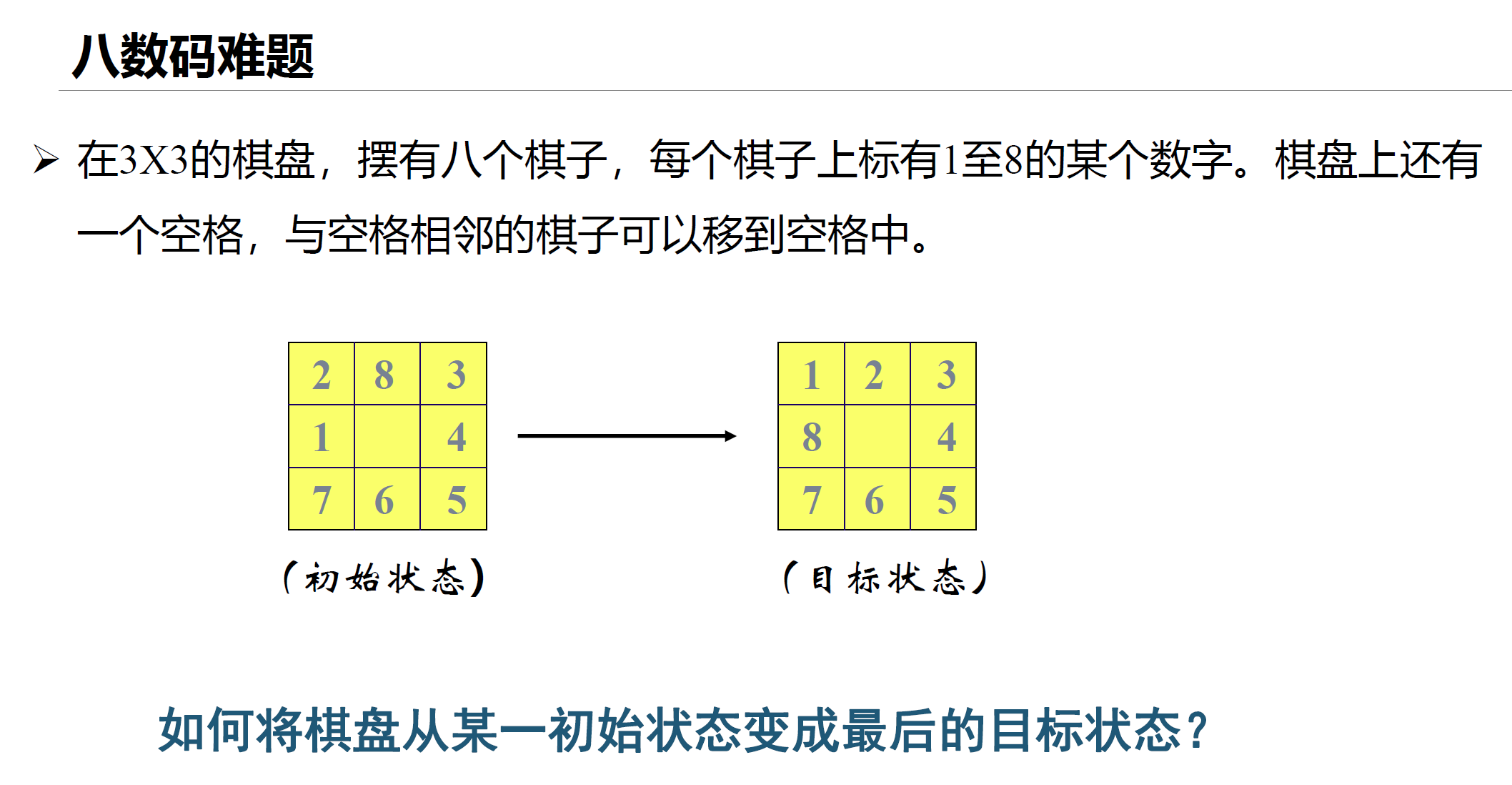

二阶梵塔难题

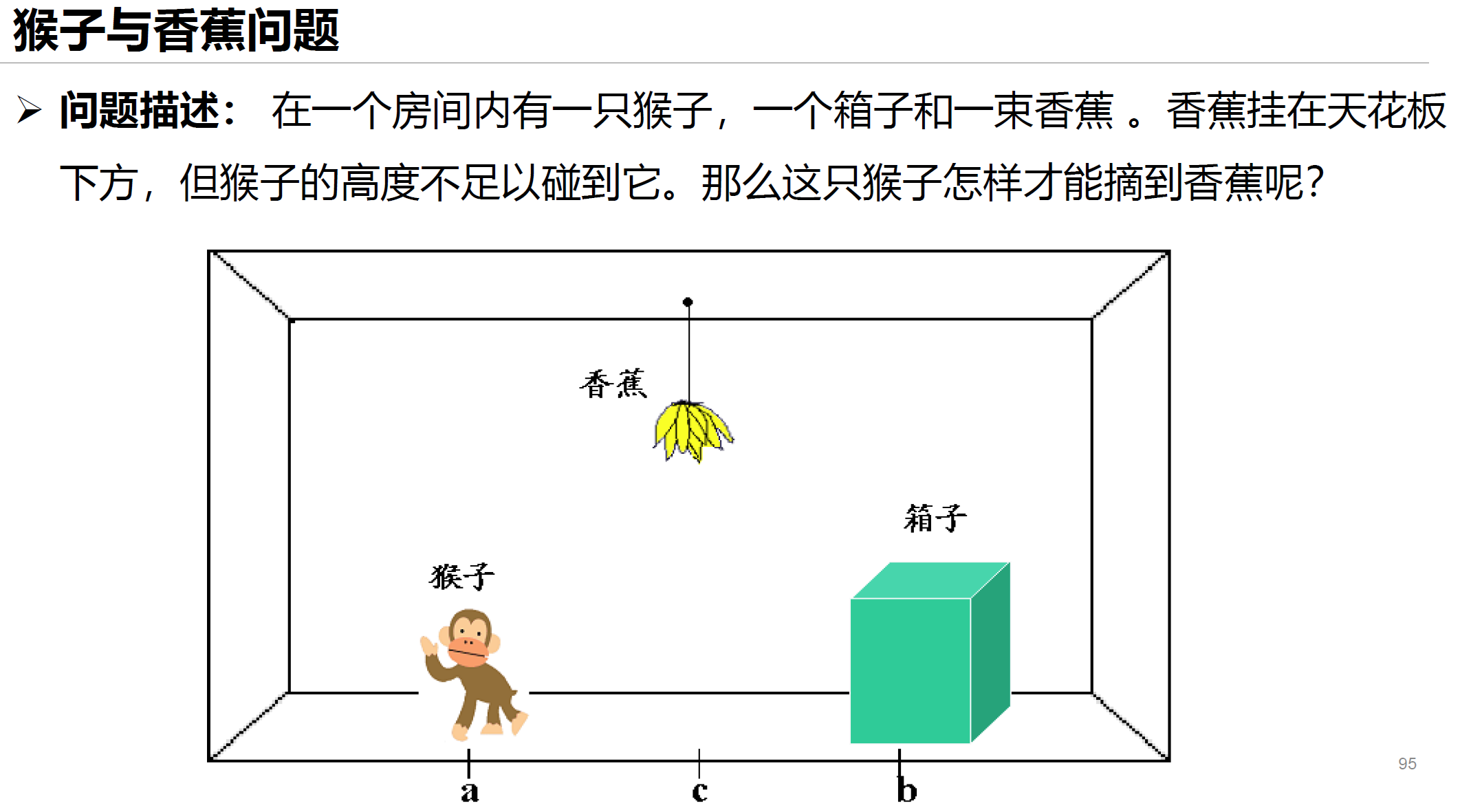

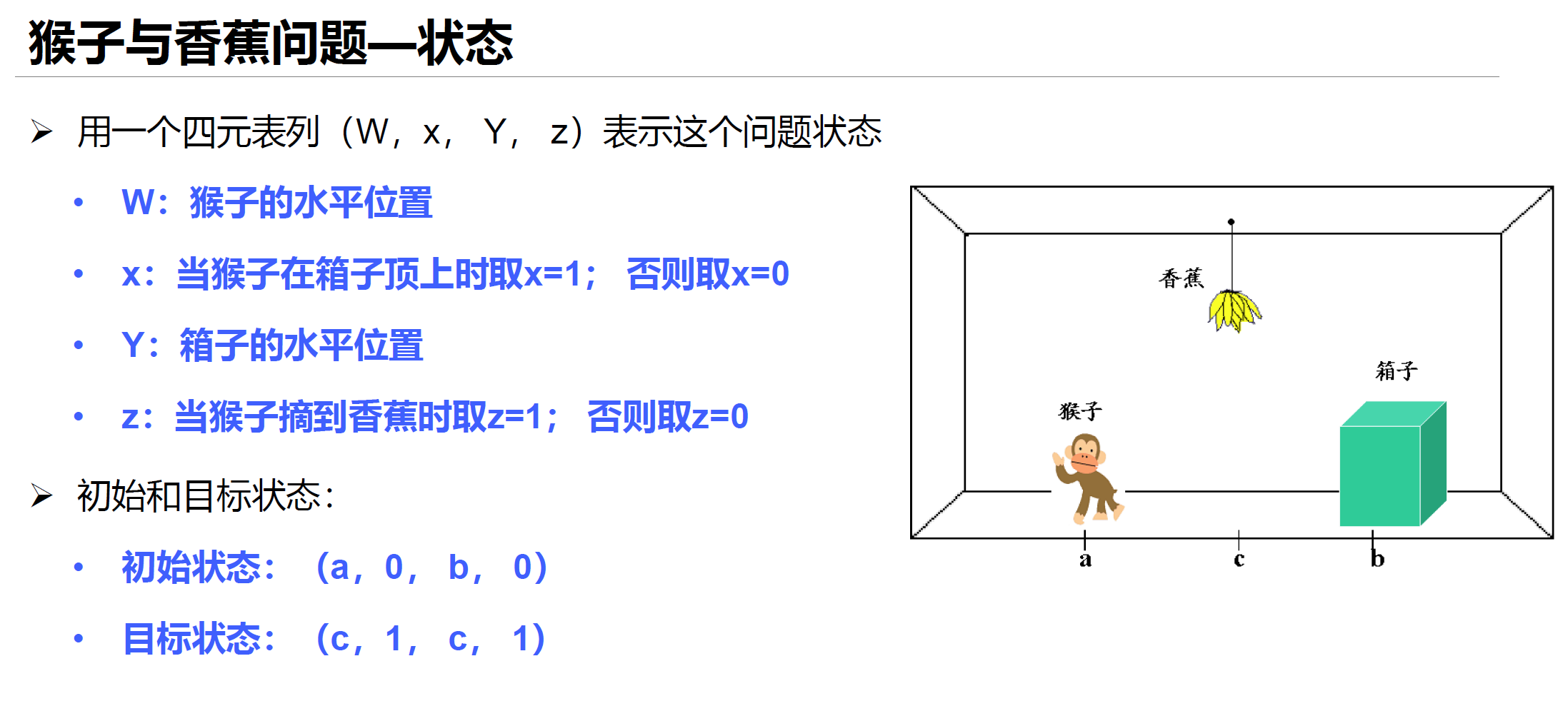

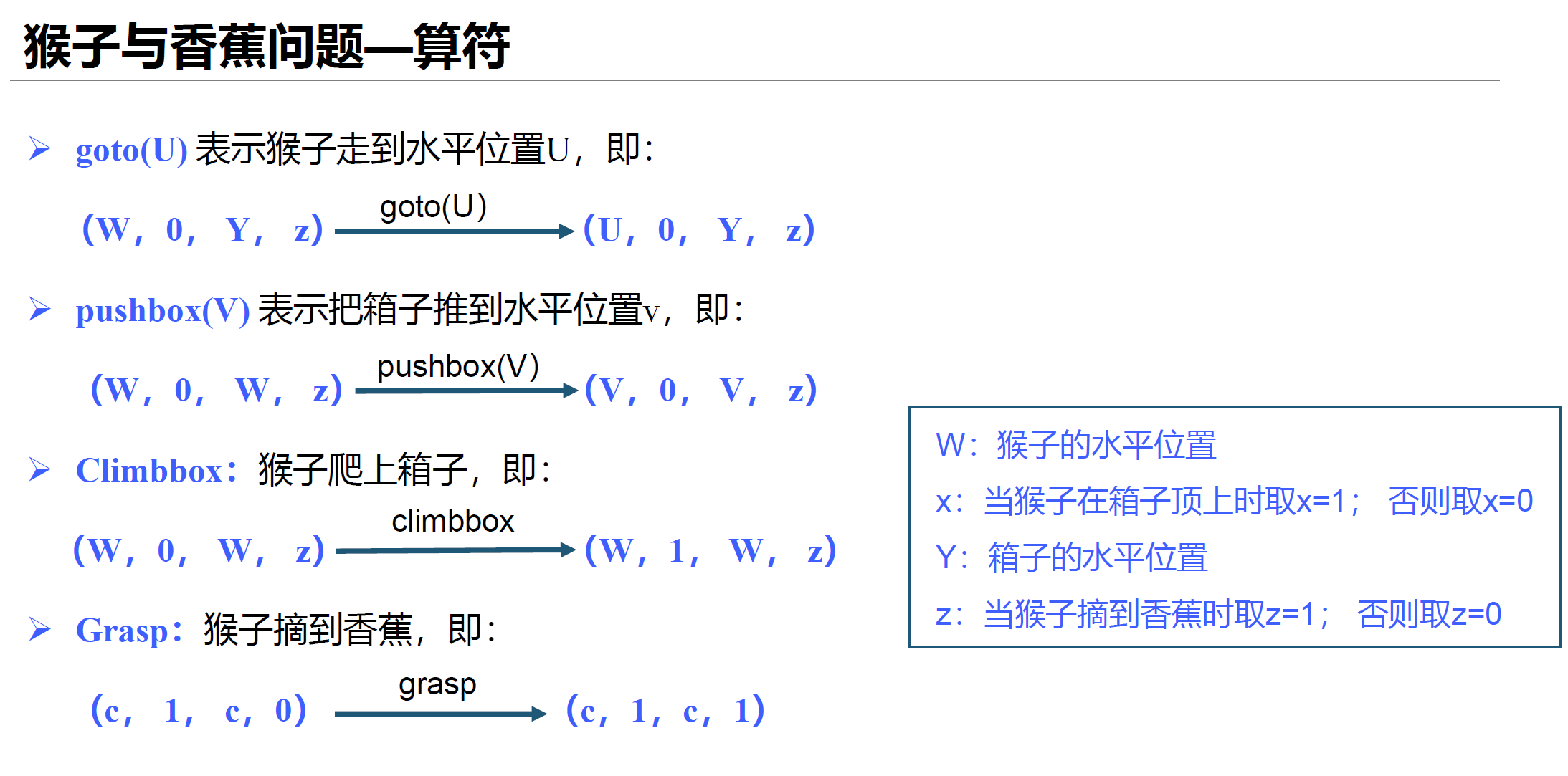

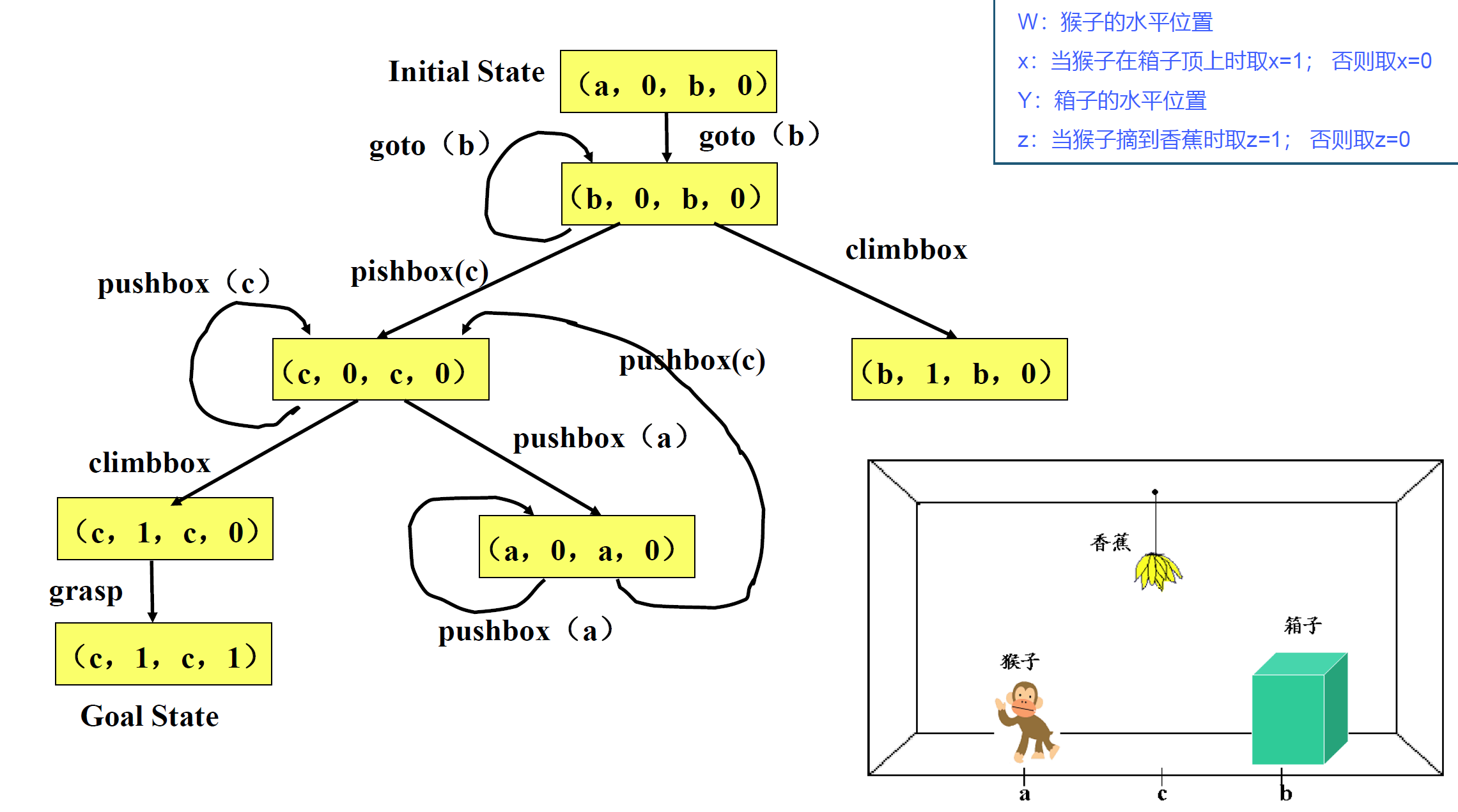

猴子与香蕉问题

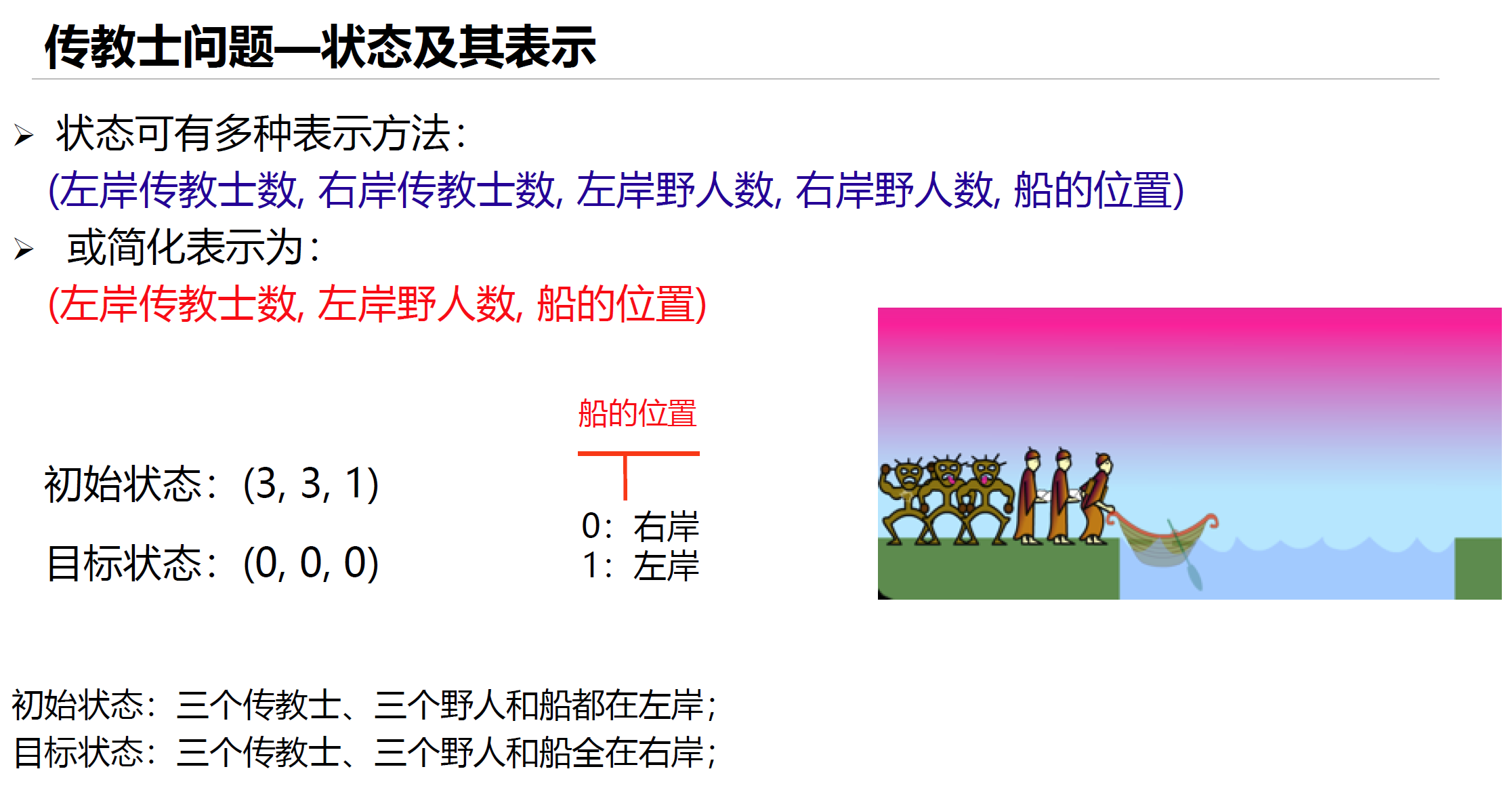

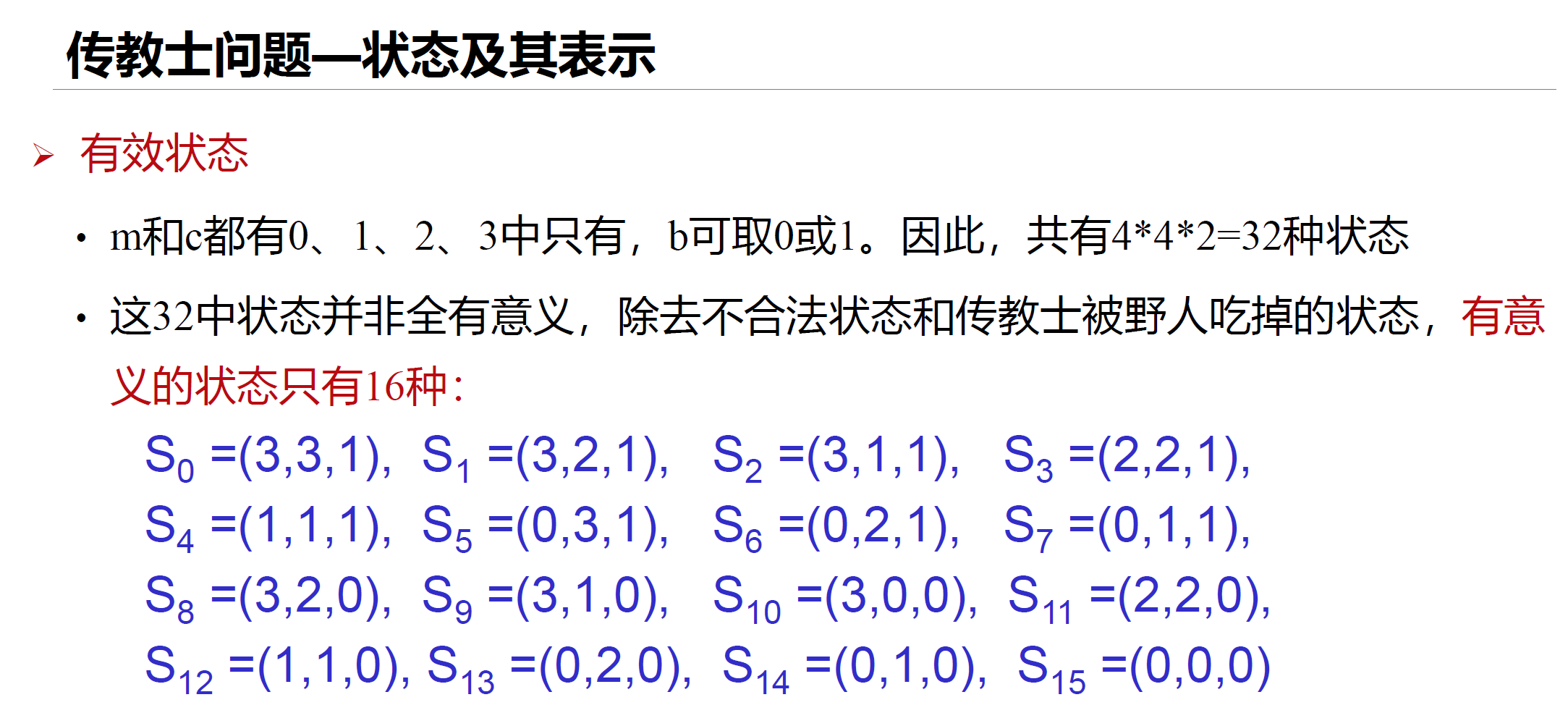

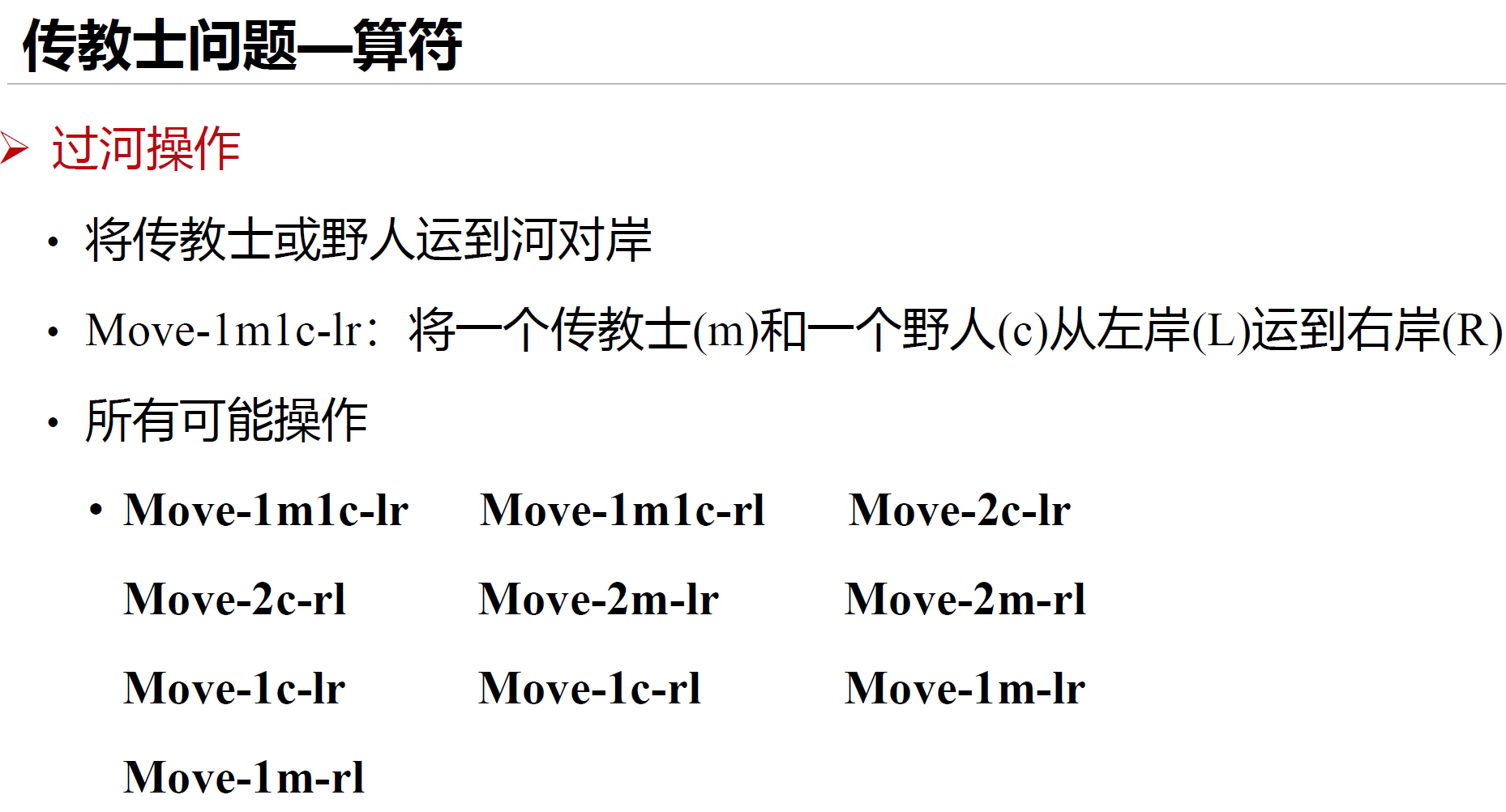

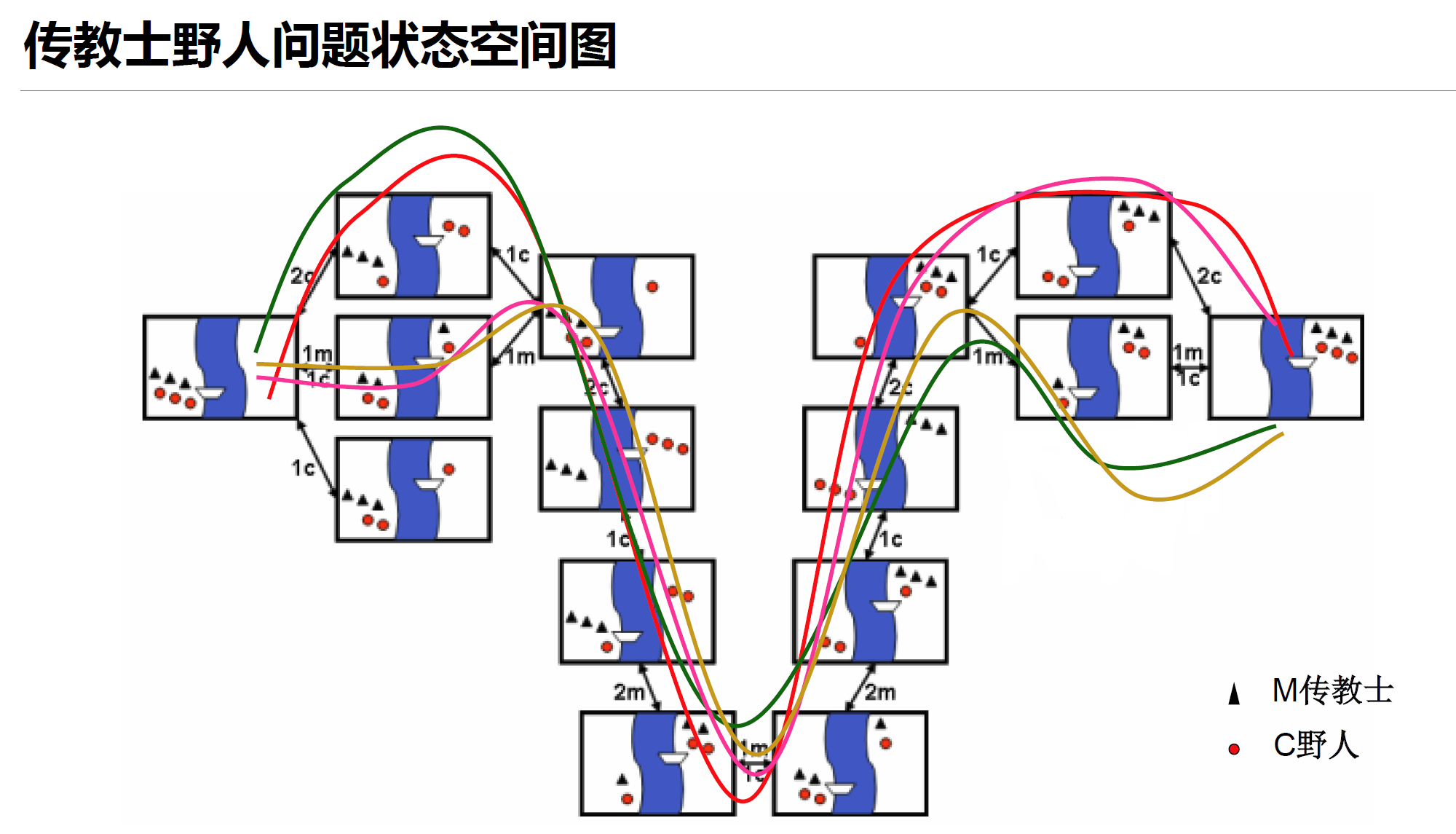

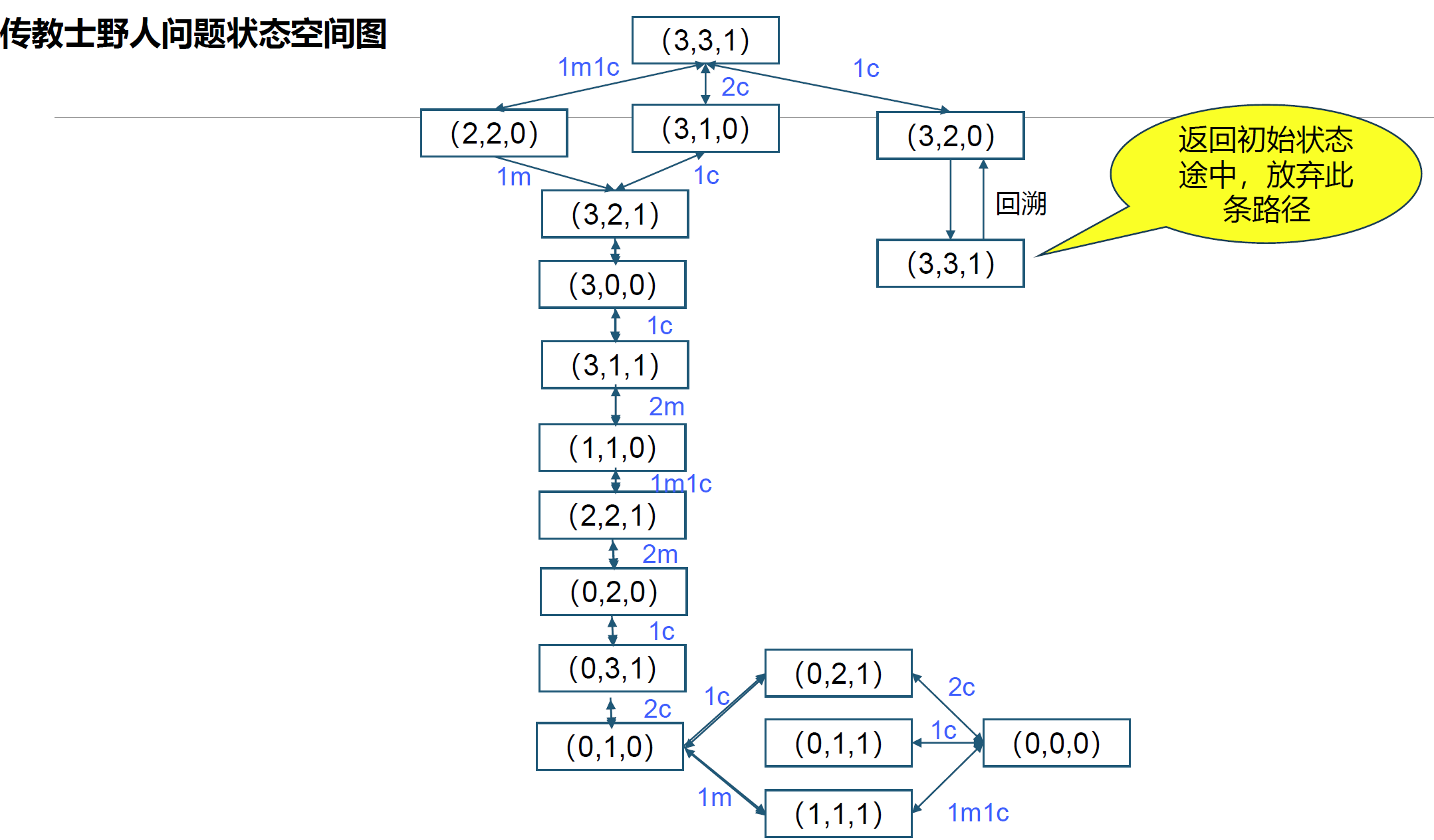

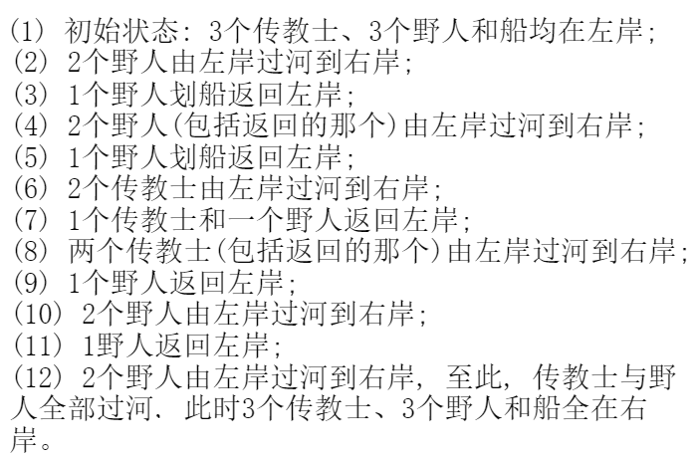

传教士问题

小结一下:第一步规定好状态,用什么符号来表示什么状况,确定好起始状态和目标状态,第二步确定操作/算符,第三步再根据状态和操作来画状态空间图。

第三章 搜索求解策略——图搜索策略

什么是搜索(AI的基本技术之一)?

内容:

①早期搜索技术,如图搜索、盲目搜索、启发式搜索

②高级搜索技术,如规则演绎系统、产生式系统

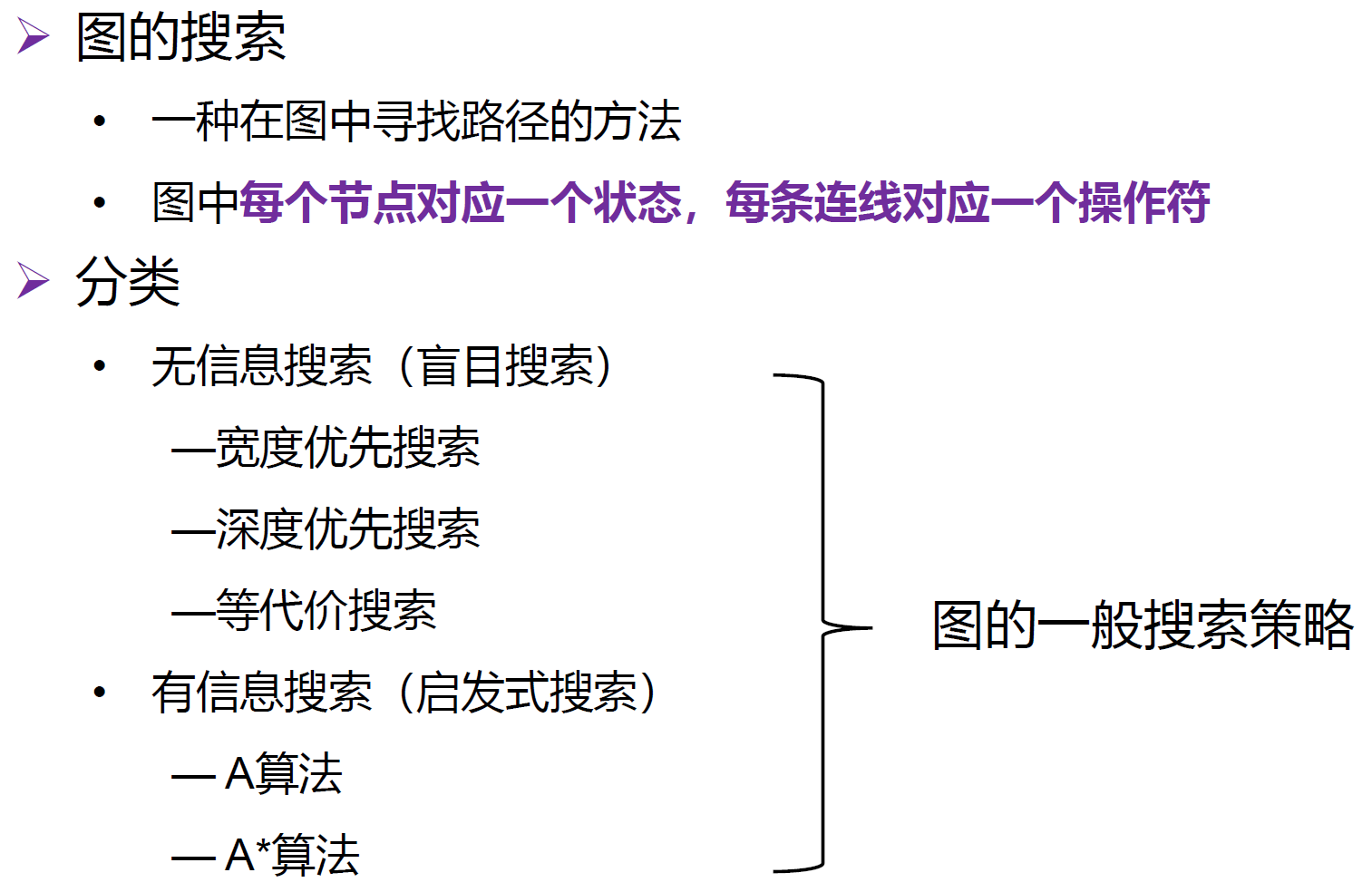

图搜索策略分类:

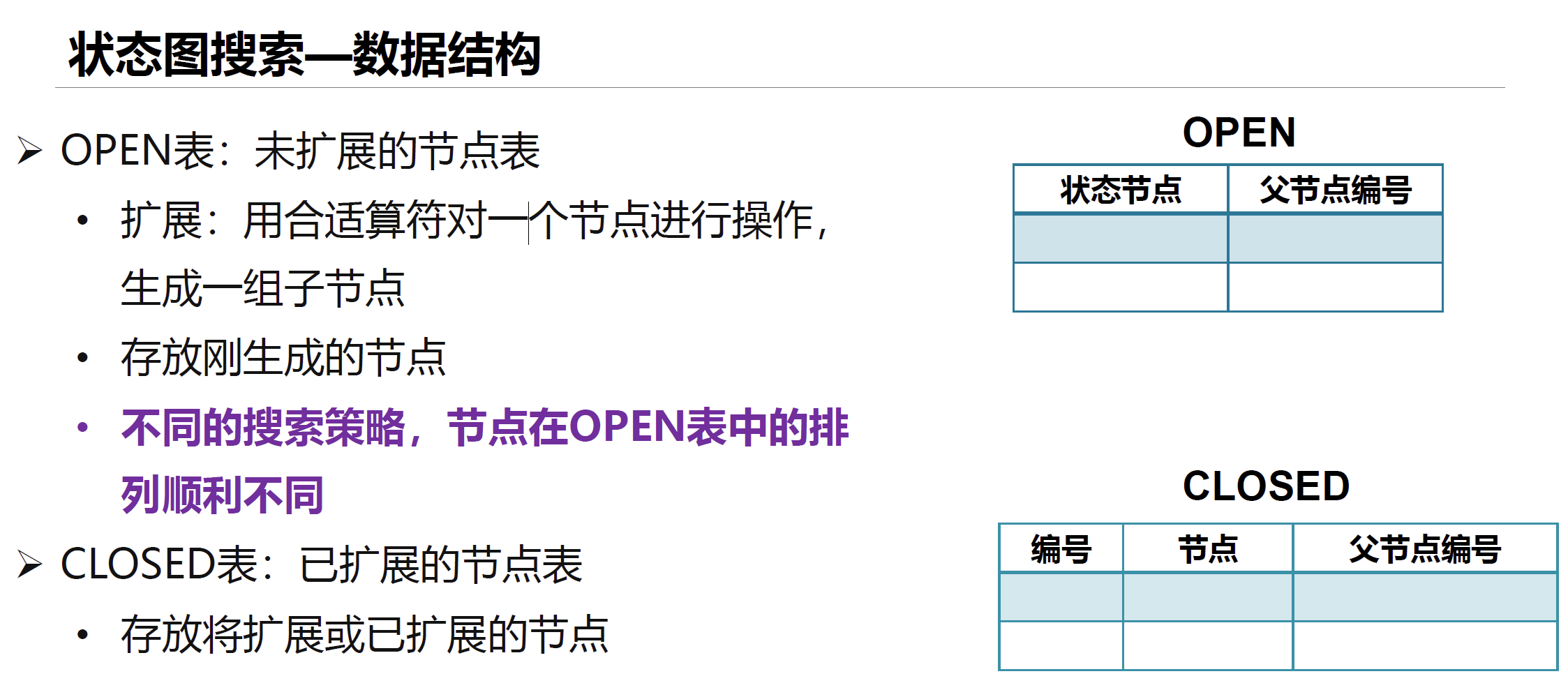

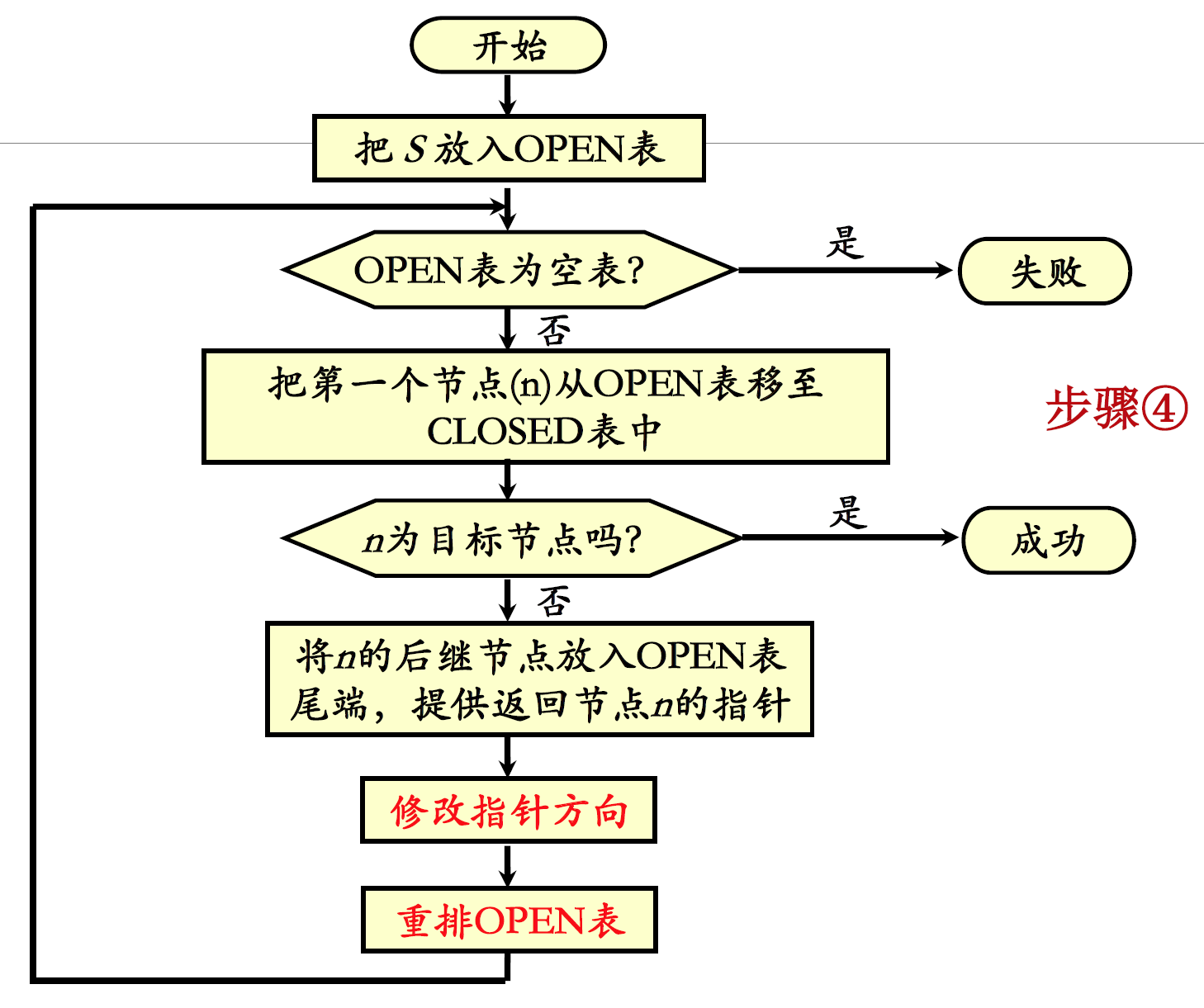

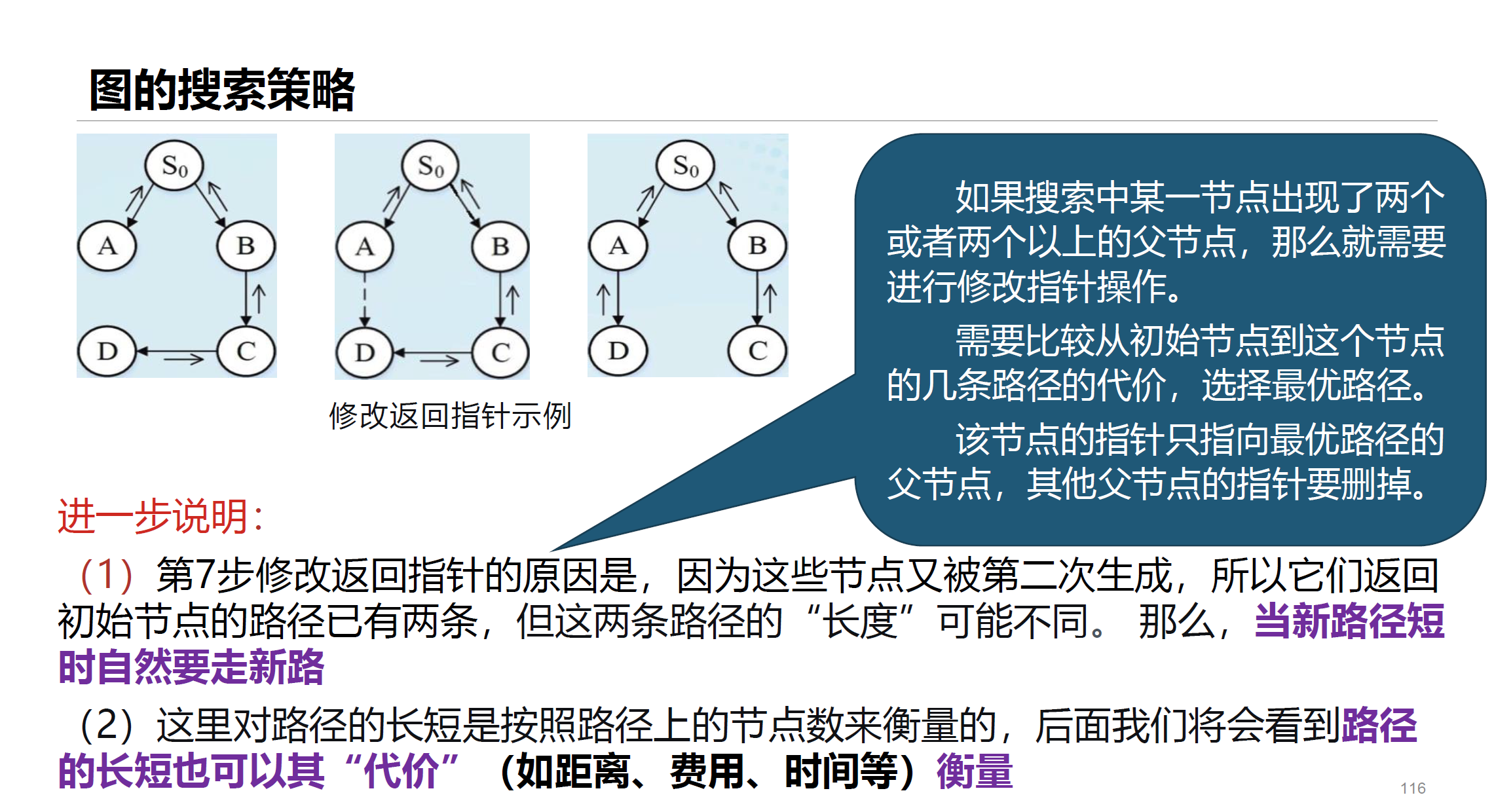

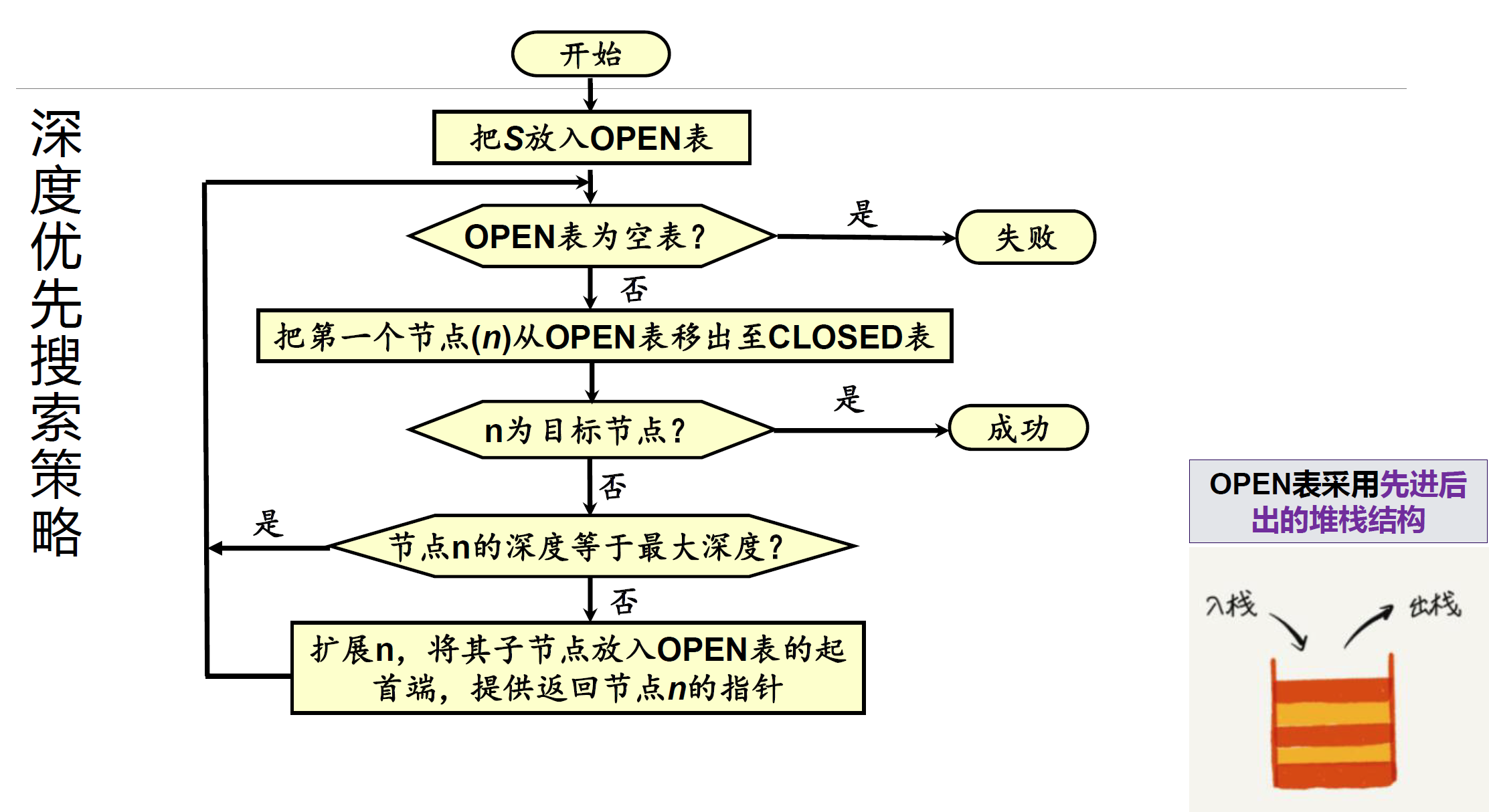

图的搜索过程:必须记住从目标返回的路径与站点;

必须记住下一步还可以走哪些点: OPEN 表 (存放待扩展的节点表)

必须记住哪些点走过了: CLOSED 表 (存放已扩展的节点)

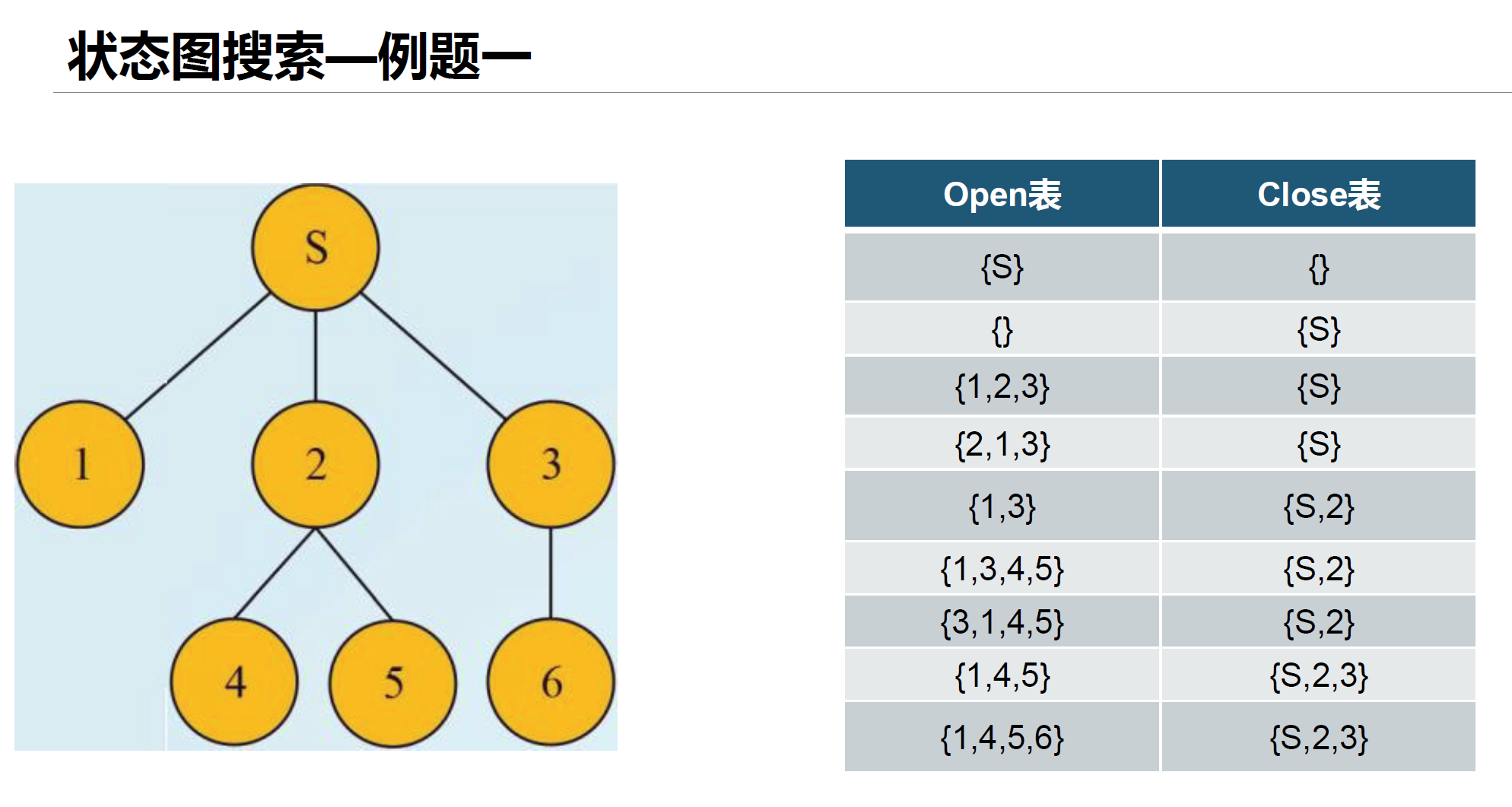

简单示例1:

一开始,open表中只有S(row1),将S放入close表中(row2),判断S不是目标节点,然后将S的后继节点1、2、3放入open表中(row3),重排open表(row4),将open表中第一个节点2放入close表中(row5),将2的后继节点4、5放入open表中(row6),重排open表(row7),将open表中第一个节点3放入close表中(row8),将3的后继节点放入open表中(row9)。

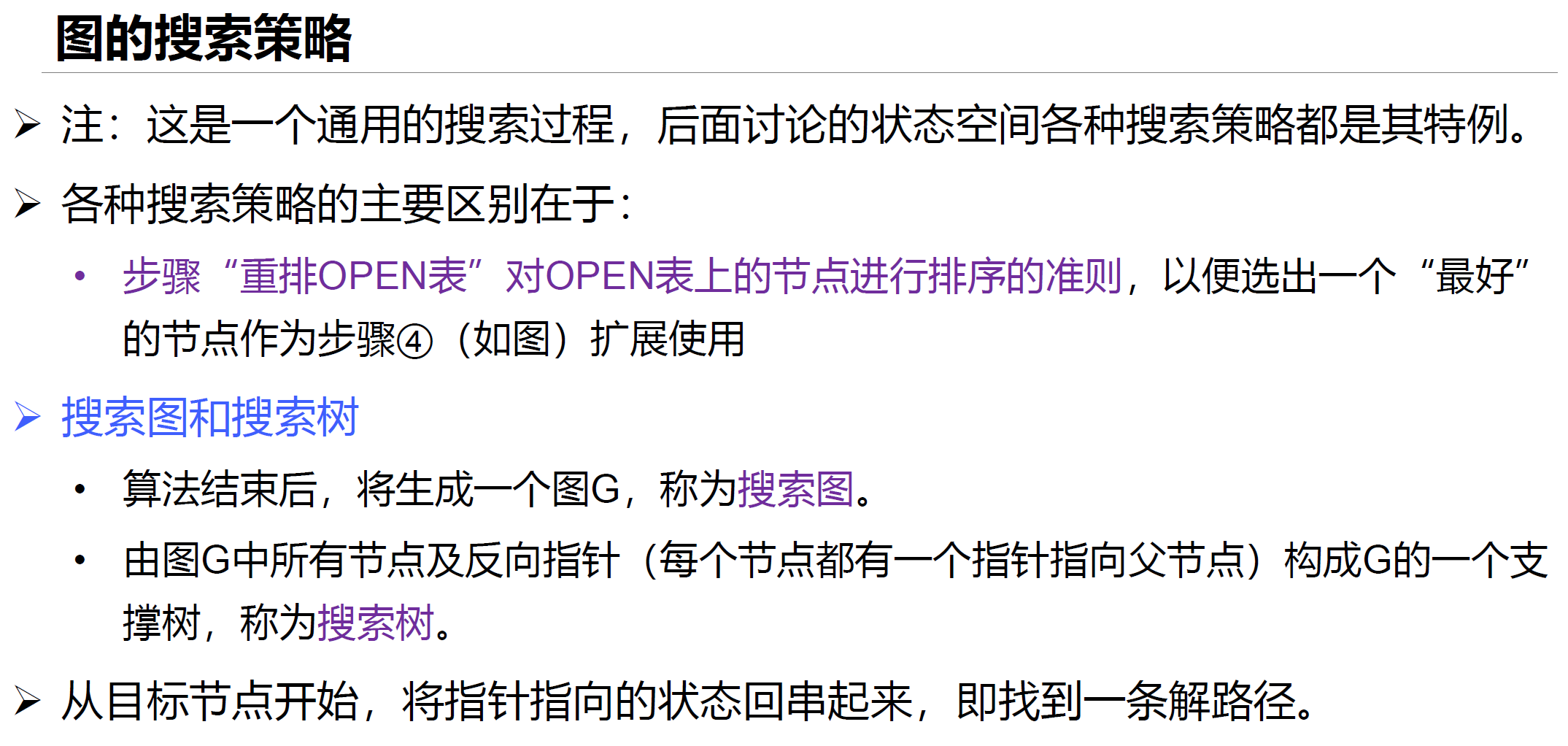

图搜索分类依据:open表重排的准则不同;

盲目式搜索(Blind Search)

概念、定义:对特定问题不具有任何相关信息的条件下, 按照固定的步骤 (依次或者随机)进行搜索,搜索过程中获得的中间信息不用来改进控制策略。一般只适用于 求解比较简单的问题

种类:

①宽度优先(Breadth first search,BFS)

②深度优先(Depth first search,DFS)

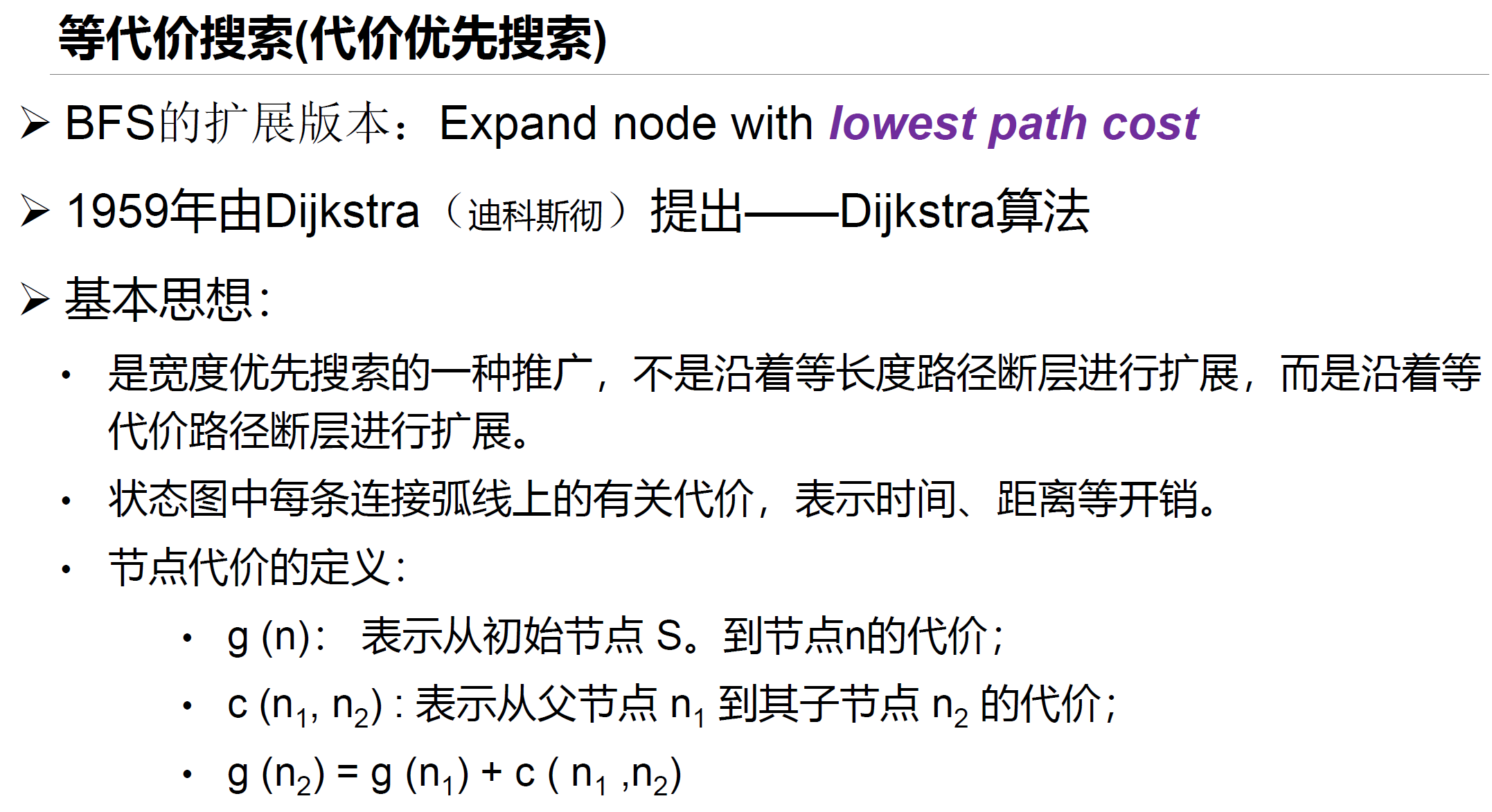

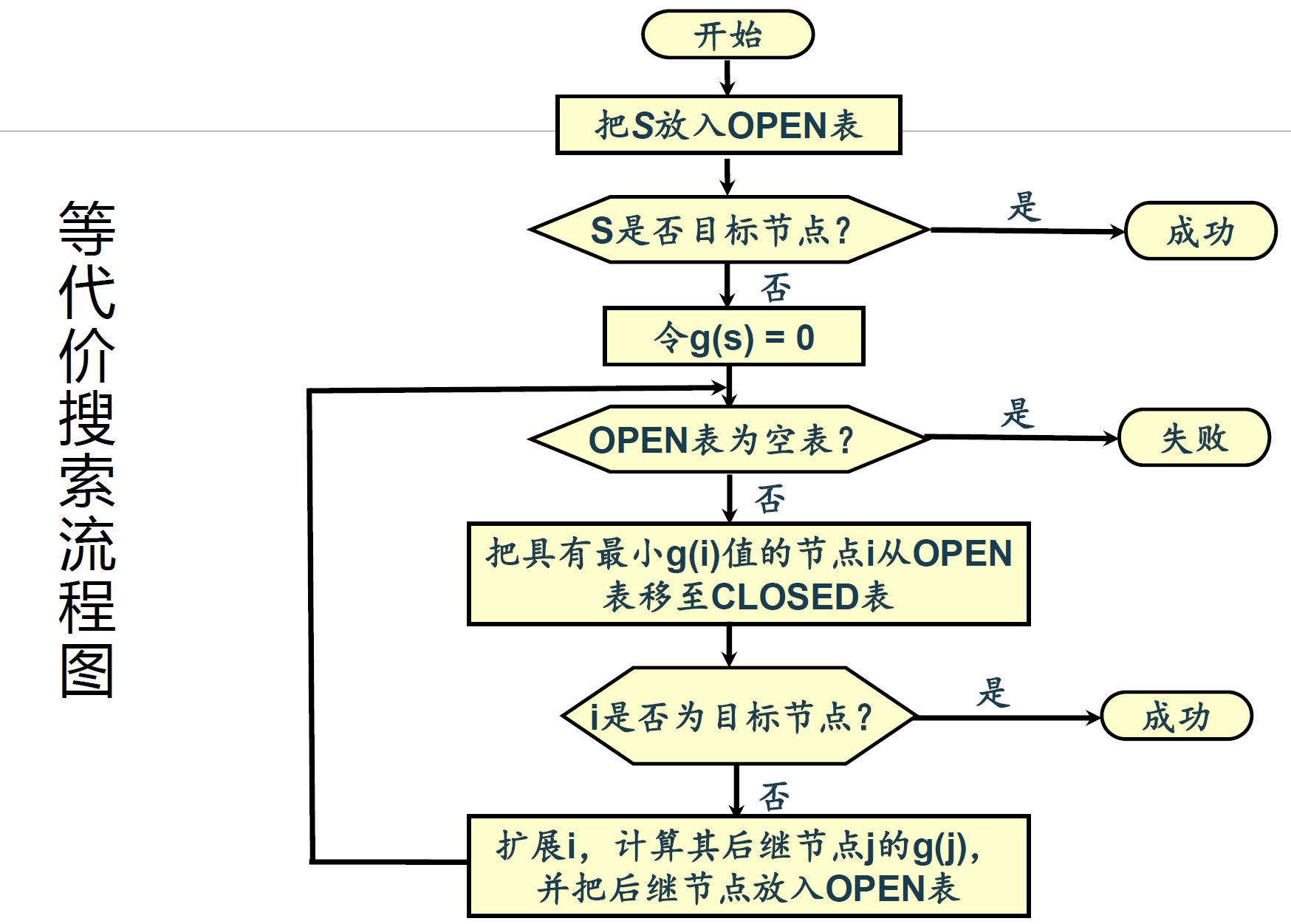

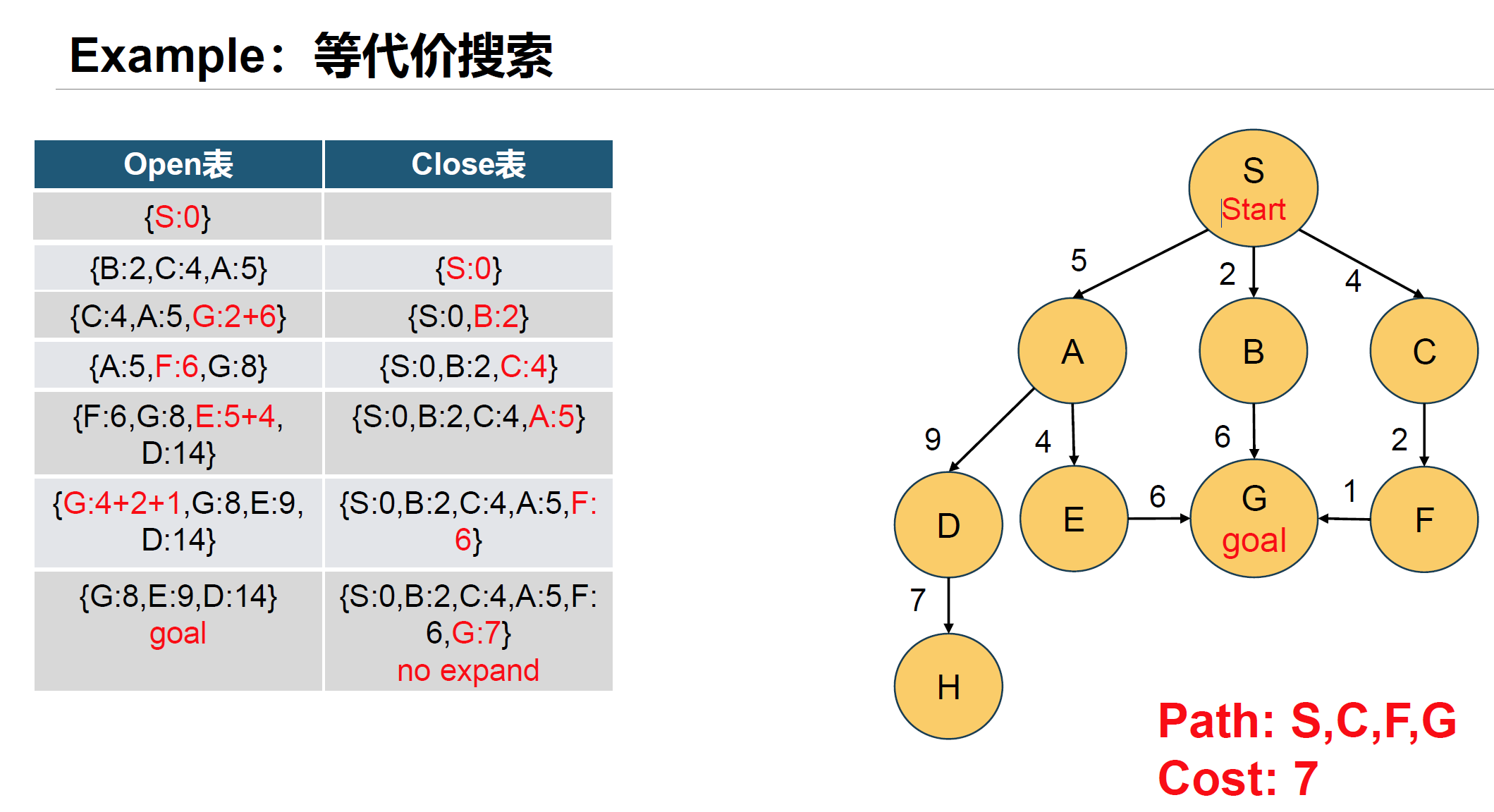

③等代价(代价优先,Uniform cost search)

特点:

①搜索过程中不使用与问题有关的经验信息

②搜索效率低

③不适合大空间的实际问题求解

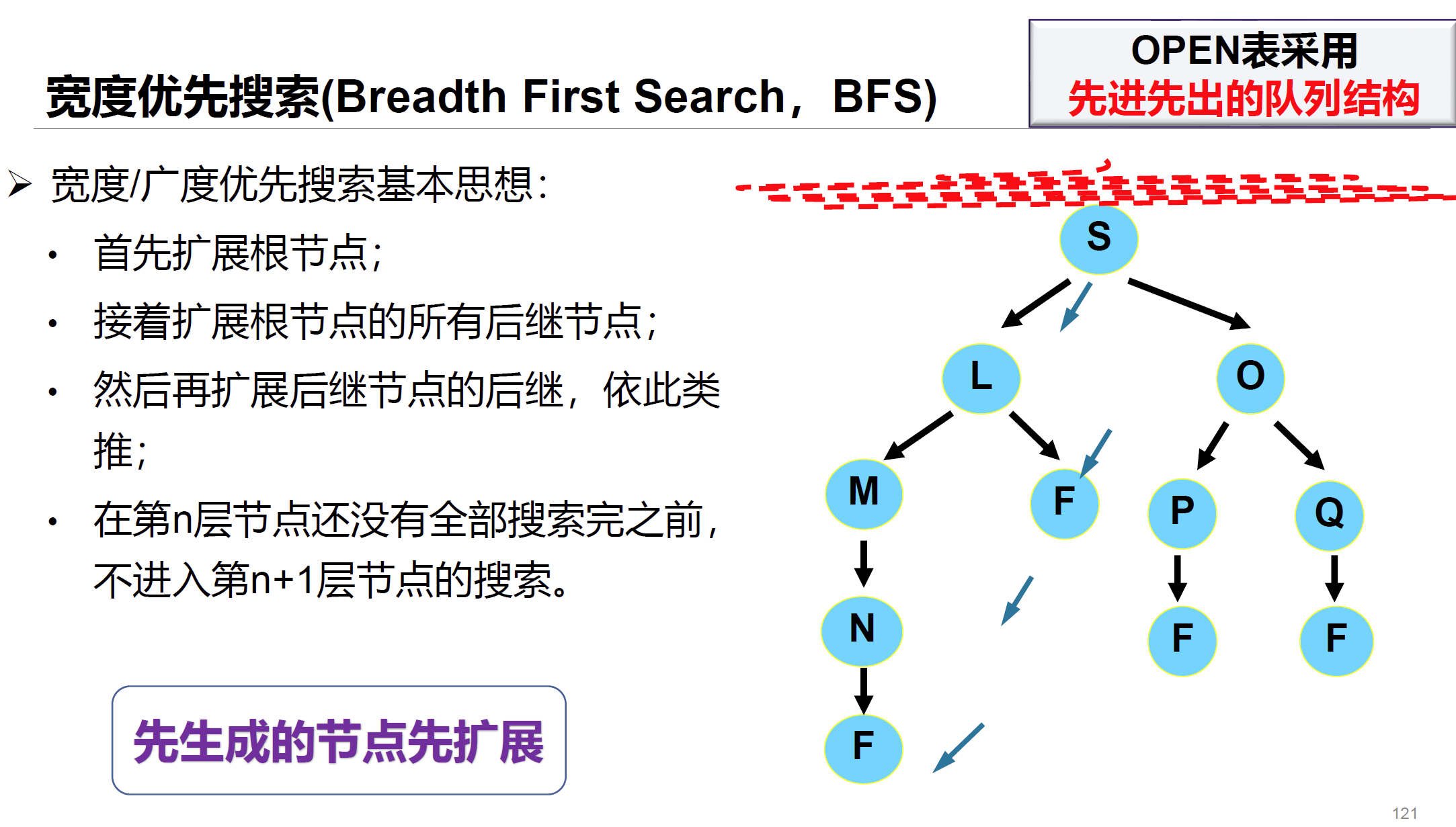

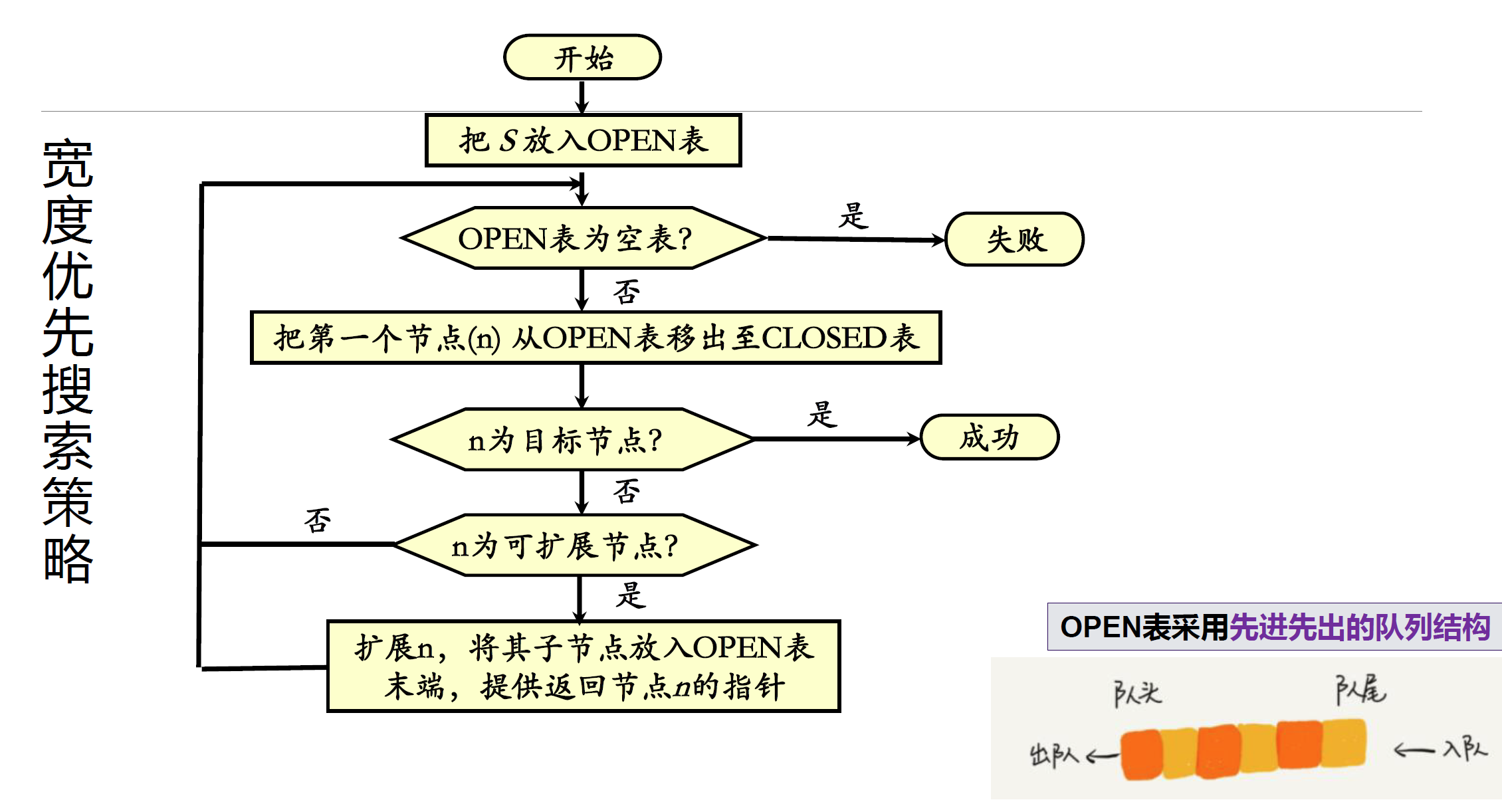

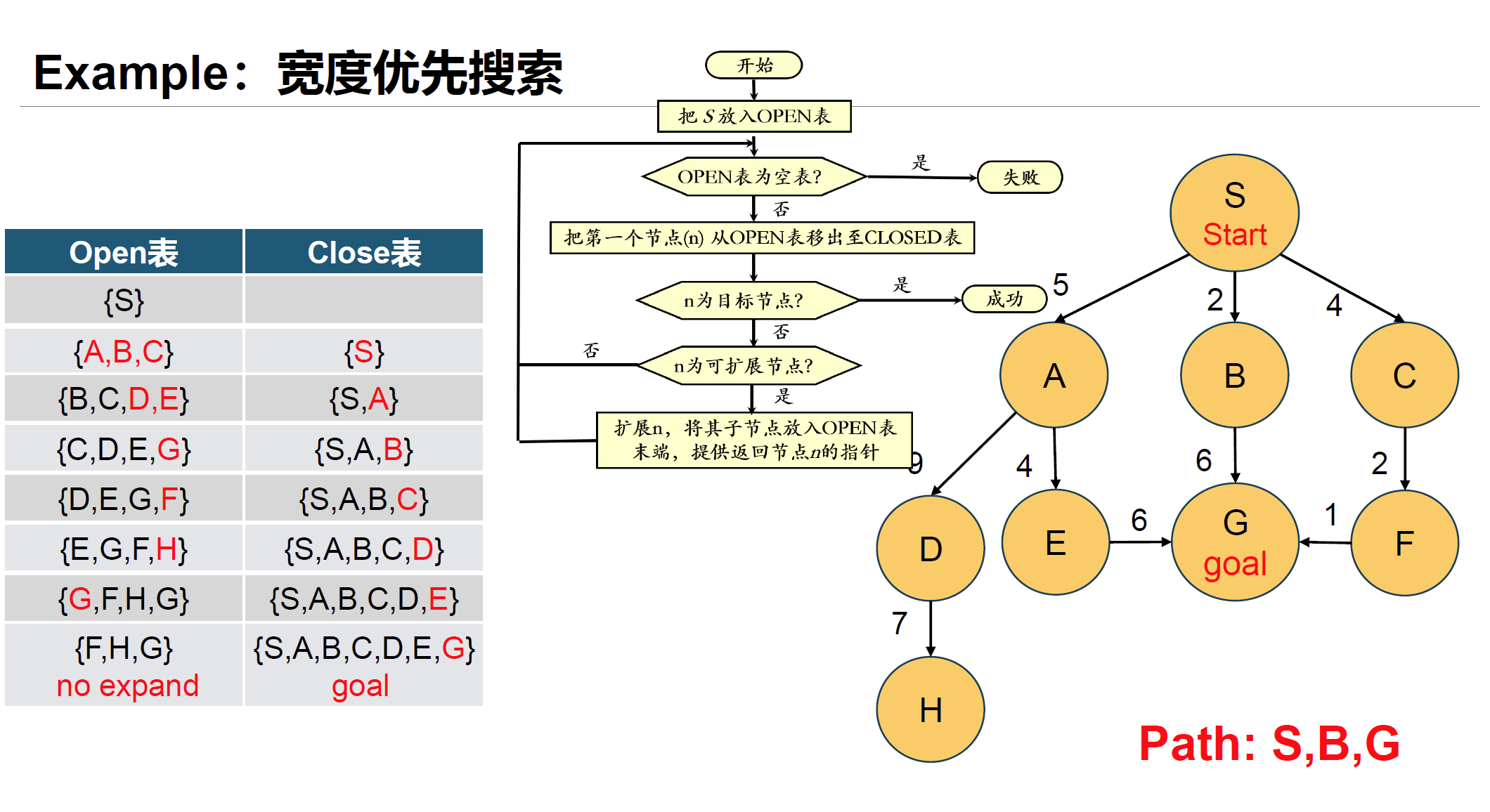

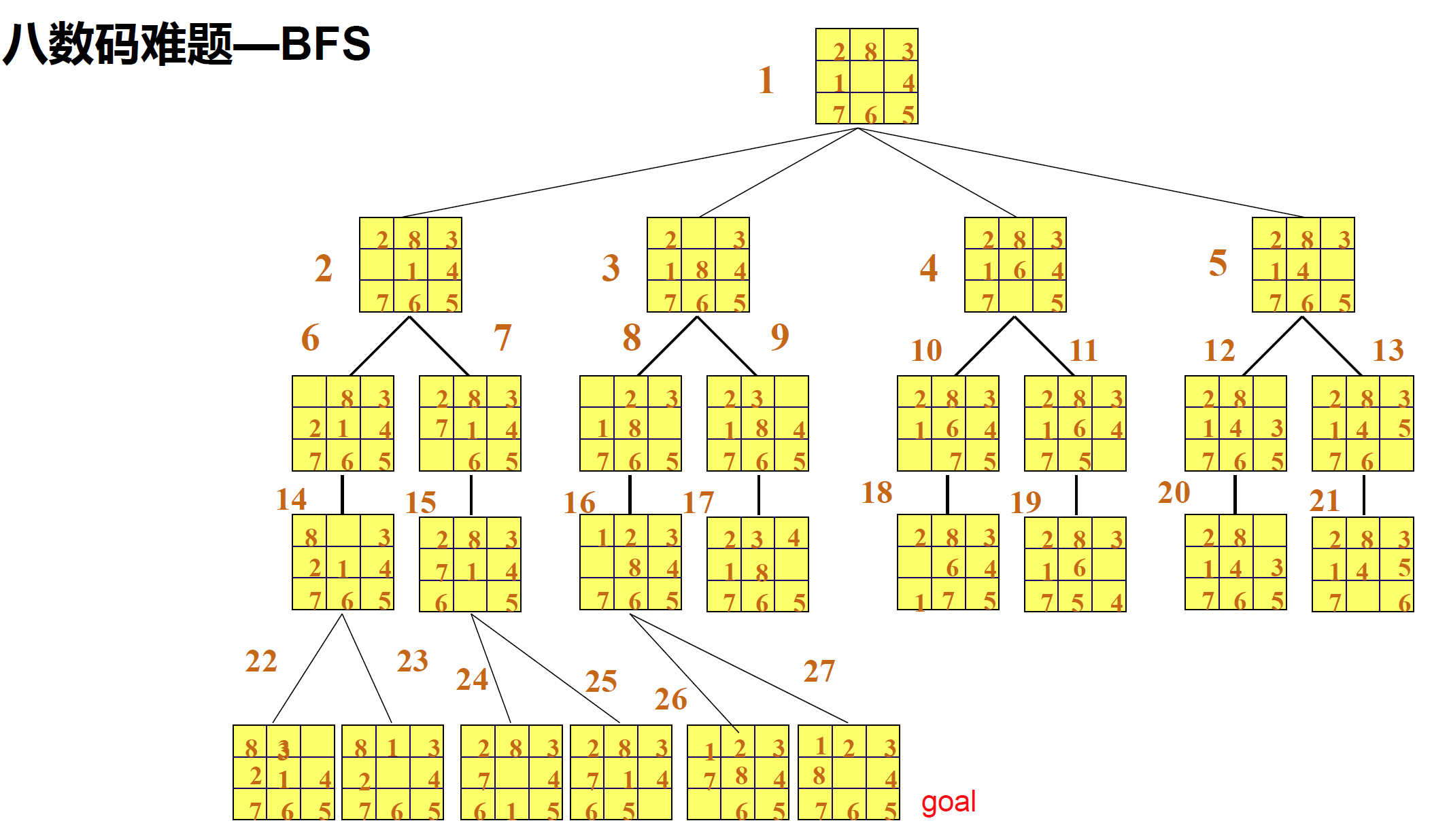

宽度优先搜索,BFS

open表采用先进先出的队列结构。

例如:

BFS的性质:

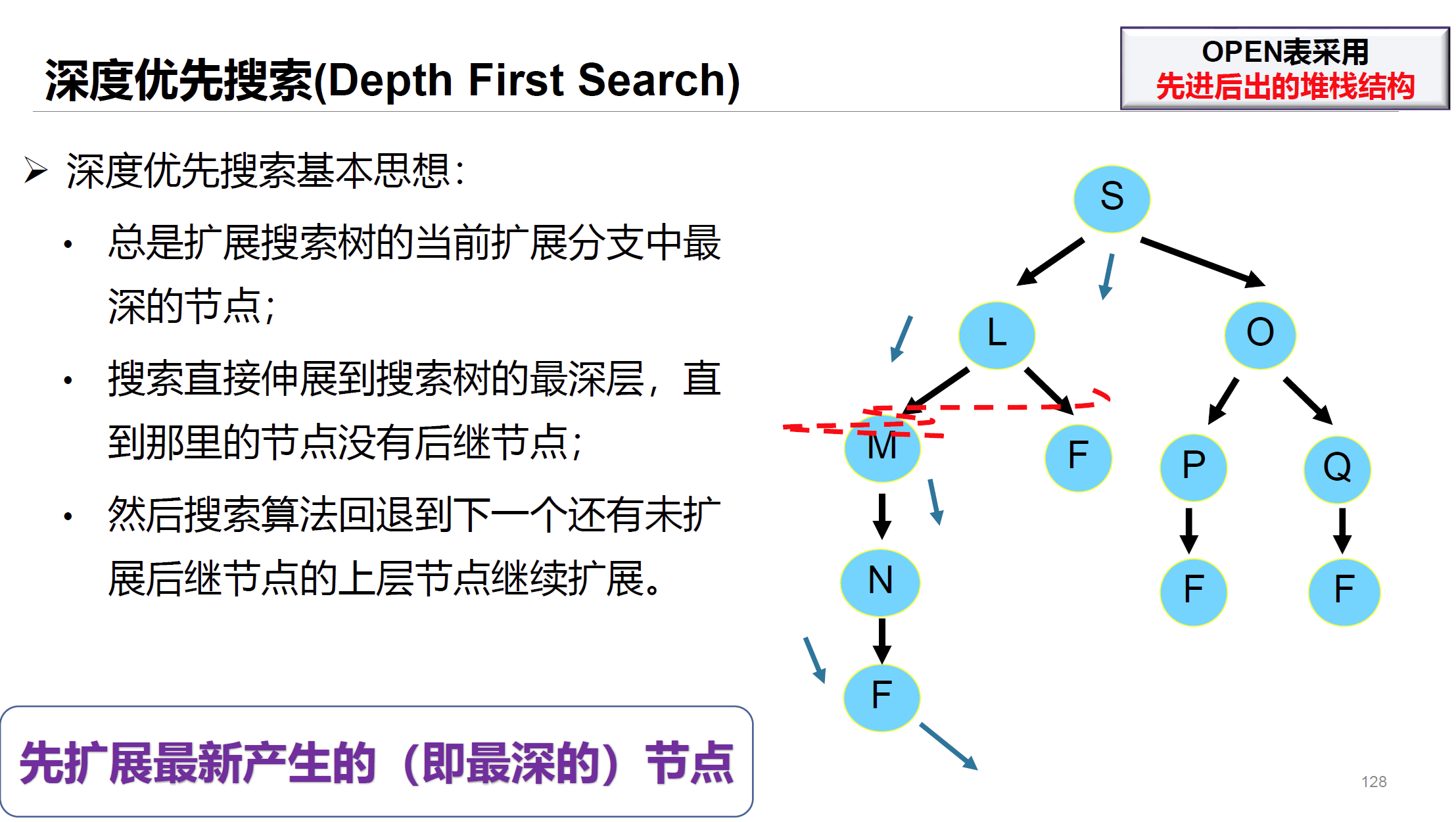

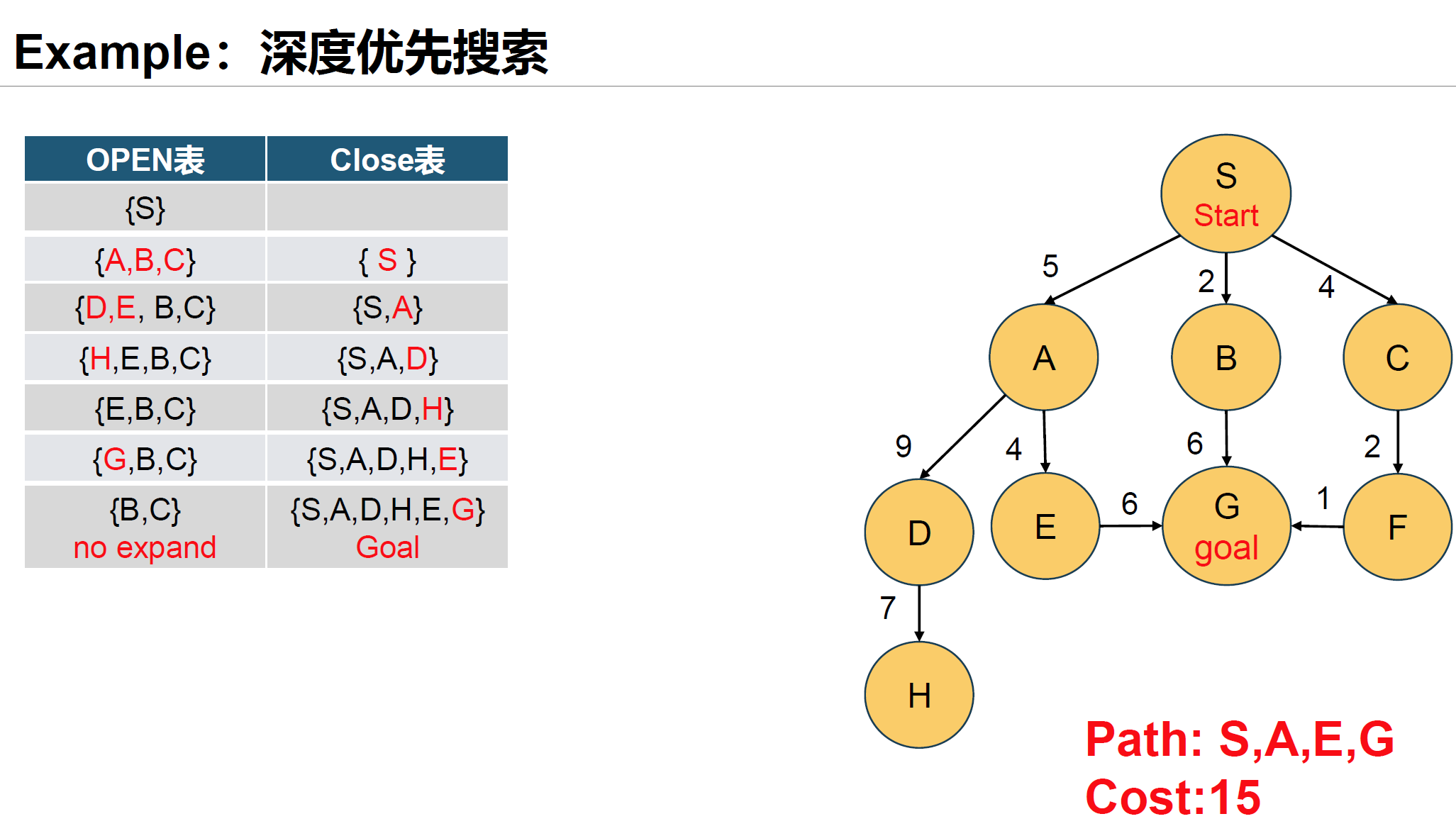

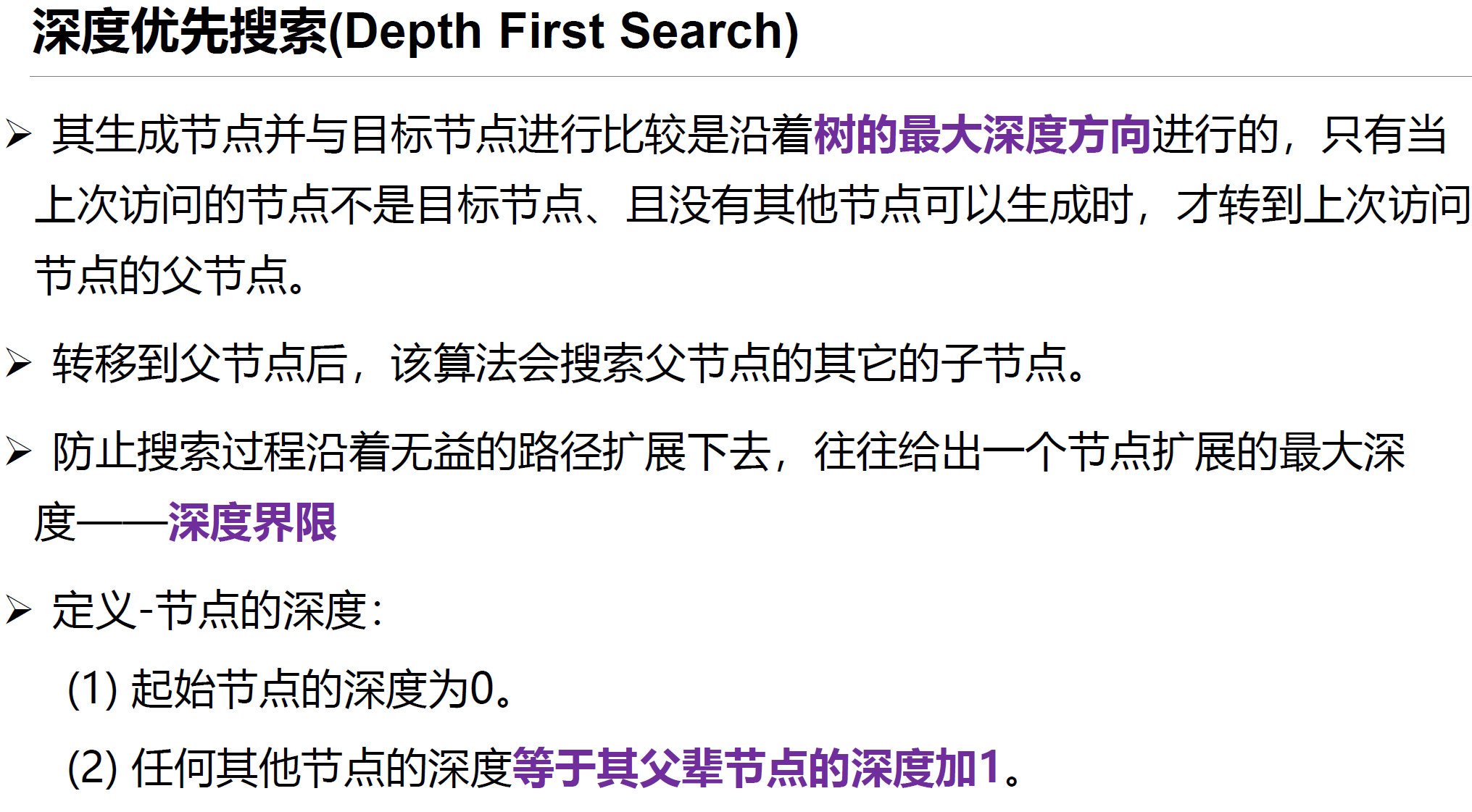

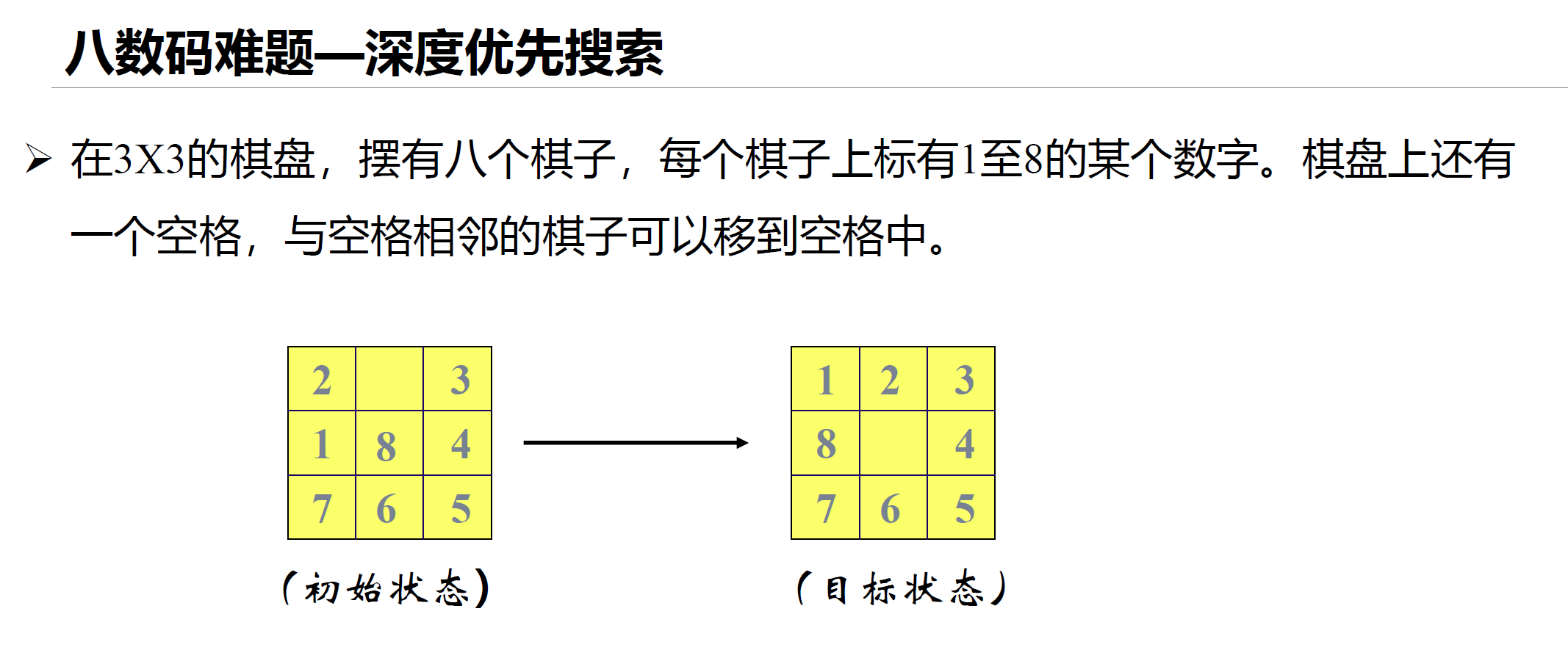

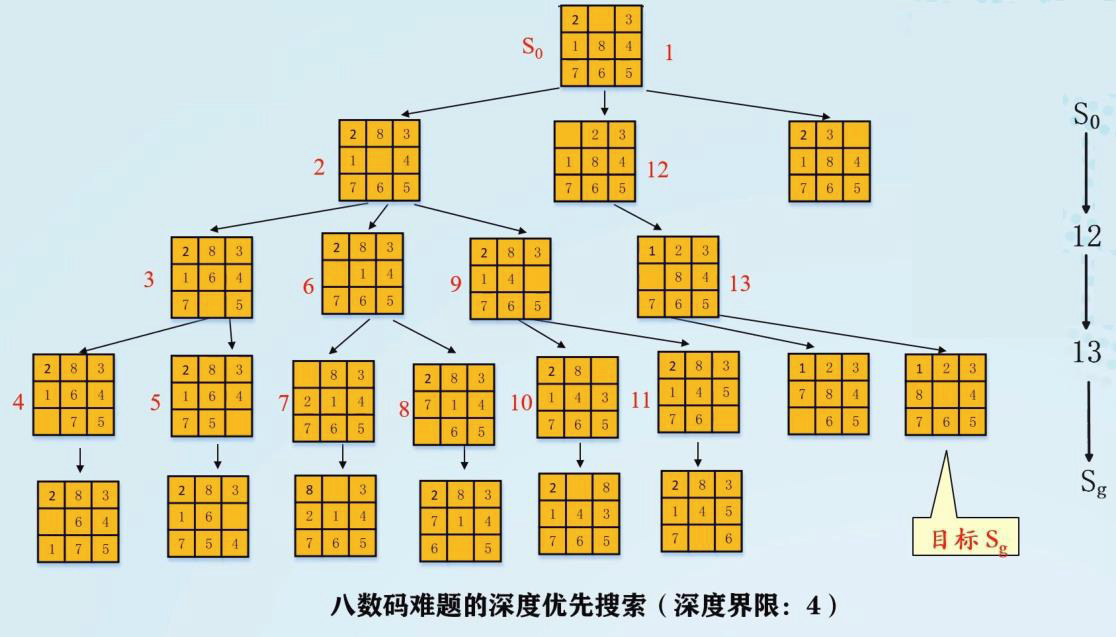

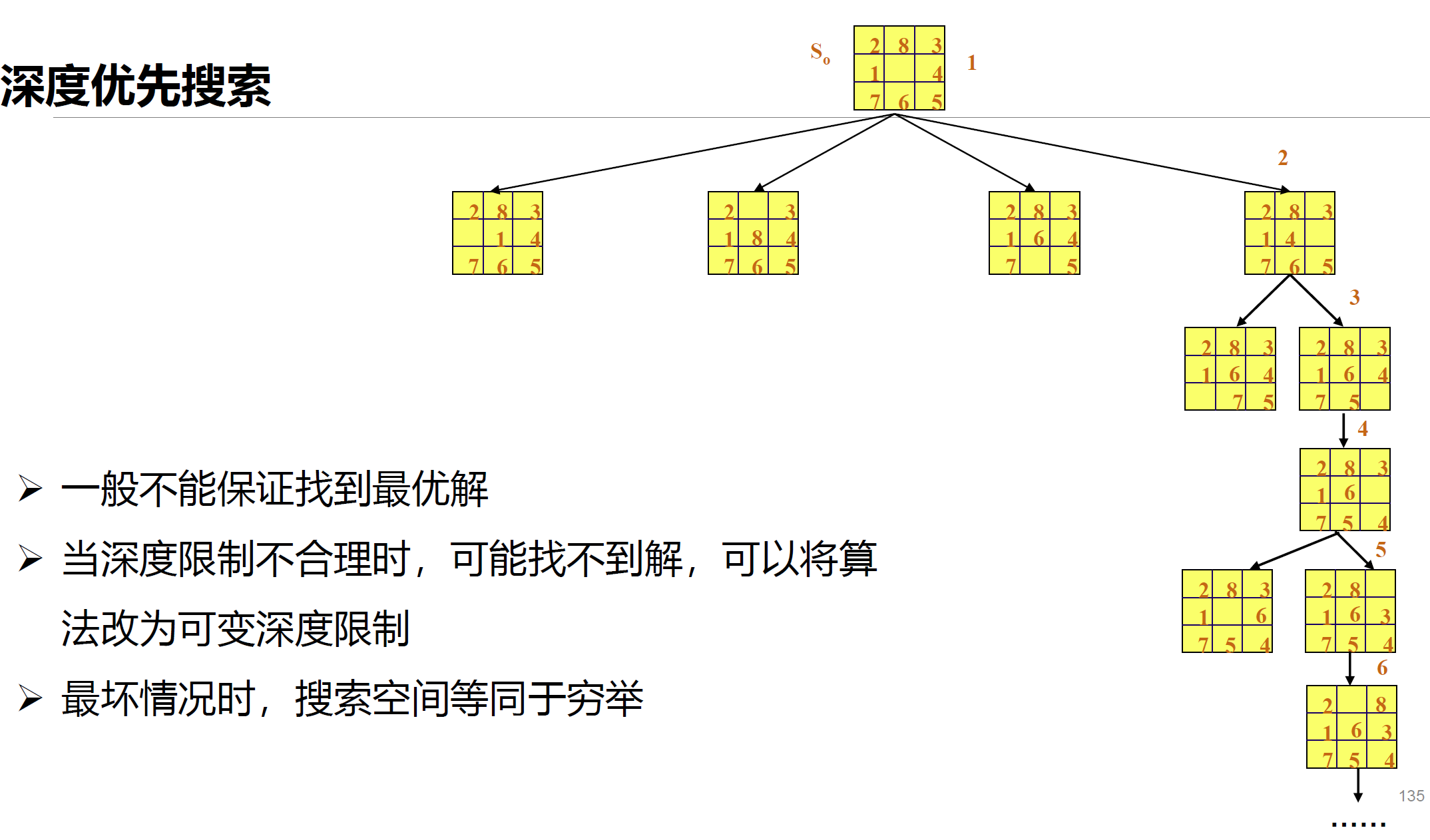

深度优先搜索,DFS

open表采用先进后出的堆栈结构。

例如:

盲目式搜索小结:

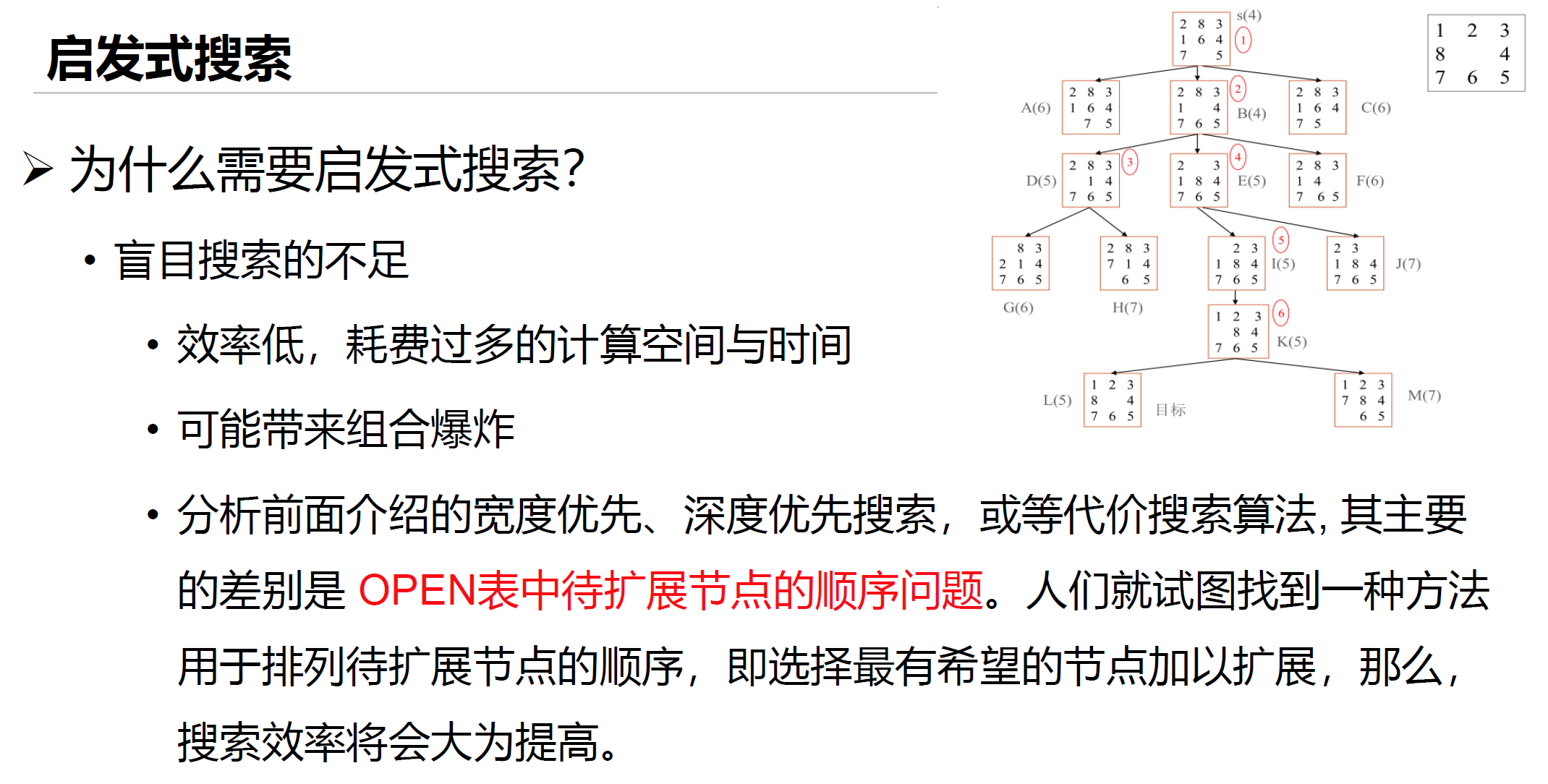

启发式搜索

为什么需要启发式搜索:

启发性信息定义:

启发性信息是指那种与具体问题求解过程有关的,并可指导搜索过程朝着最有希望方向前进的控制信息。

启发式搜索定义:

启发式搜索是利用与问题有关的启发性信息,并以这些启发性信息指导的搜索的问题求解过程。

种类:

①A算法

②A*算法

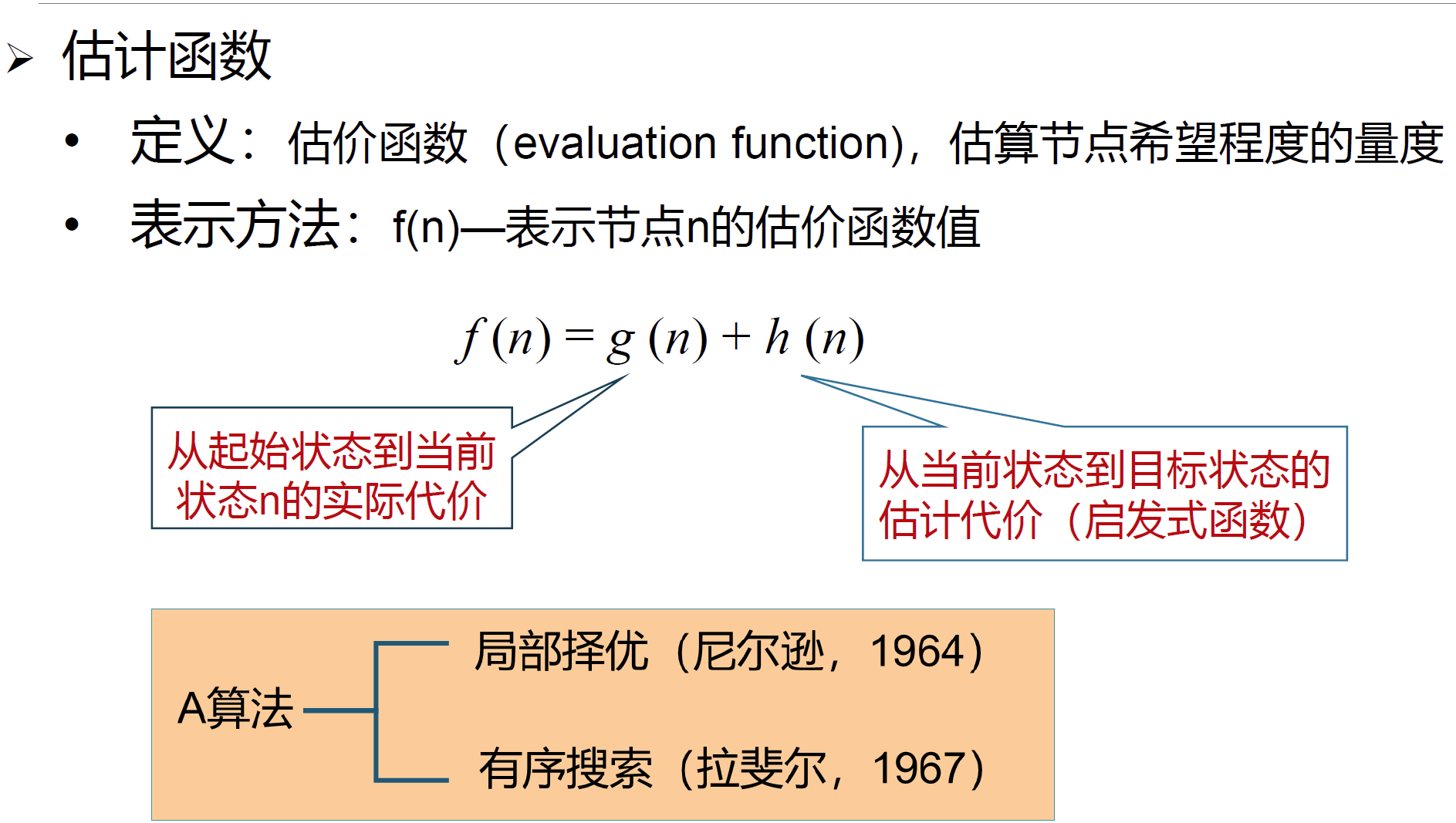

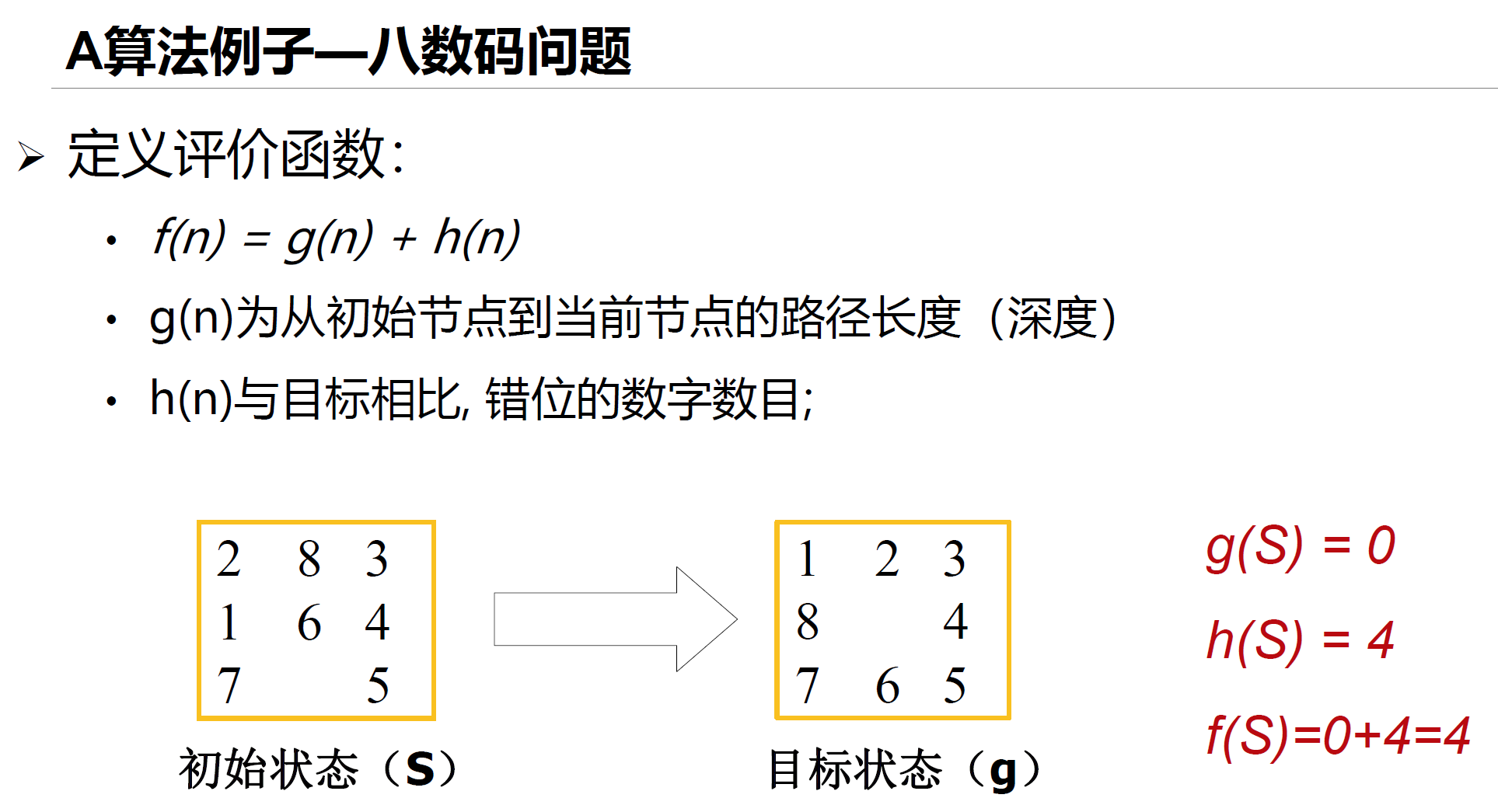

A算法

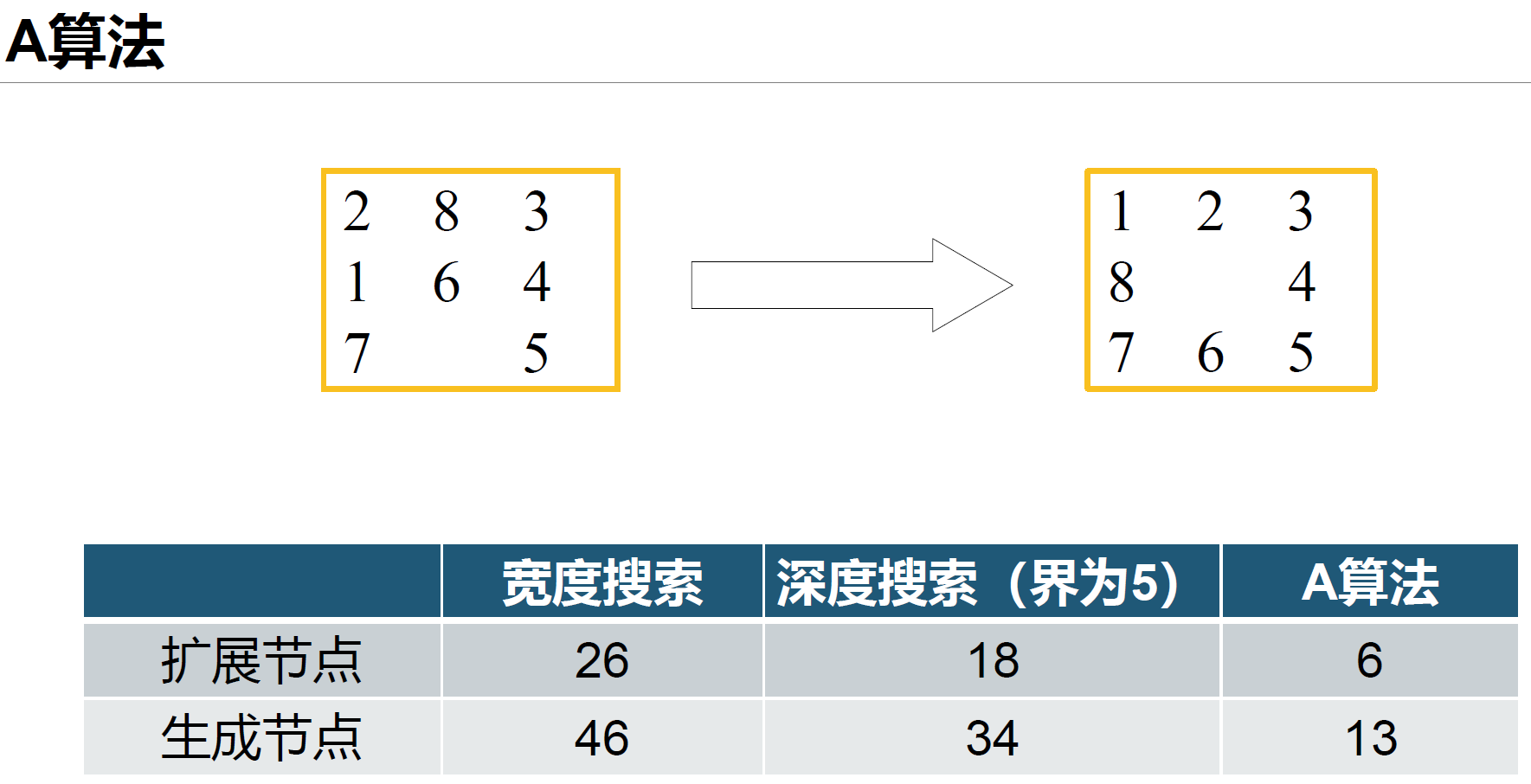

例如:

注:看位置正确的数字数目即可,用8-位置正确的数字数目再加上相应的深度即可得到f。

A算法和BFS、DFS作比较:

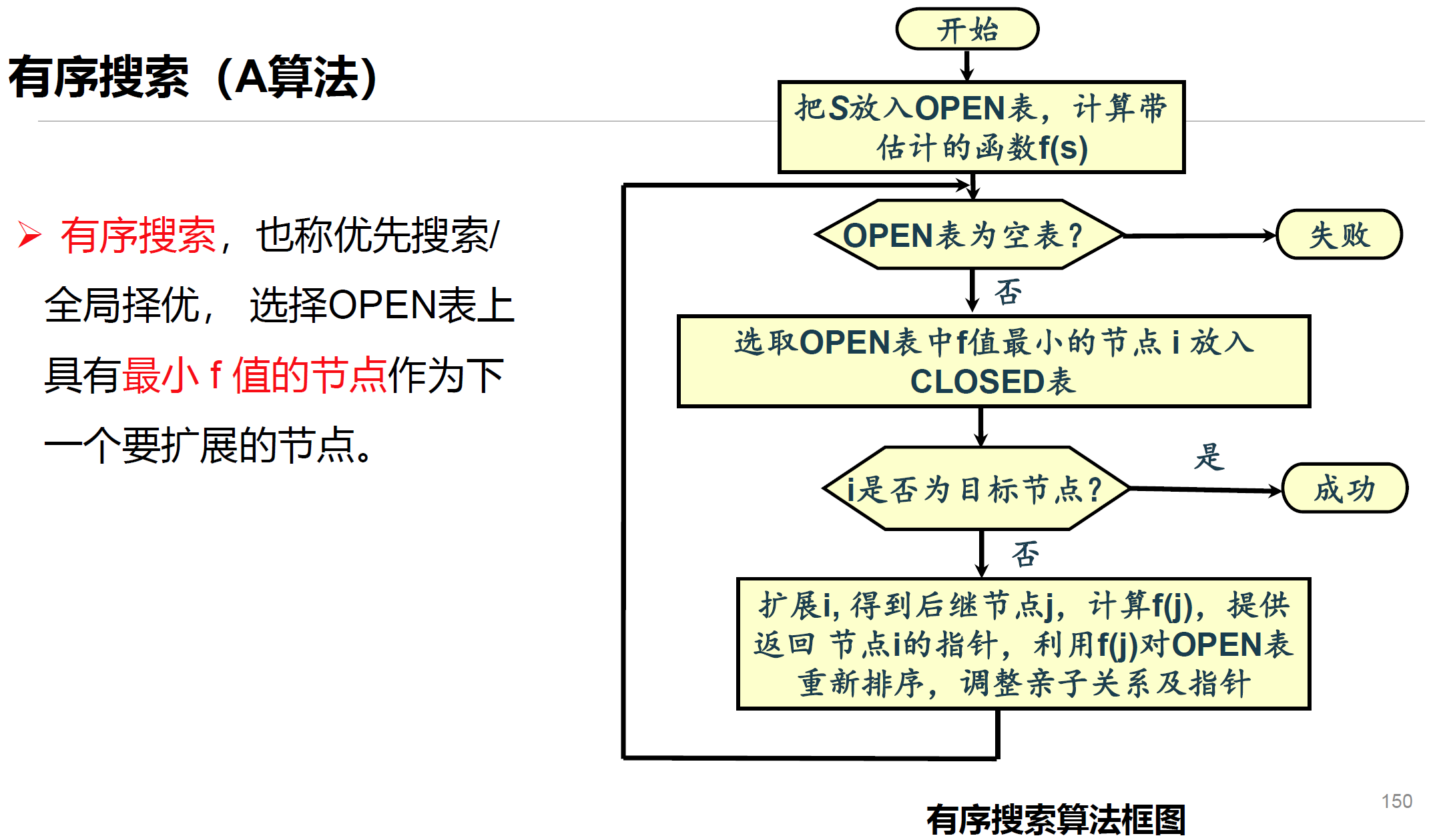

有序搜索(A算法)

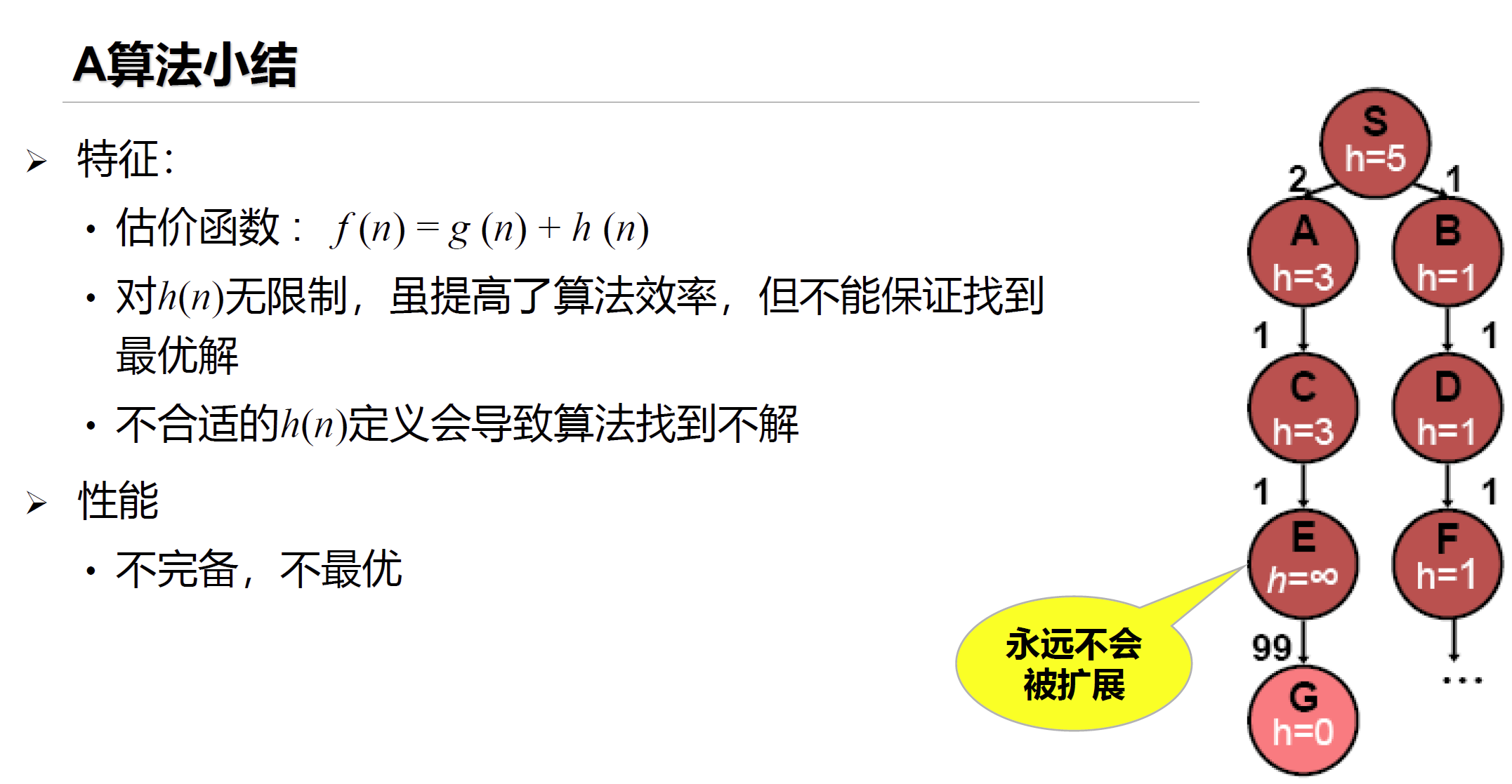

A算法小结

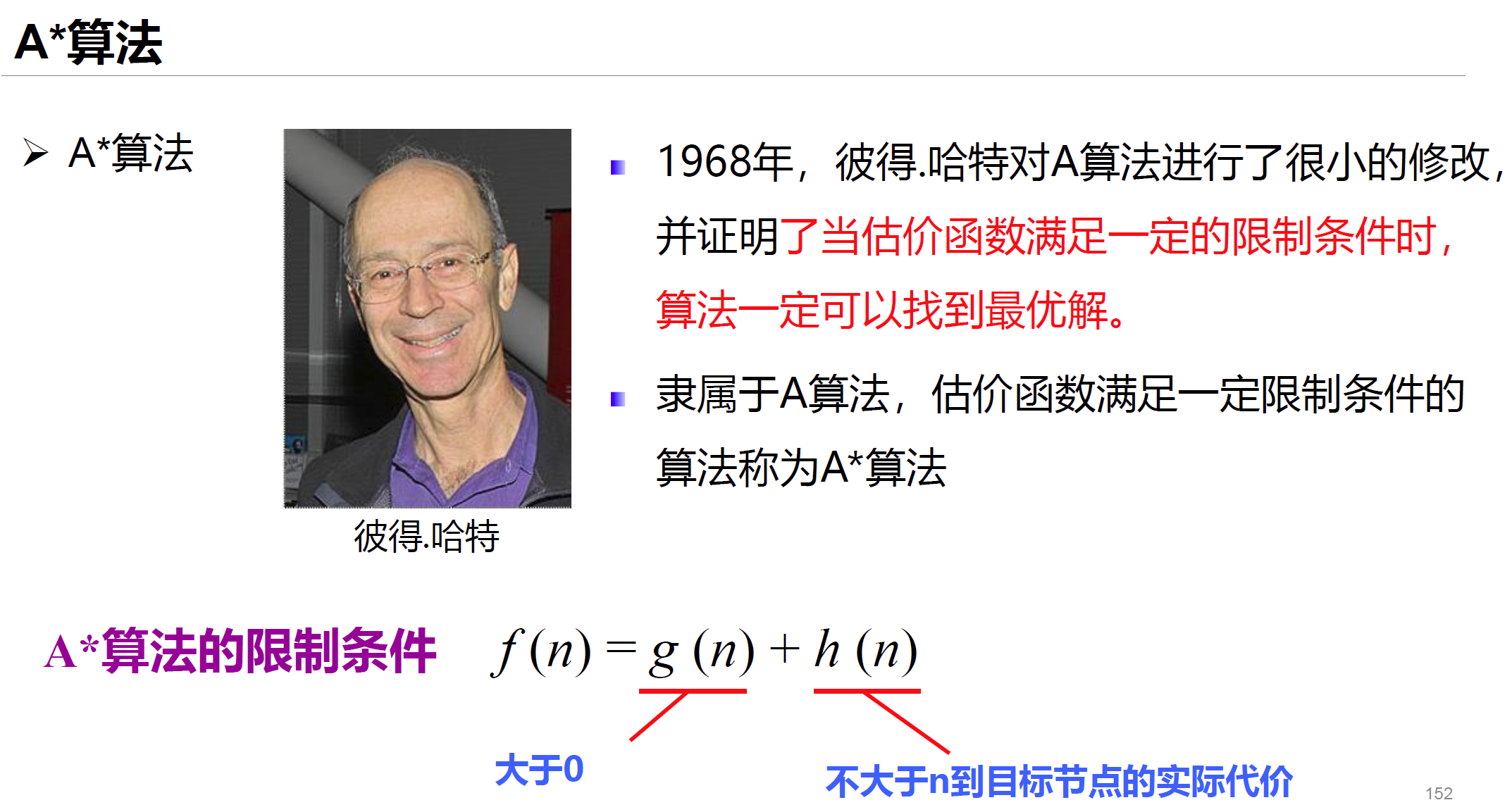

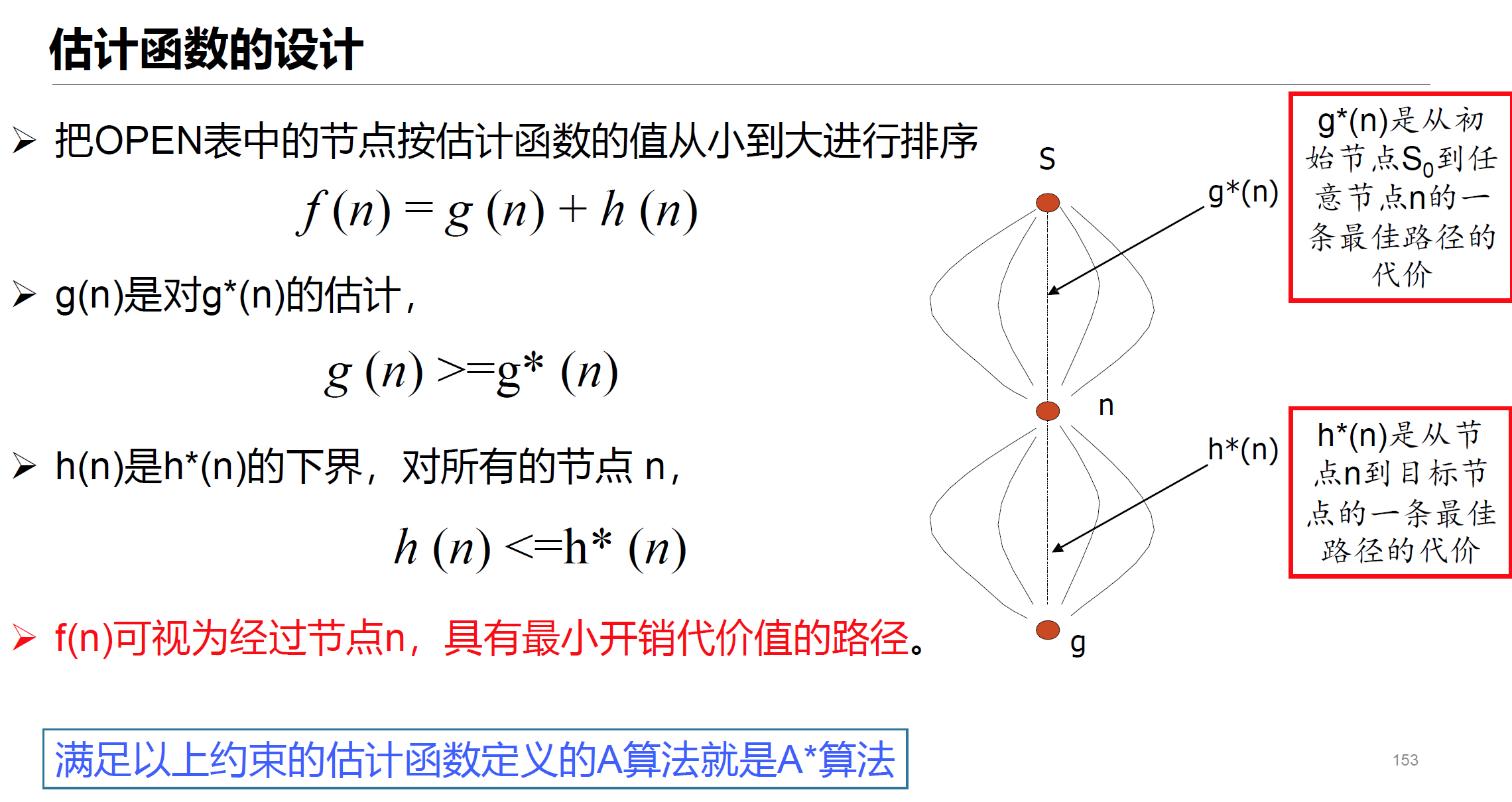

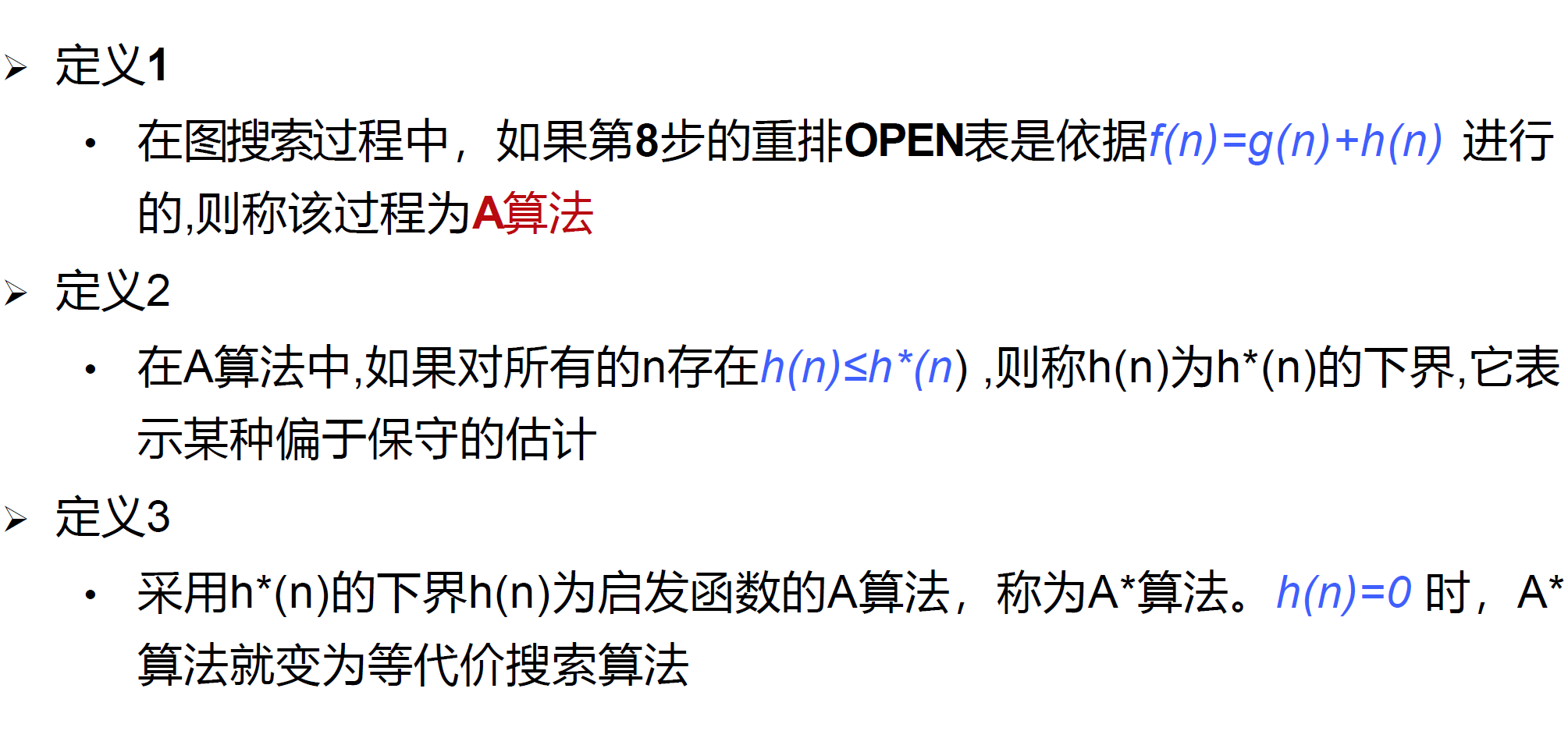

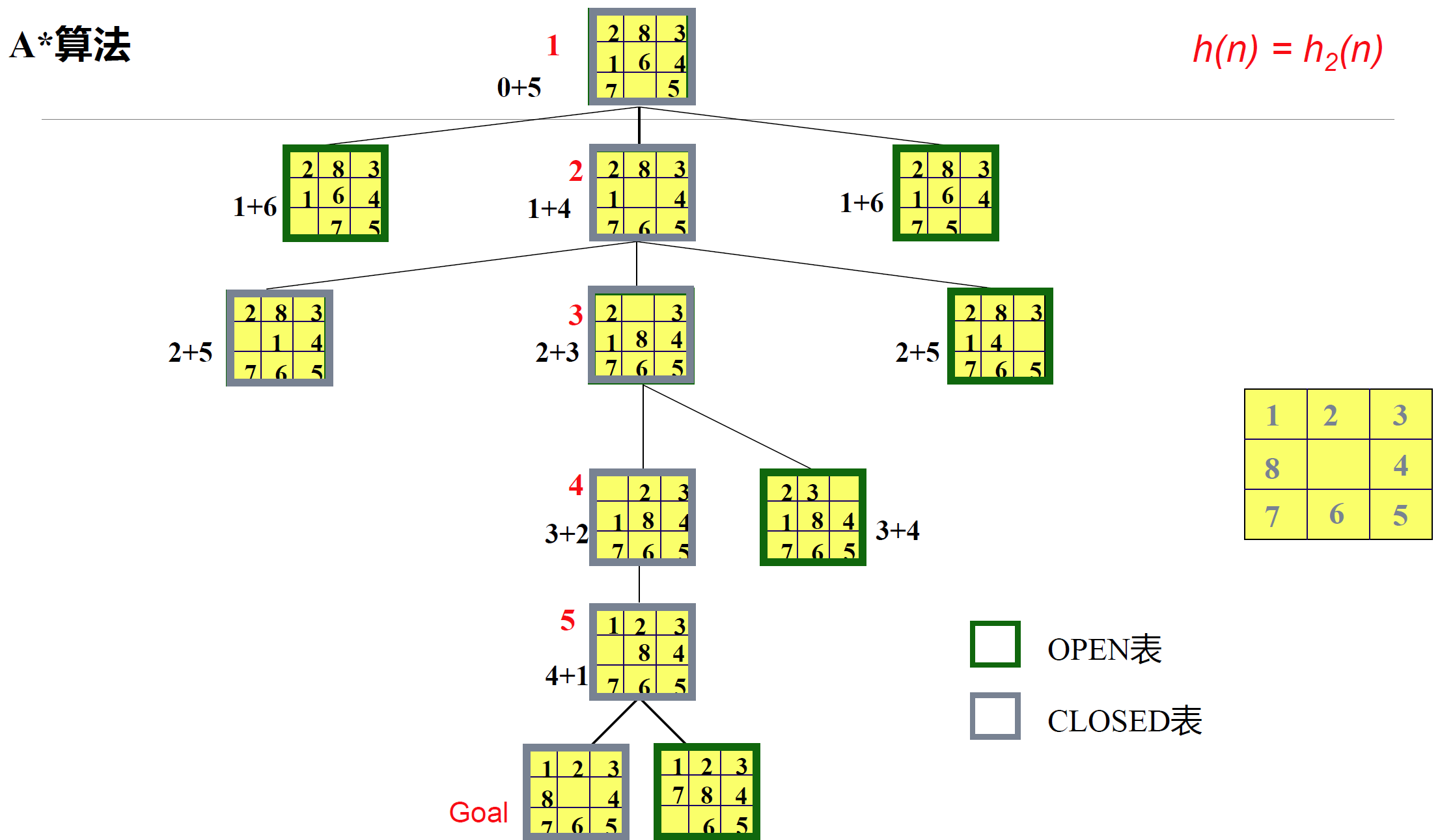

A*算法

估价函数满足一定限制条件的A算法被称为A*算法。

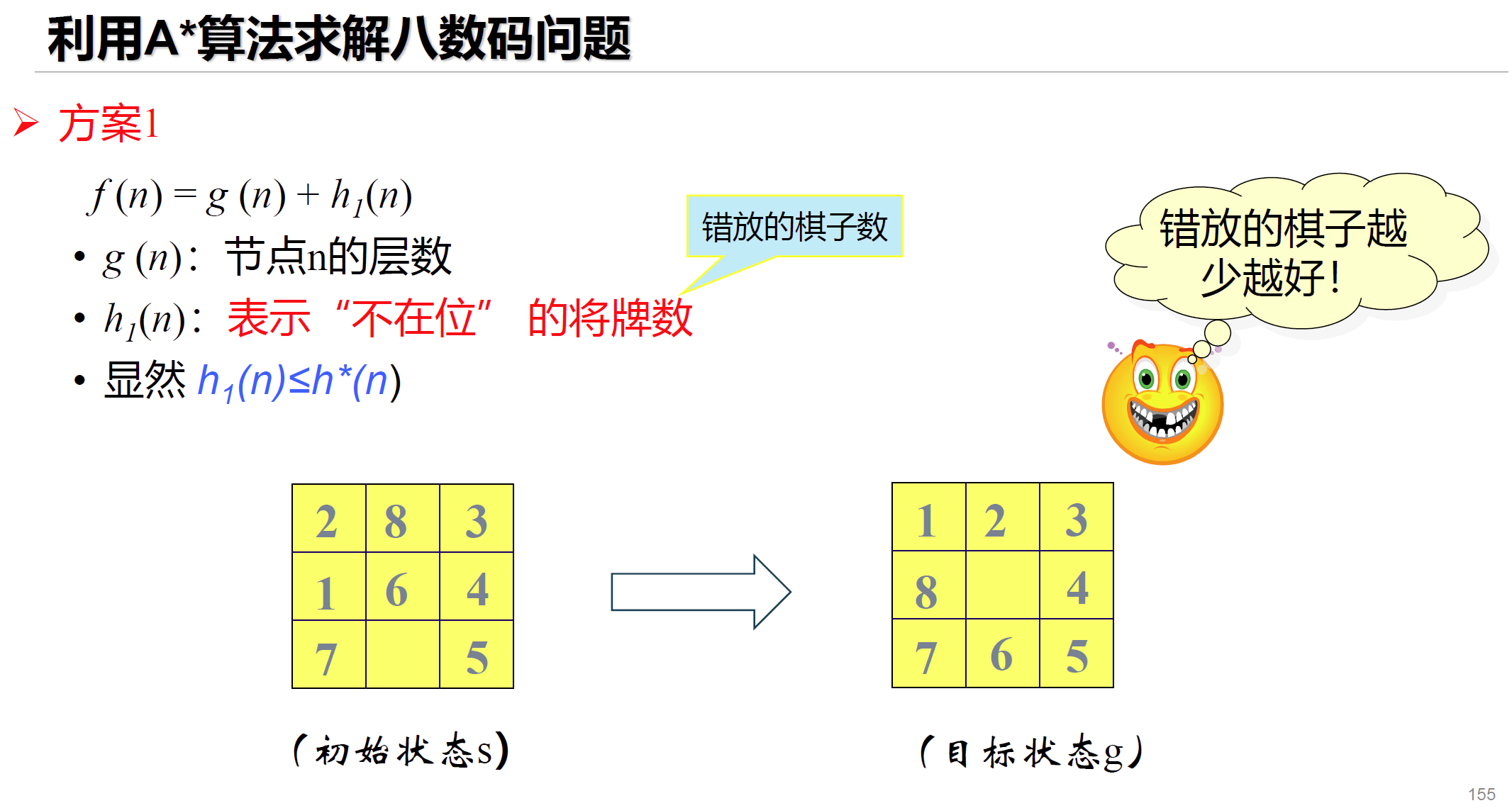

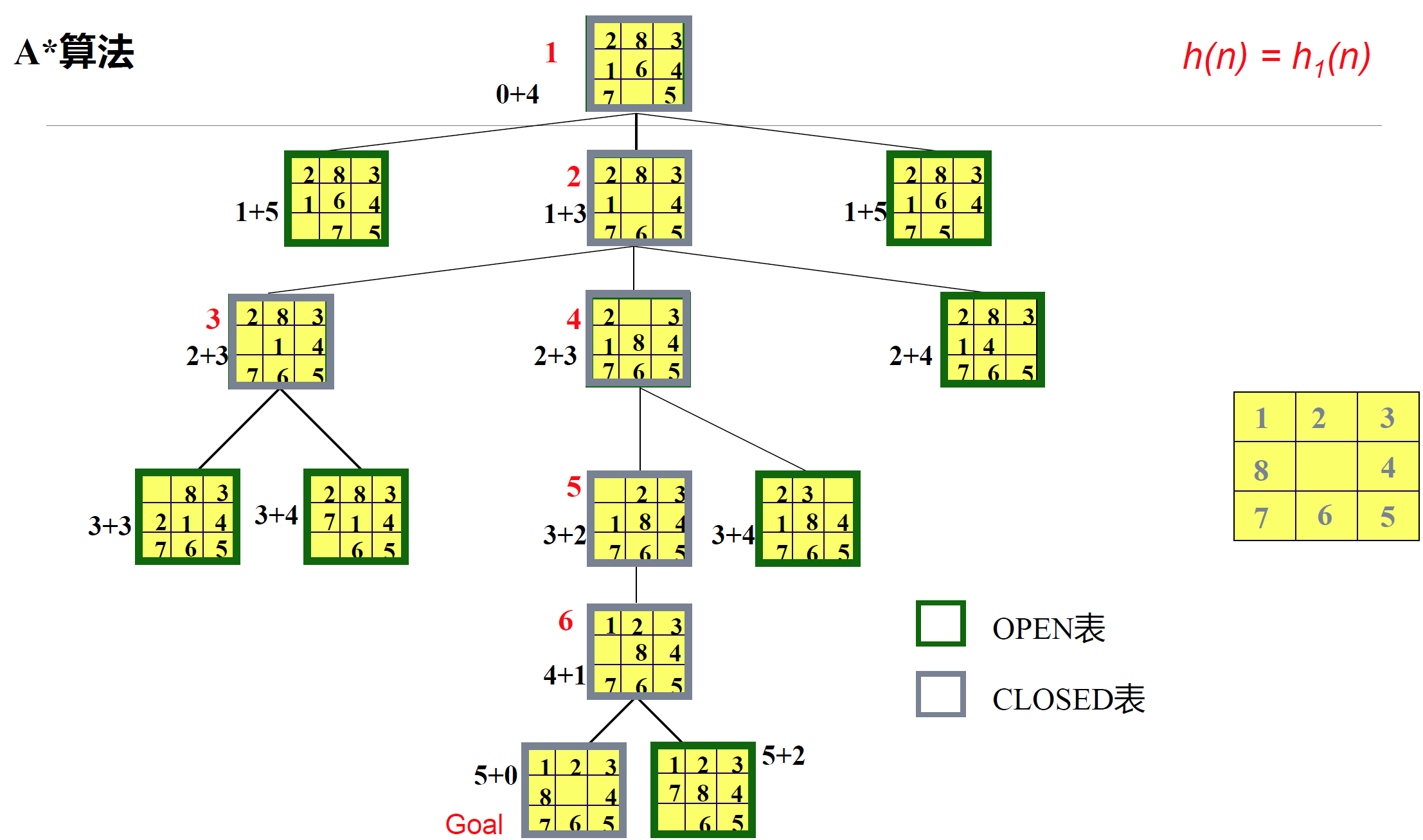

例如:

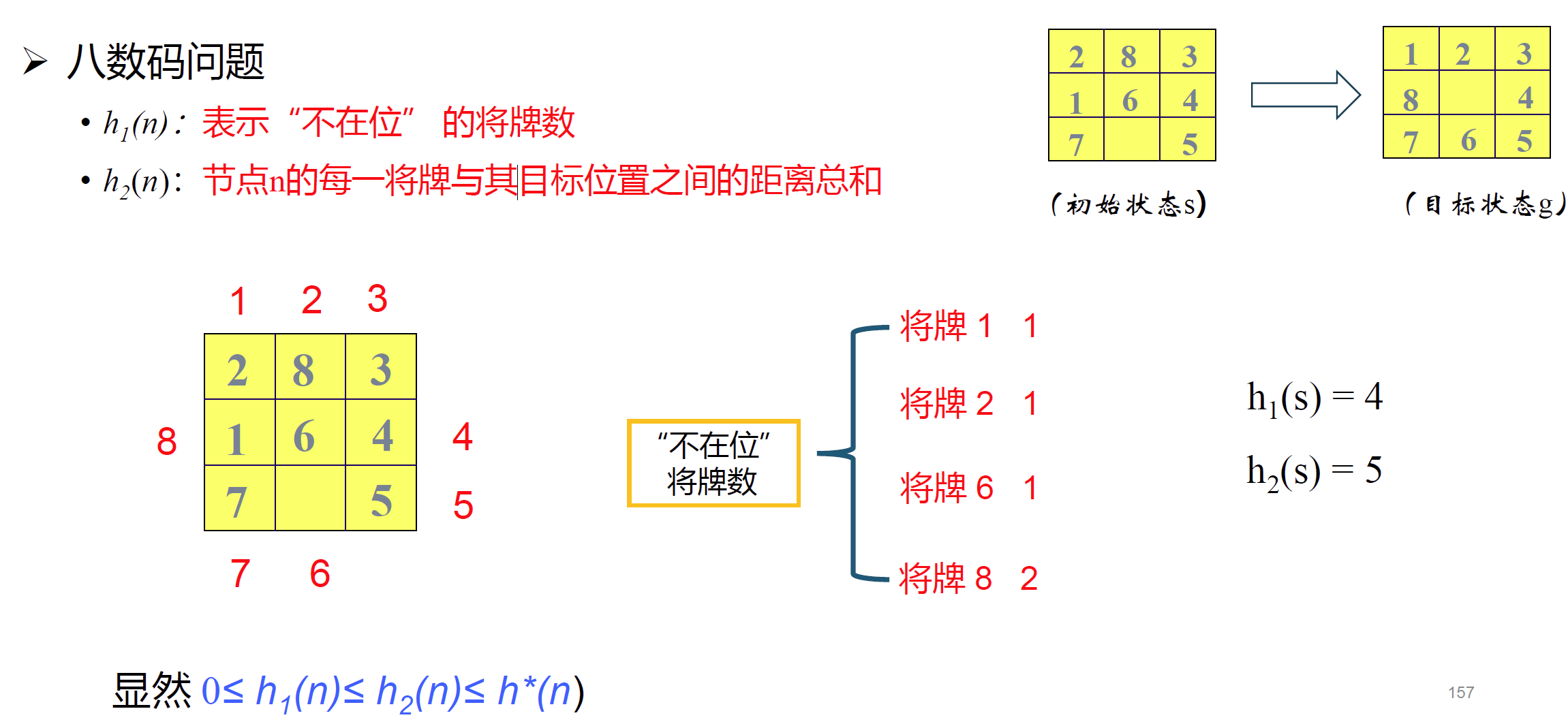

方案1:

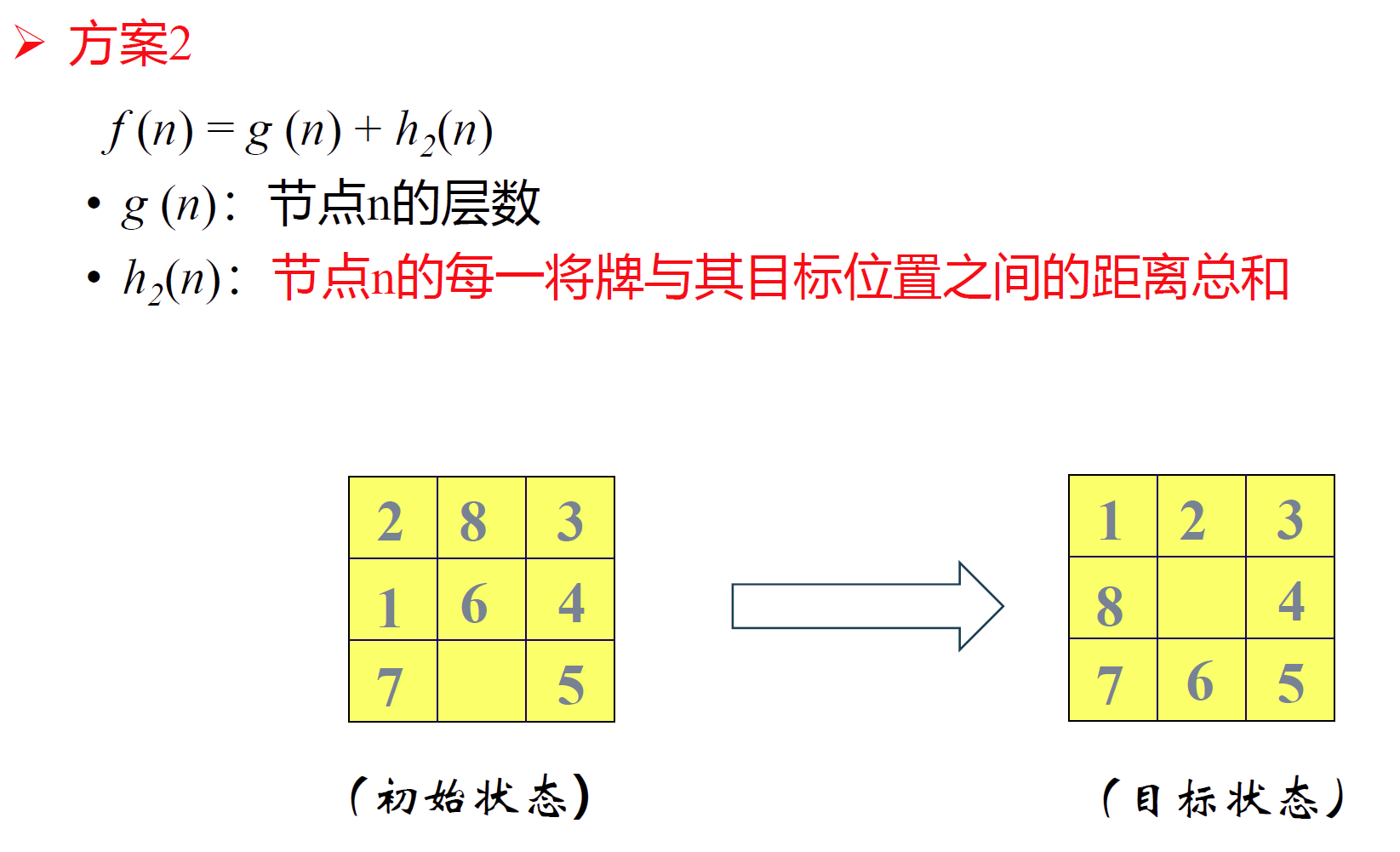

方案2:

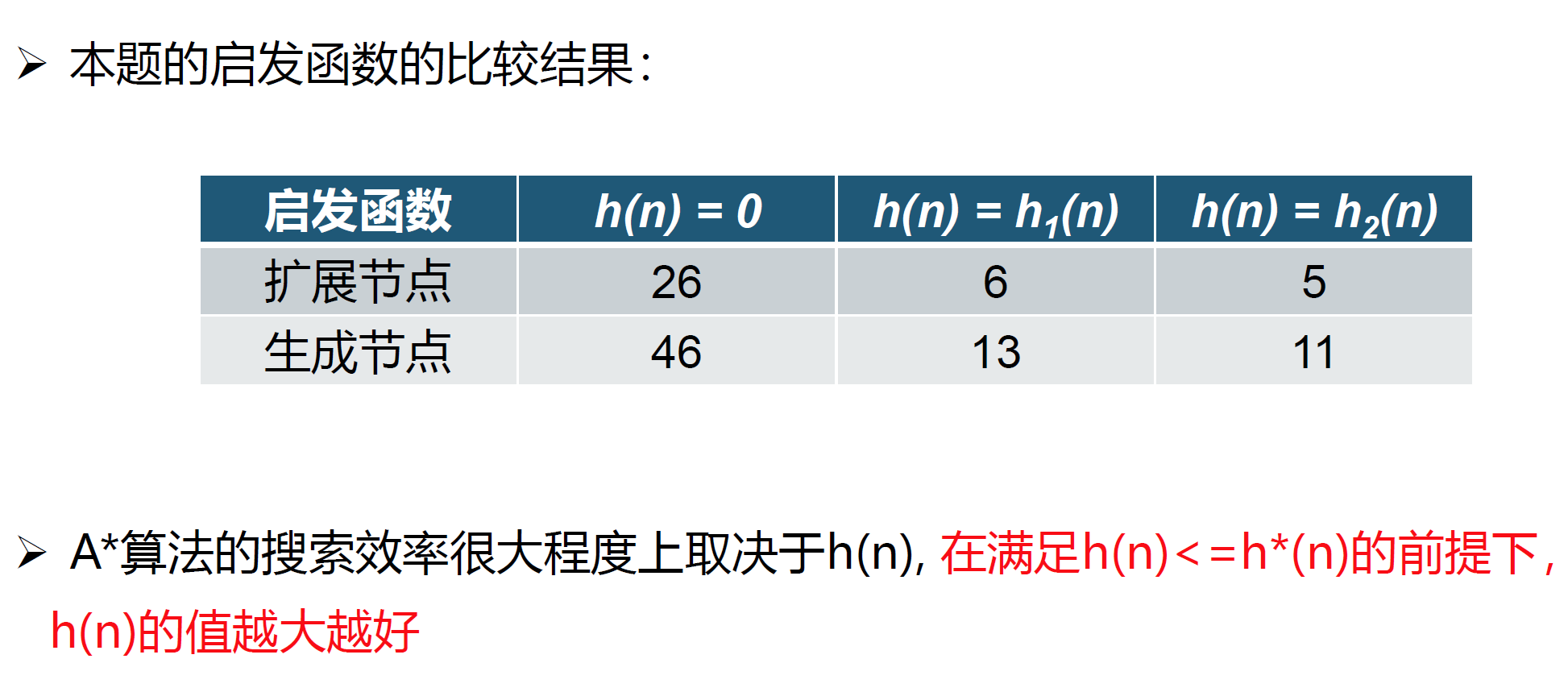

等代价搜索、方案1和方案2对比:

启发式搜索小结

第四章 智能计算及其应用

智能计算的定义

受自然界和生物界规律启迪,模仿其原理设计求解问题的算法。

如:遗传 基因 免疫 蚁群 粒子群 蜂群 鱼群 细菌群 退火 模糊 神经网络……

群智能算法产生背景

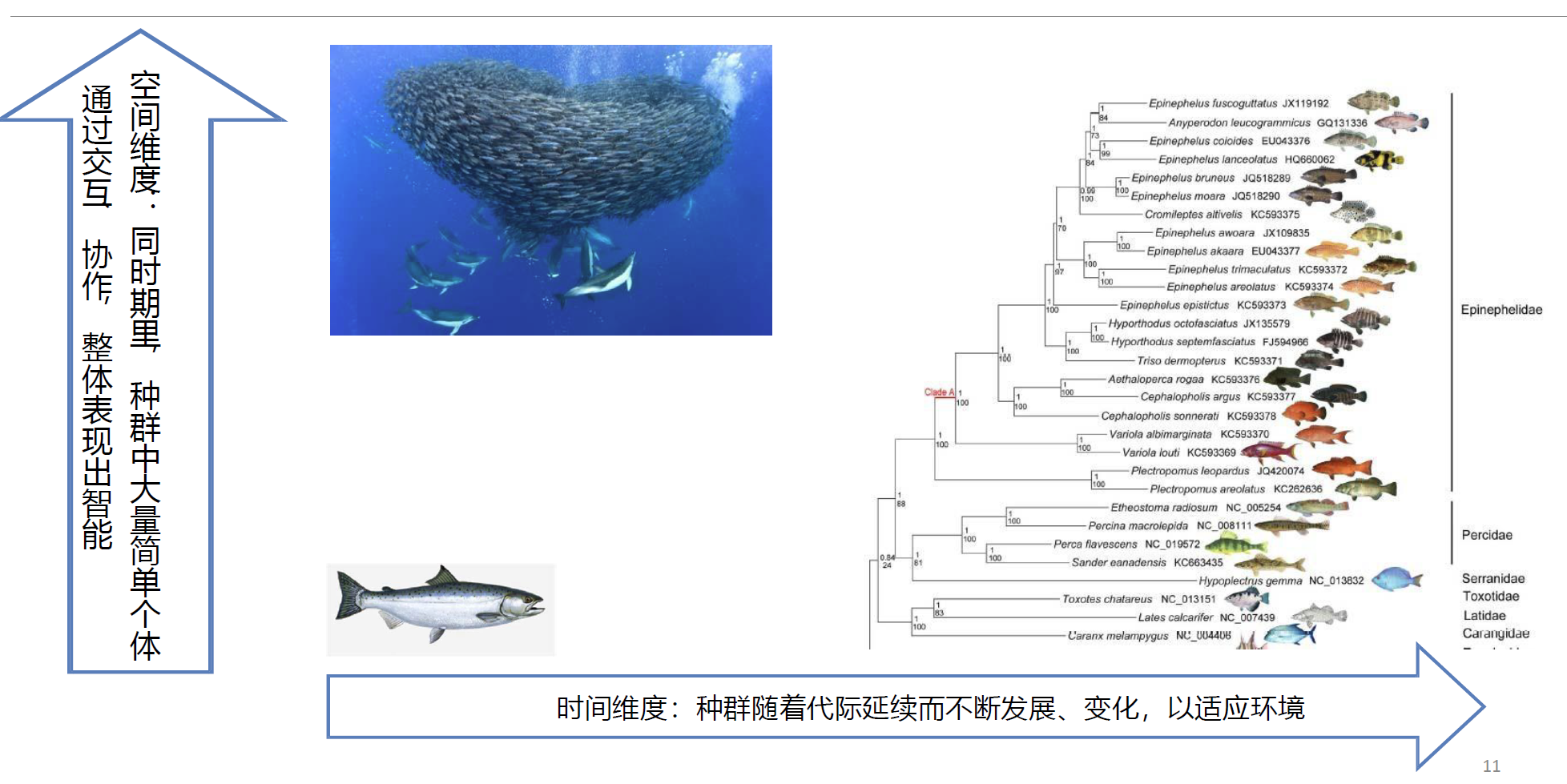

对物种适者生存的解读、进化智能和群体智能的定义

典型的进化智能算法和群体智能算法

遗传算法

引言

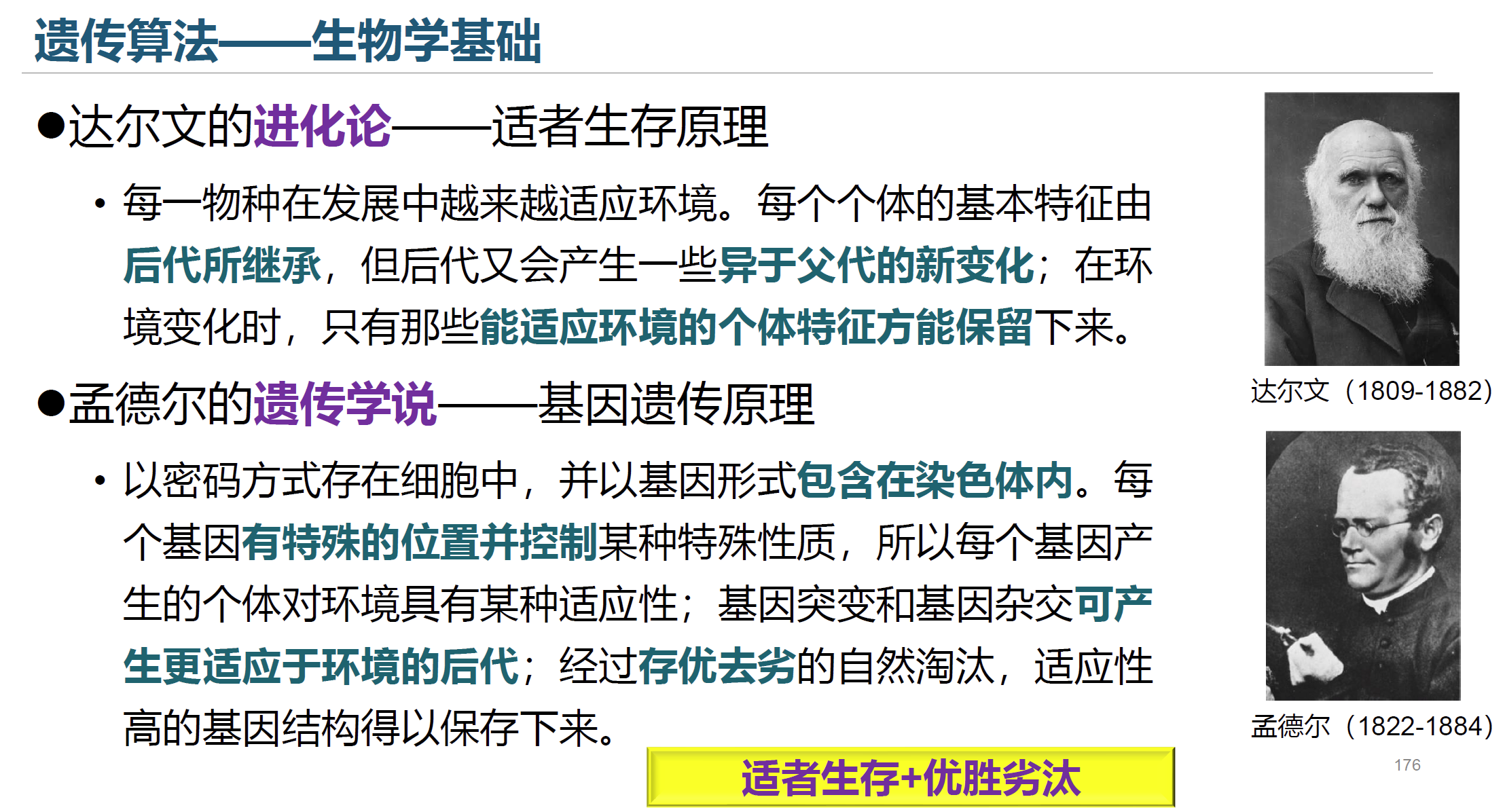

生物学基础

20 世纪 80 年代以后:遗传算法兴盛发展时期,广泛应用于自动控制、生产计划、图像处理、机器人等领域

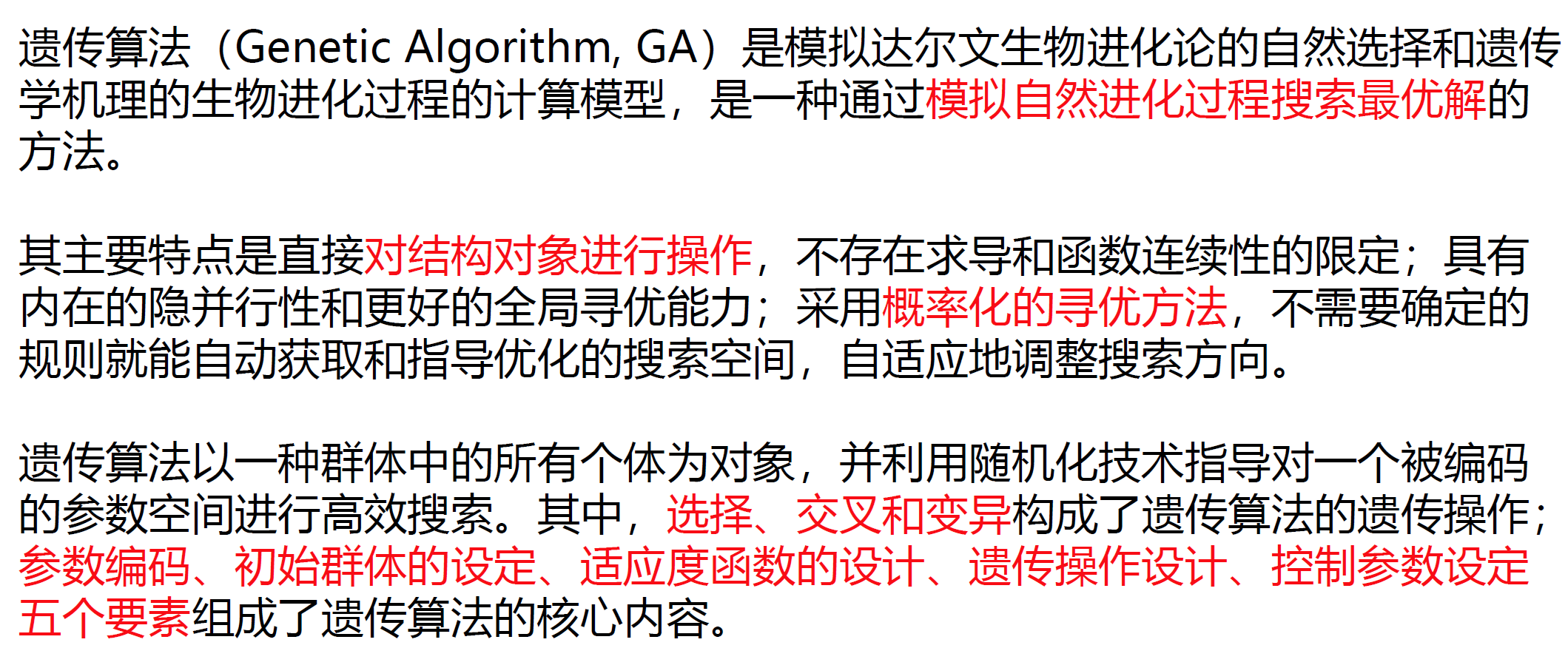

遗传算法的概念

遗传算法(Genetic Algorithm ):通过生物遗传和进化过程中选择、交叉、变异机理的模仿,完成对问题求解的 自适应搜索过程。

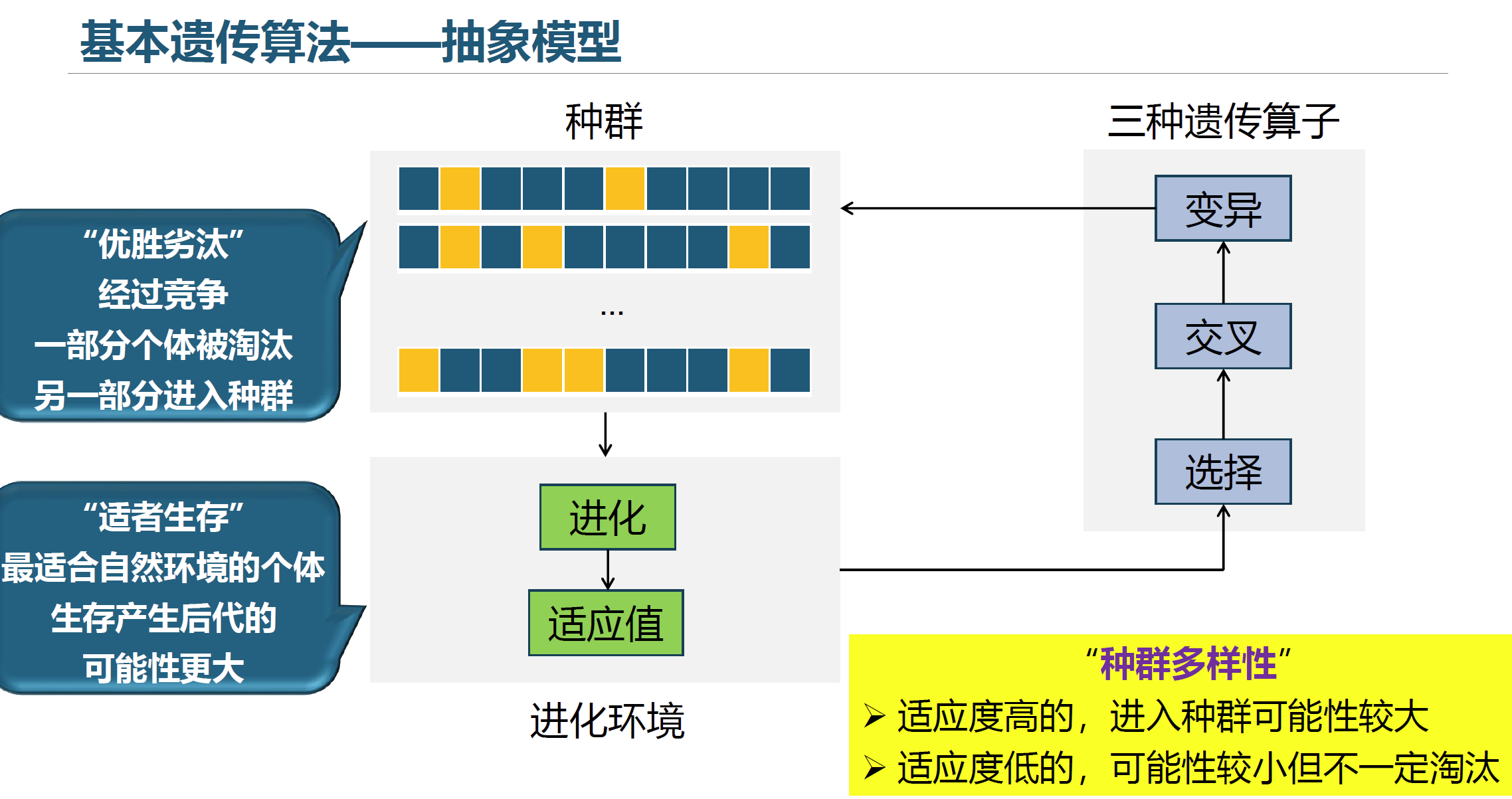

抽象模型

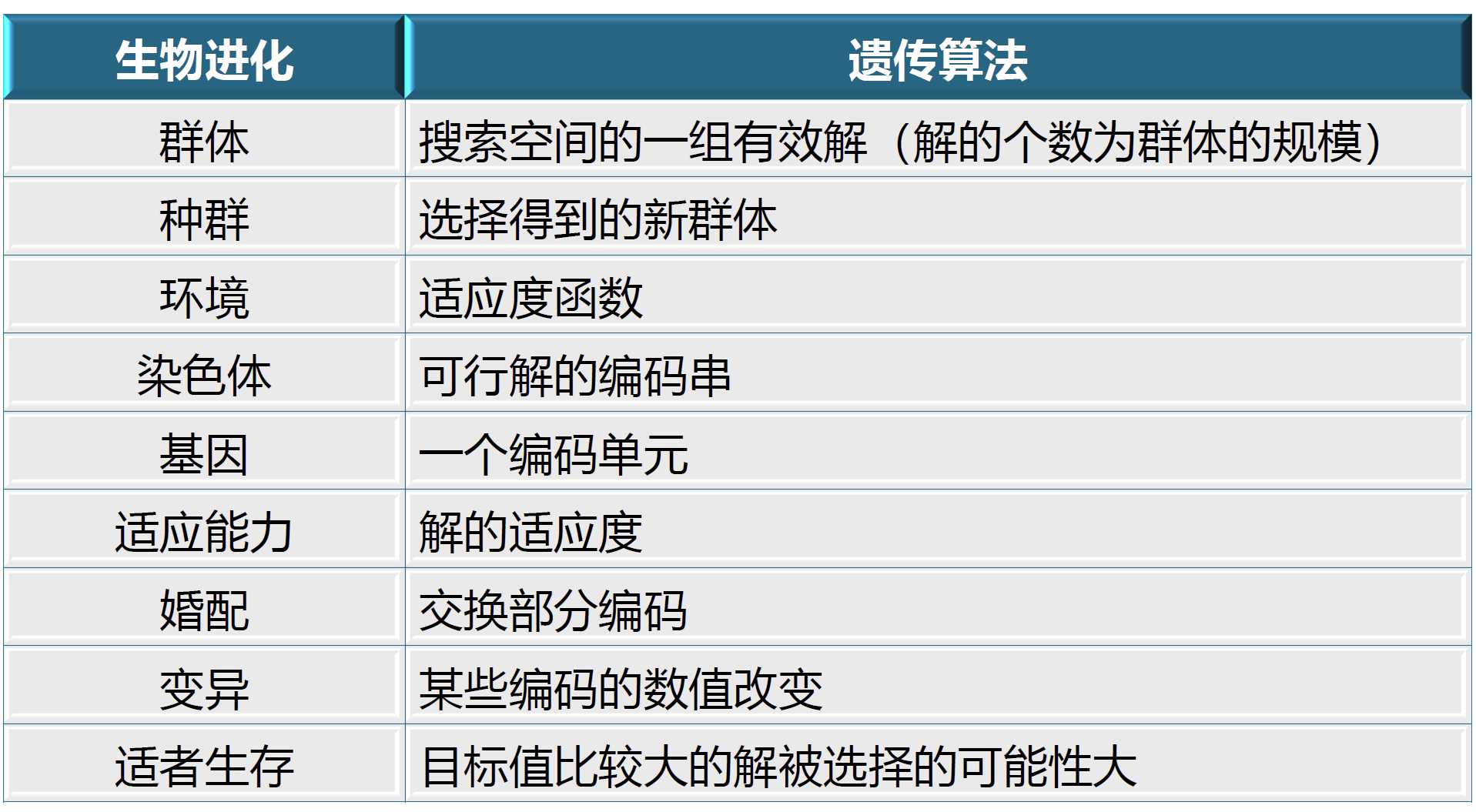

遗传算法和生物进化的对比

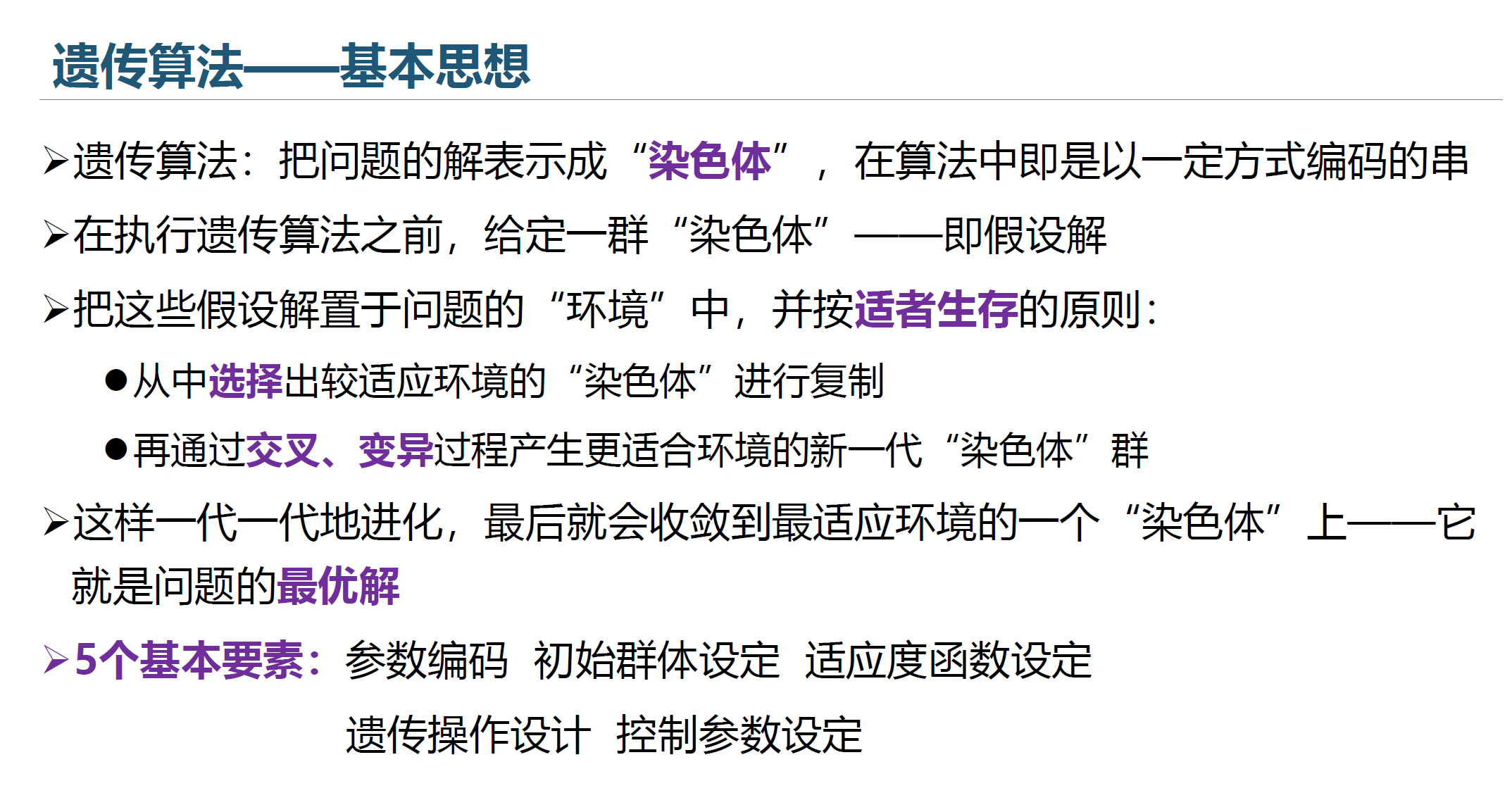

遗传算法的基本思想

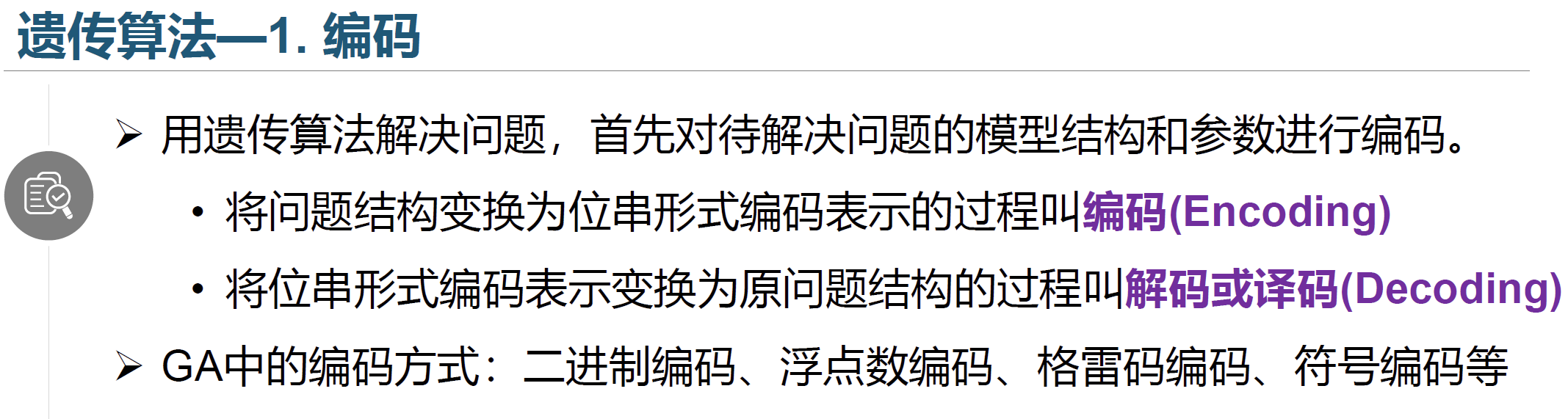

1.编码

2.群体设定

3.适应度函数

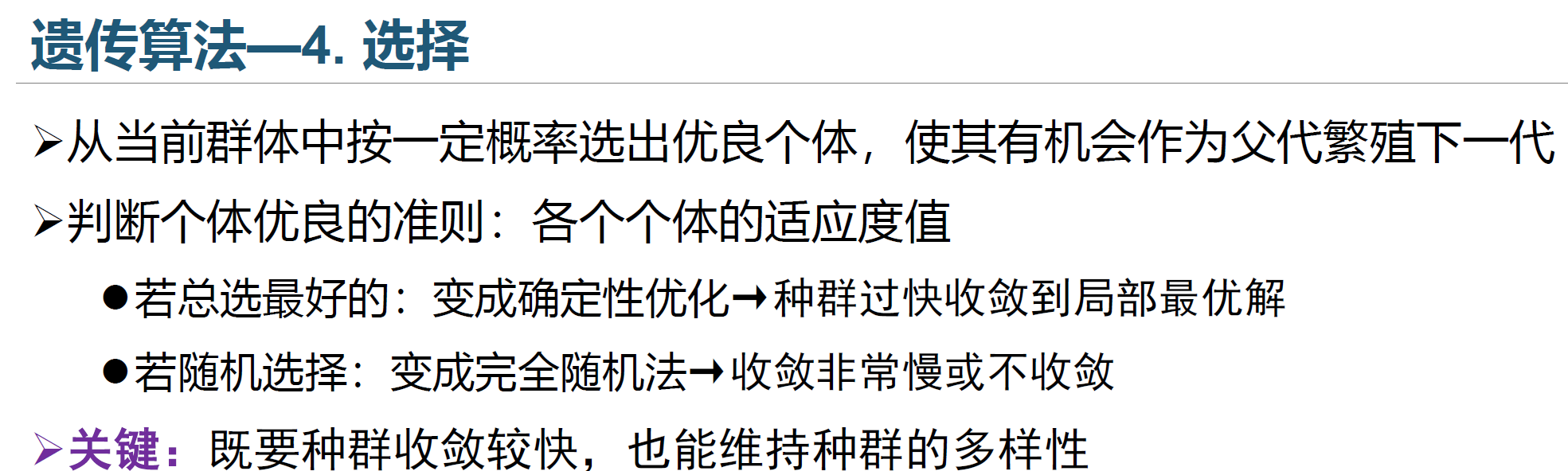

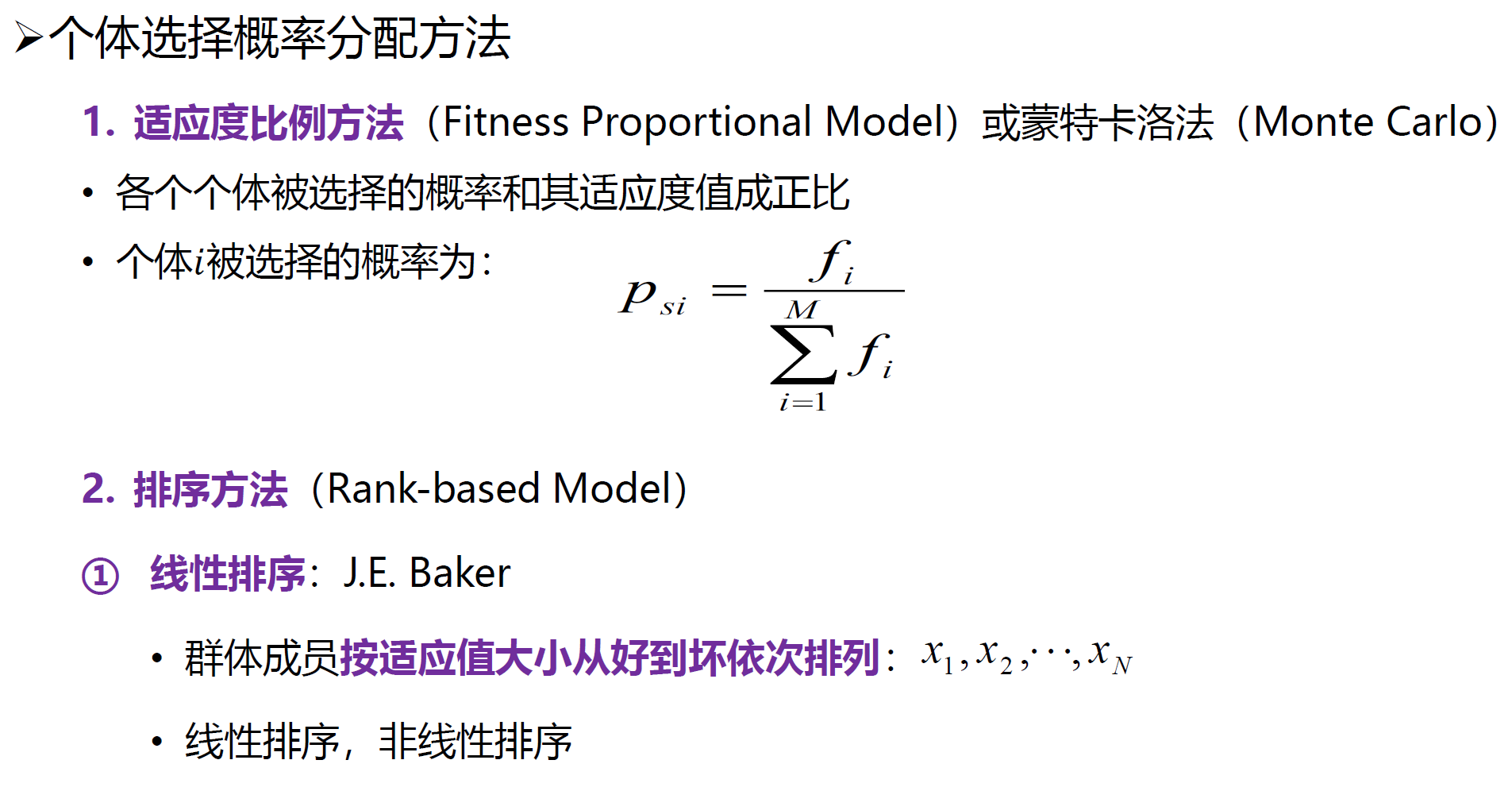

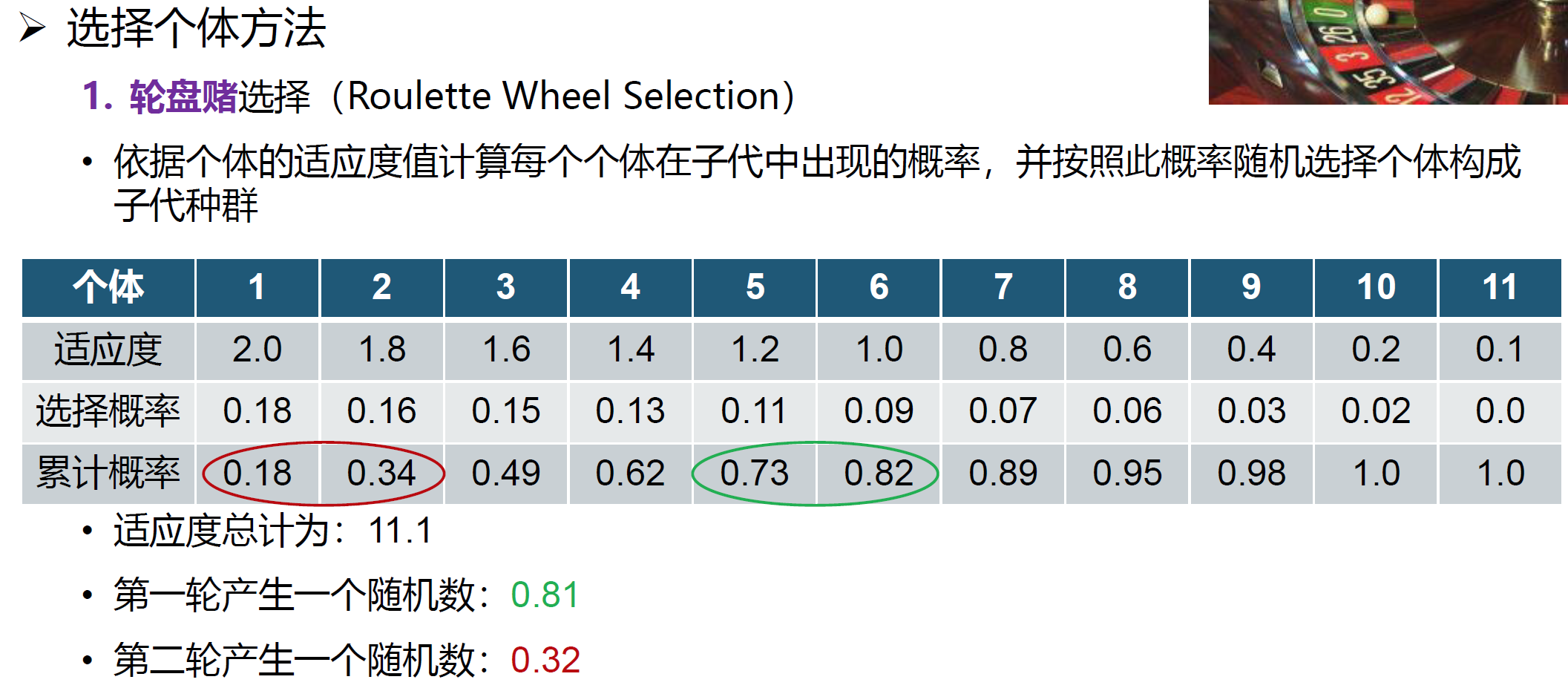

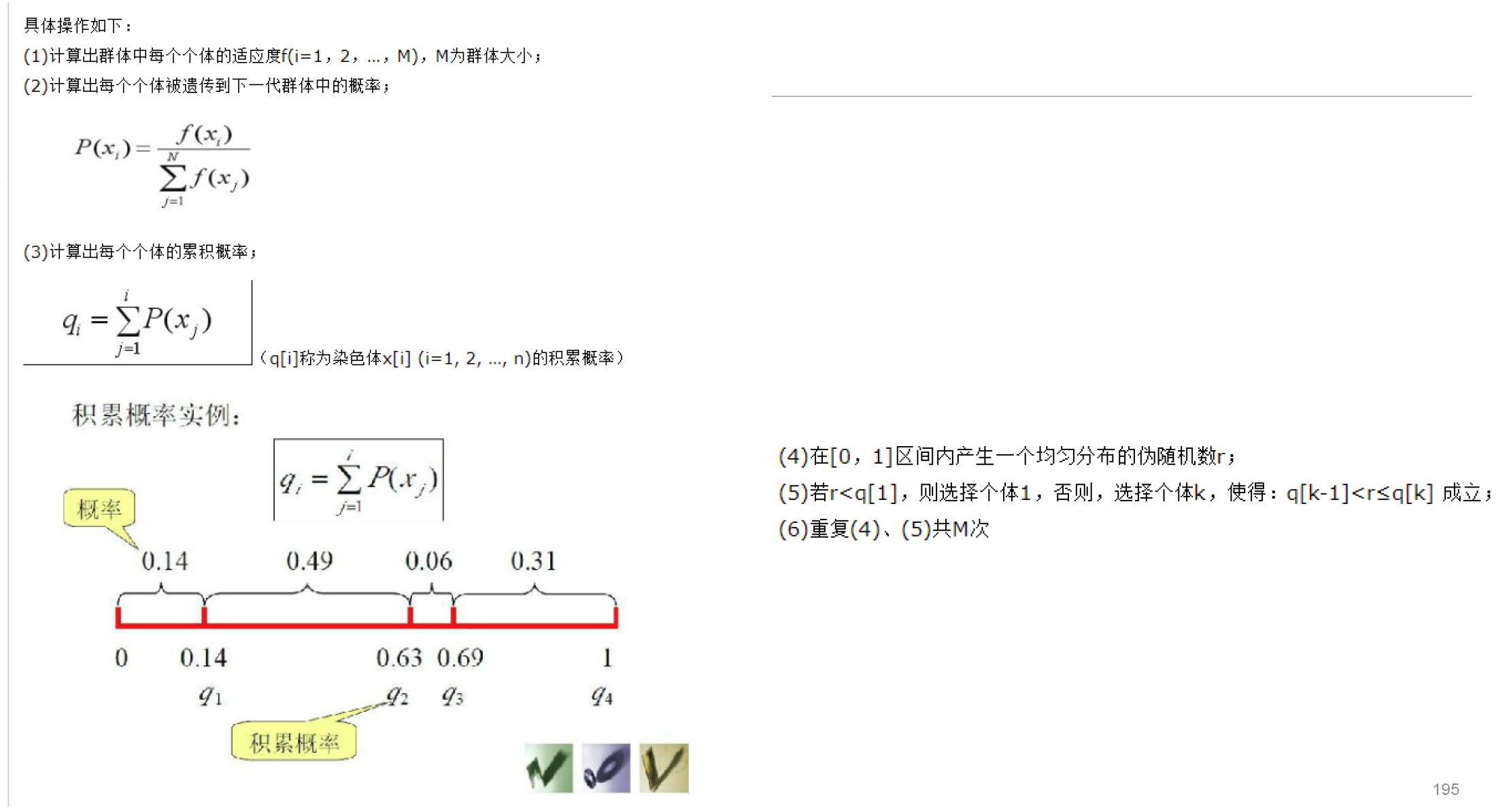

4.选择

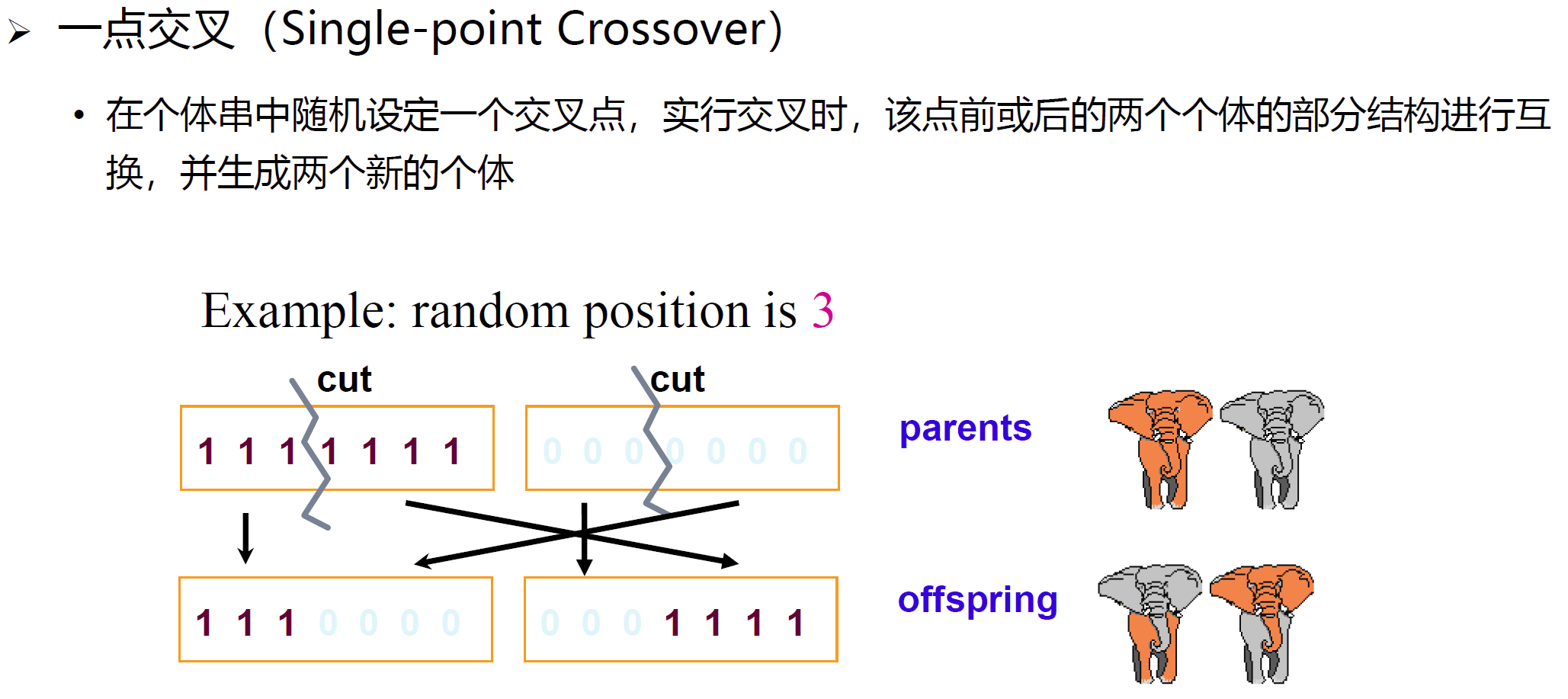

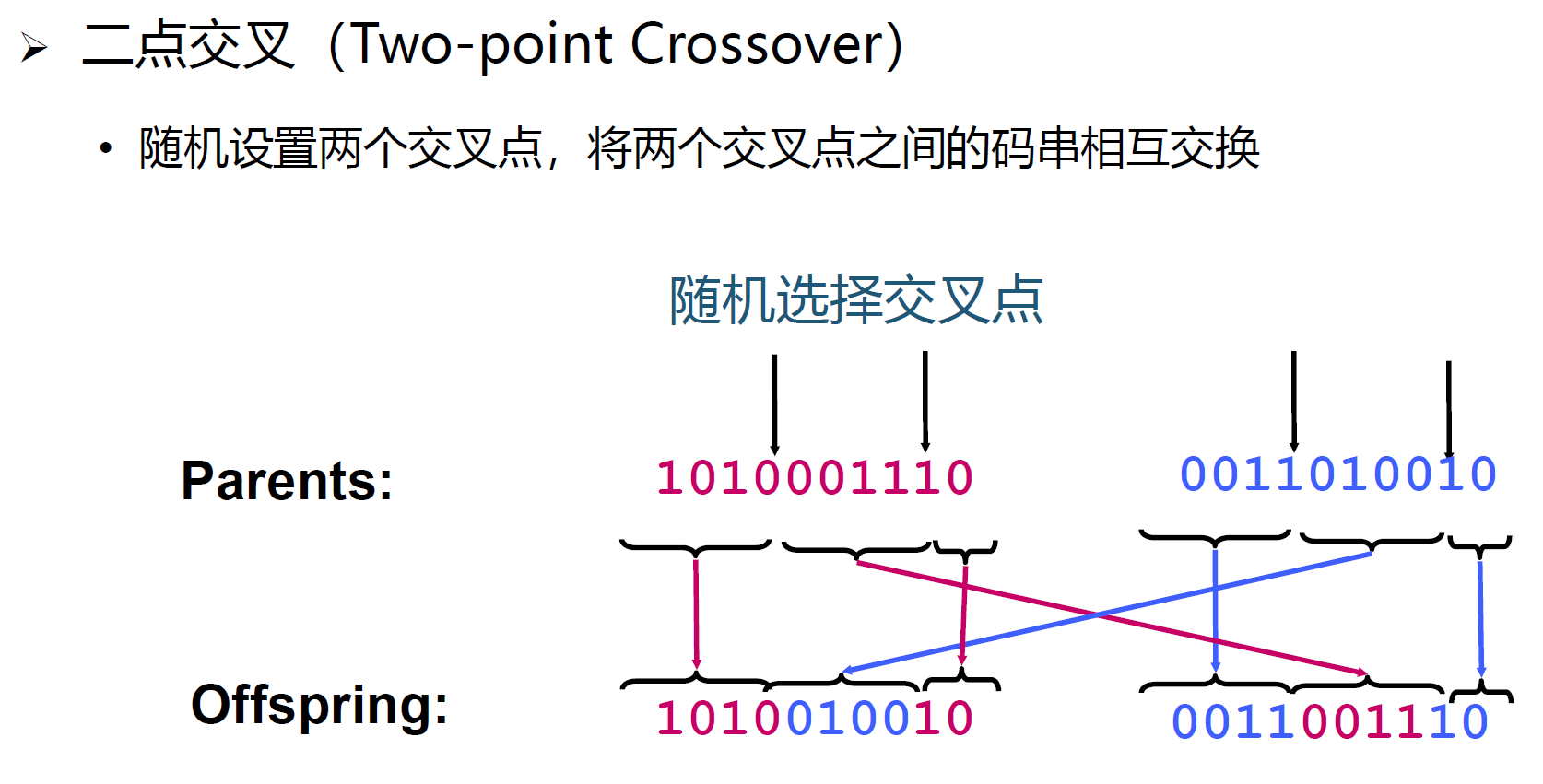

5.交叉

6.变异

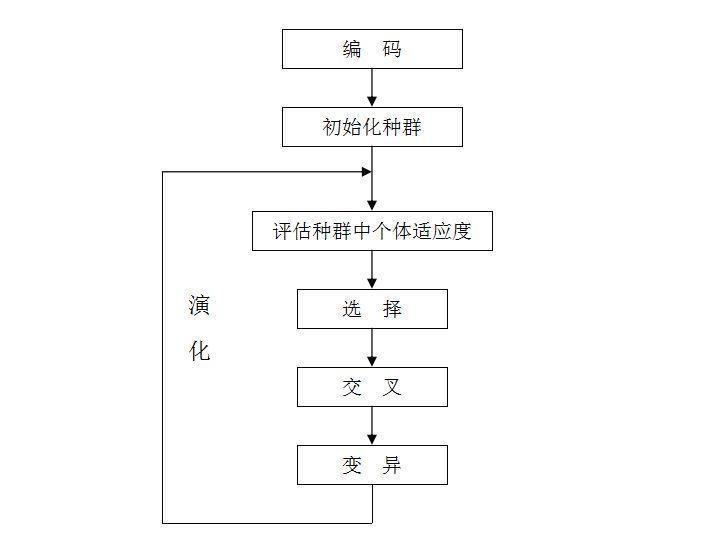

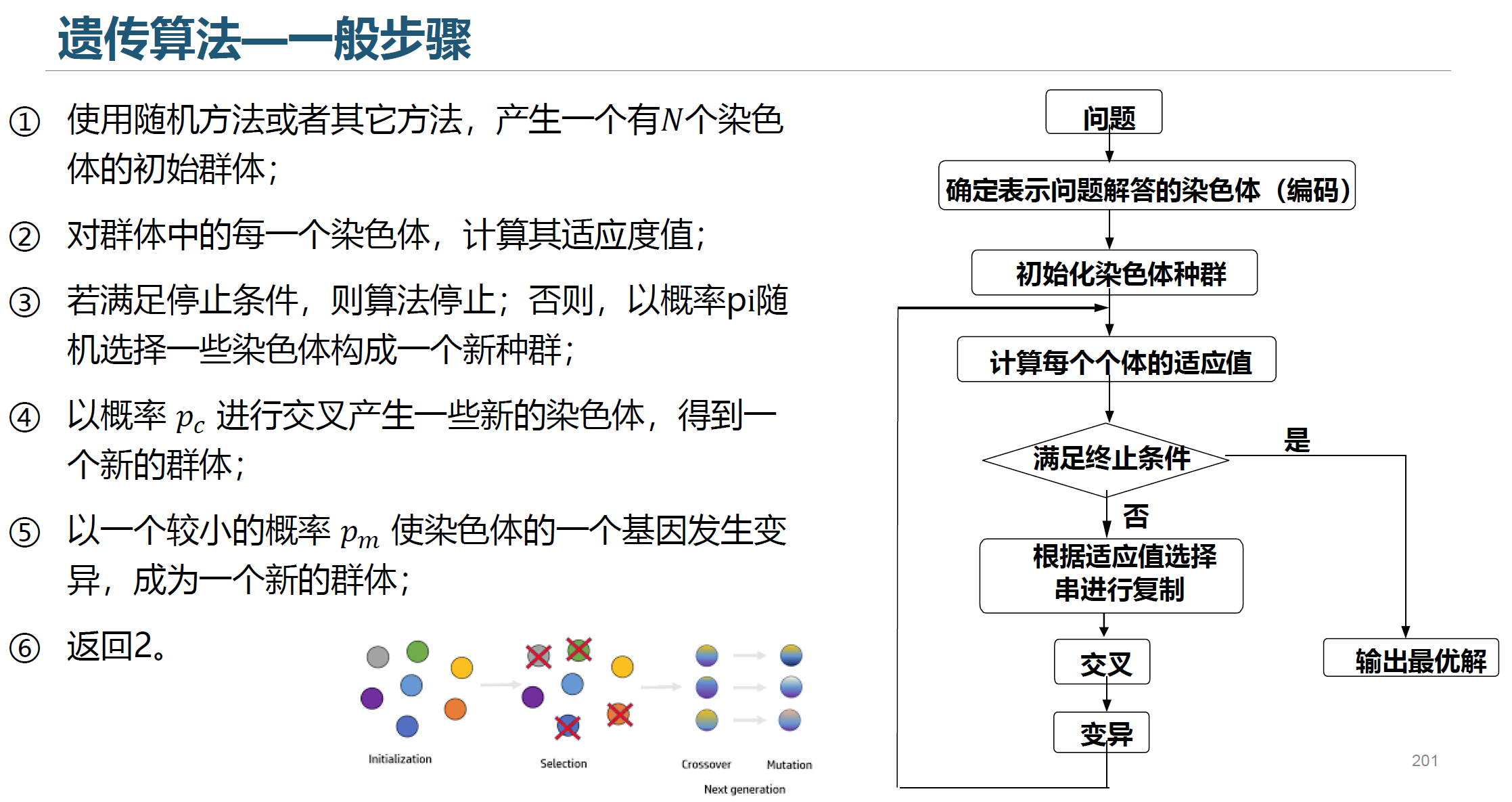

一般步骤

遗传算法与搜索技术的比较

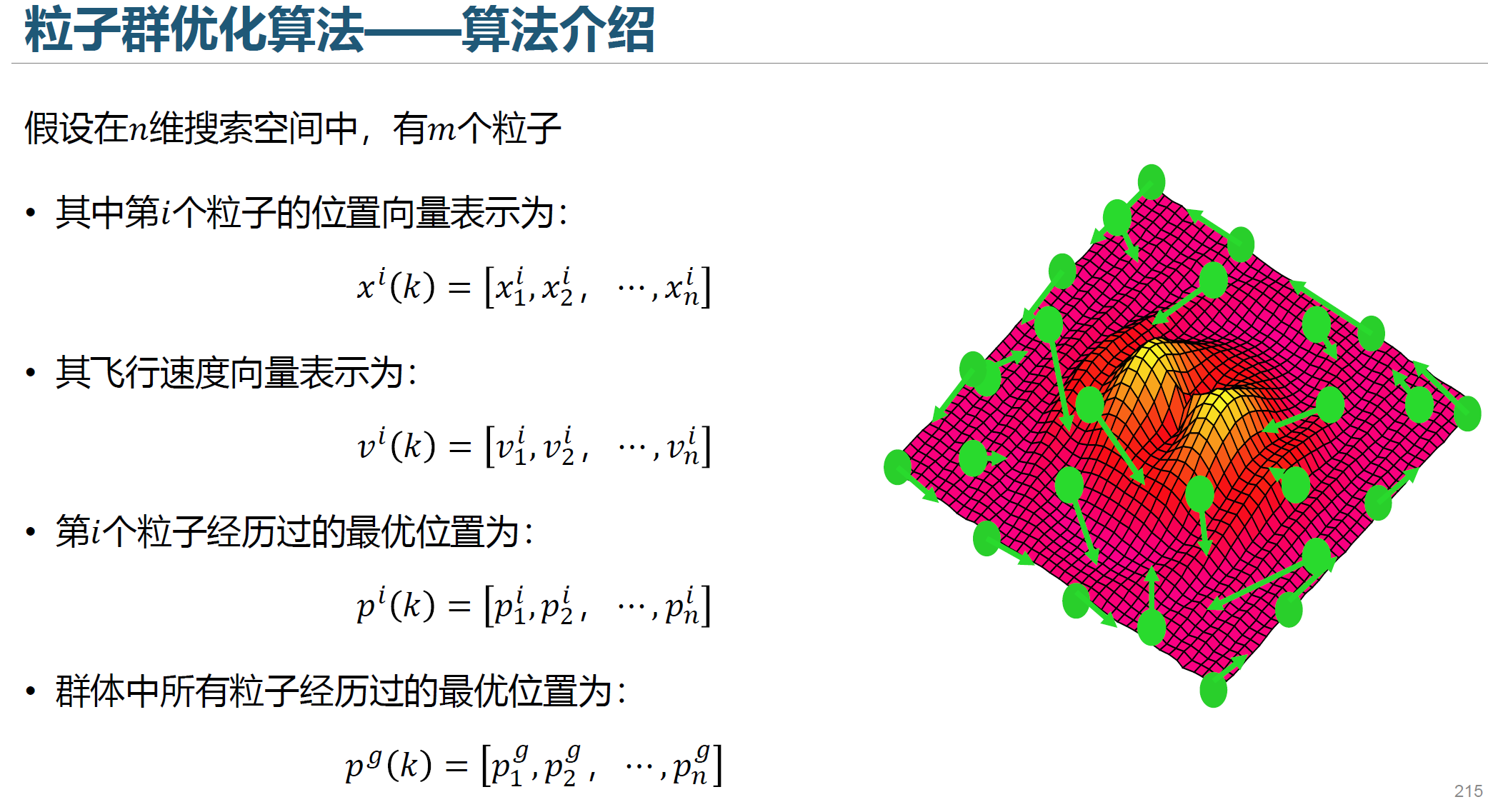

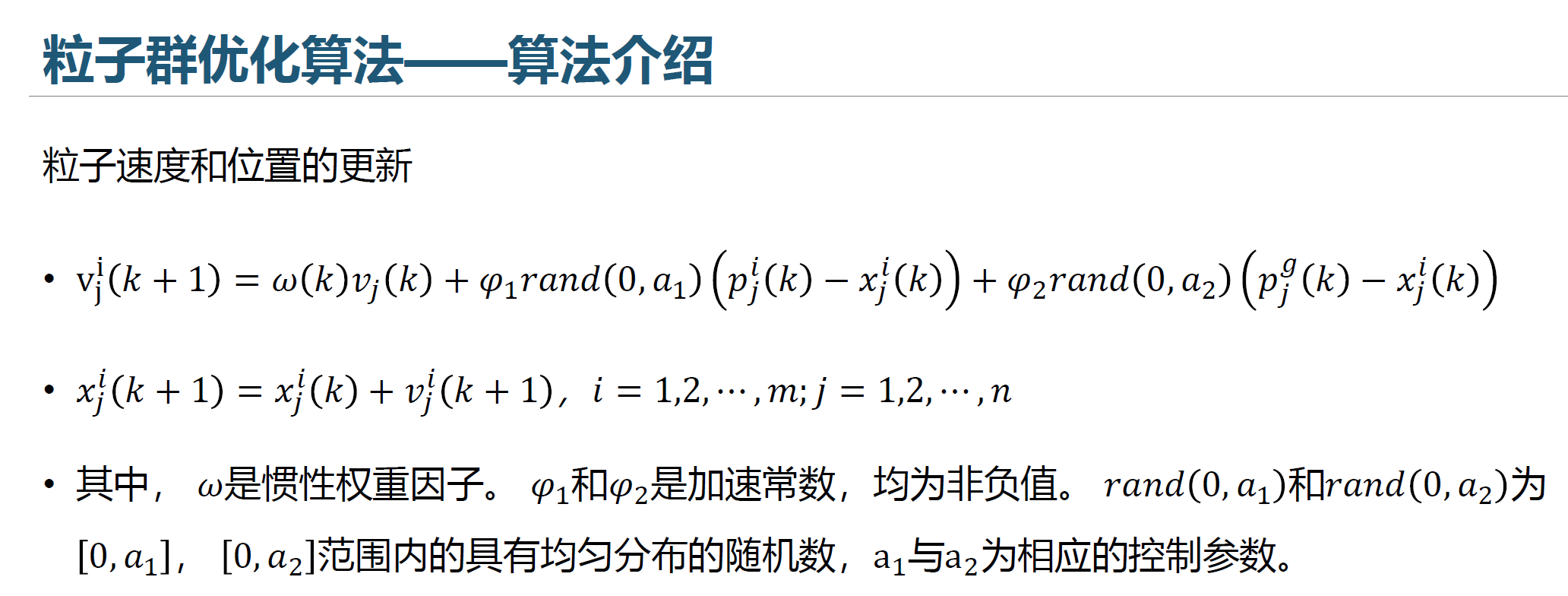

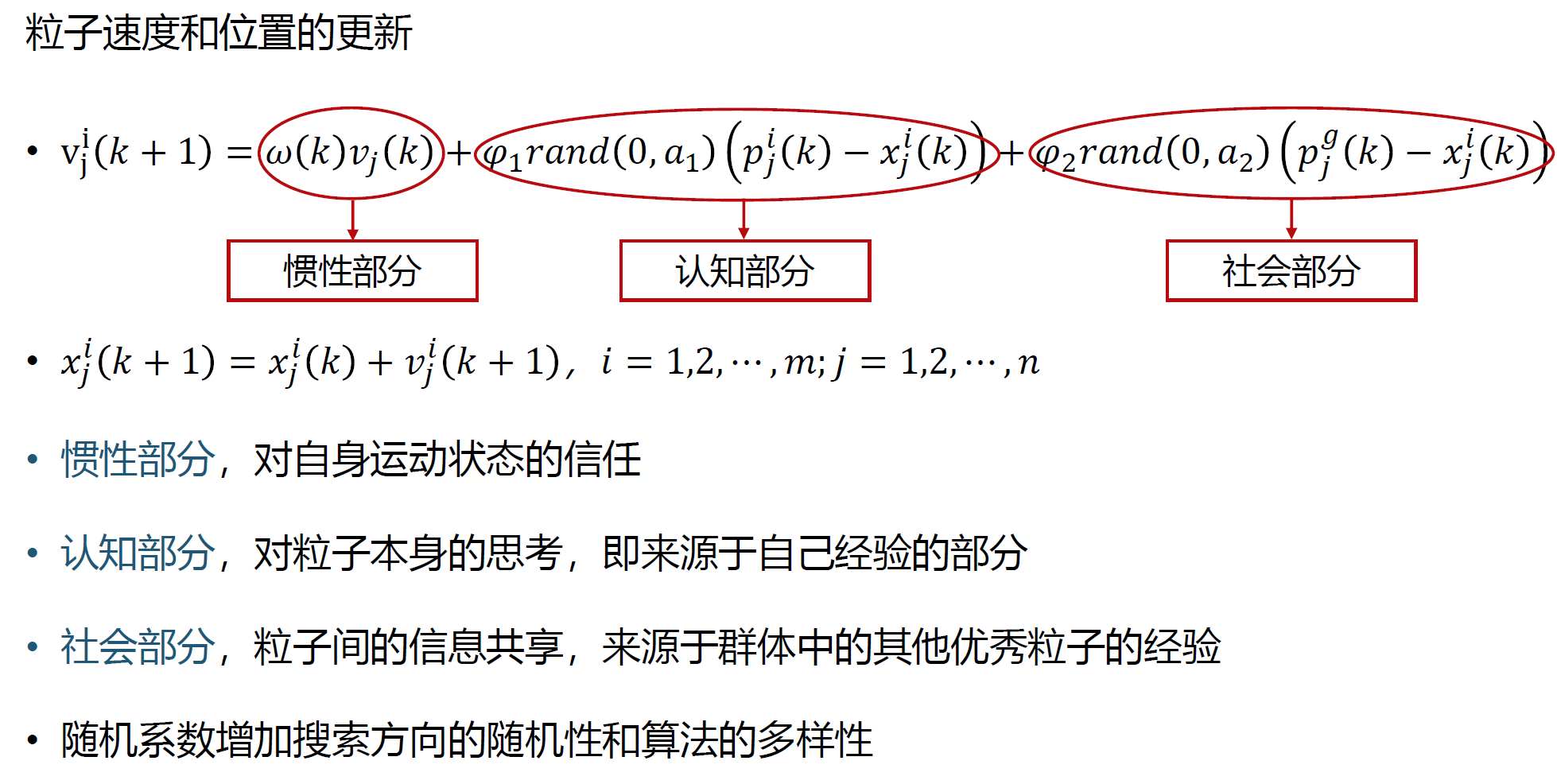

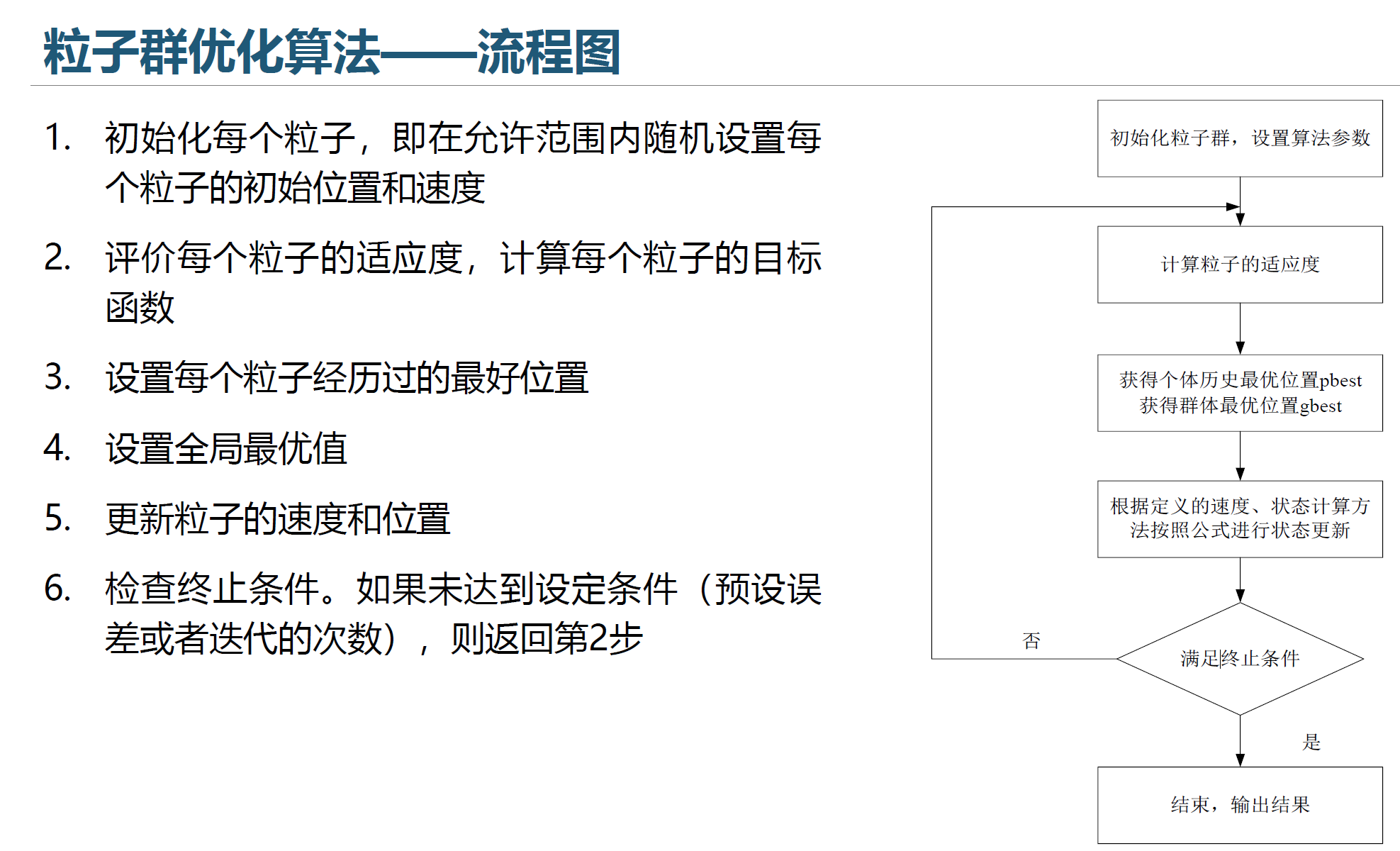

粒子群算法

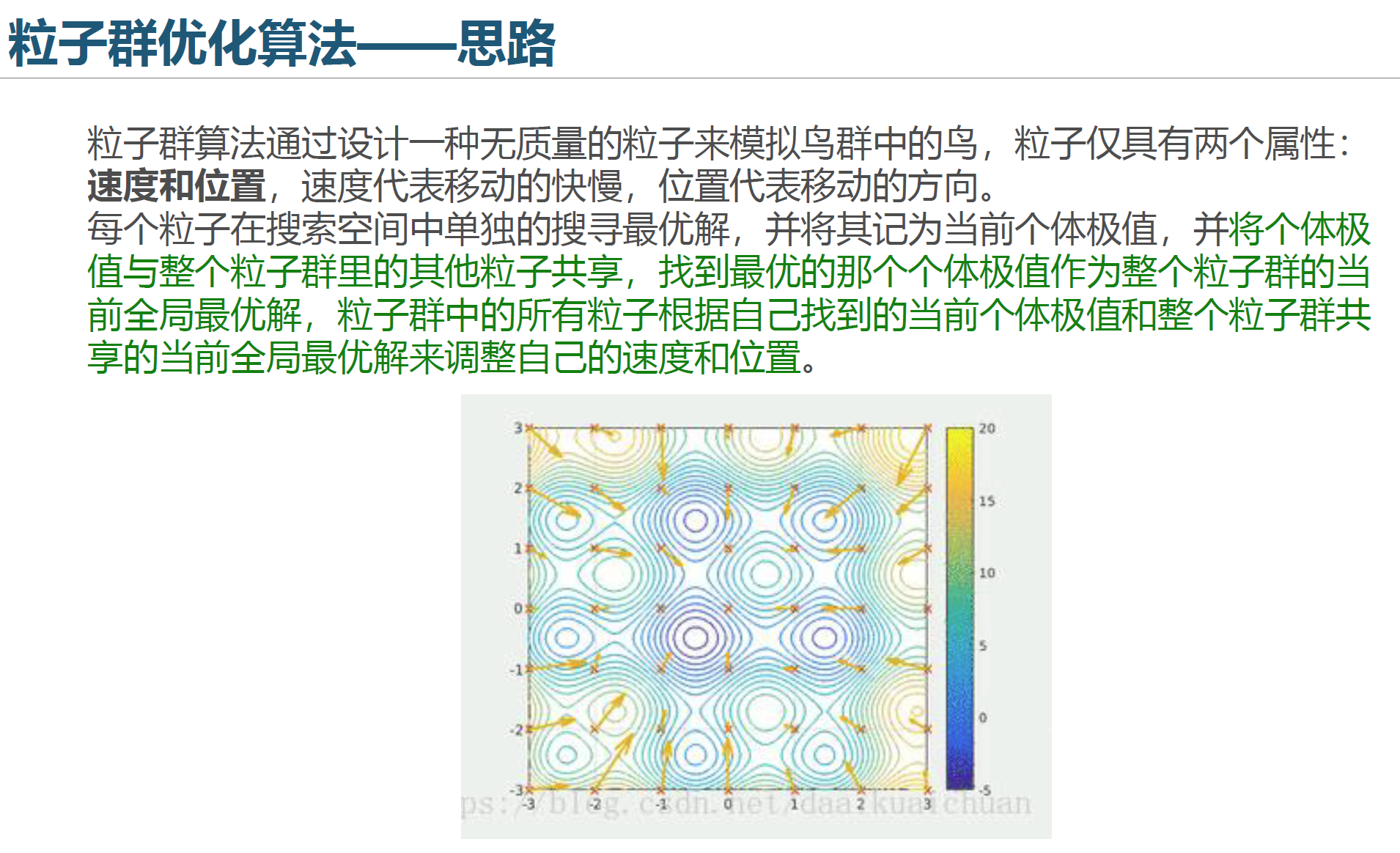

思路

流程图

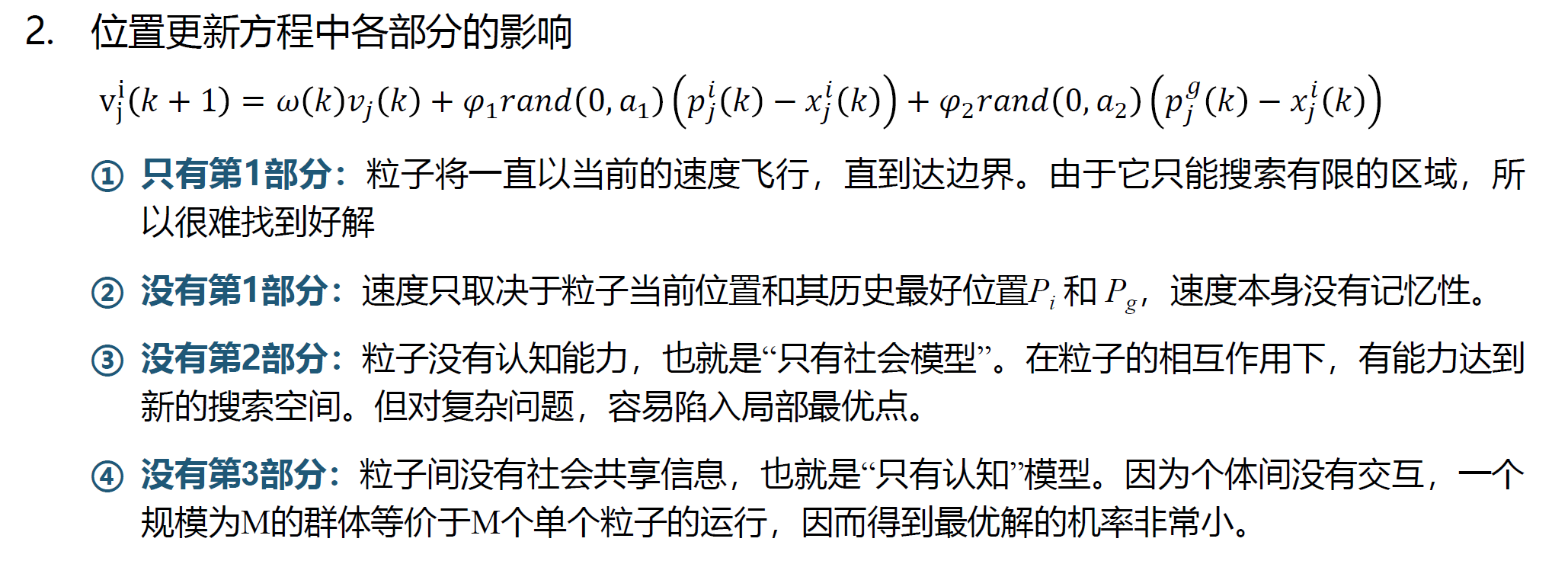

参数分析

特点

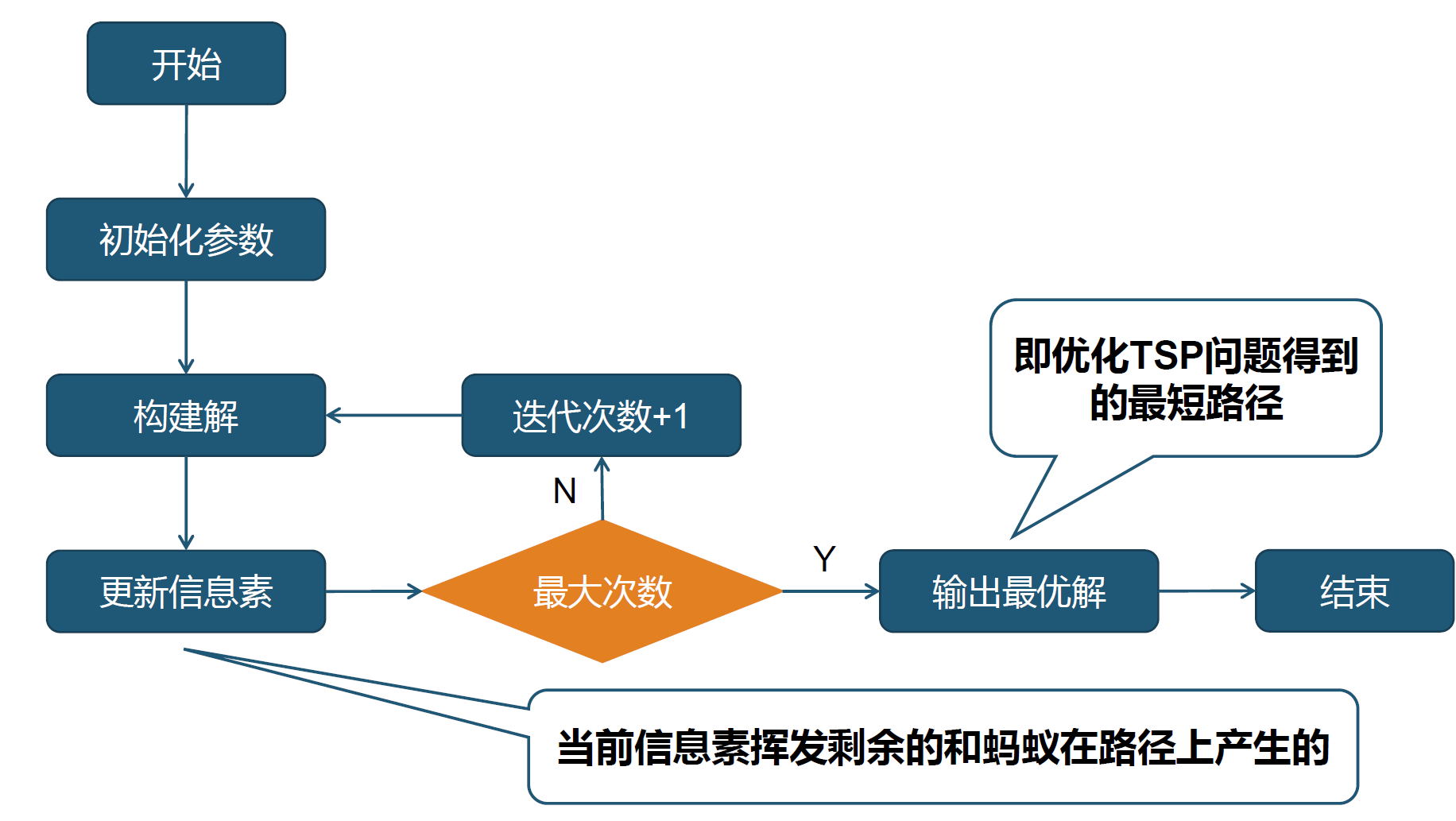

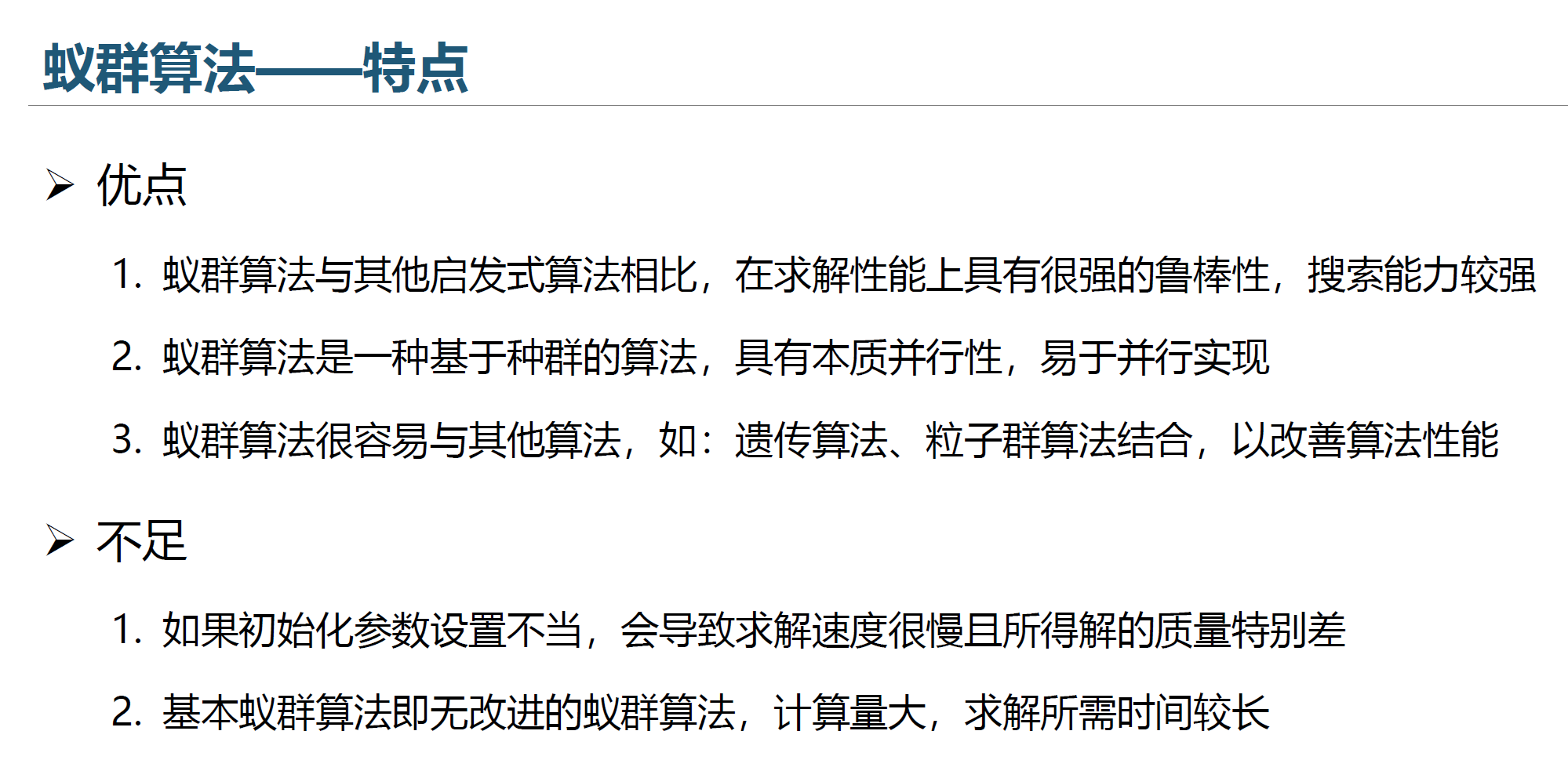

蚁群算法

基本原理

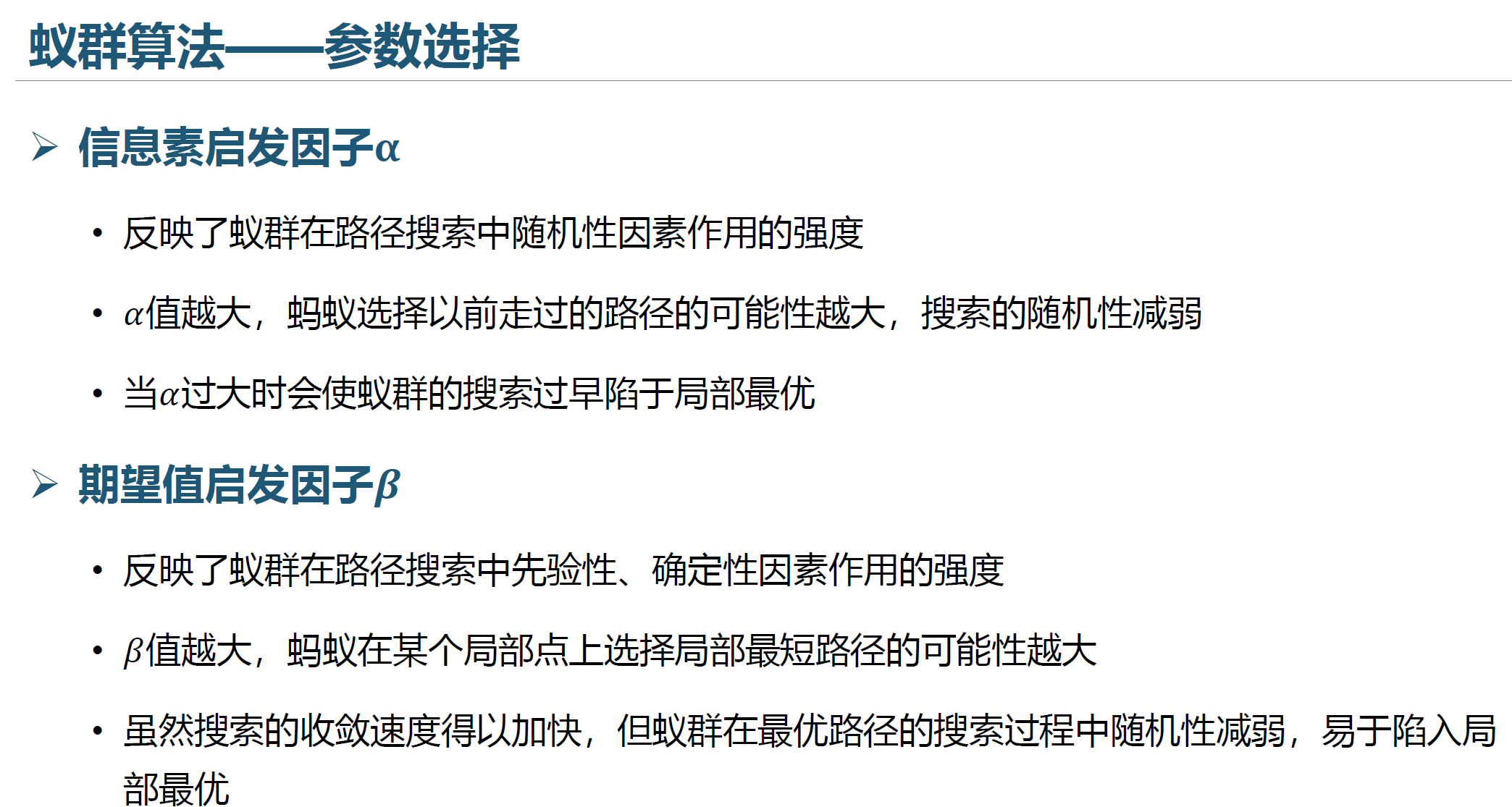

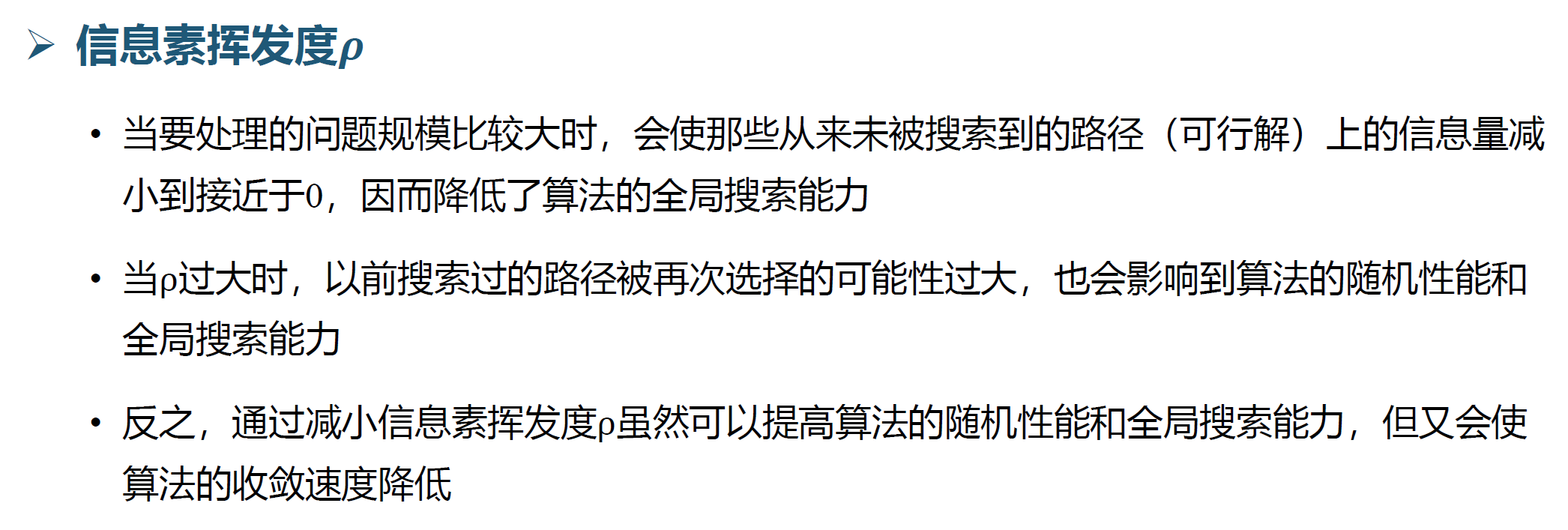

参数选择

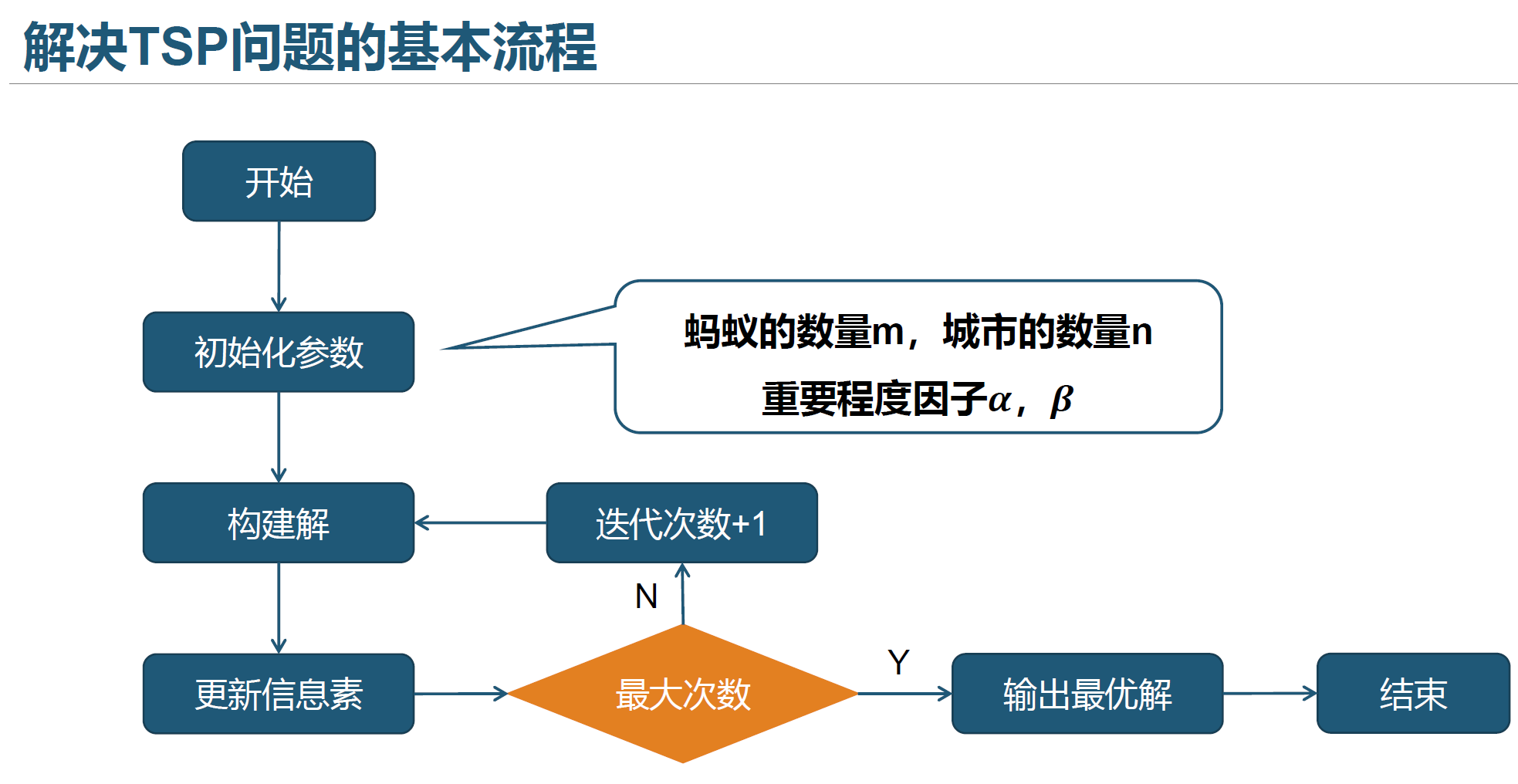

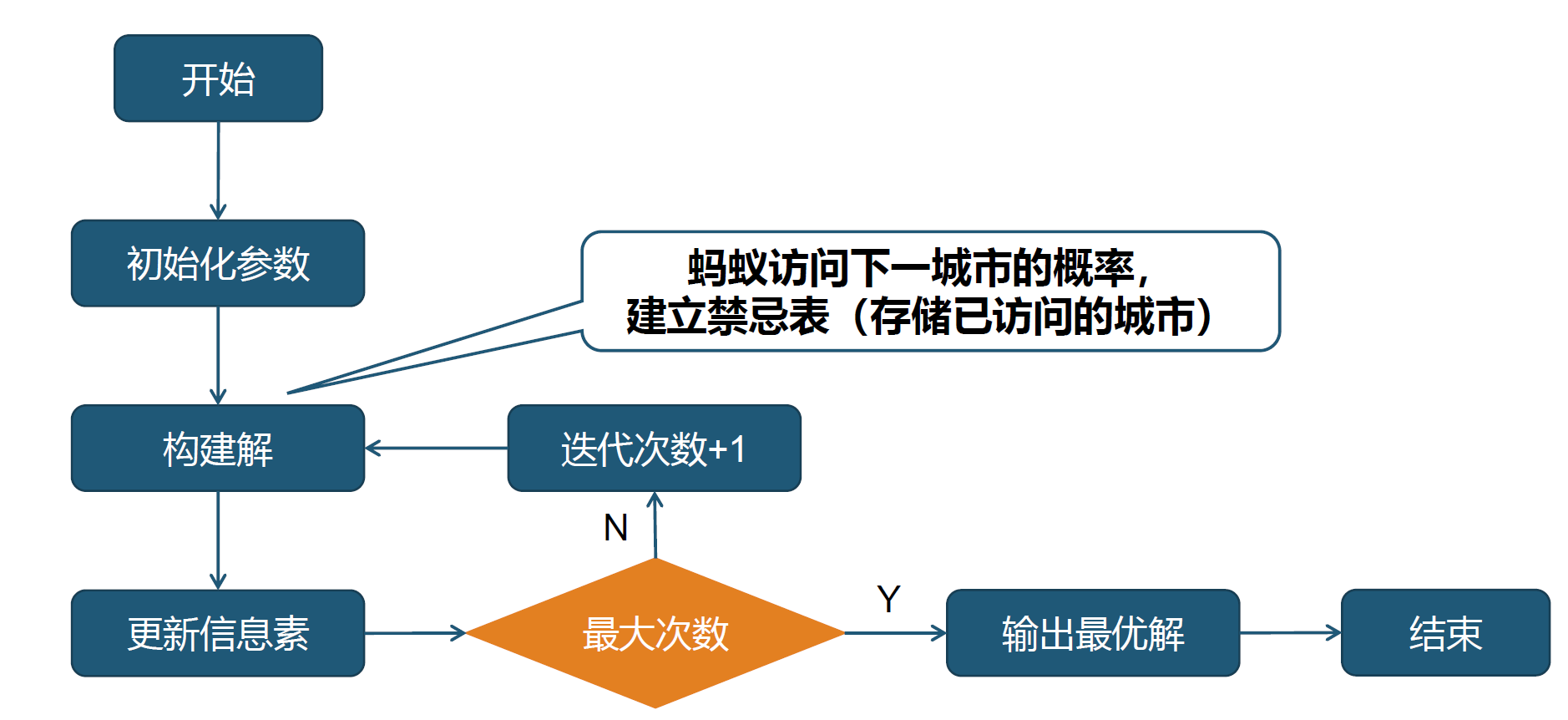

解决旅行商问题(Traveling Salesman Problem, TSP)

特点

第五章 机器学习

案例理解

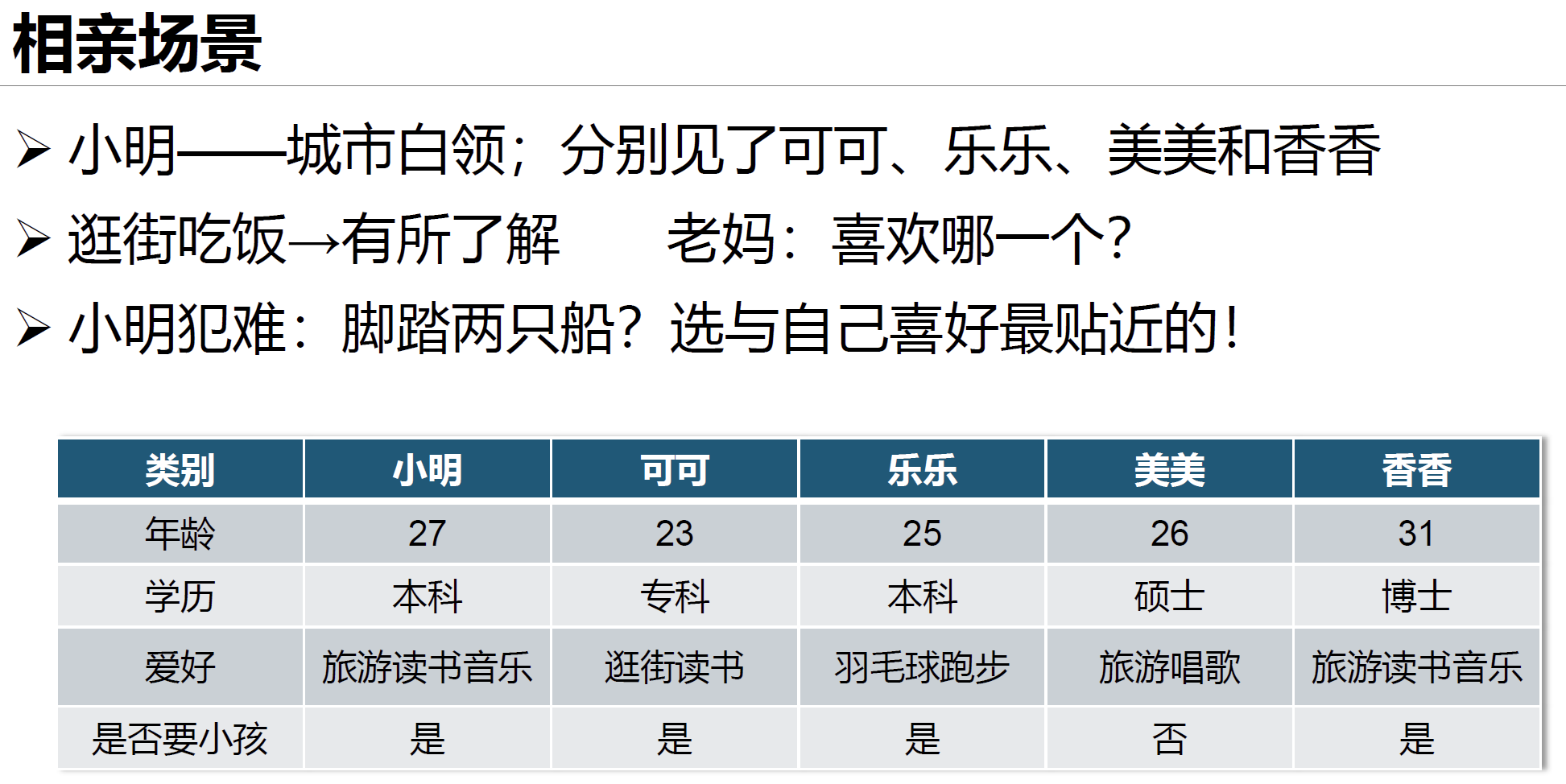

场景

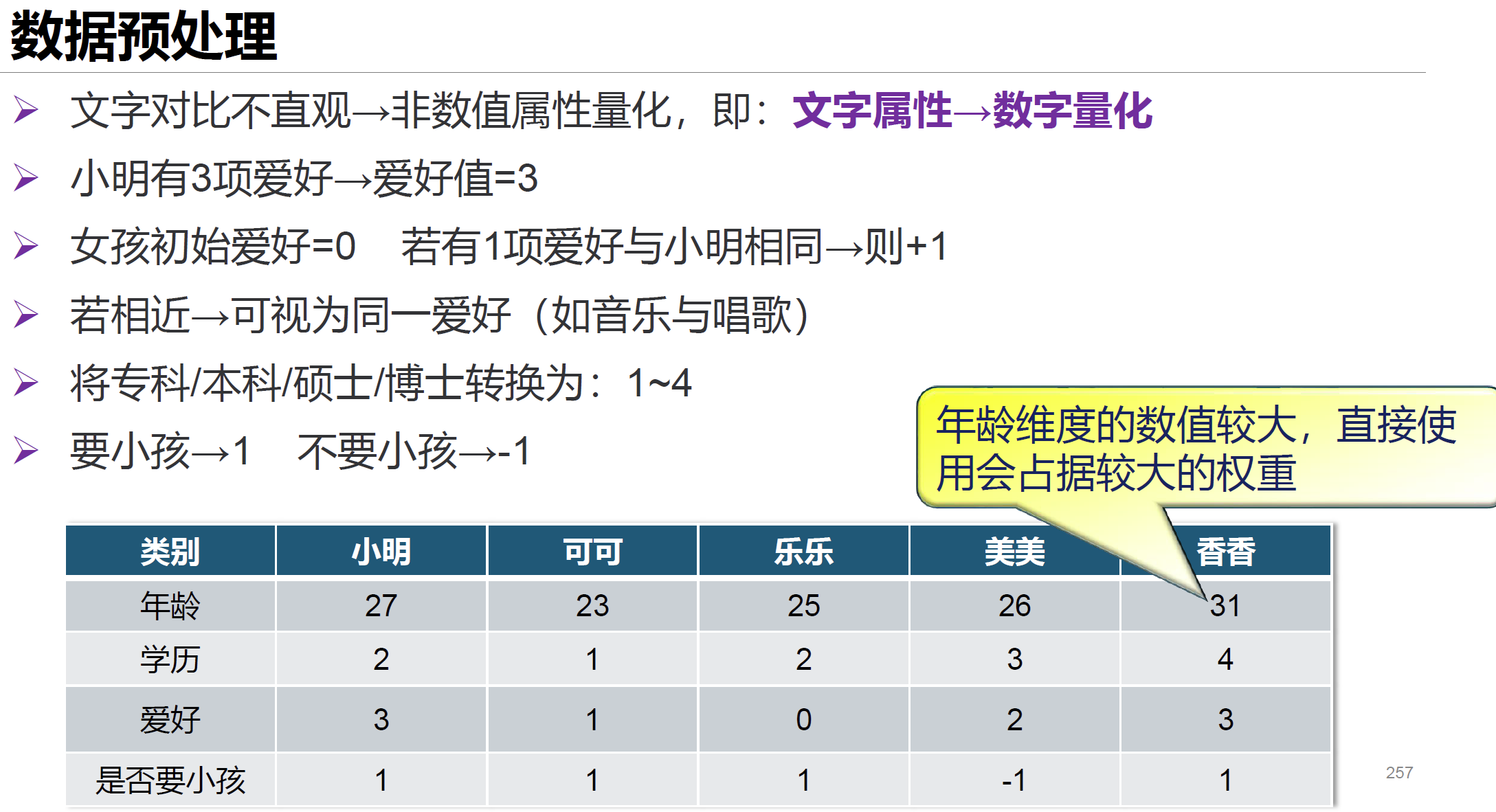

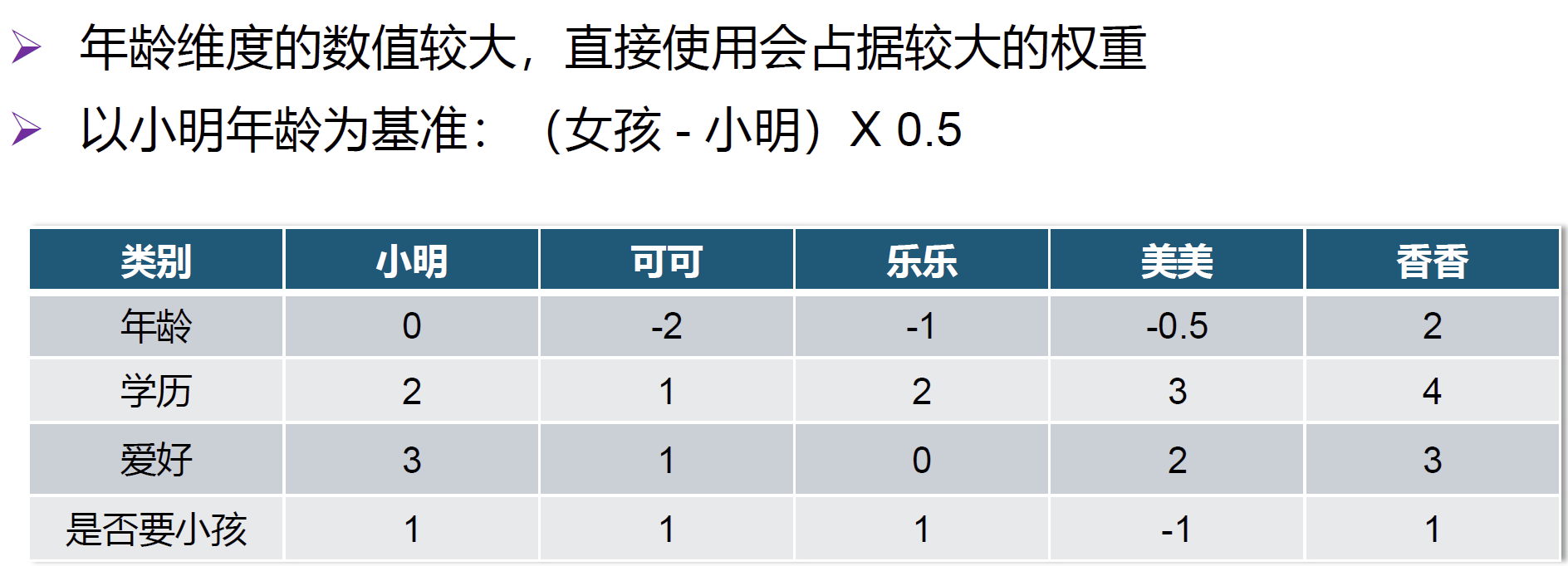

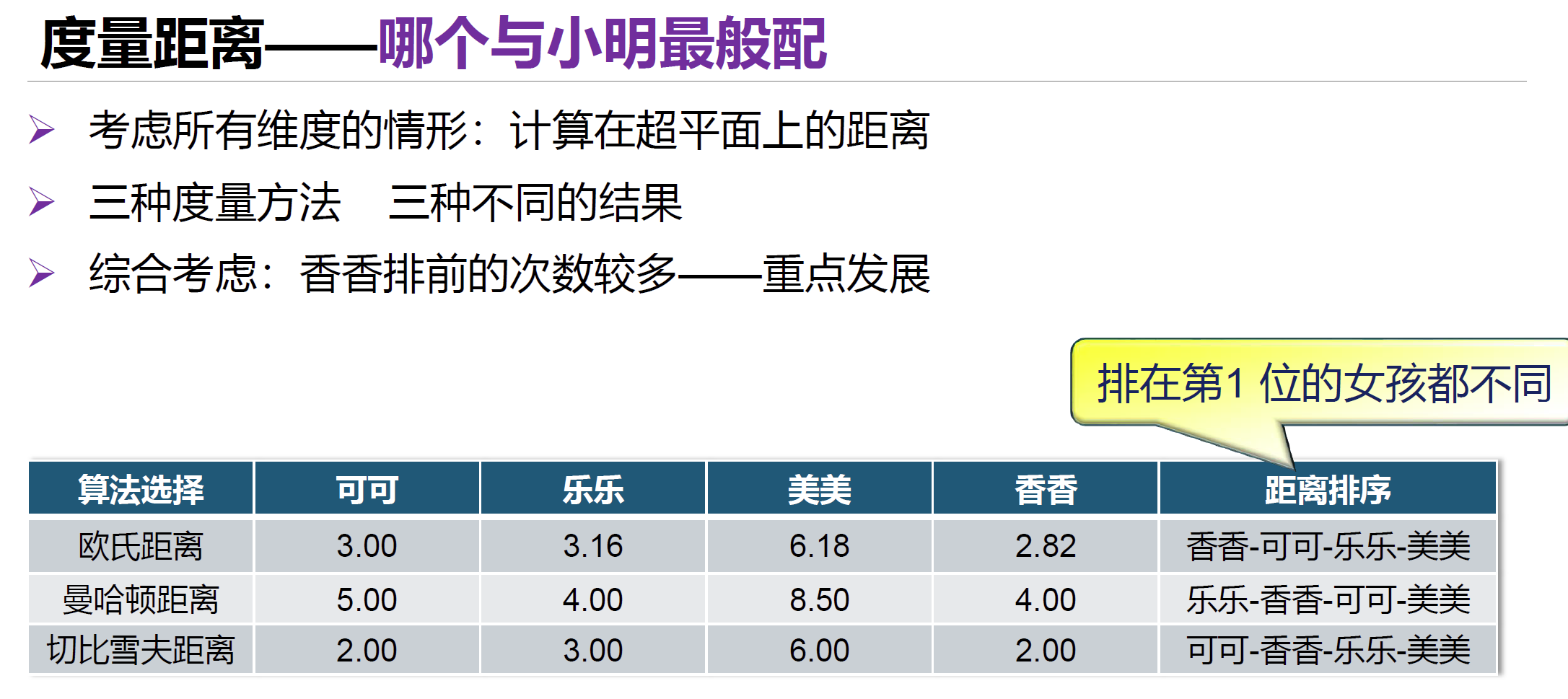

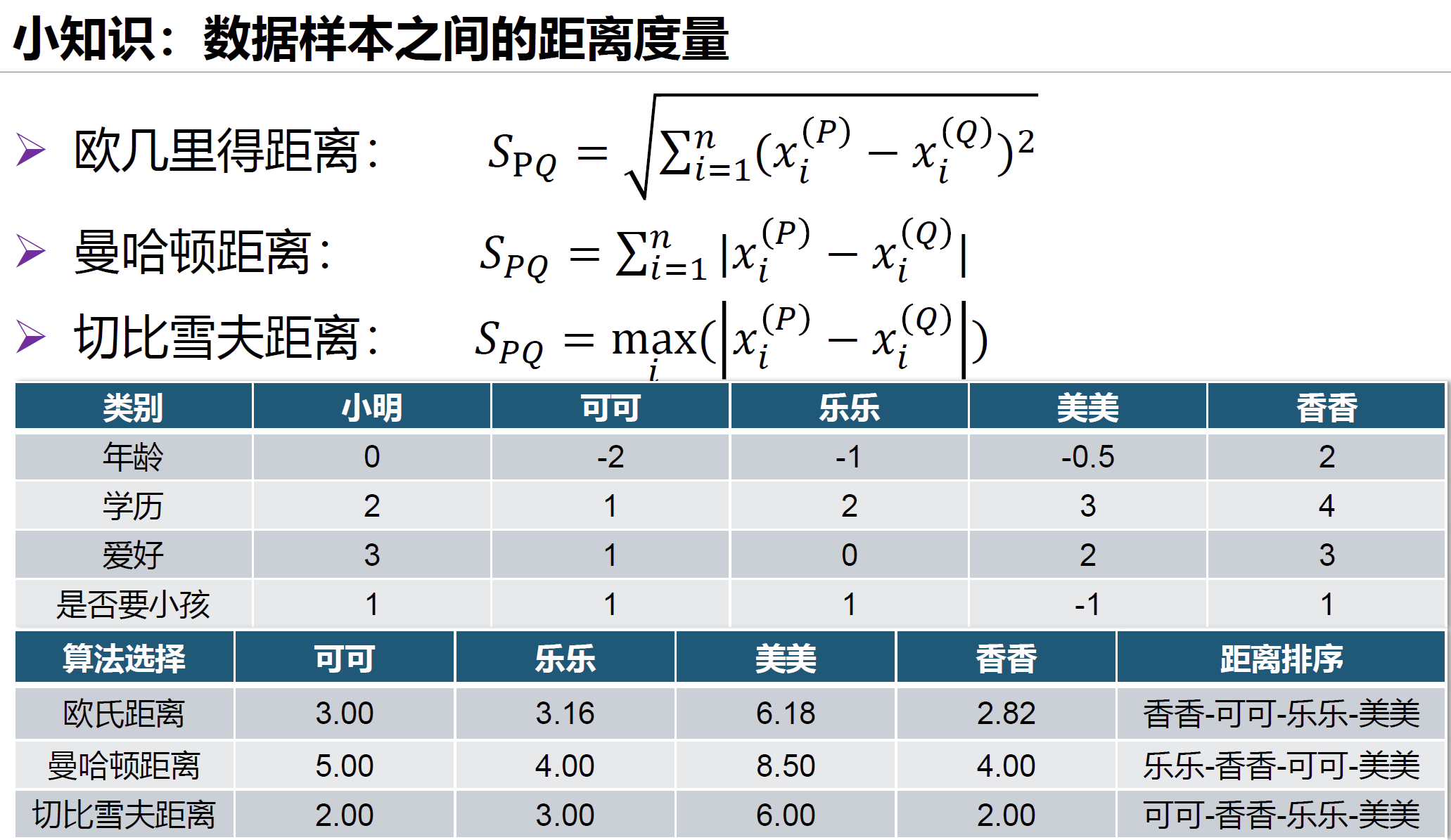

数据预处理

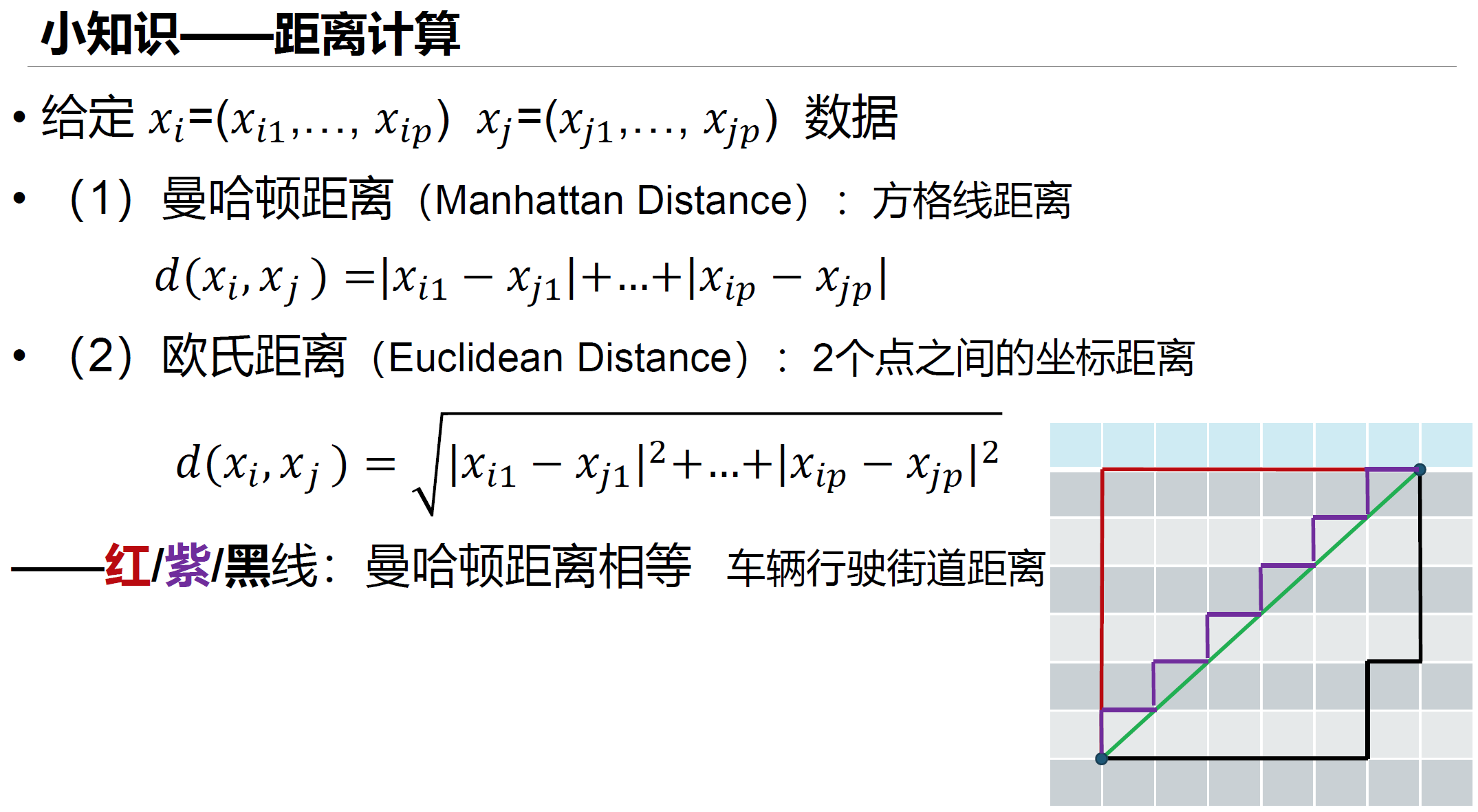

距离度量(距离越近的越相似,两人就越好越般配)

妈的,有演员!别的人的计算没什么问题,但是美美的计算全部出错,应该为2.5、4.5、2才对,这样下来美美才是最佳人选!吐了啊。

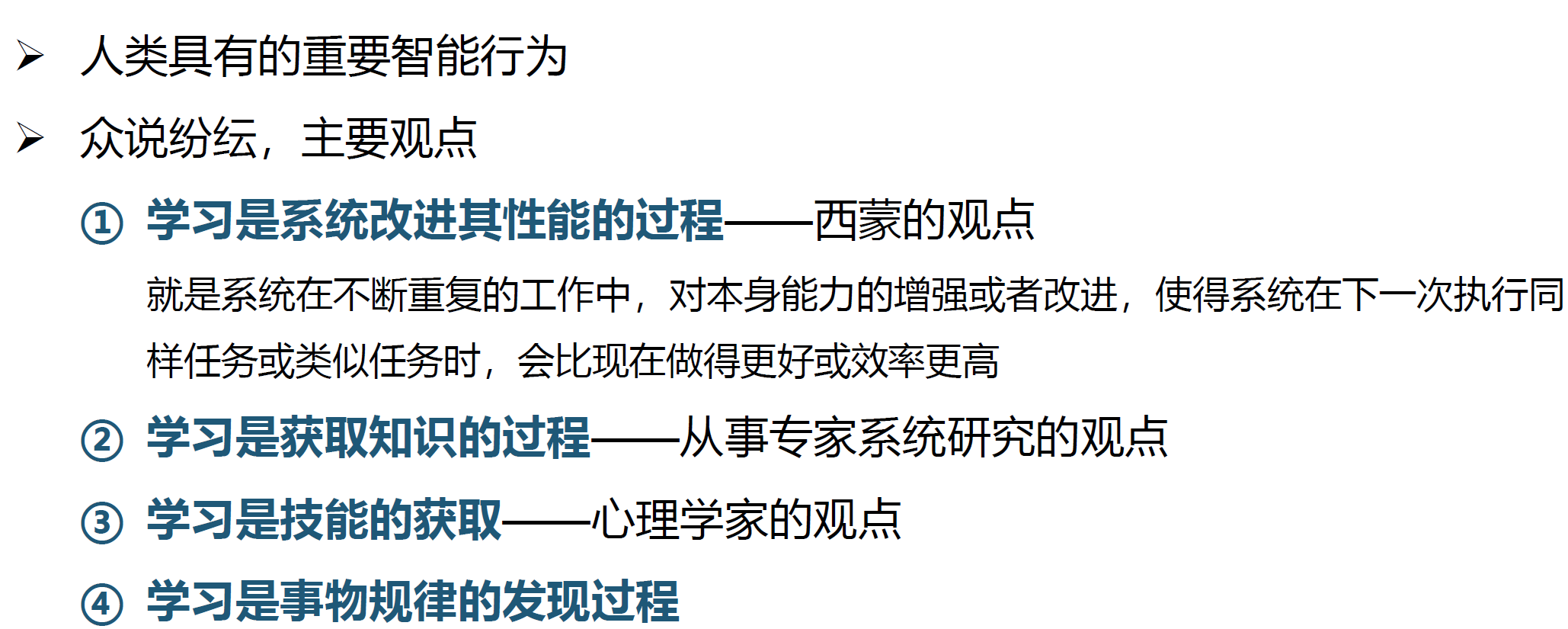

什么是学习?

什么是机器学习?

无公认的统一定义,一般认为: 研究如何使用机器来模拟人类学习活动。

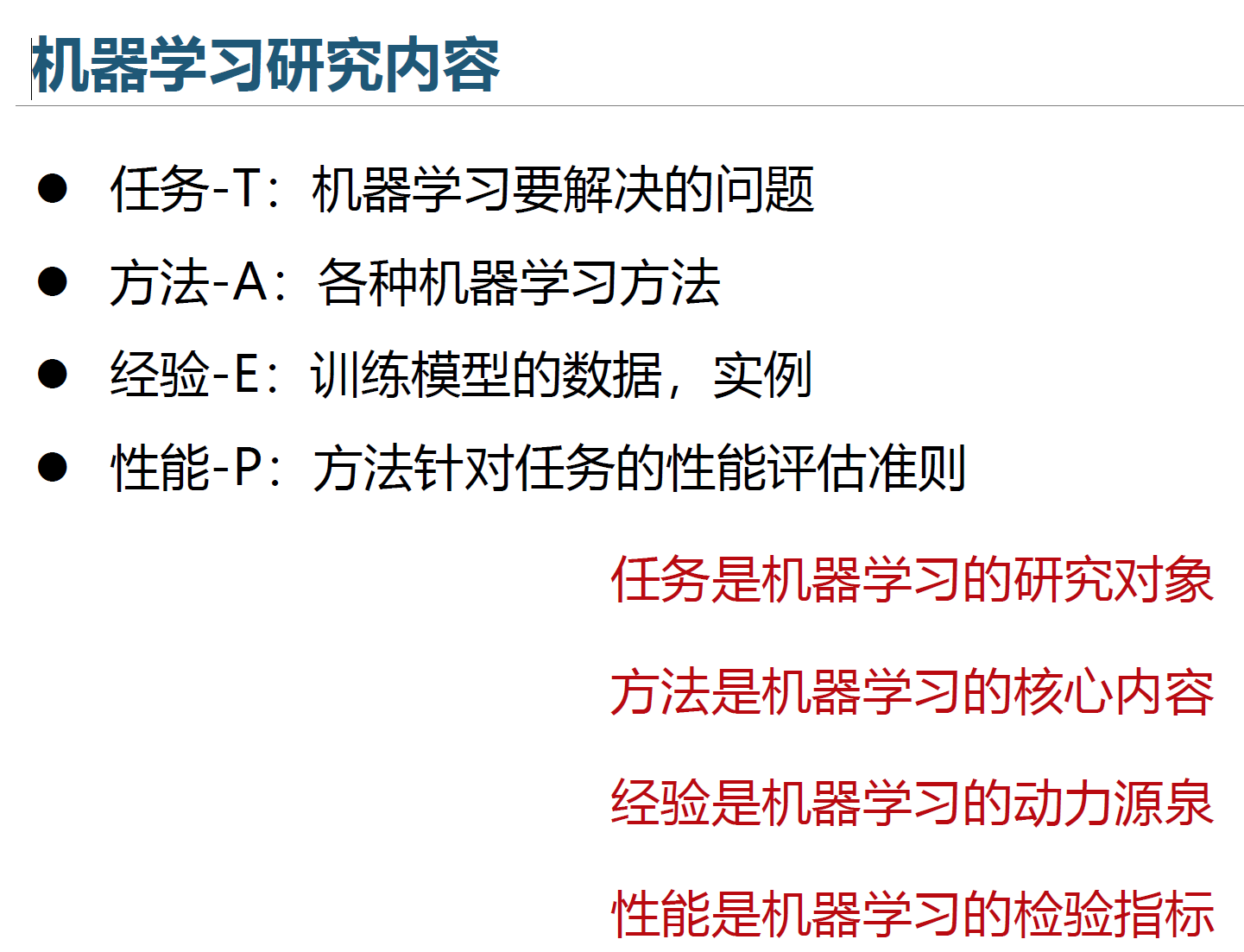

机器学习研究内容

例如:

机器学习的基本过程:

计算机从给定的数据中学习规律,即从观测数据(样本)中寻找规律、建立模型,并利用学习到的规律(模型)对未知或无法观测的数据进行预测。

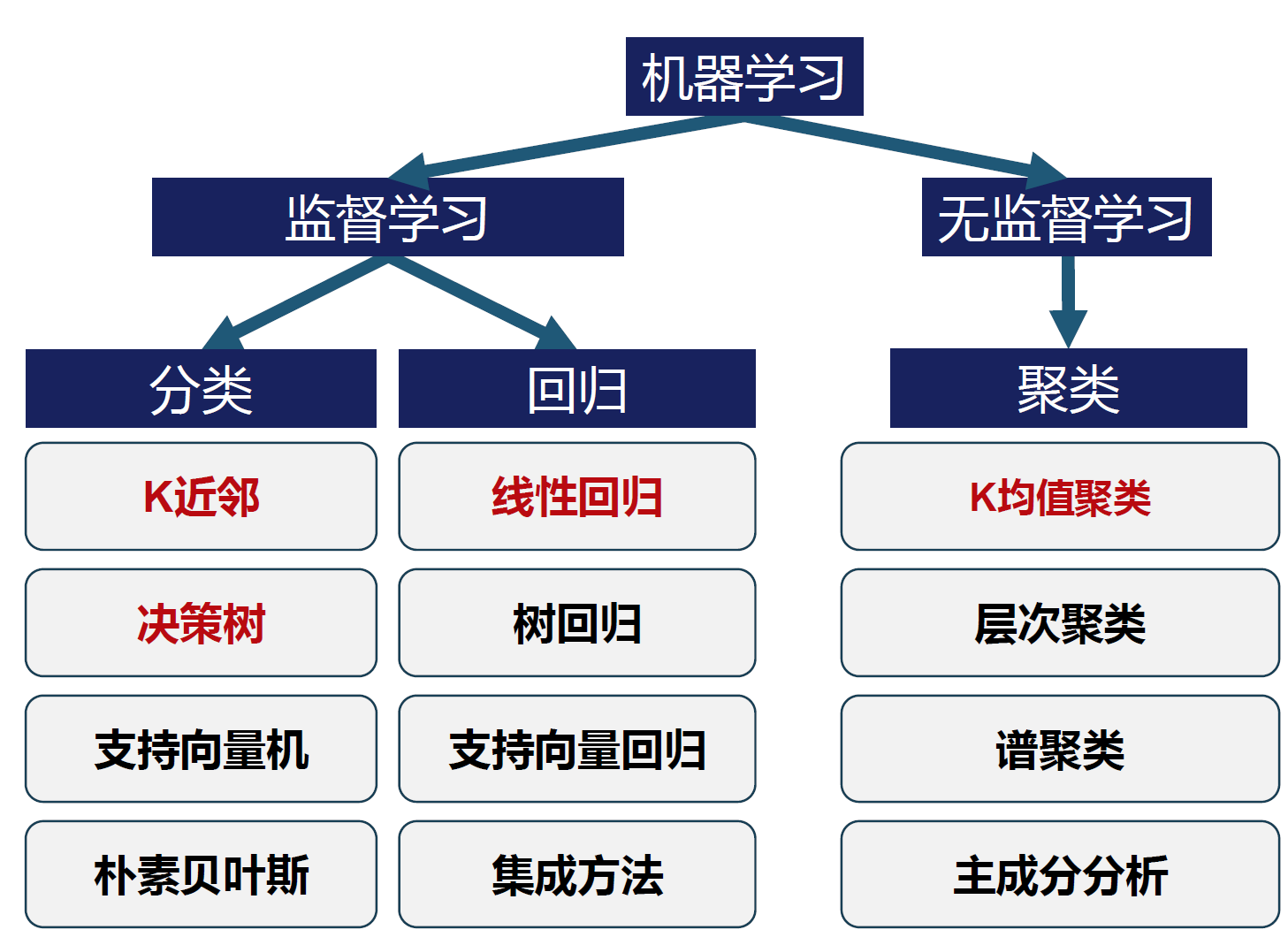

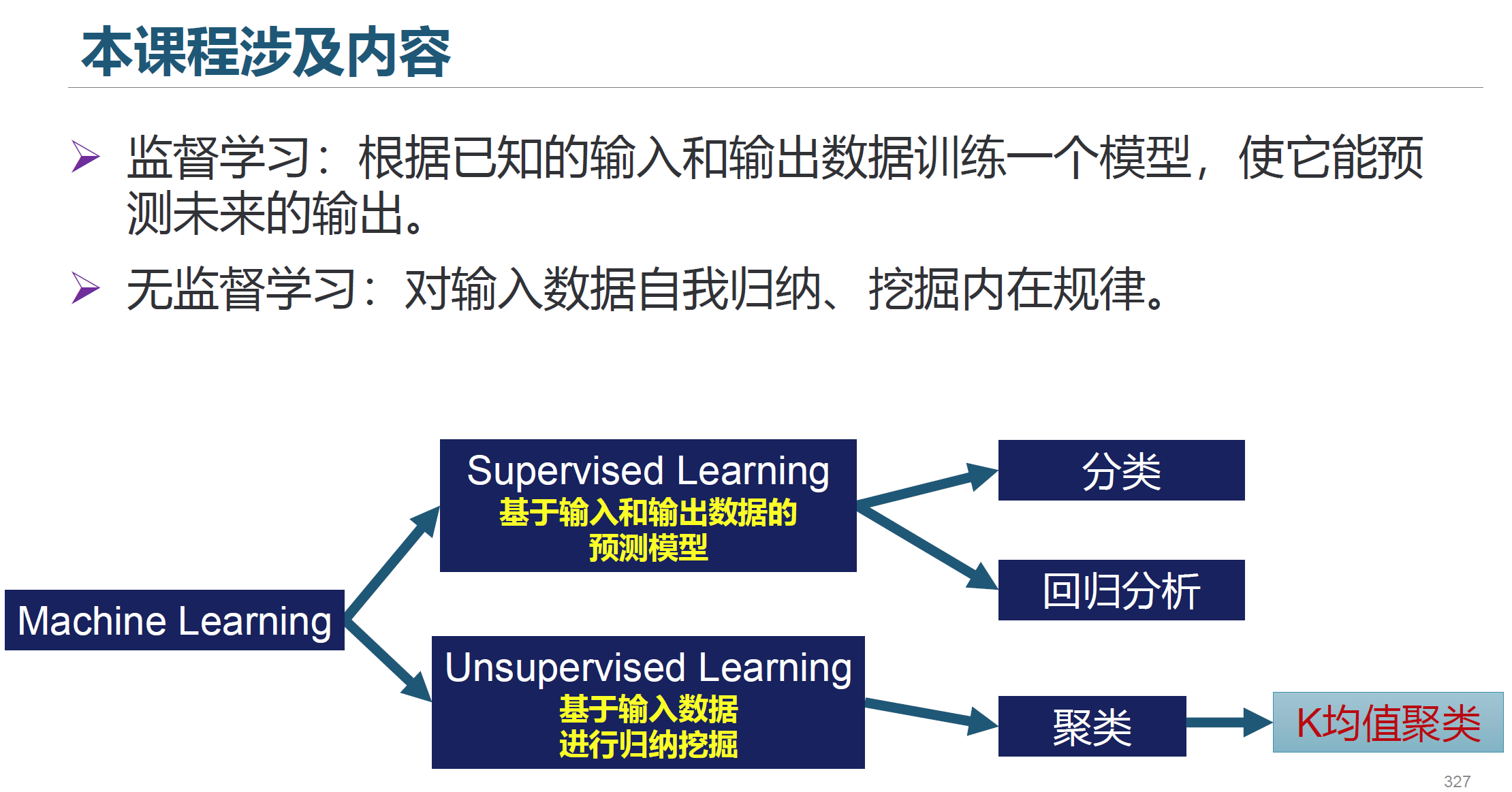

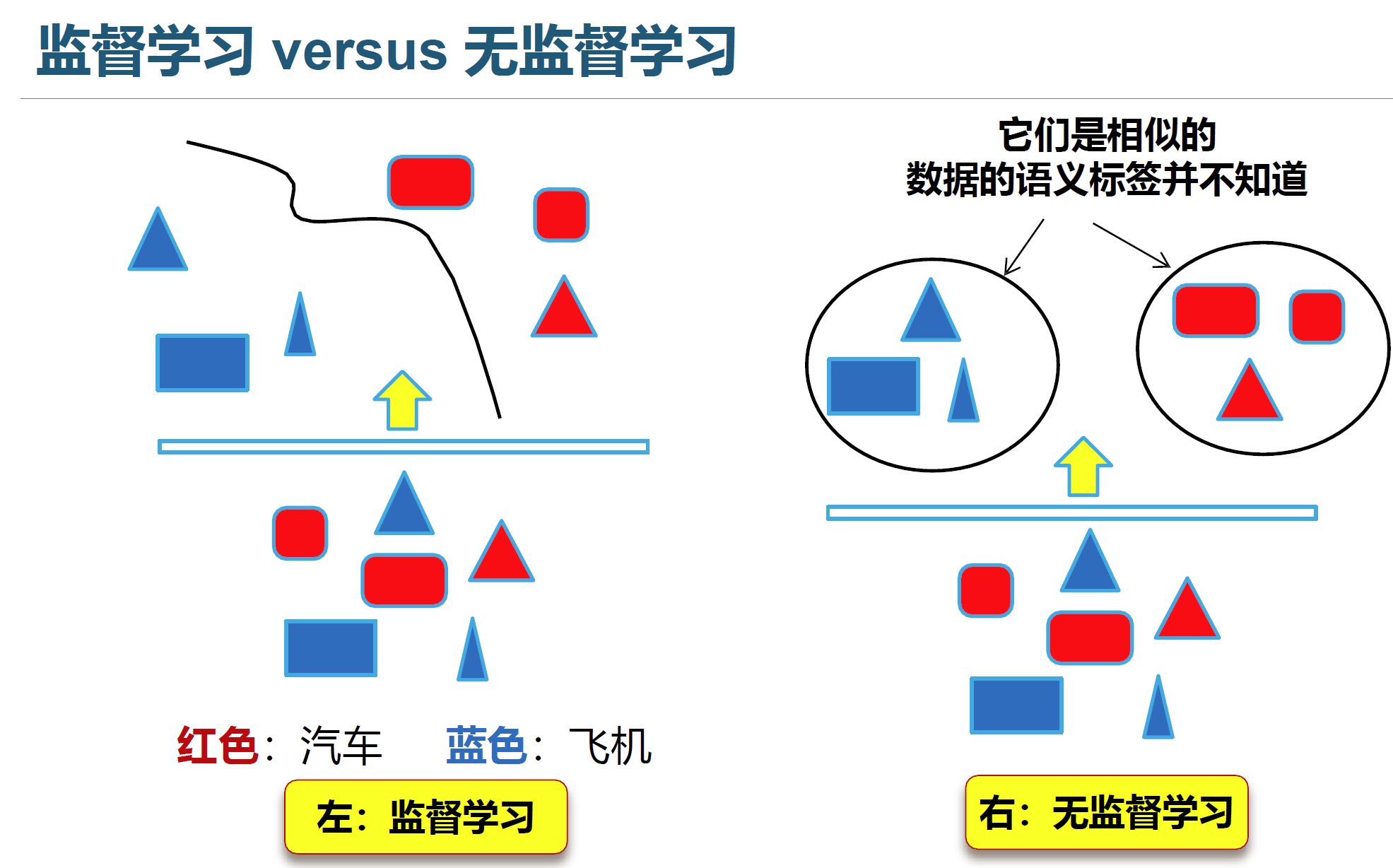

机器学习的分类

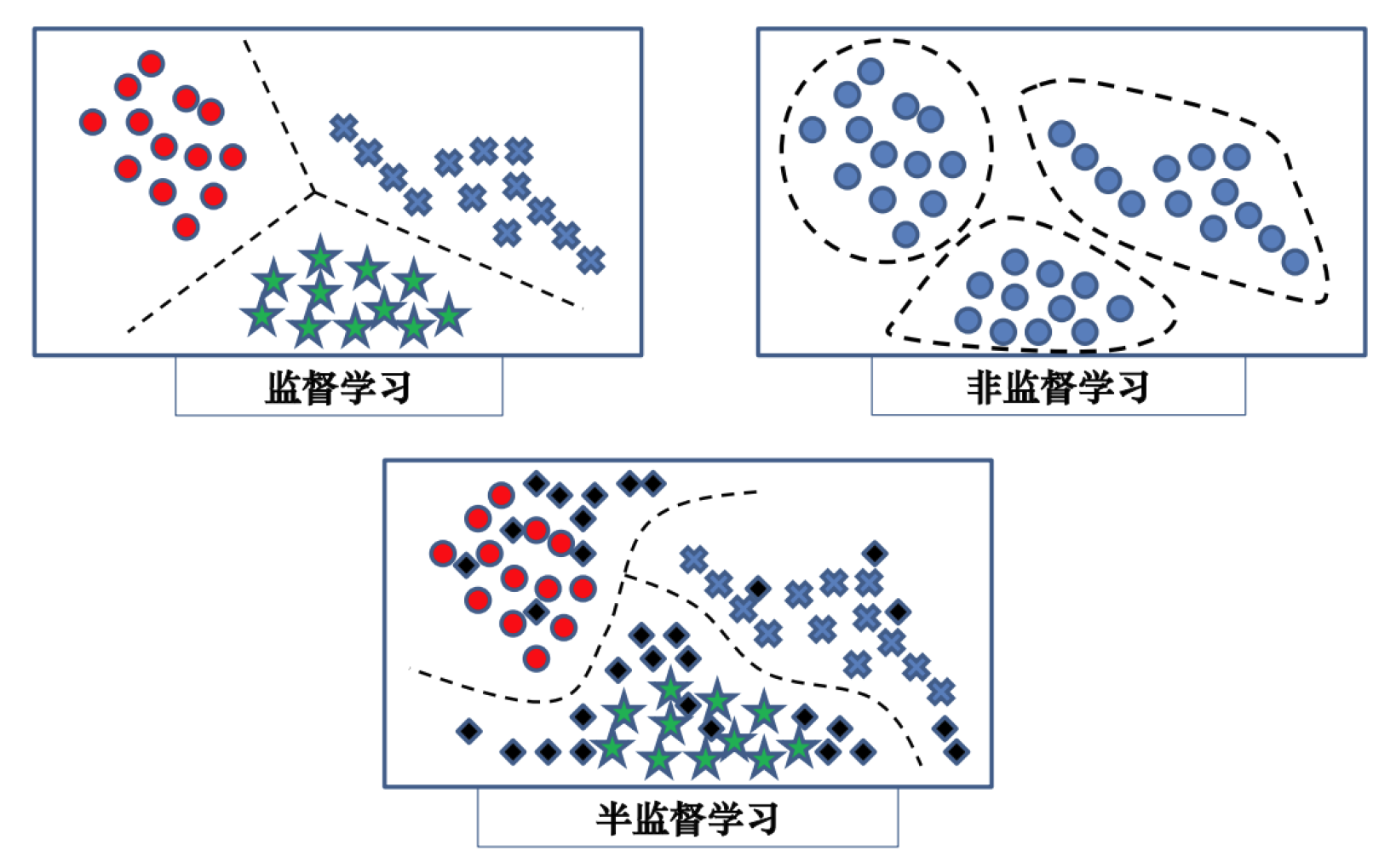

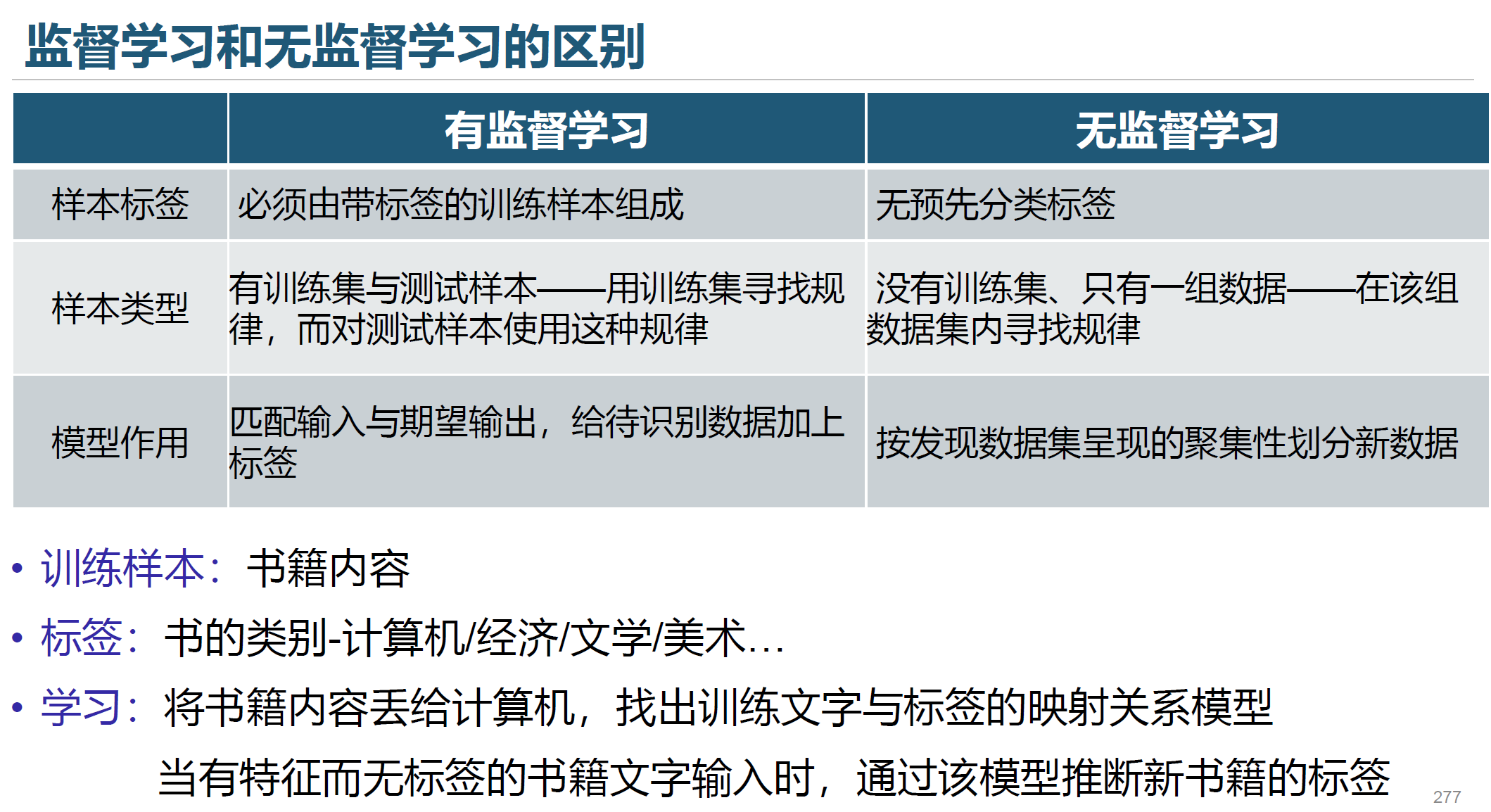

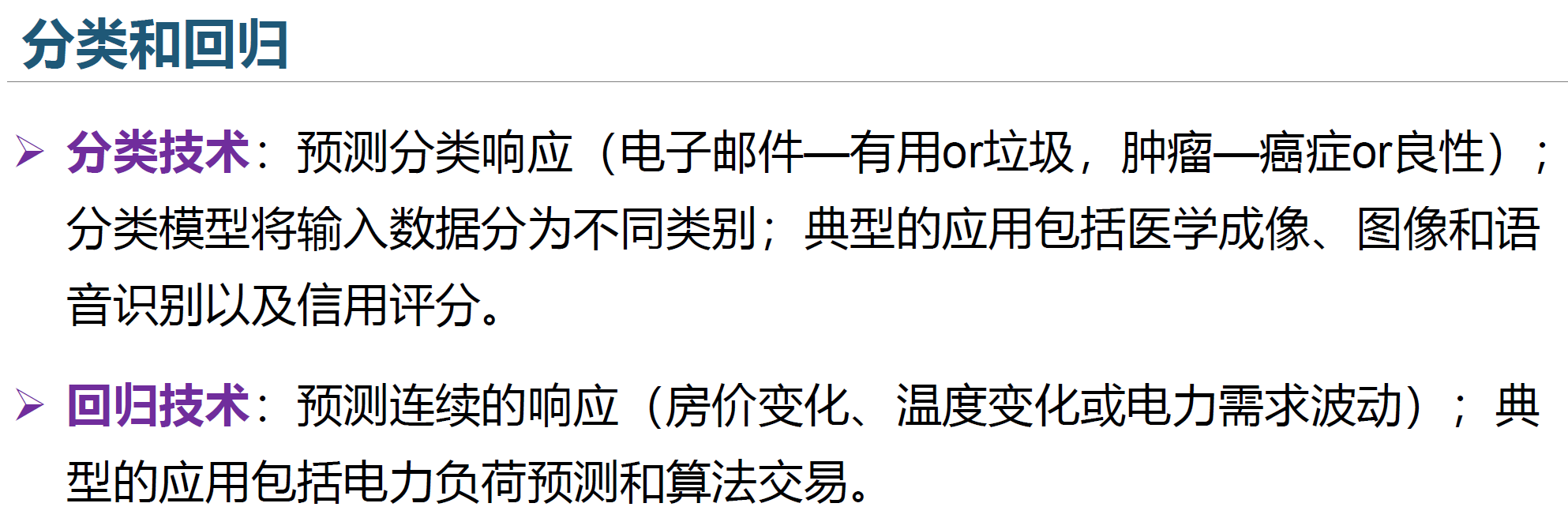

①监督学习 (supervised learning)

数据都有明确的标签,根据机器学习产生的模型可以将新数据分到一个明确的类或得到一个预测值;

一般为回归或分类等任务。

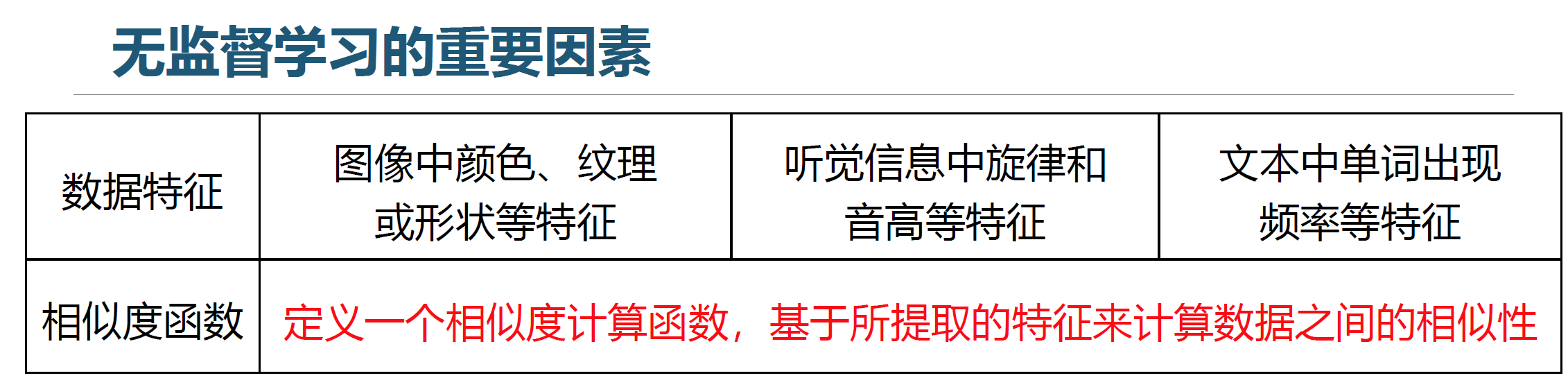

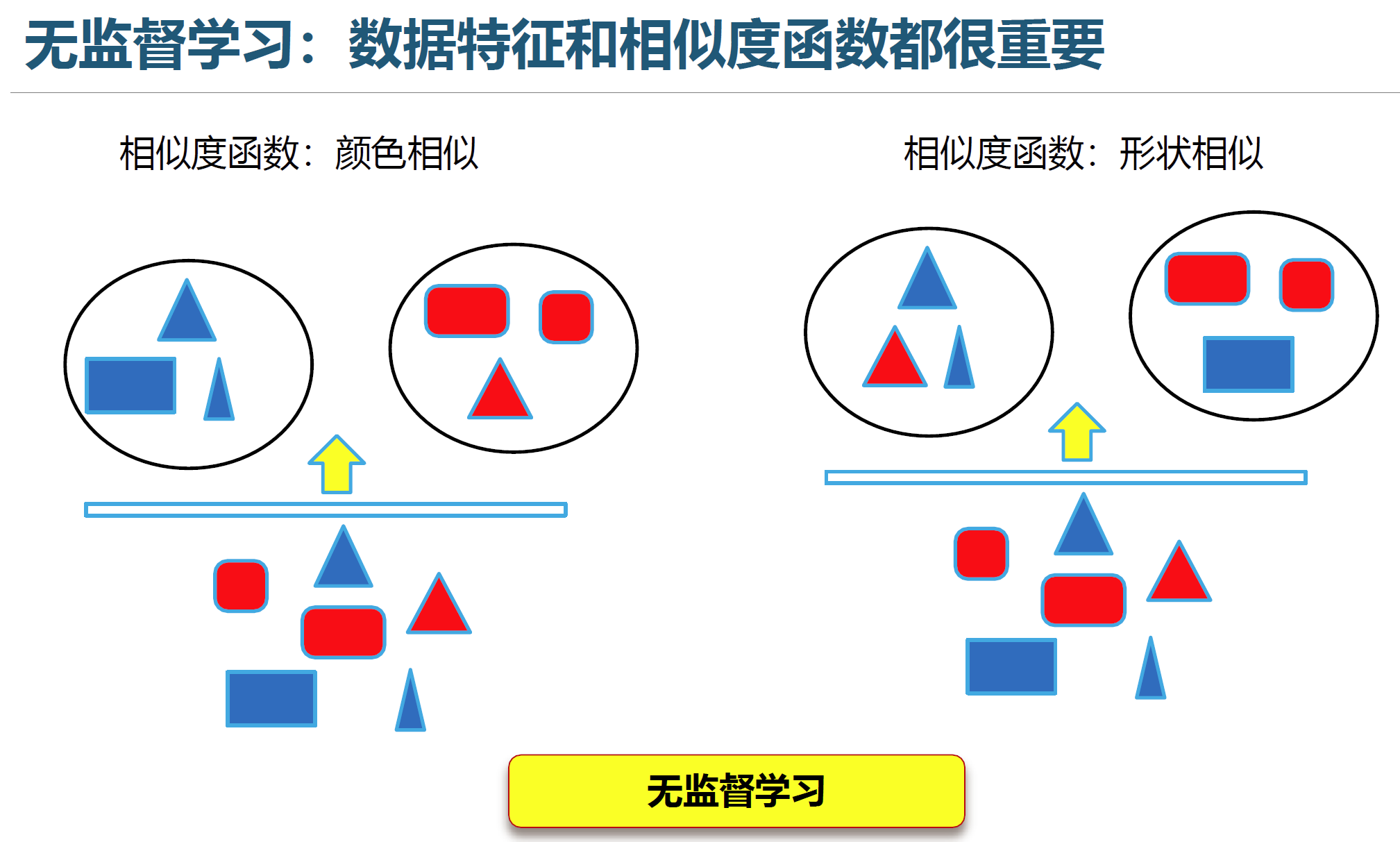

②无监督学习 (unsupervised leaning)

数据没有标签,机器学习出的模型是从数据中提取出来的模式(提取决定性特征或者聚类等);

一般为聚类或若干降维任务。

③半监督学习(semi-supervised learning)

部分数据有标签,机器学习出的模型是从数据中提取出来的模式(提取决定性特征或者聚类等);

一般是分类或回归等任务。

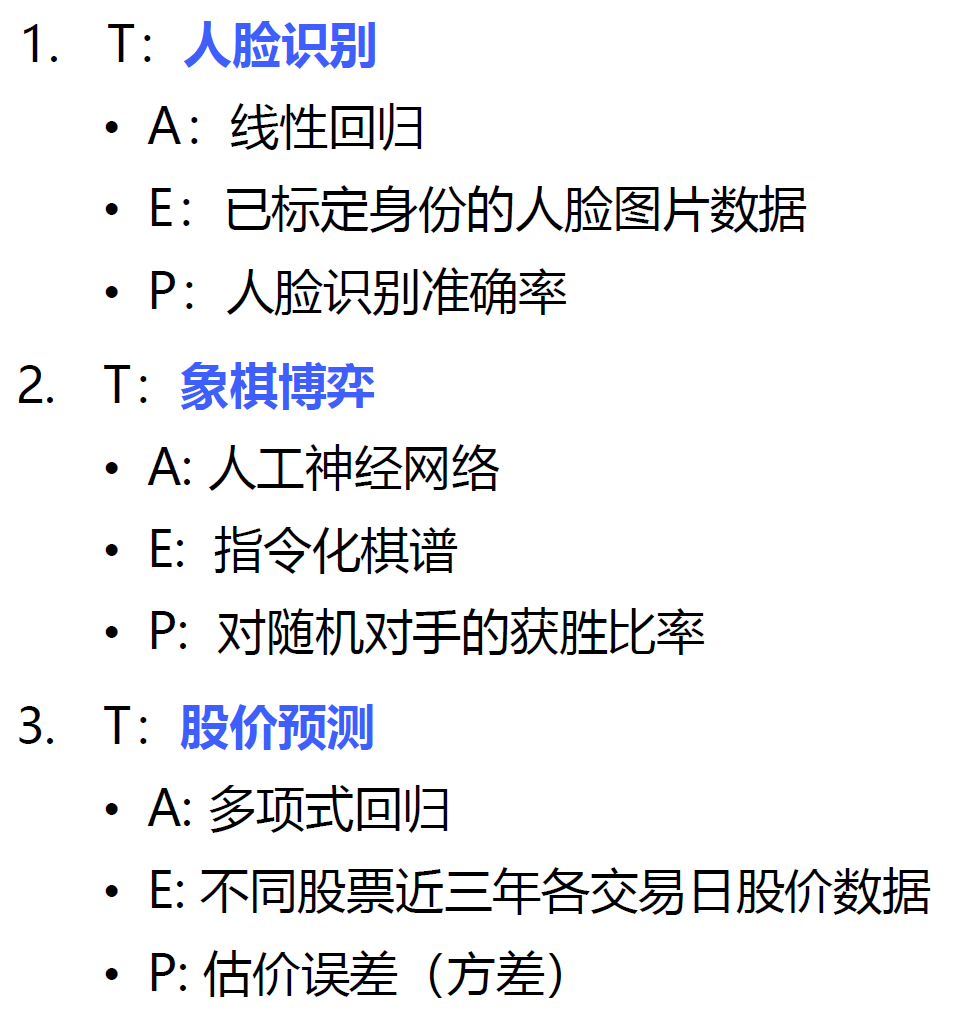

④强化学习 (reinforcement learning)

外部环境对输入只给出评价信息而非正确答案(标签),学习机通过强化受奖励的动作来改善自身的性能;

常见的应用场景包括动态系统以及机器人控制等。

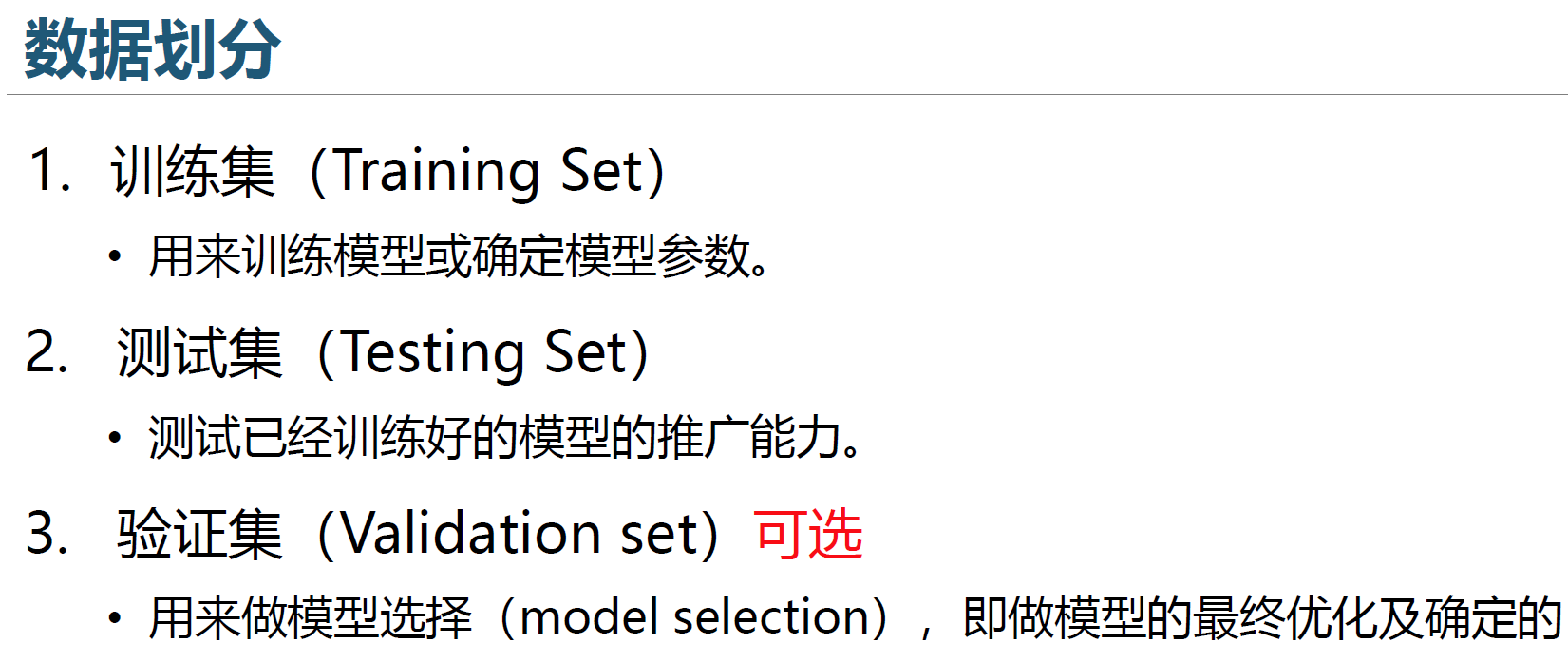

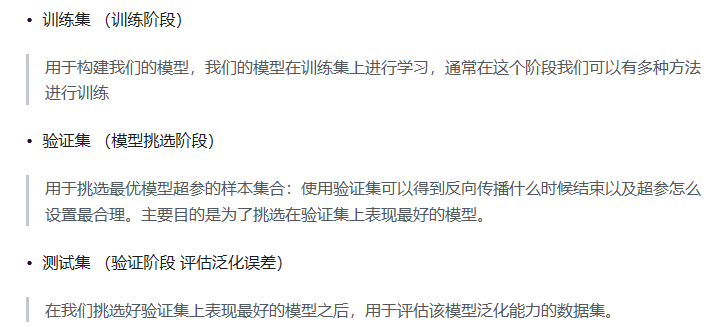

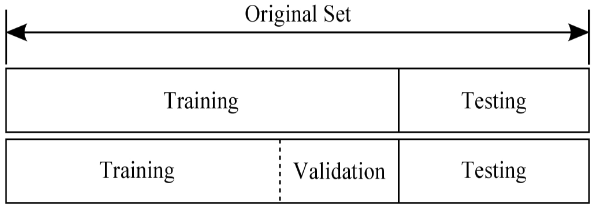

数据划分

验证集和测试集的区别:

在机器学习中,我们不仅需要作模型与模型之间类的比较,对于某一类模型内部,也要不断进行筛选,涉及到模型自身的评估以及超参数的调整,我们就需要从训练集中再次划分出验证集。

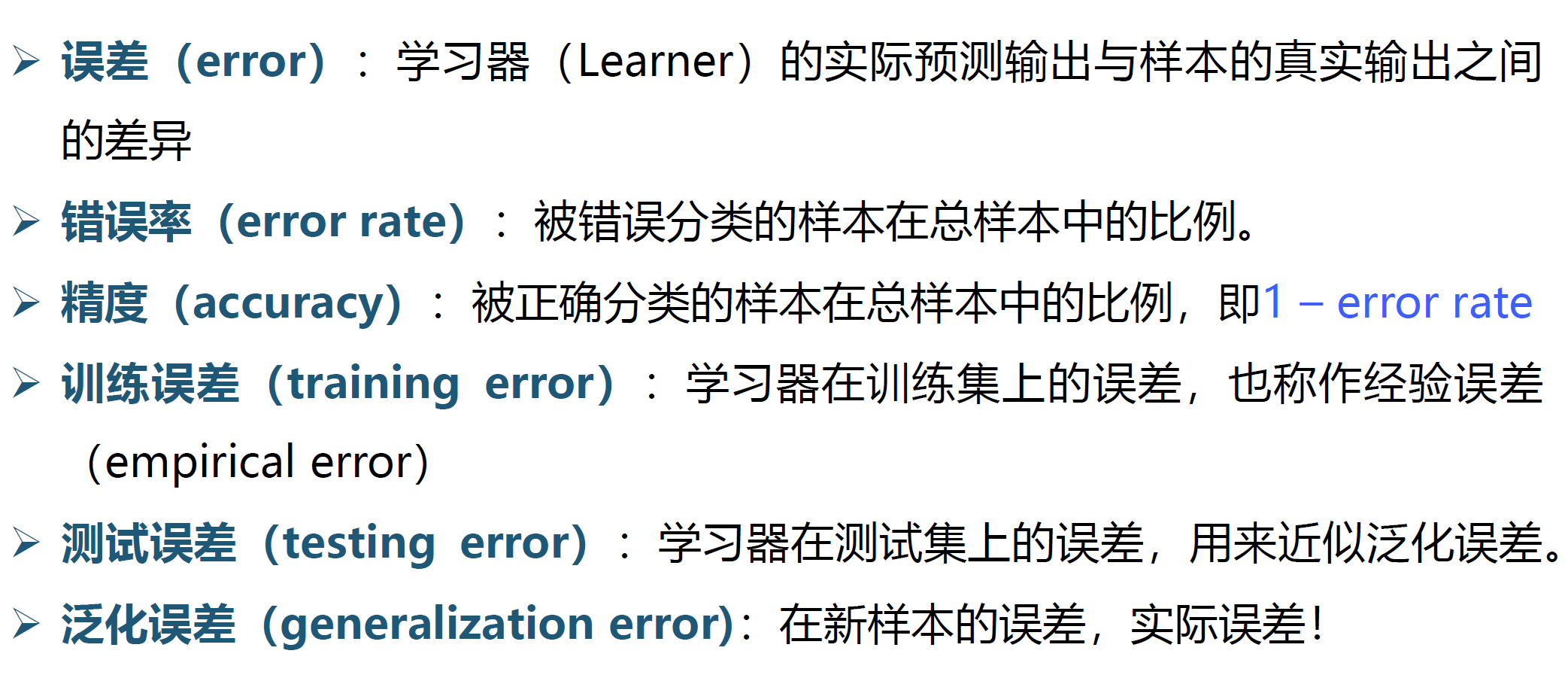

误差与精度

监督学习和无监督学习的区别

监督学习(分类)

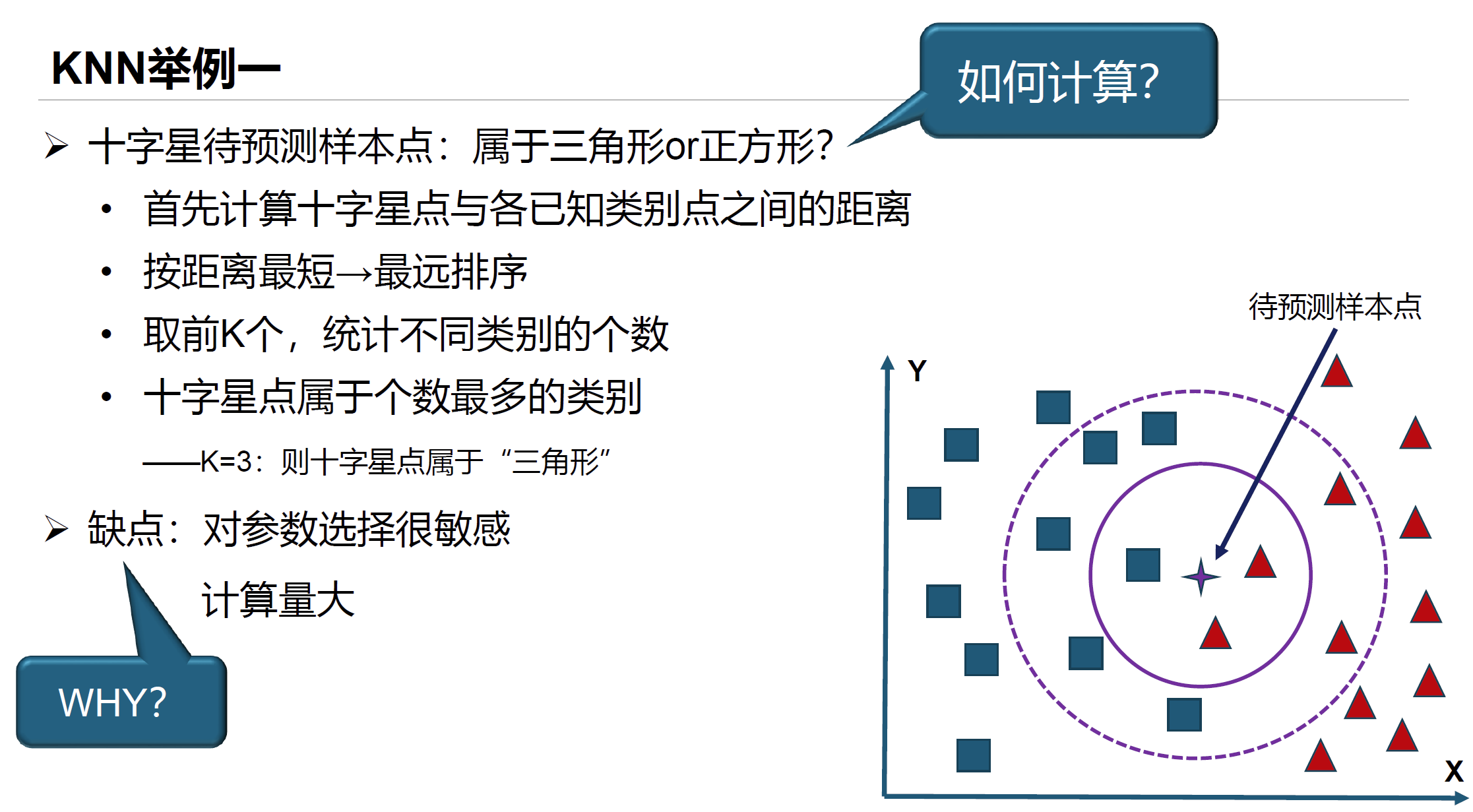

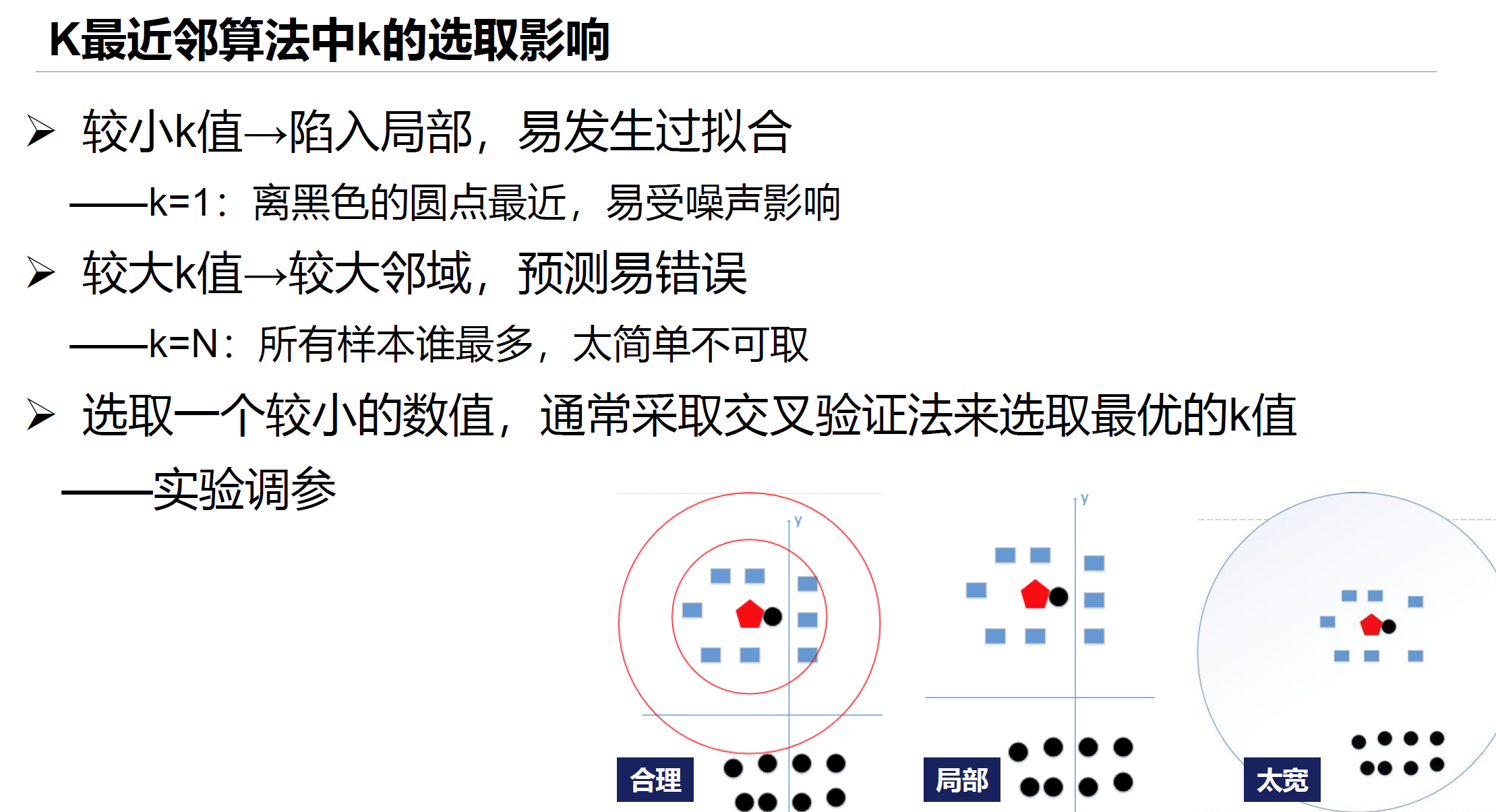

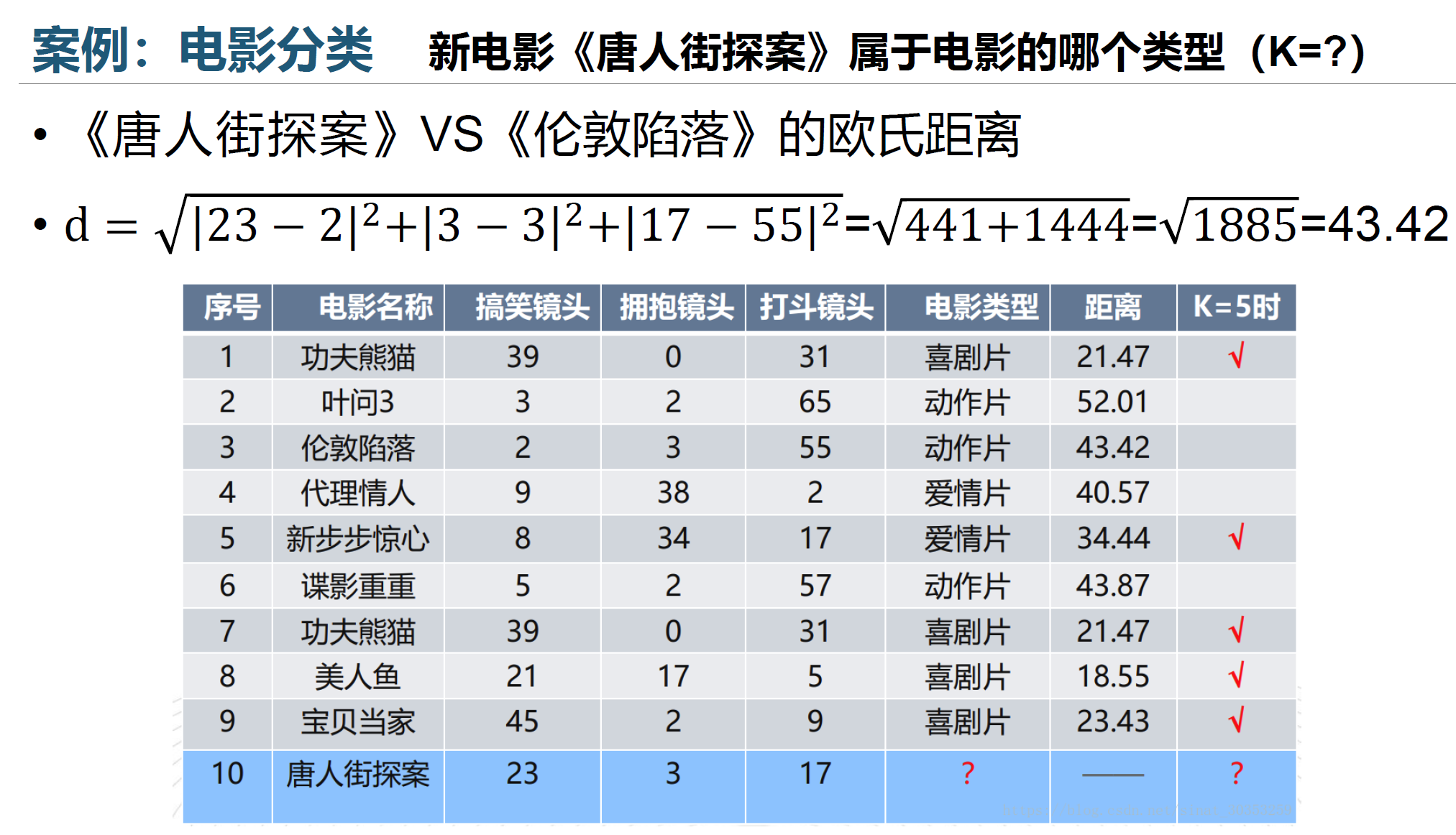

K最近邻算法(KNN)

定义:

举例

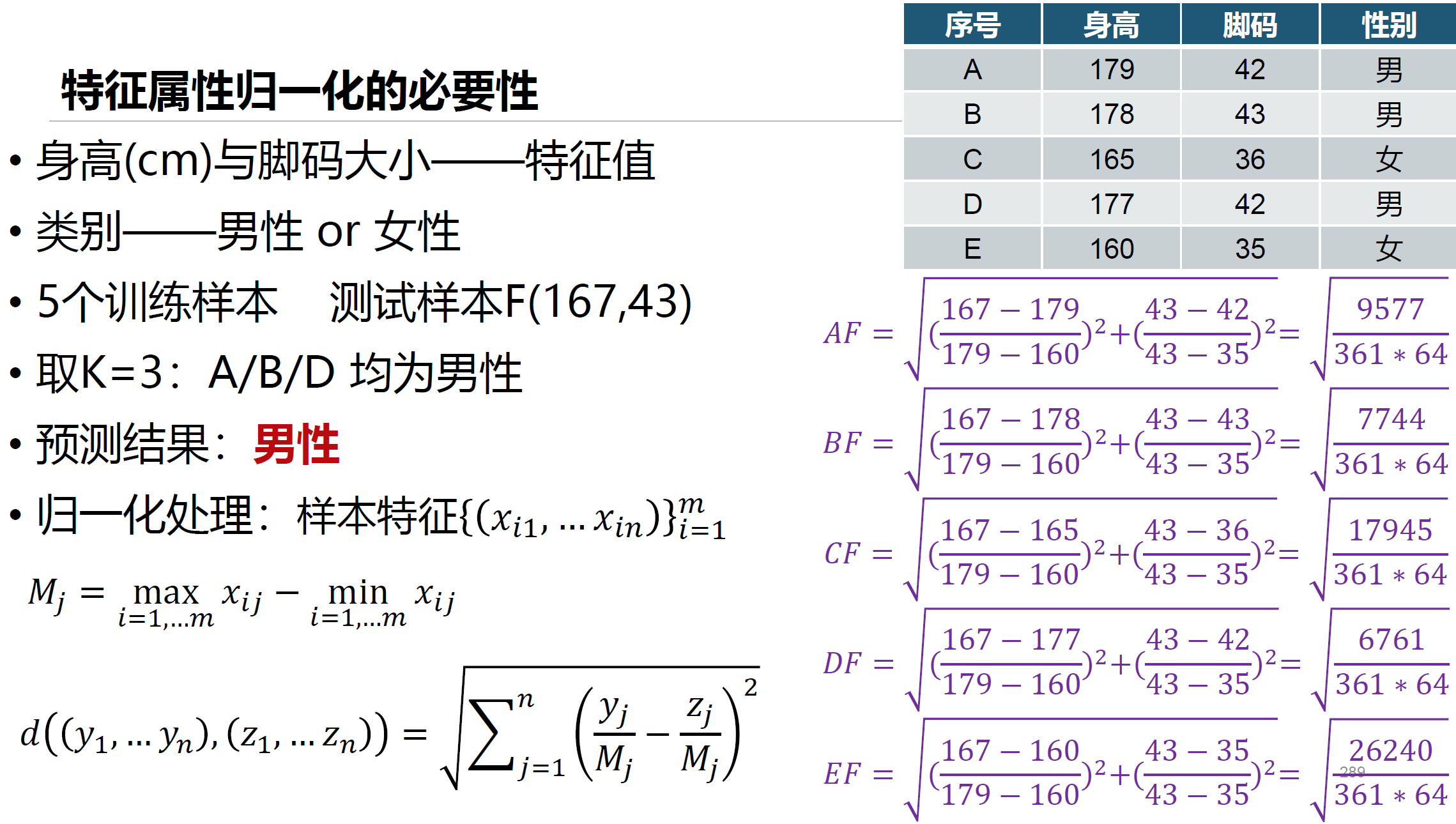

特征属性归一化的必要性

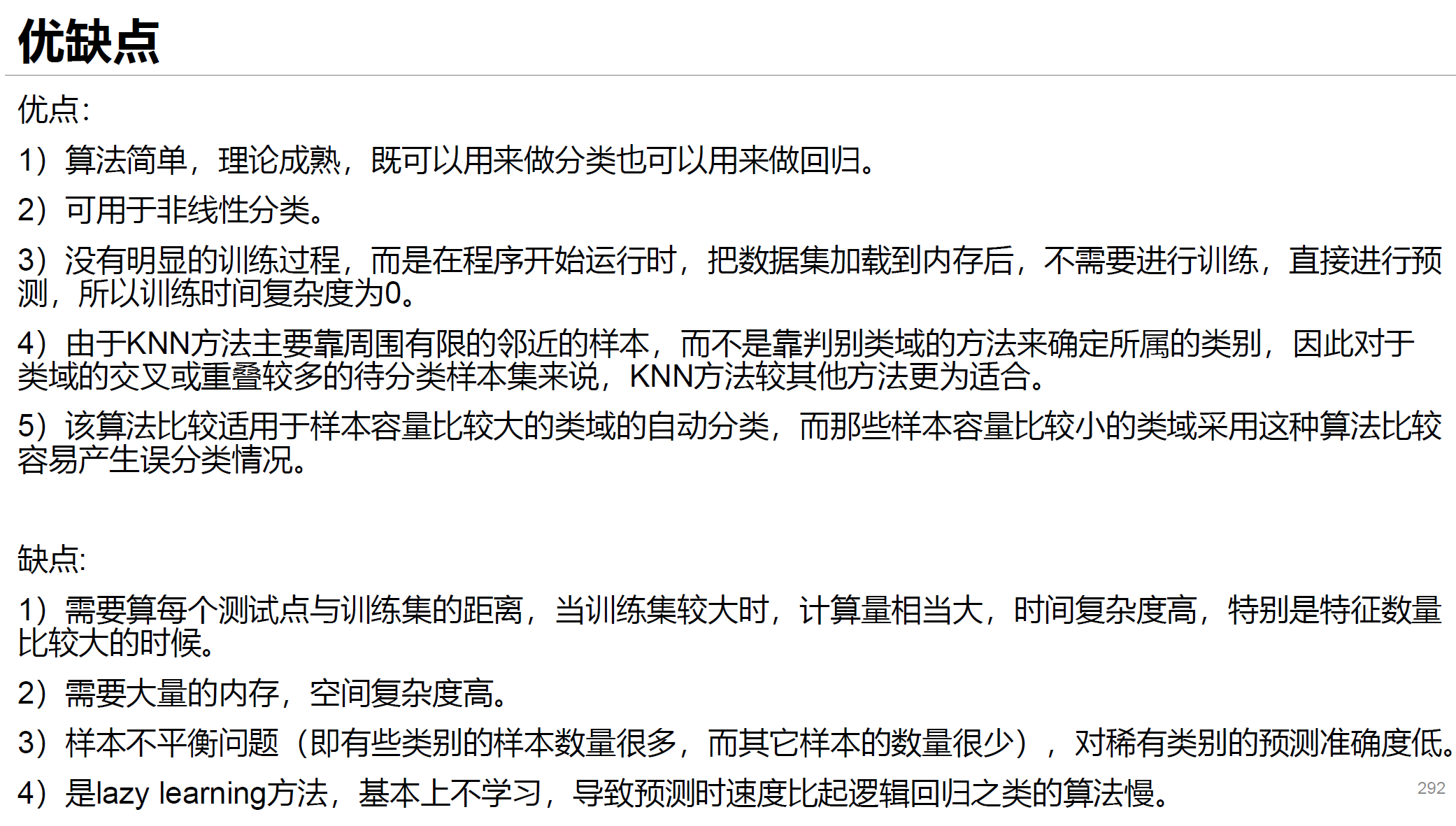

优缺点

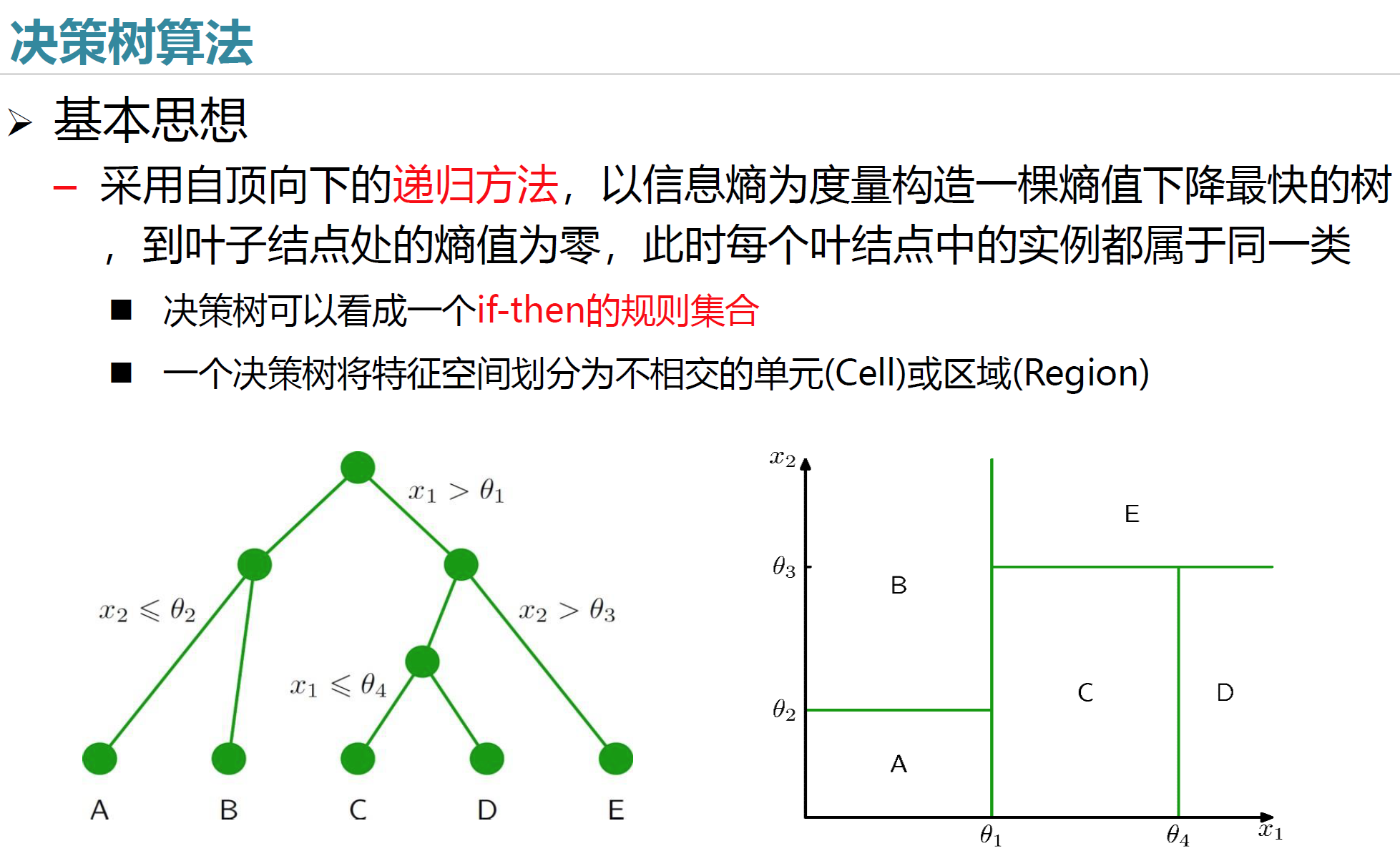

决策树 Decision Tree

定义

ID3算法(Iterative Dichotomiser 3 迭代二叉树 3 代)

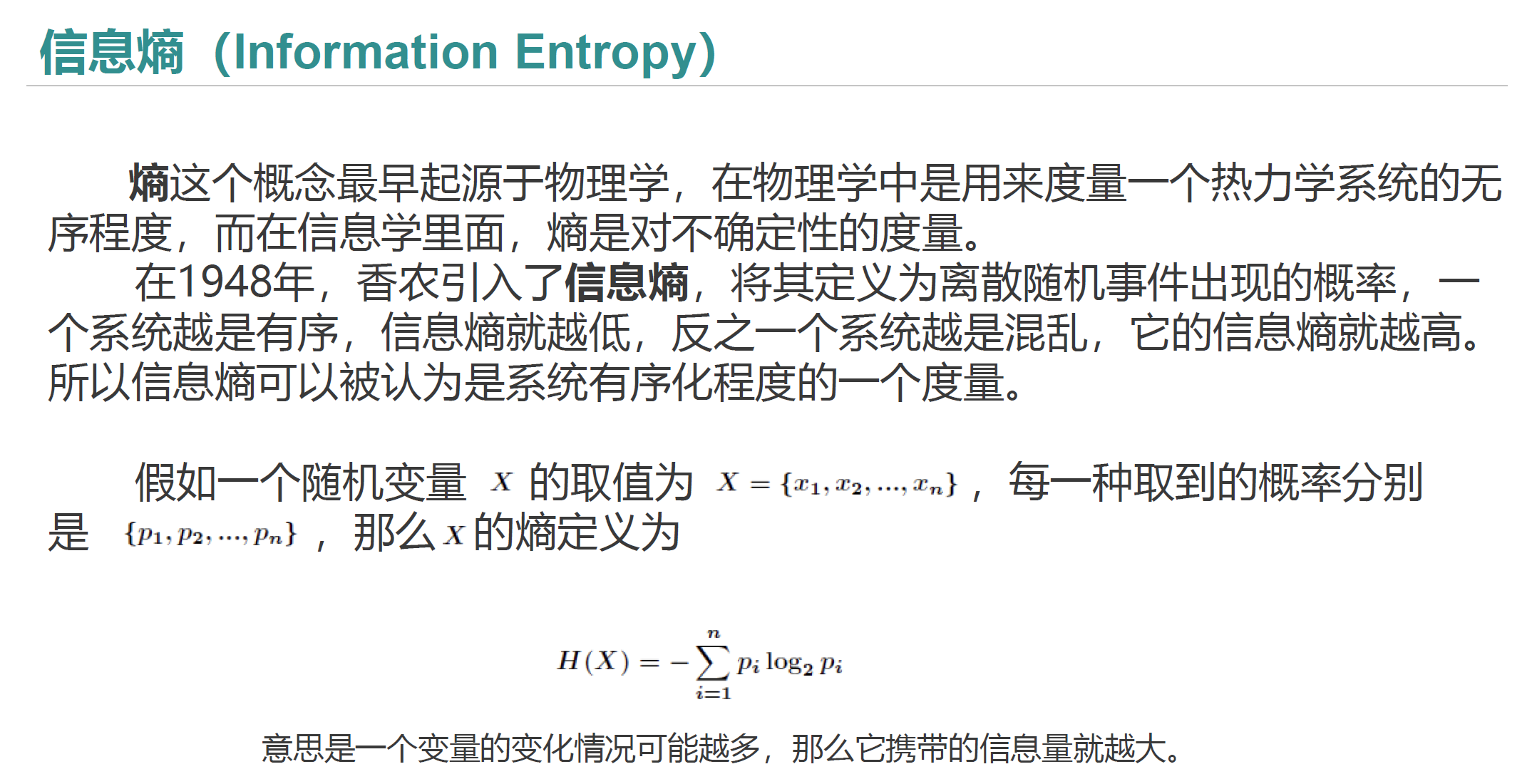

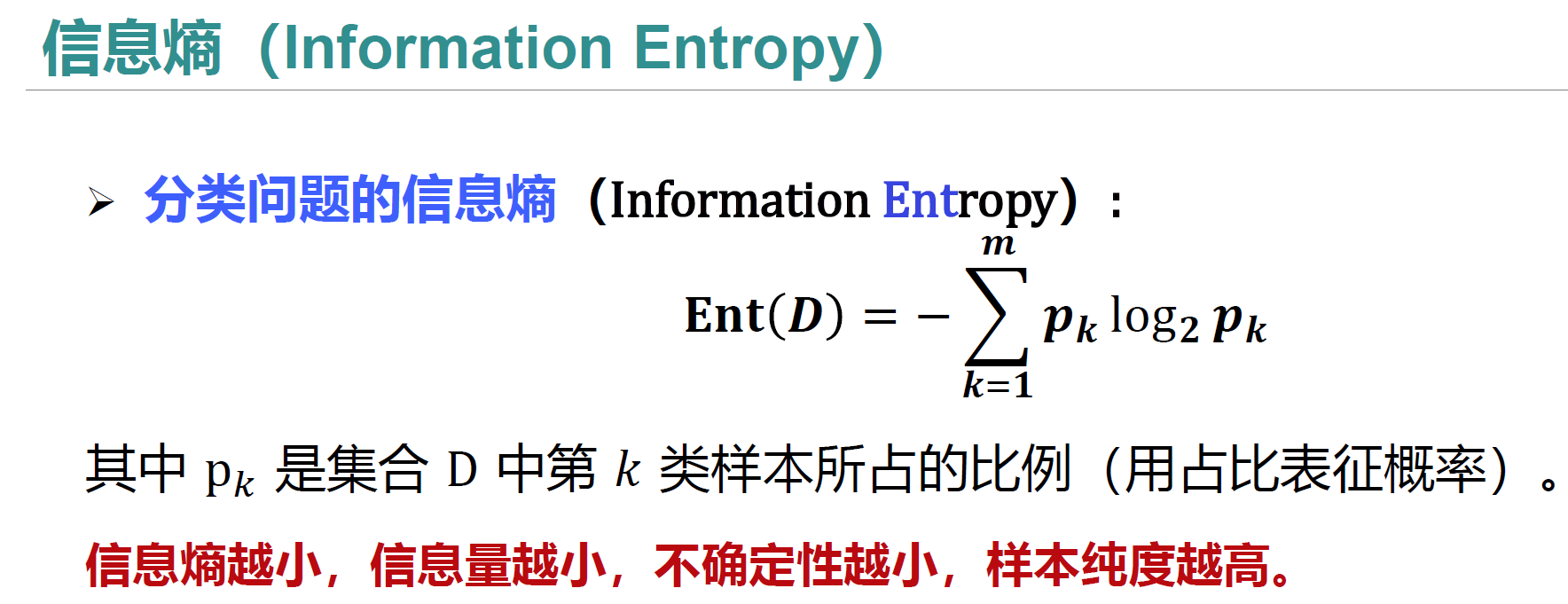

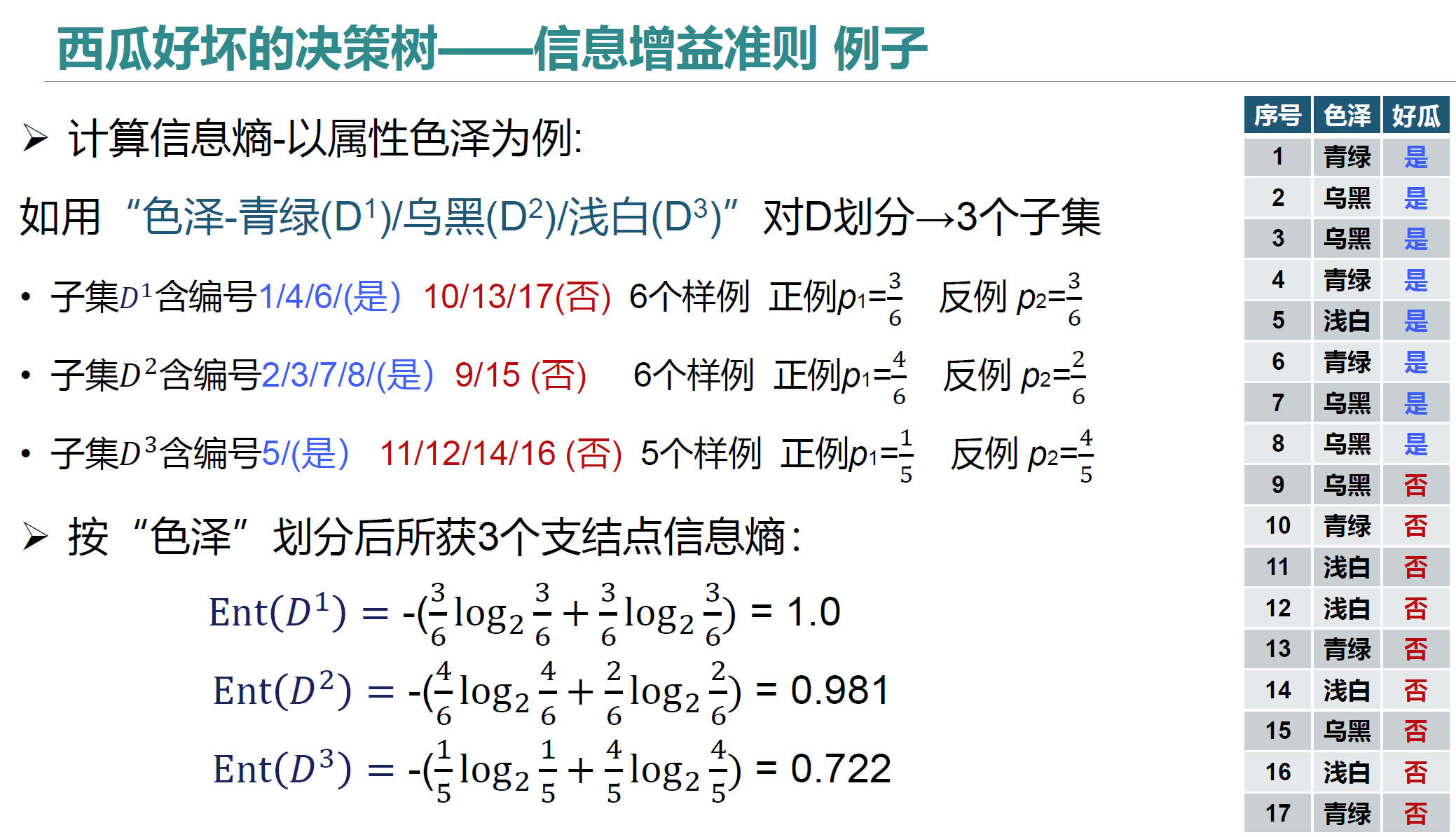

信息熵(Information Entropy)

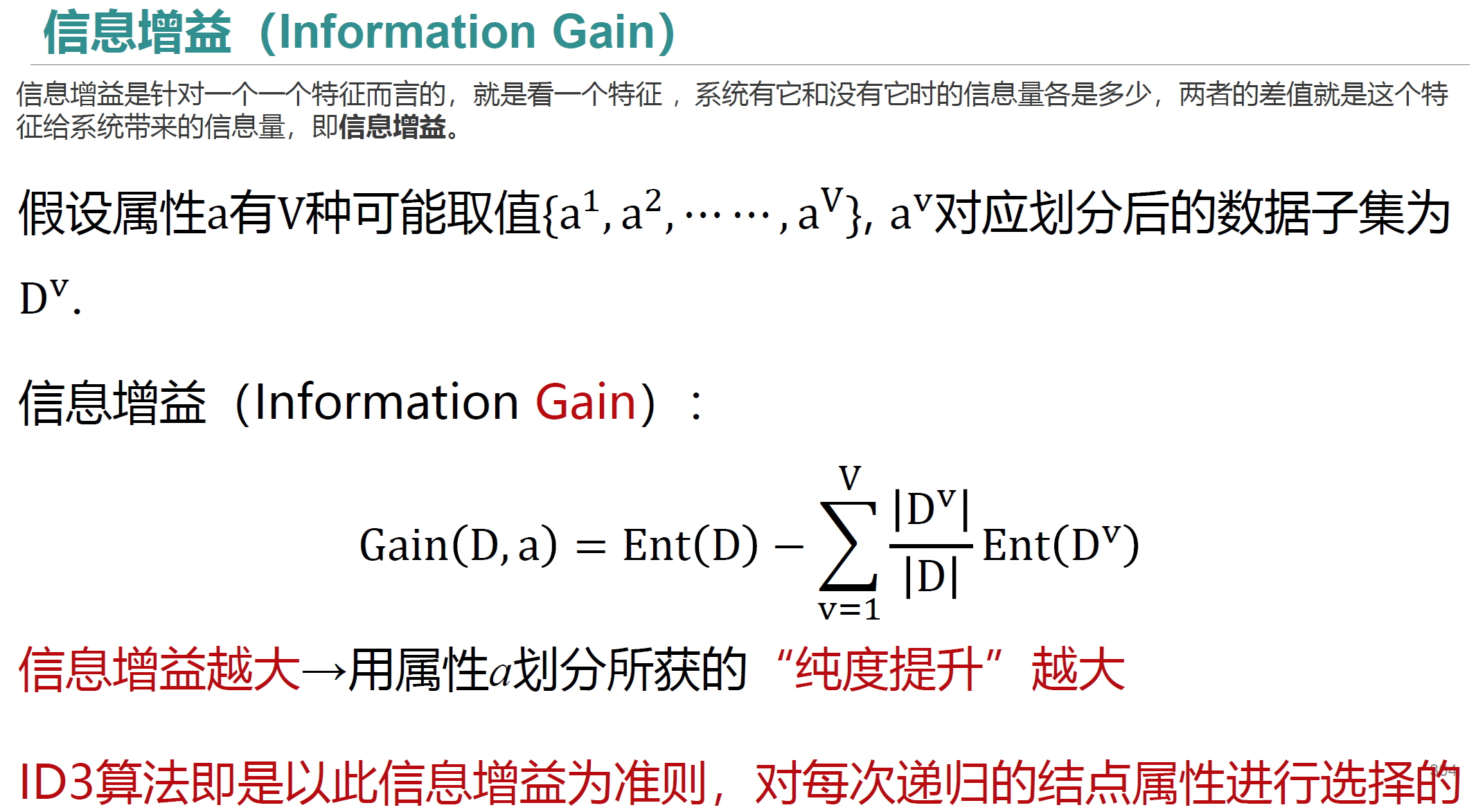

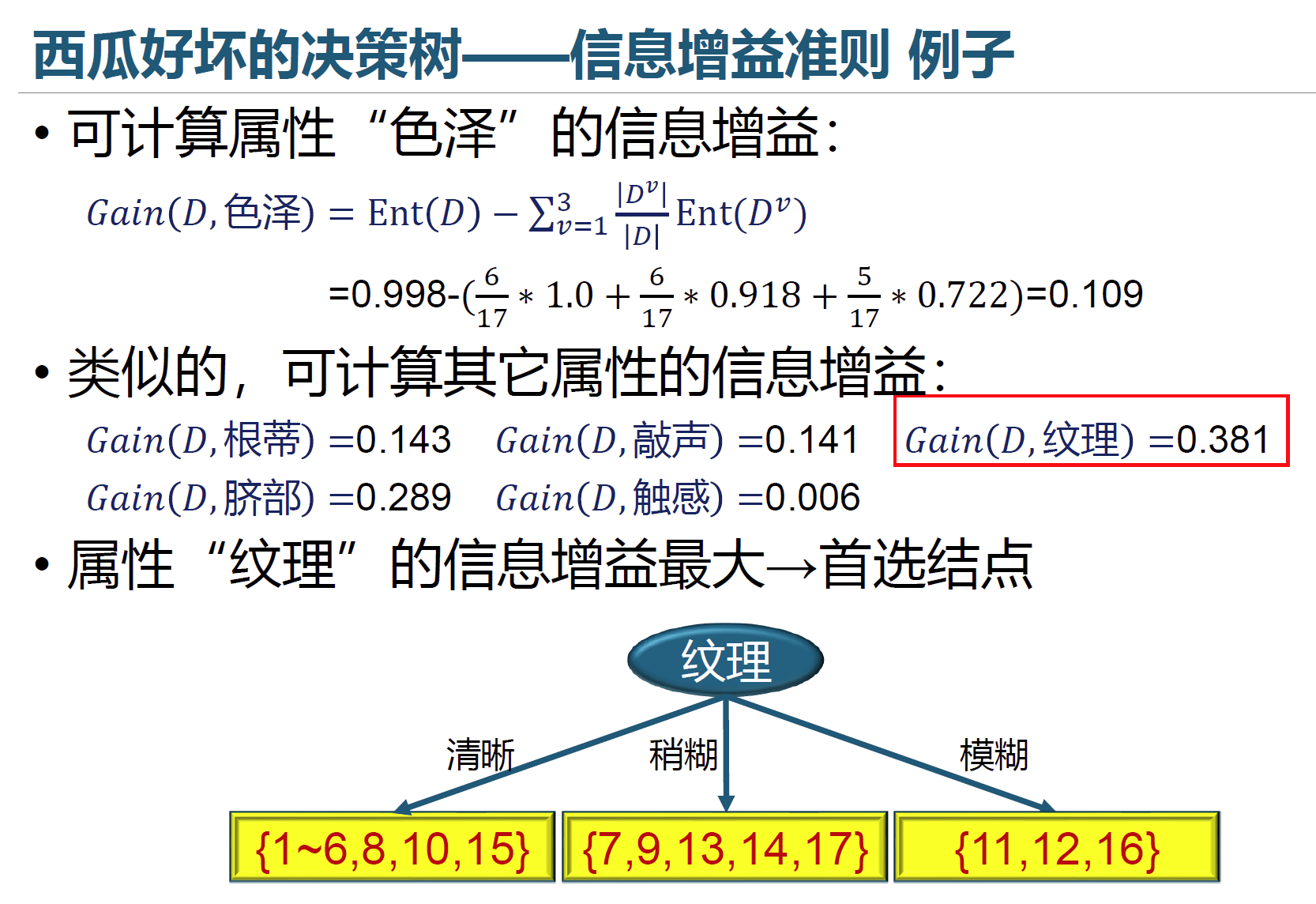

信息增益(Information Gain)

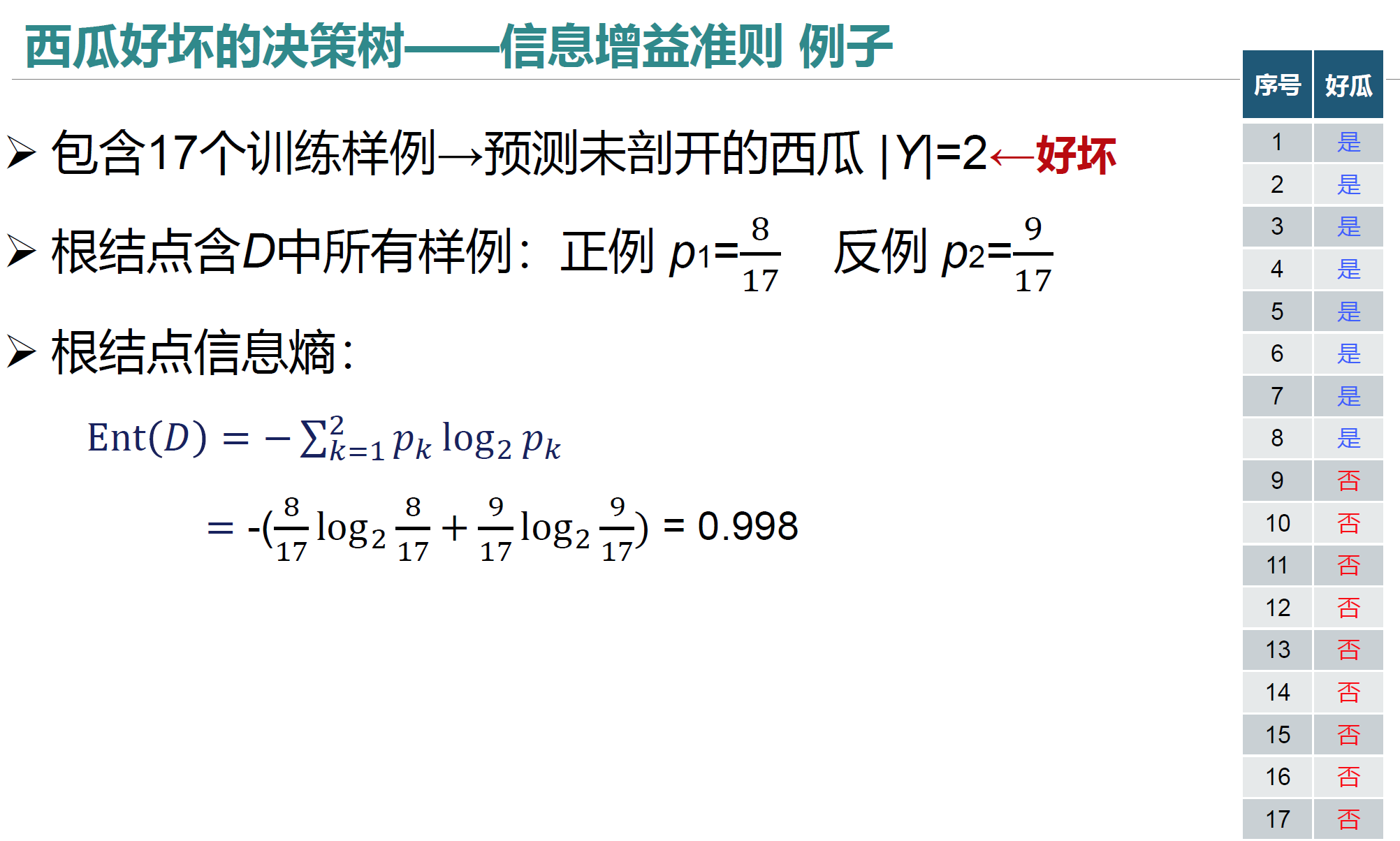

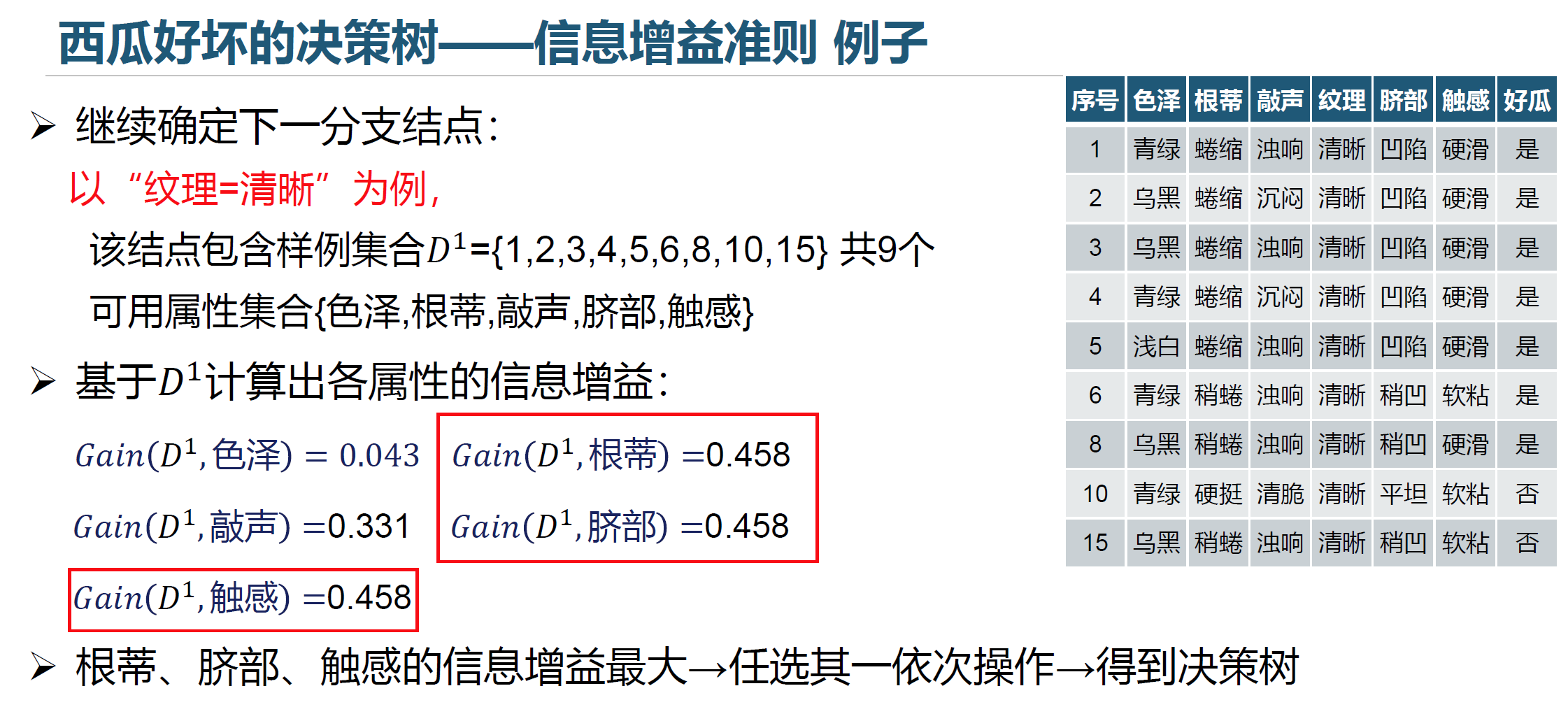

例如:

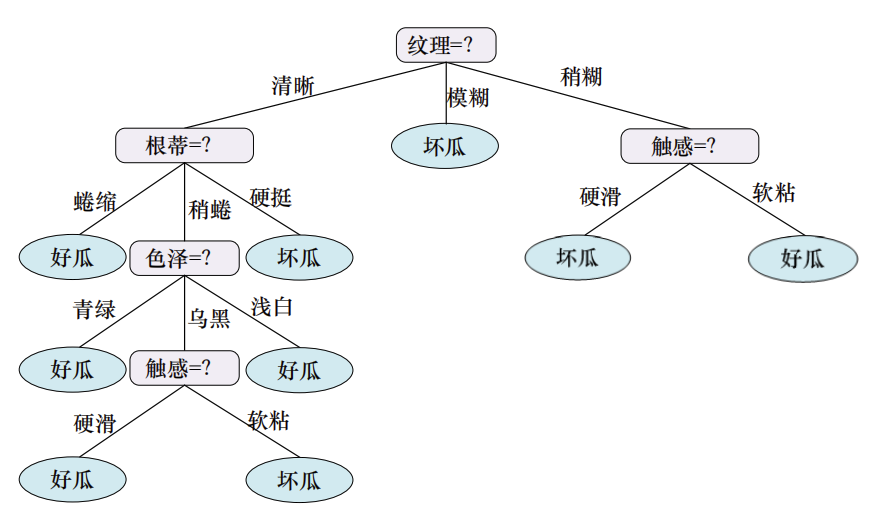

选择信息增益最大的属性来分裂!

最终生成的决策树:

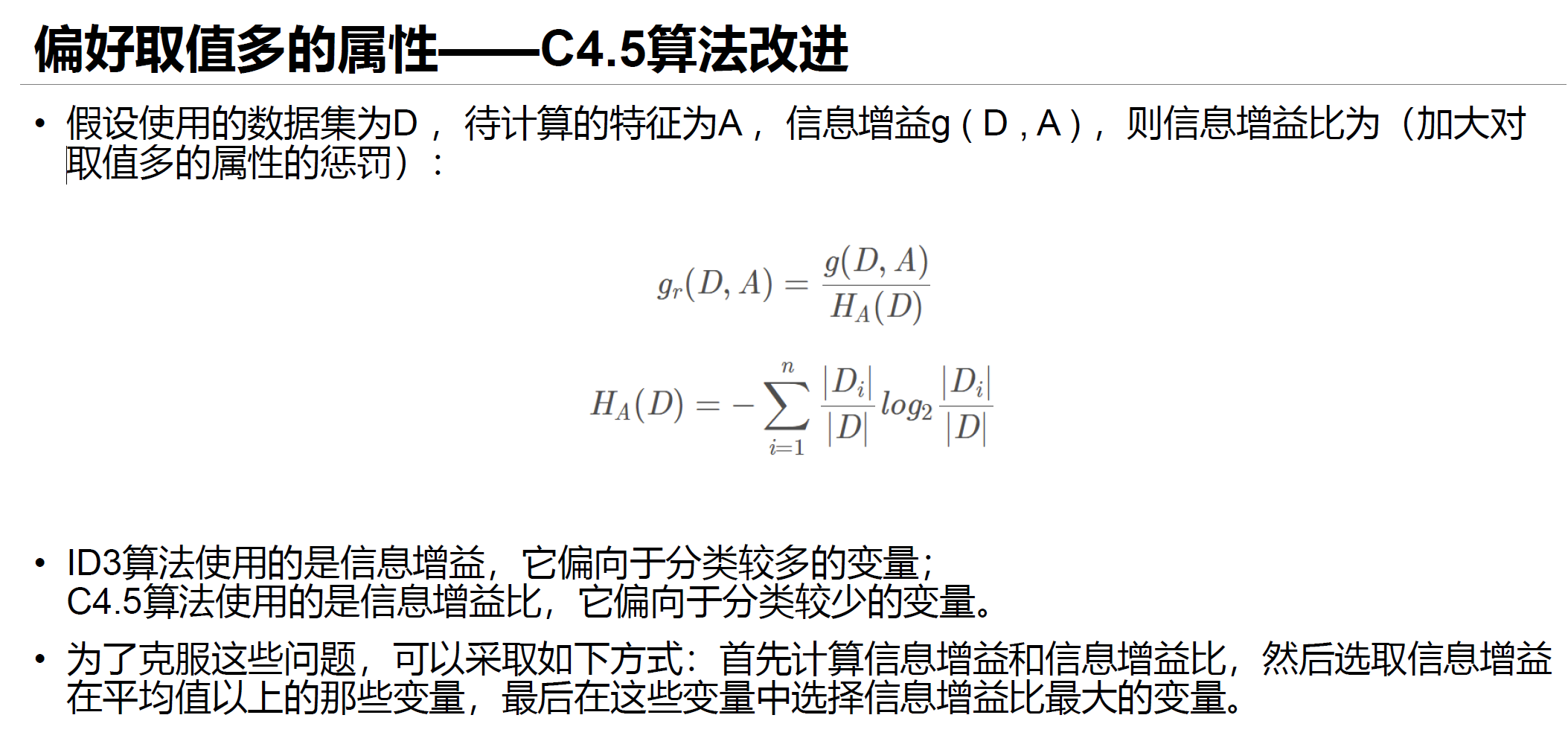

ID3算法小结

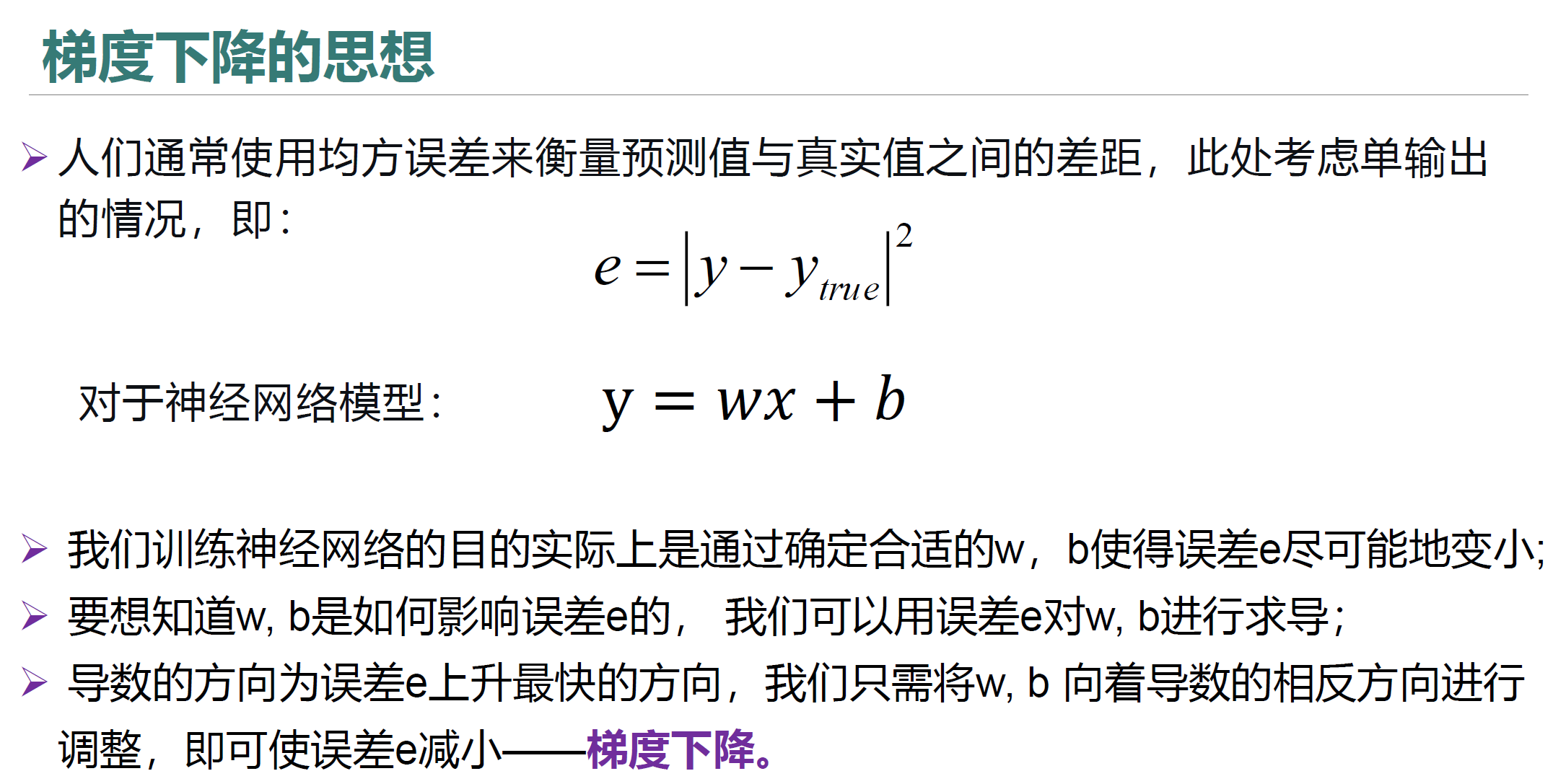

监督学习(线性回归,Linear Regression)

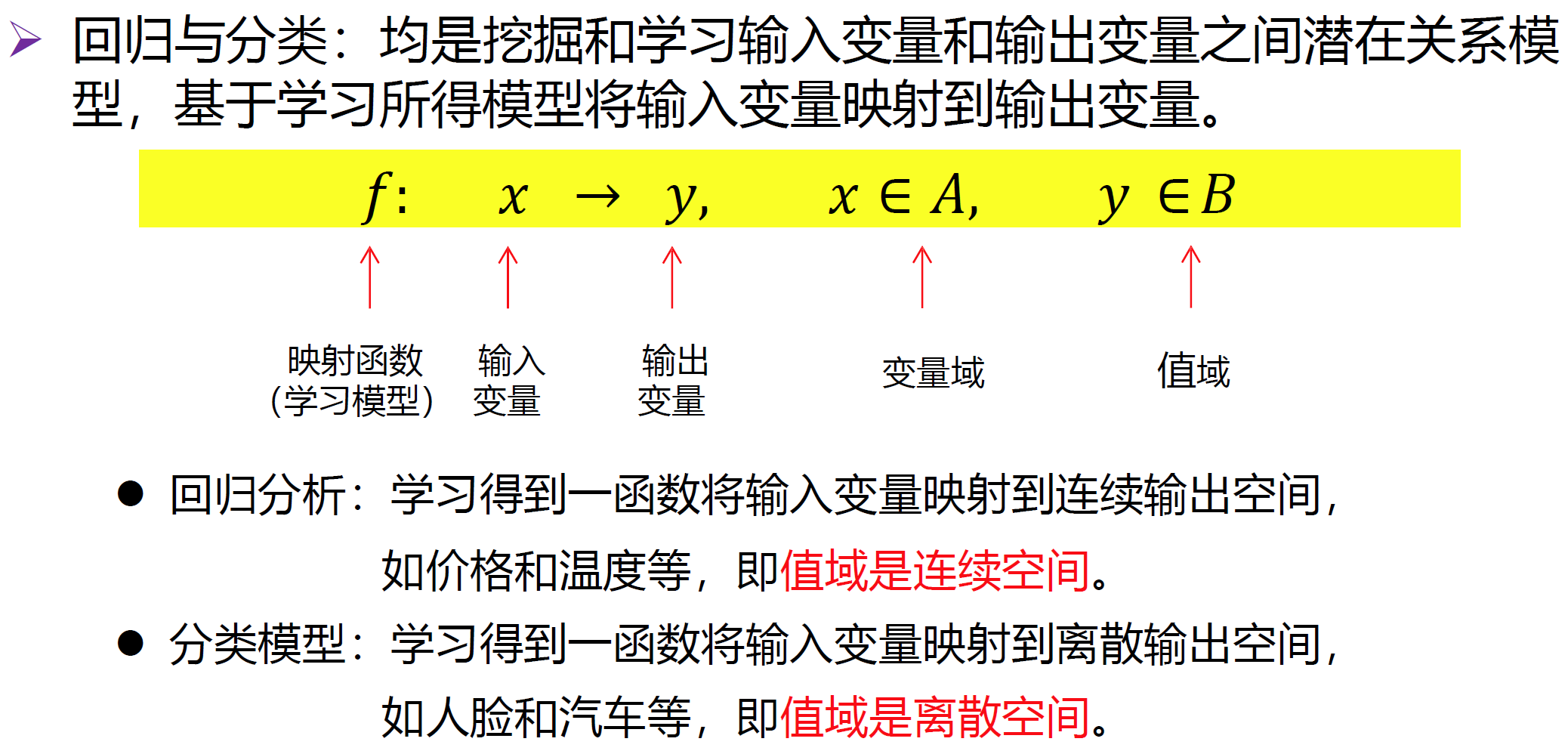

回归与分类的区别

分类:值域是离散空间;

回归:值域是连续空间。

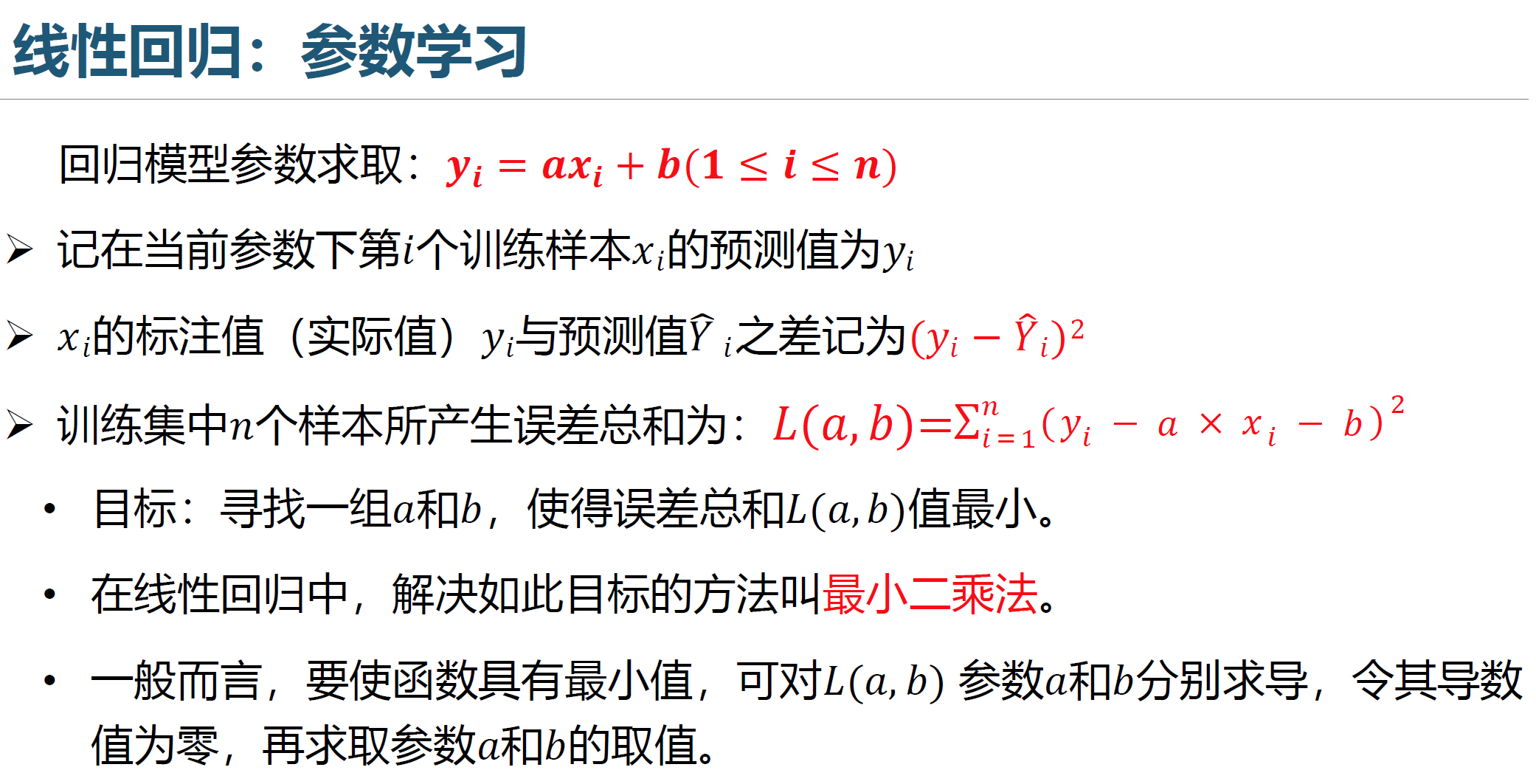

线性回归:参数学习

无监督学习

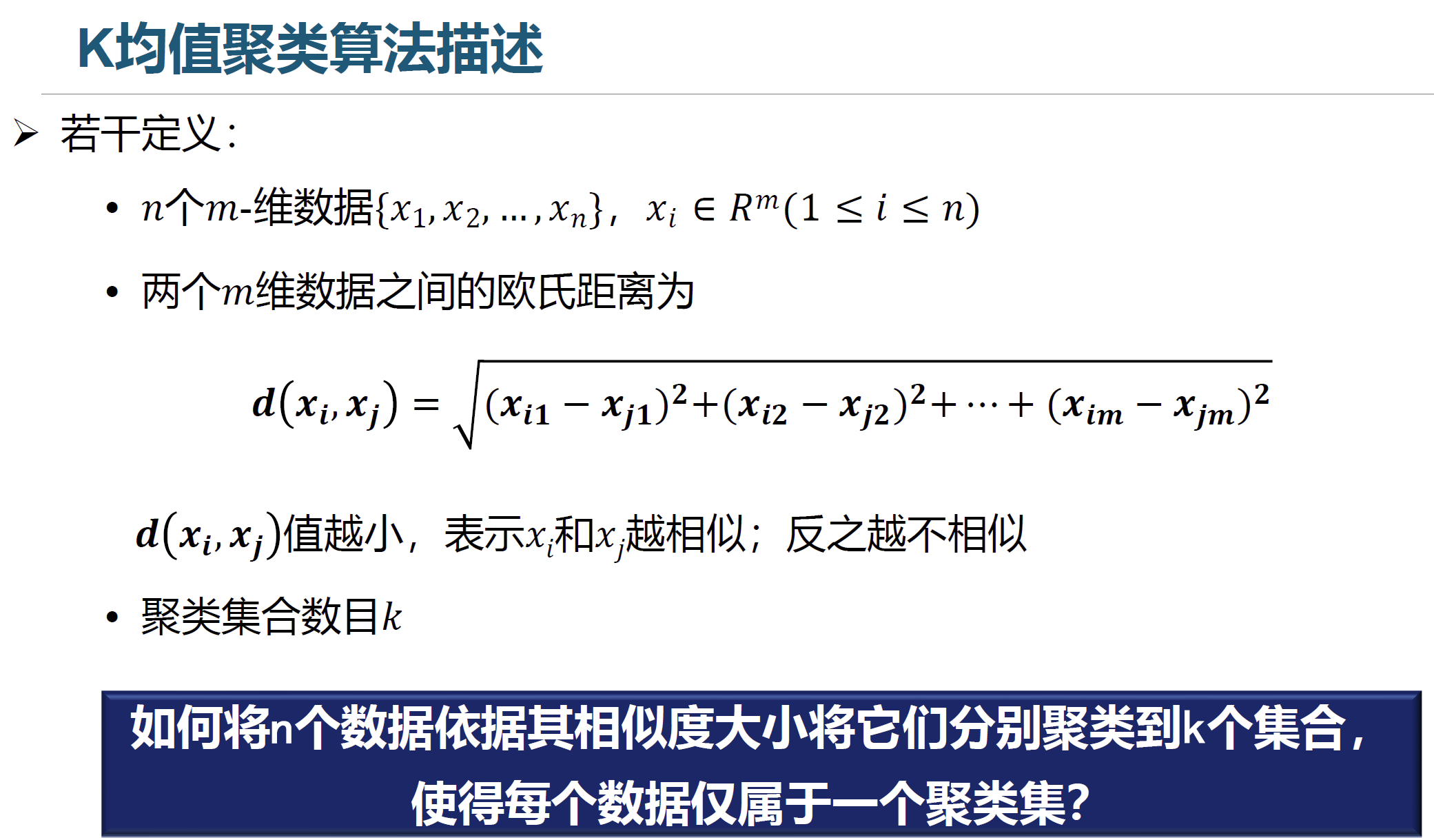

K均值聚类(K-means)

K-means算法描述:

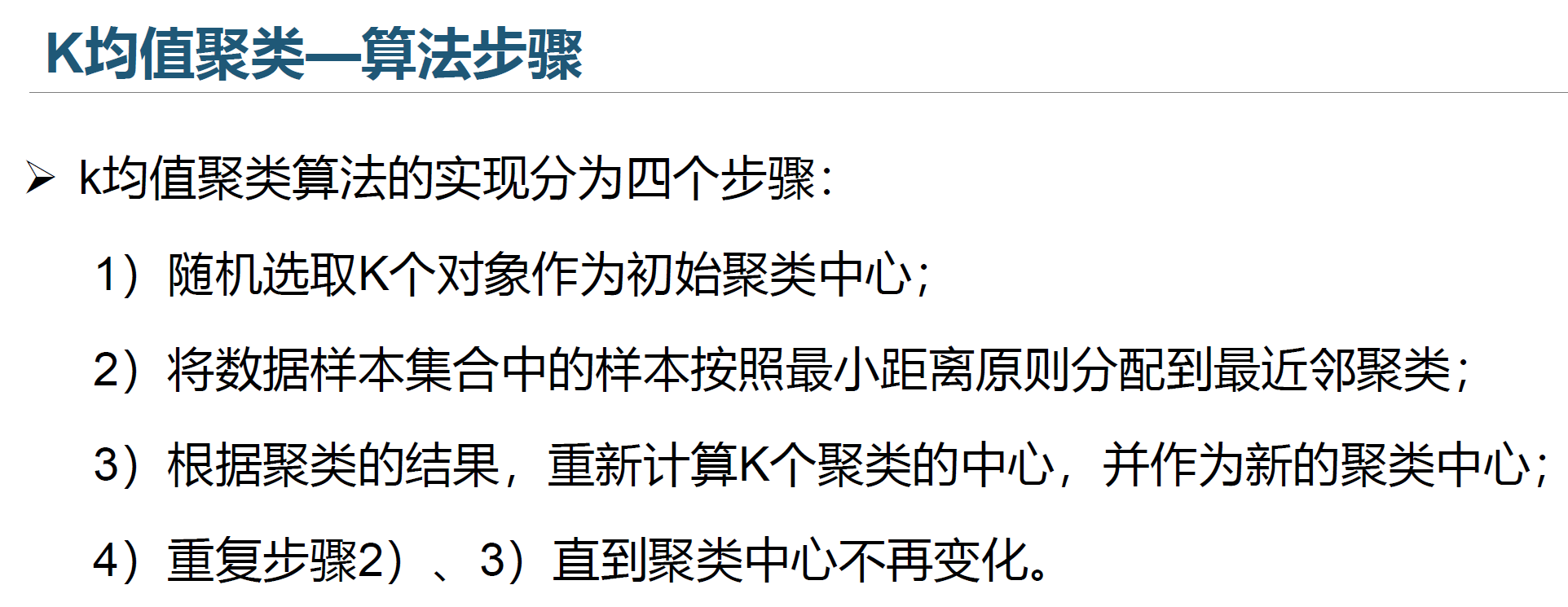

K-means算法步骤

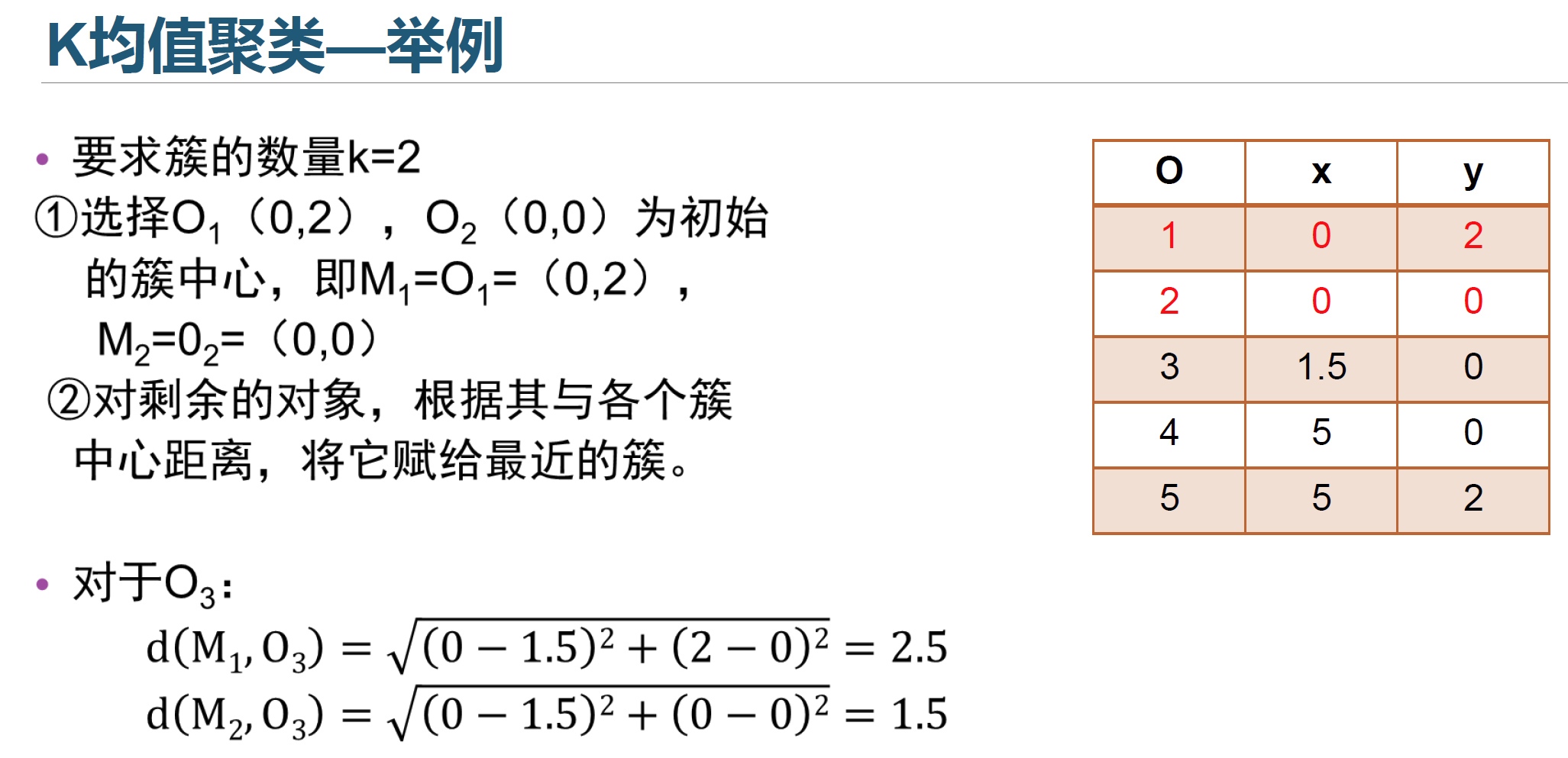

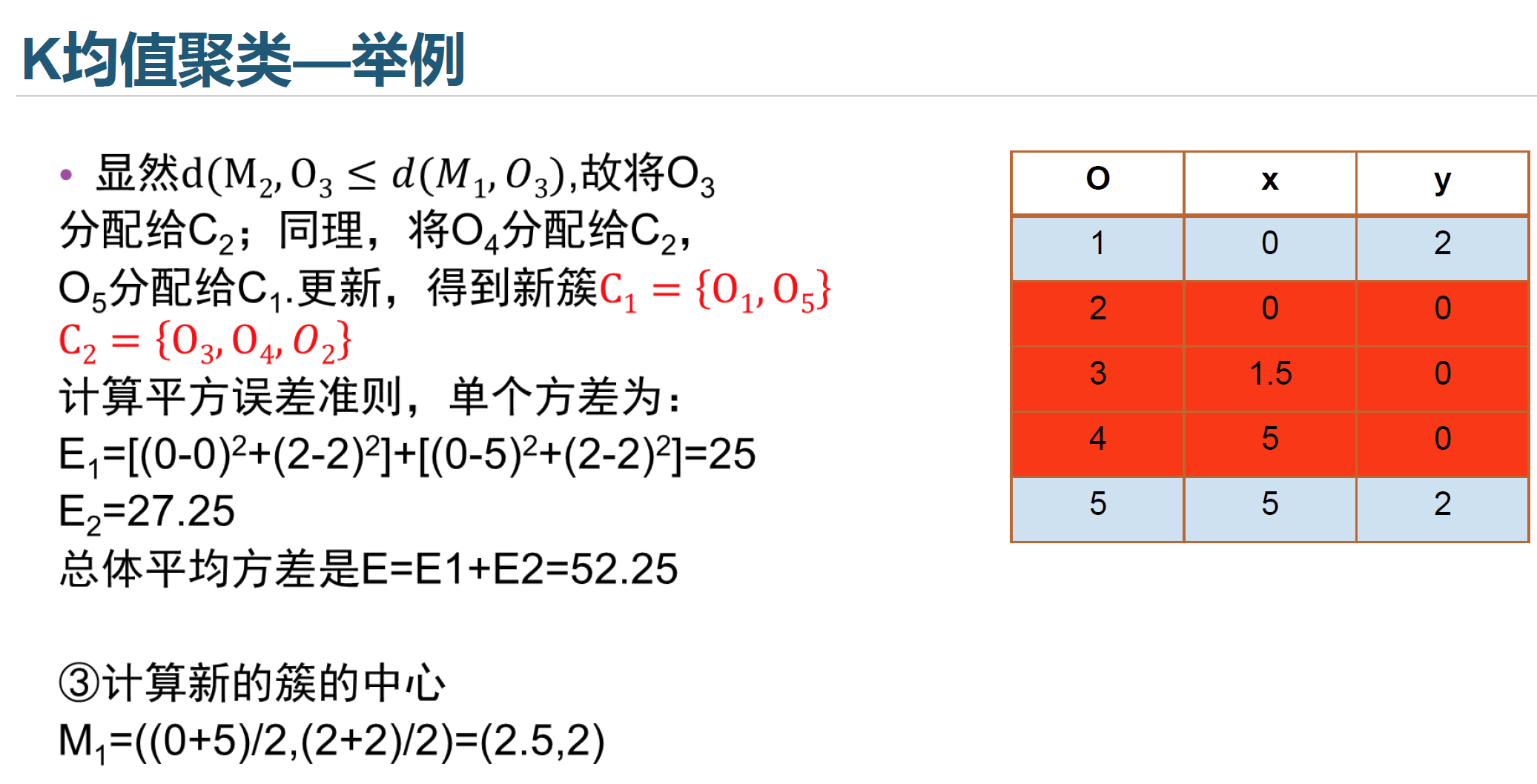

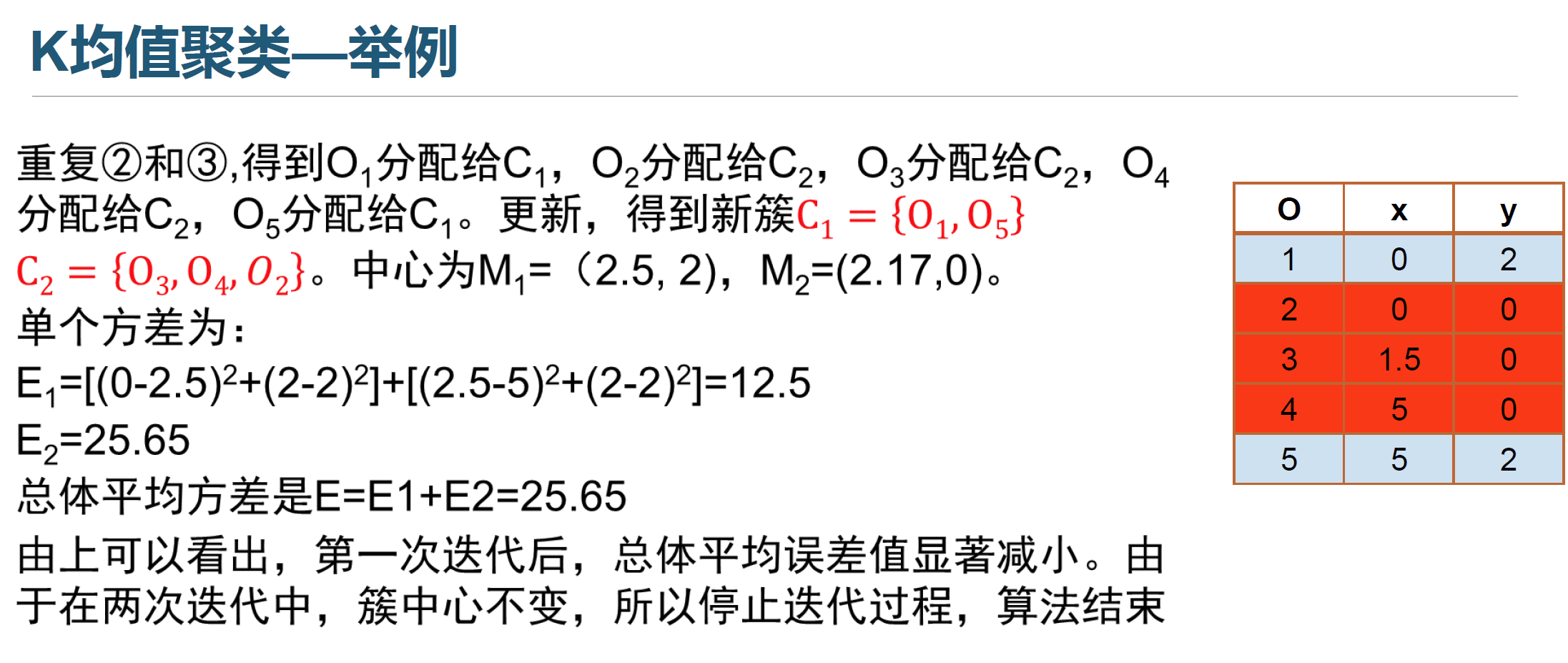

举例说明

K均值聚类/K-means小结

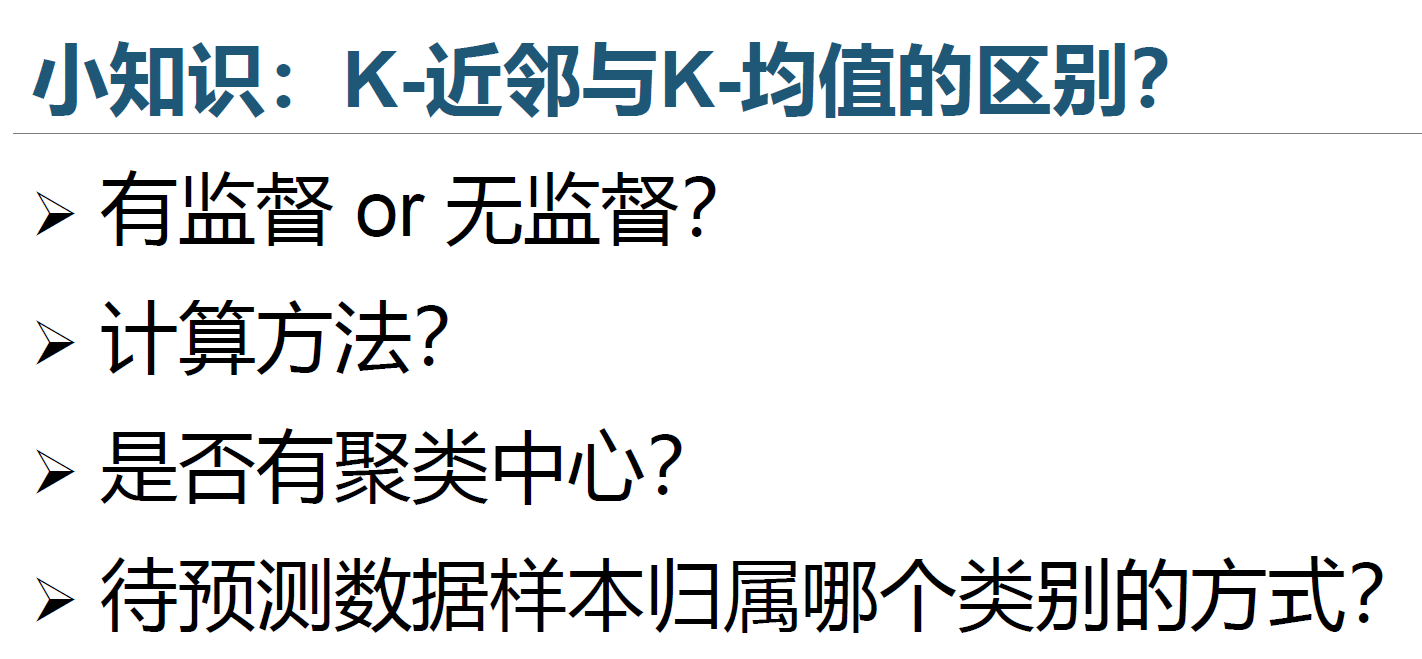

K近邻与K均值的区别

①K近邻是有监督学习算法,K均值是无监督学习算法;

②略;

③K近邻无聚类中心,K均值有聚类中心;

④K近邻吧?

| KNN | K-Means |

|---|---|

| 目的是为了确定一个点的分类 | 目的是为了将一系列点集分成k类 |

| KNN是分类算法 | K-Means是聚类算法 |

| 监督学习,分类目标事先已知 | 非监督学习,将相似数据归到一起从而得到分类,没有外部分类 |

| 训练数据集有label,已经是完全正确的数据 | 训练数据集无label,是杂乱无章的,经过聚类后才变得有点顺序,先无序,后有序 |

| 没有明显的前期训练过程,属于memory-based learning | 有明显的前期训练过程 |

| K的含义:“k”是用来计算的相邻数据数。来了一个样本x,要给它分类,即求出它的y,就从数据集中,在x附近找离它最近的K个数据点,这K个数据点,类别c占的个数最多,就把x的label设为c | K的含义:“k”是类的数目。K是人工固定好的数字,假设数据集合可以分为K个簇,由于是依靠人工定好,需要一点先验知识 |

| K值确定后每次结果固定 | K值确定后每次结果可能不同,从 n个数据对象任意选择 k 个对象作为初始聚类中心,随机性对结果影响较大 |

| 时间复杂度:O(n) | 时间复杂度:O(nkt),t为迭代次数 |

| 相似点:都包含这样的过程,给定一个点,在数据集中找离它最近的点。即二者都用到了NN(Nears Neighbor)算法,一般用KD树来实现NN。 |

第六章 人工神经网络

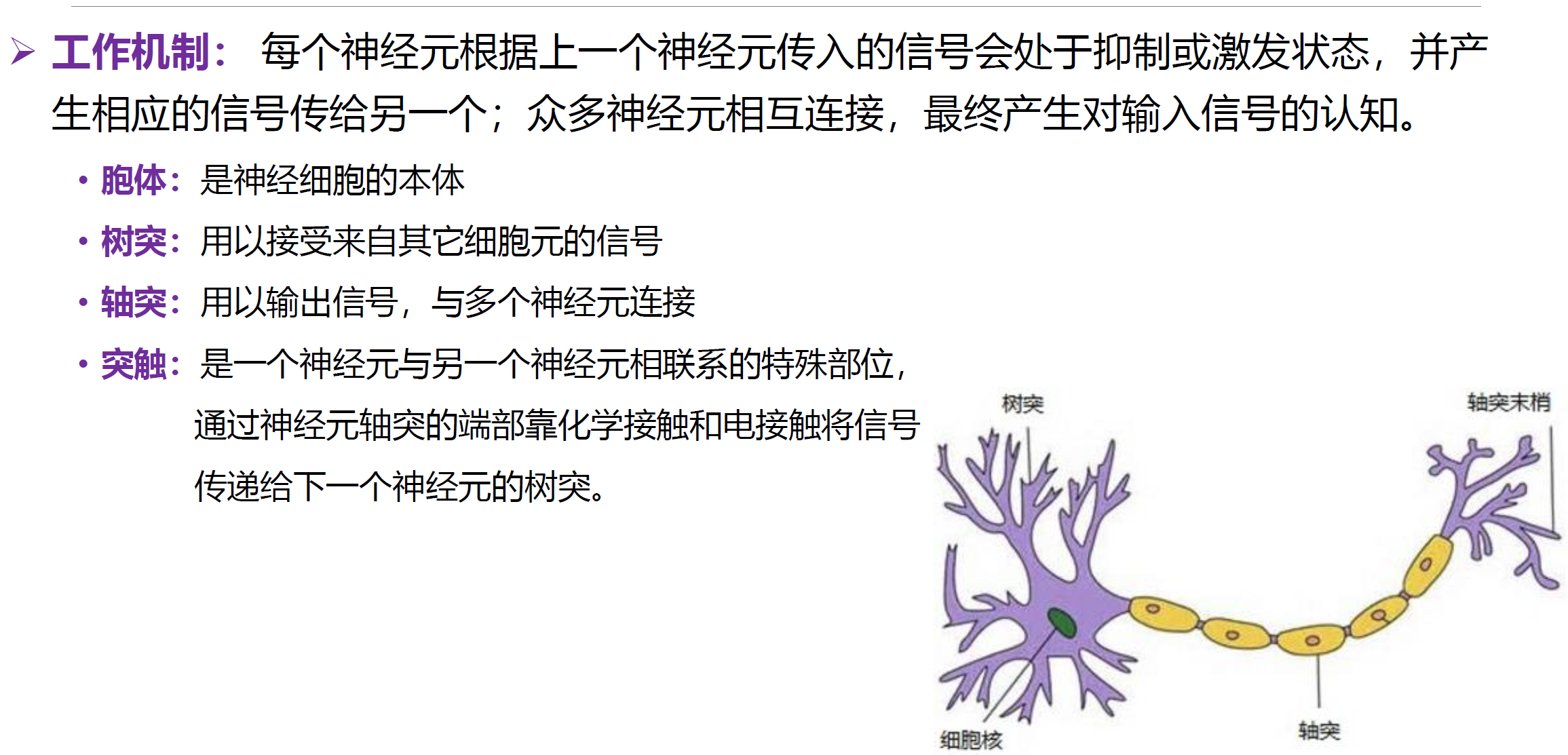

人类大脑工作机制

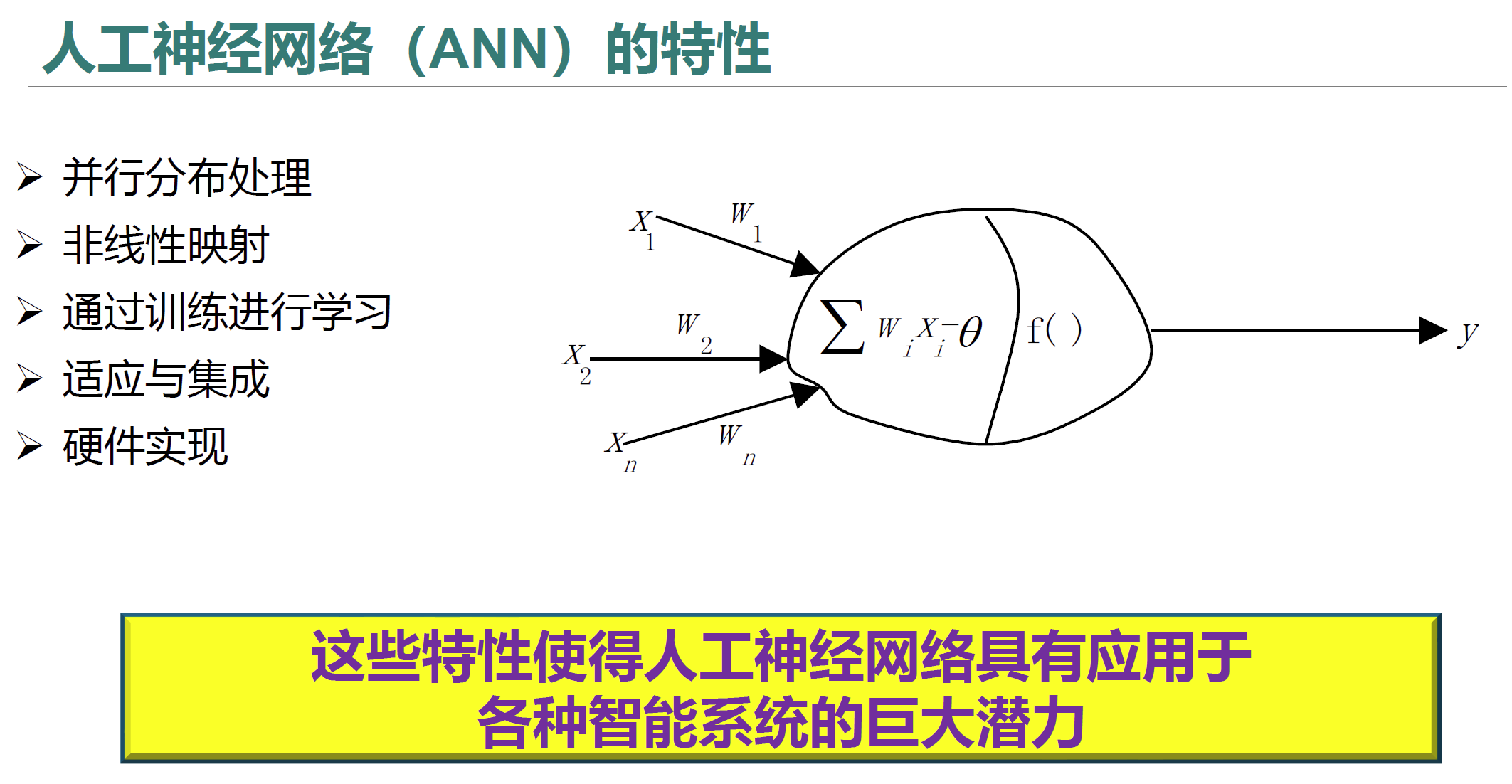

人工神经网络(ANN)的特性

①并行分布处理;

②非线性映射;

③通过训练进行学习;

④适应与集成;

⑤硬件实现。

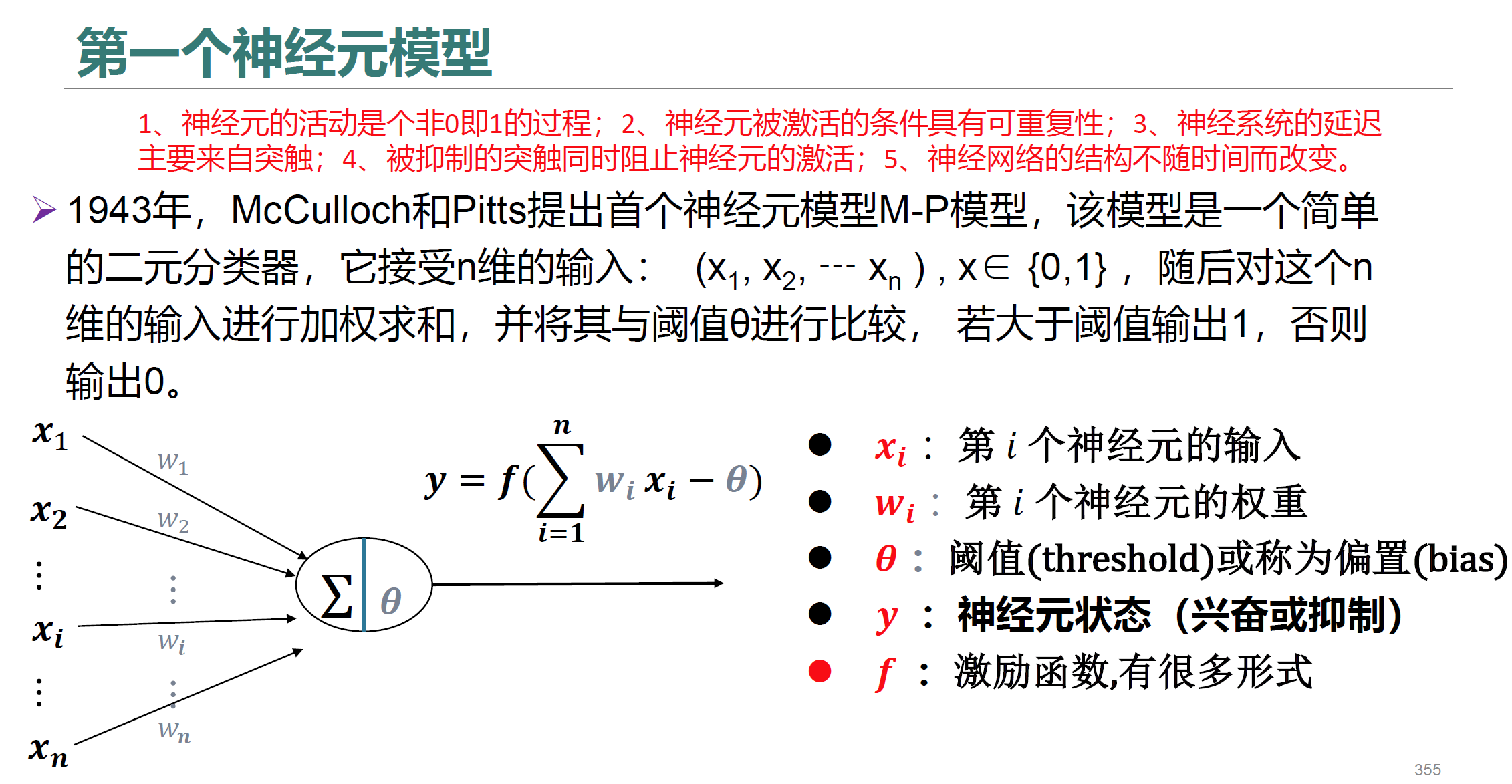

第一个神经元模型(M-P模型)

缺点:

赫布学习规则:

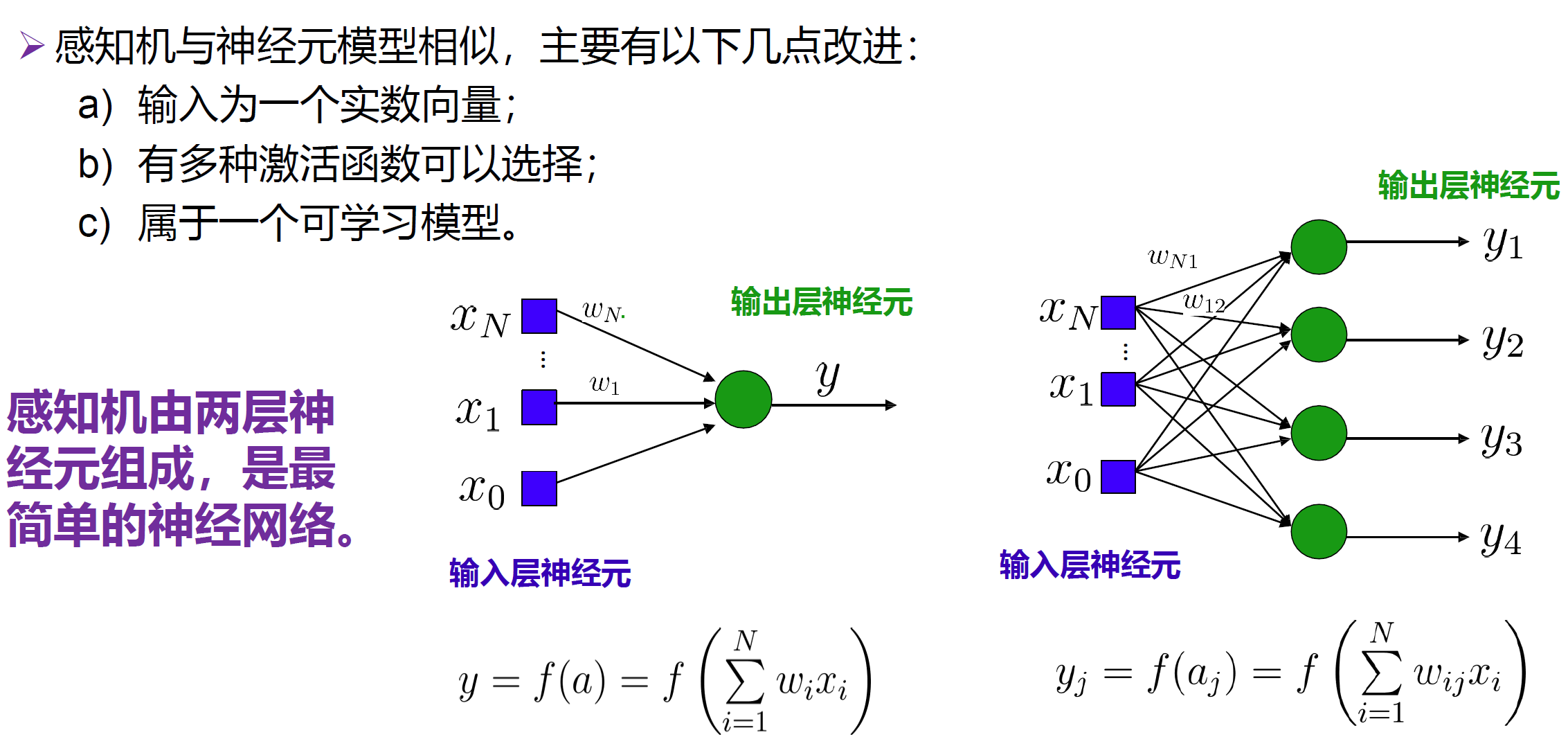

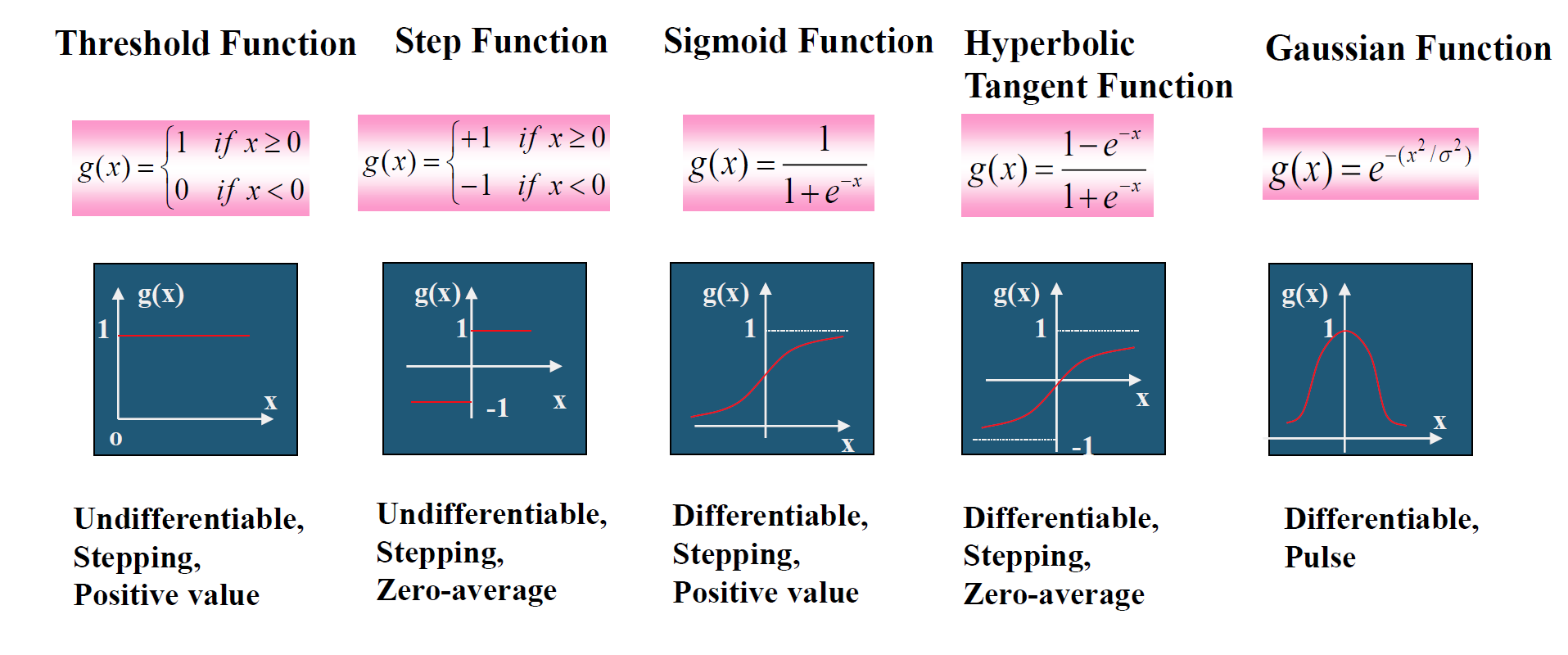

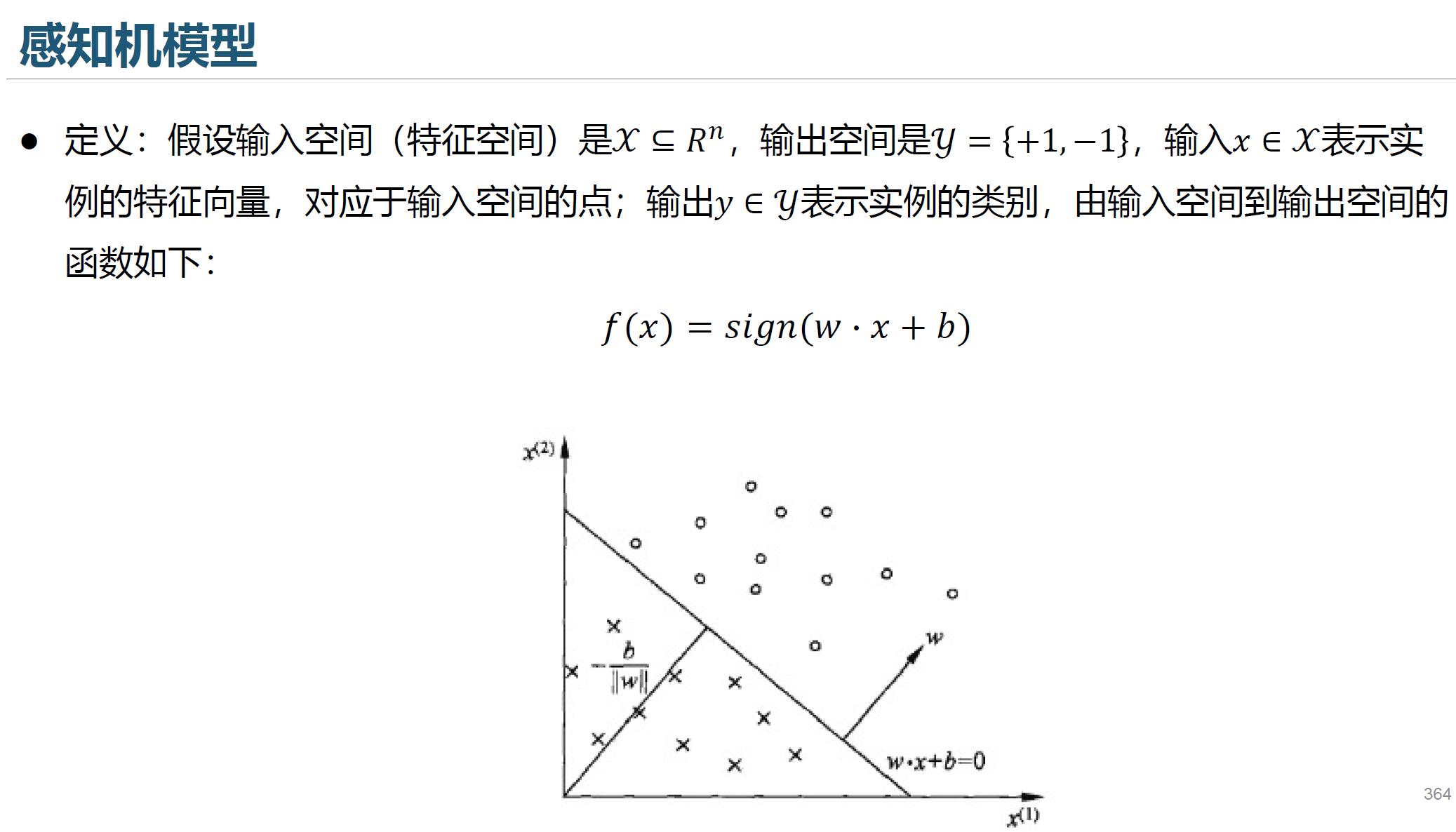

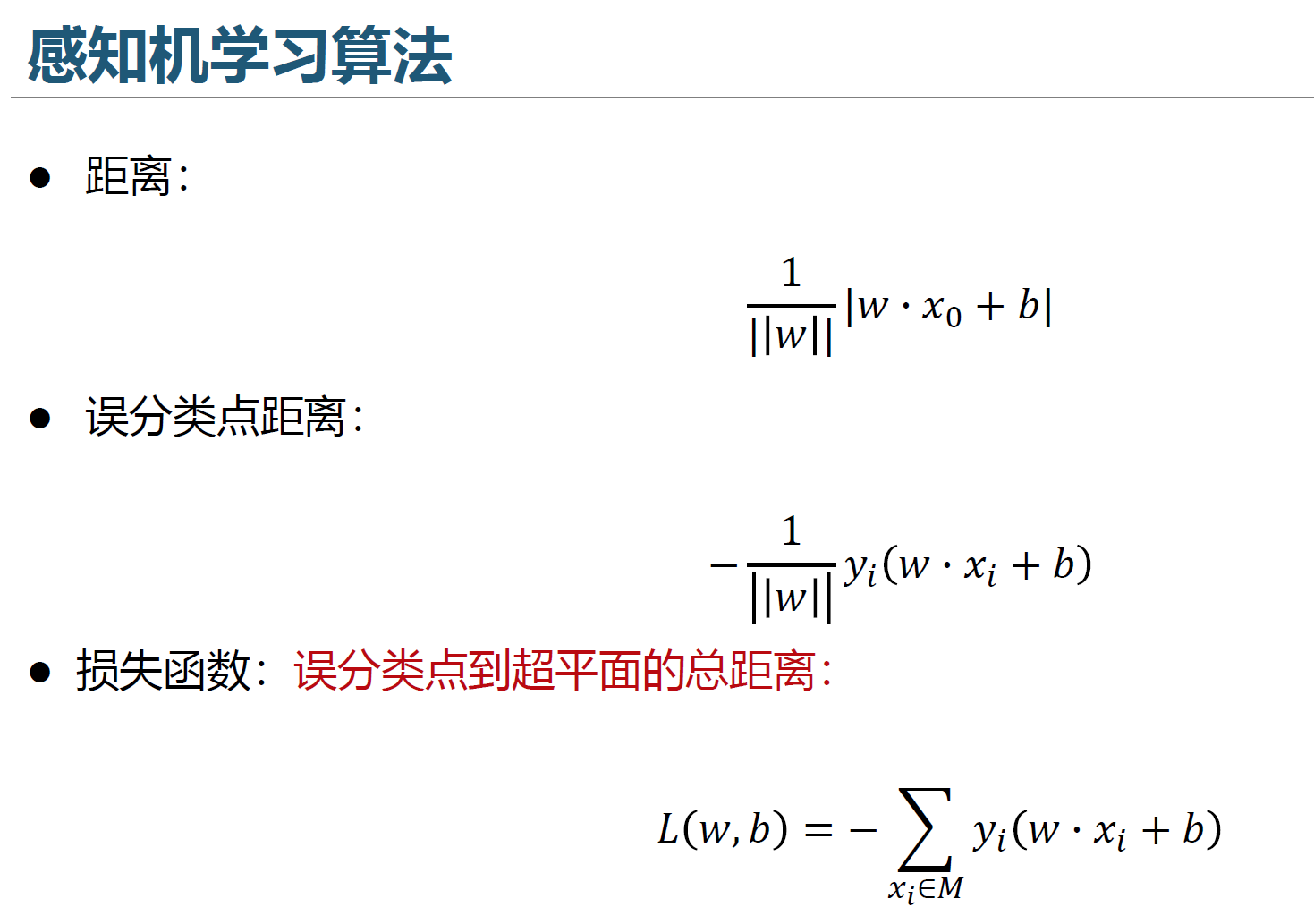

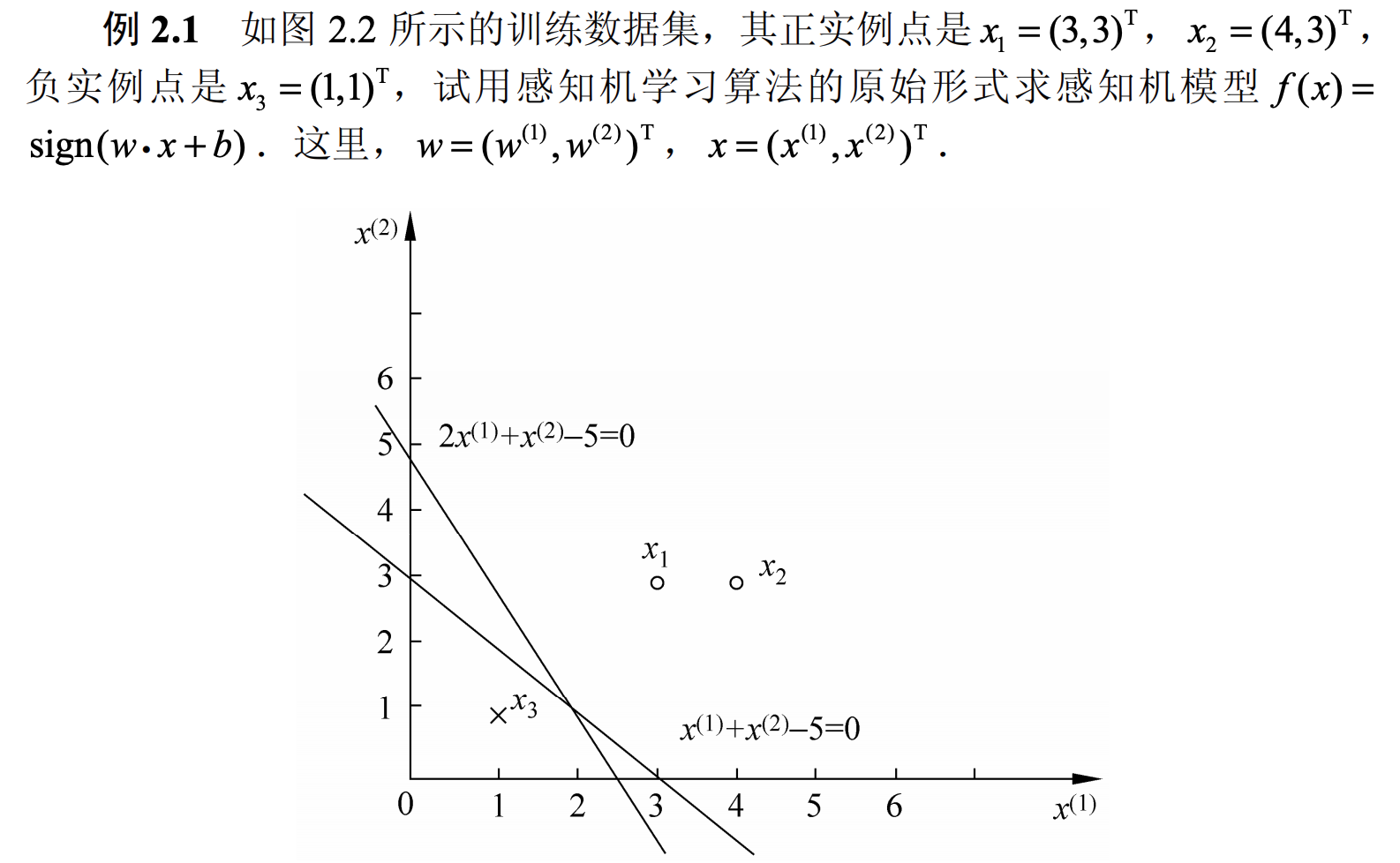

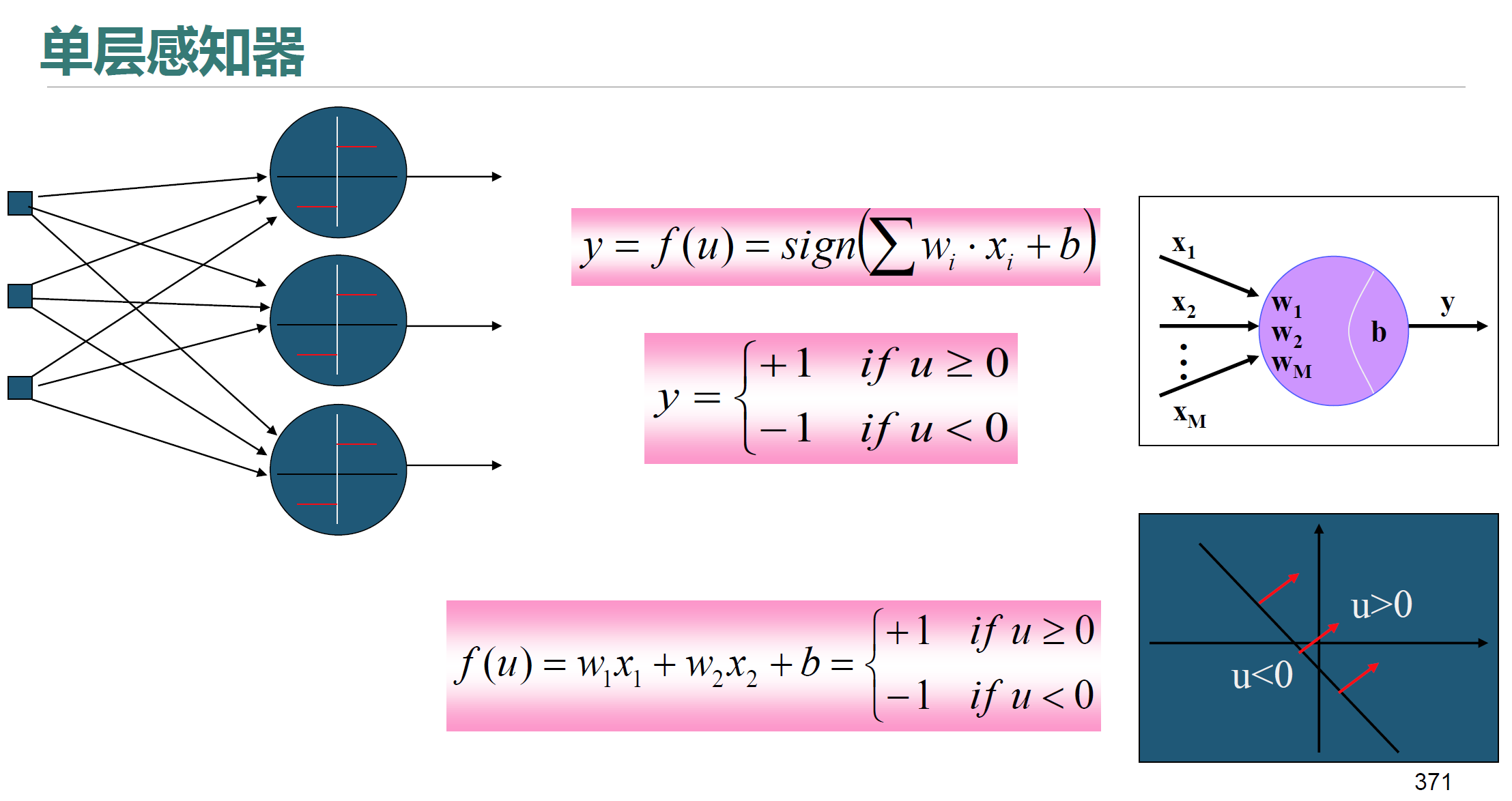

感知机(Perceptron)

感知机由两层神经元(输入层神经元、输出层神经元)组成,是最简单的神经网络。

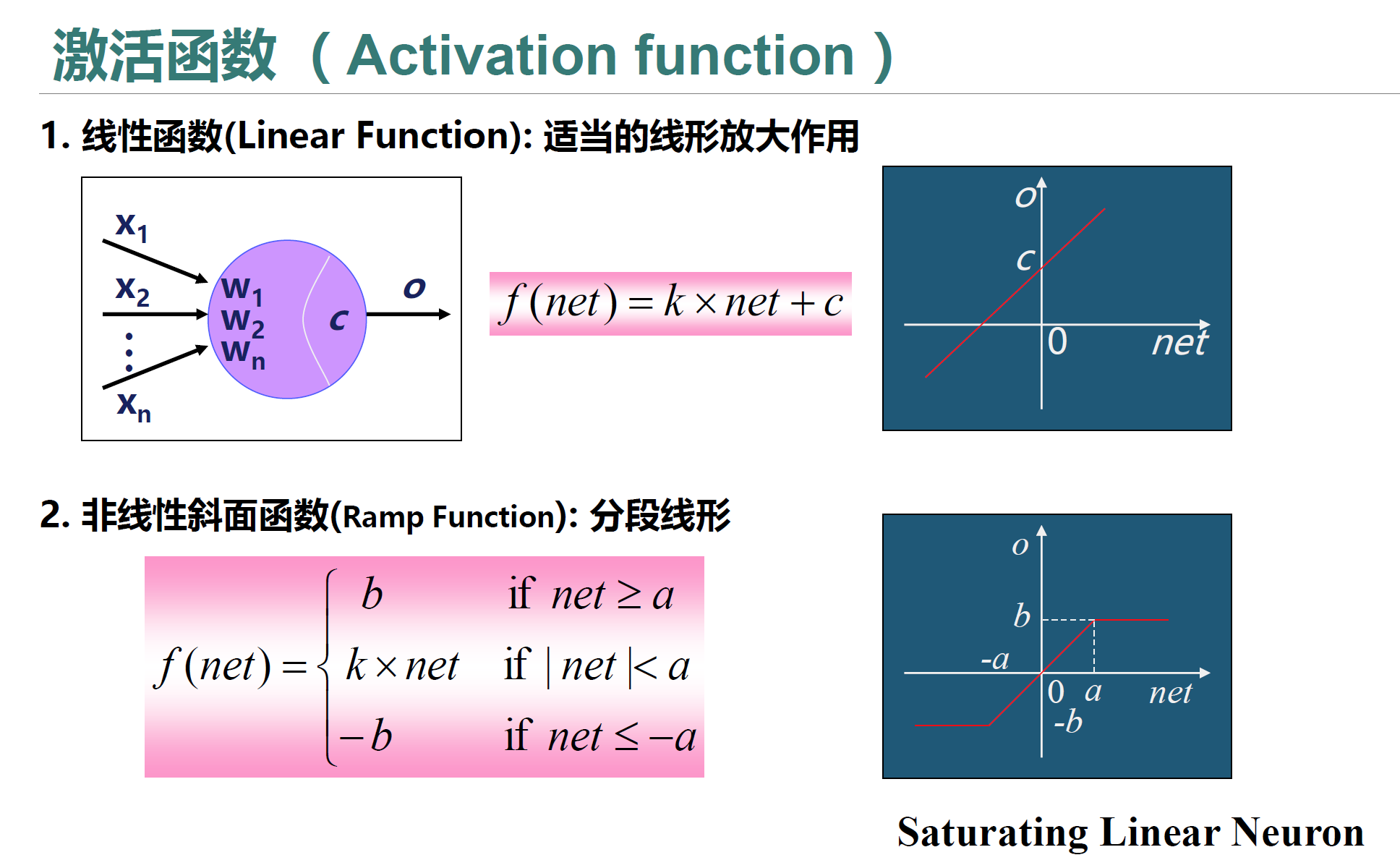

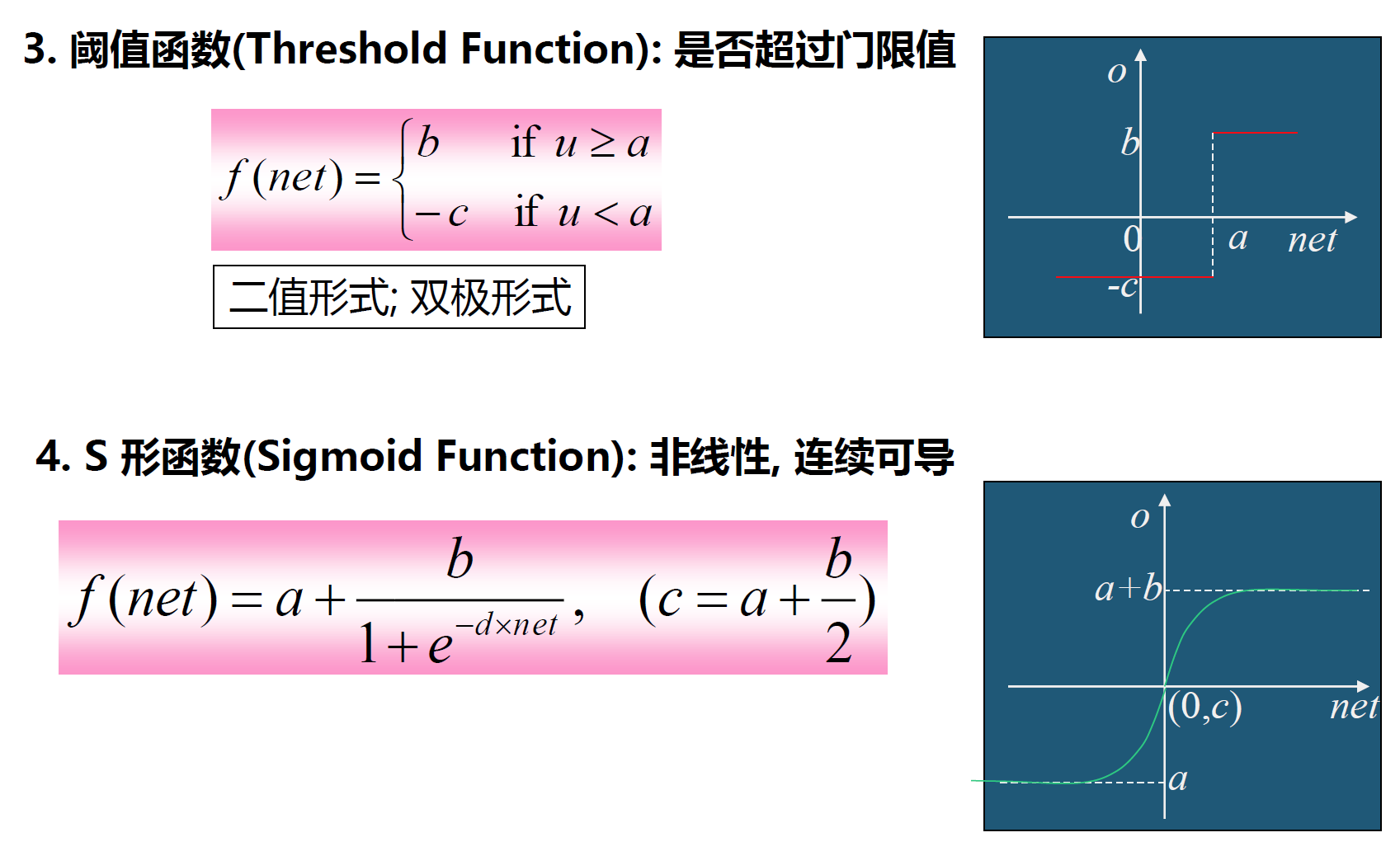

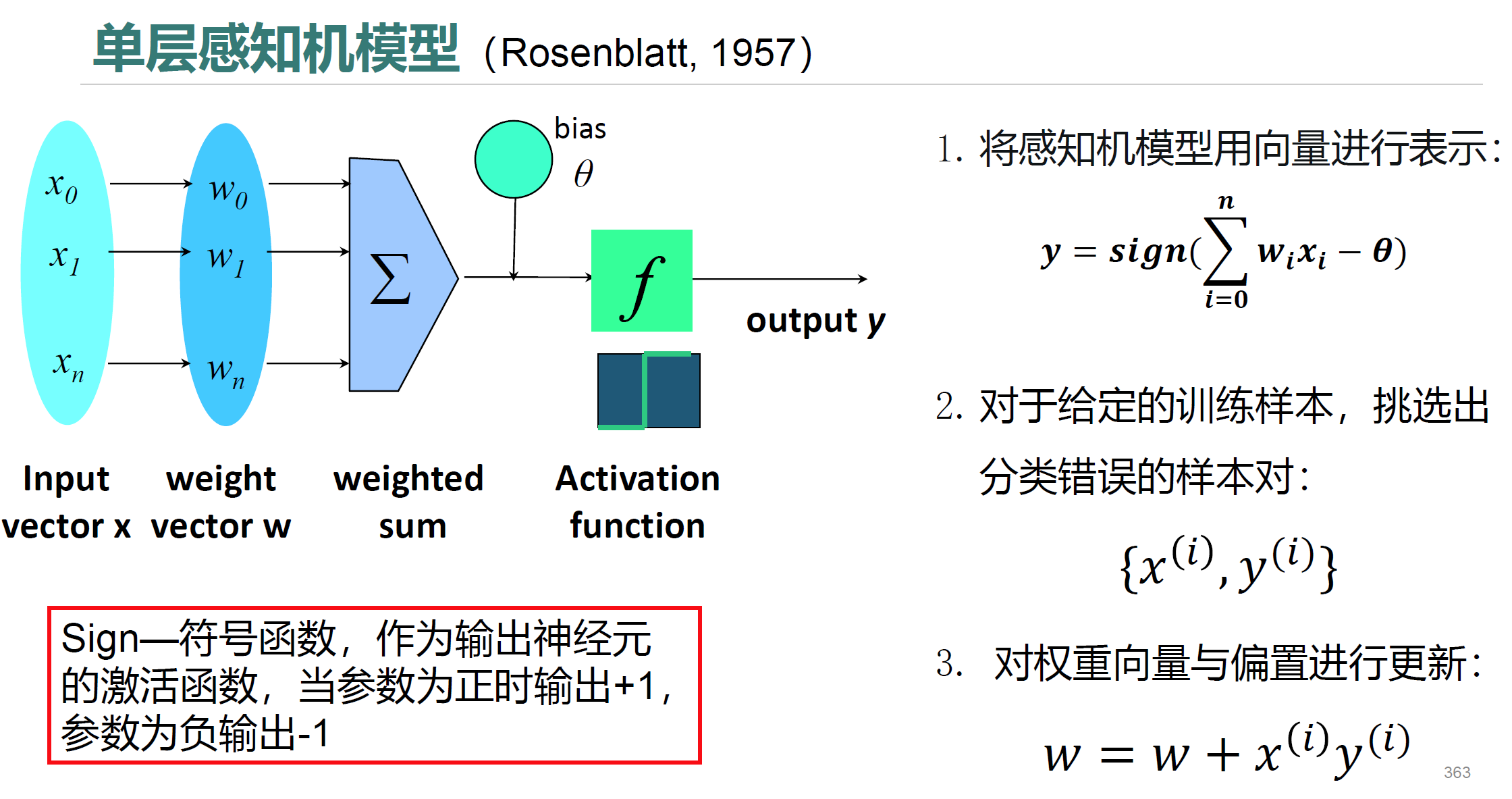

激活函数

在神经元中,输入的input经过一系列加权求和后作用于另一个函数,这个函数就是这里的激活函数。

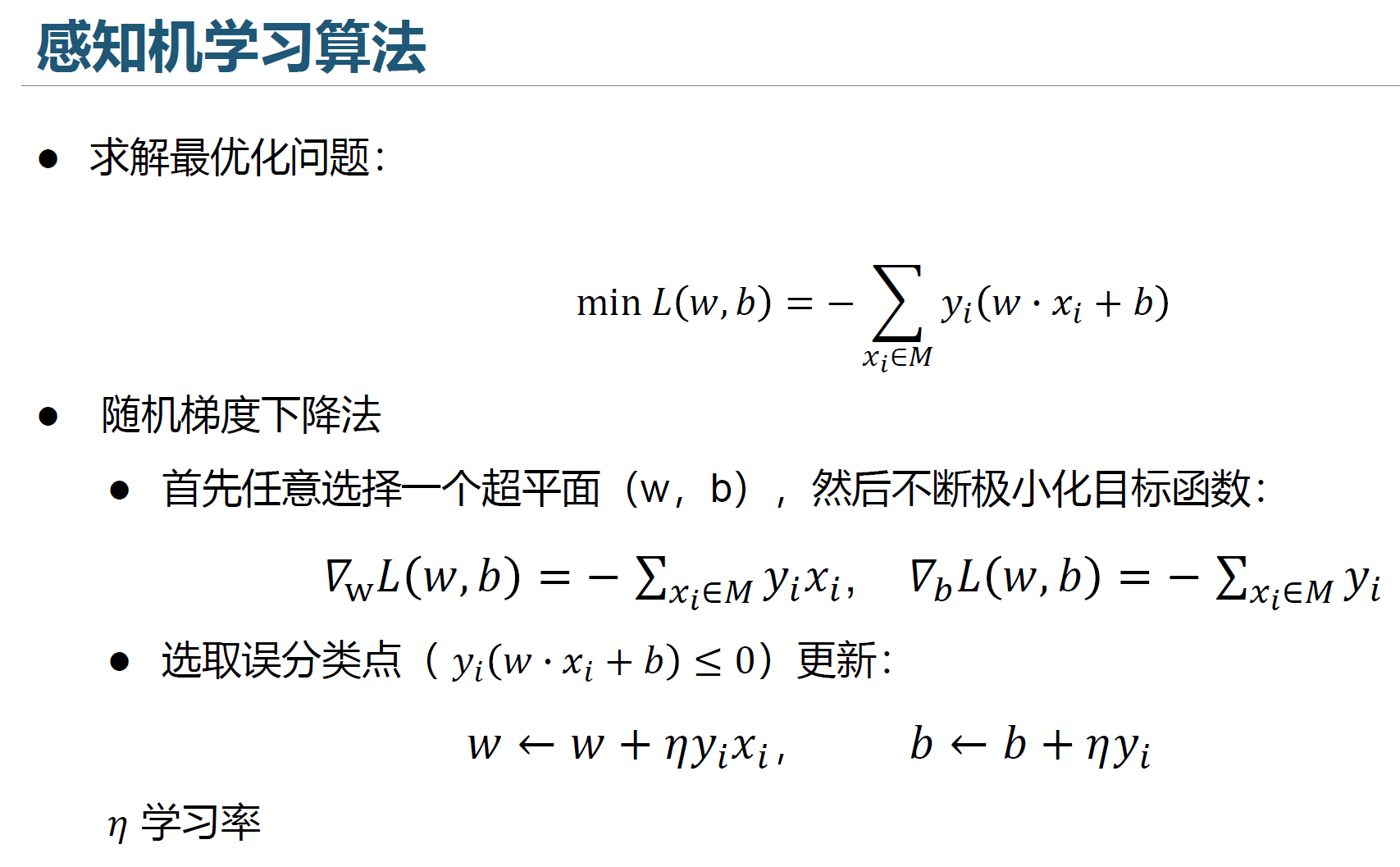

单层感知机模型

注意:sign(0)=1。

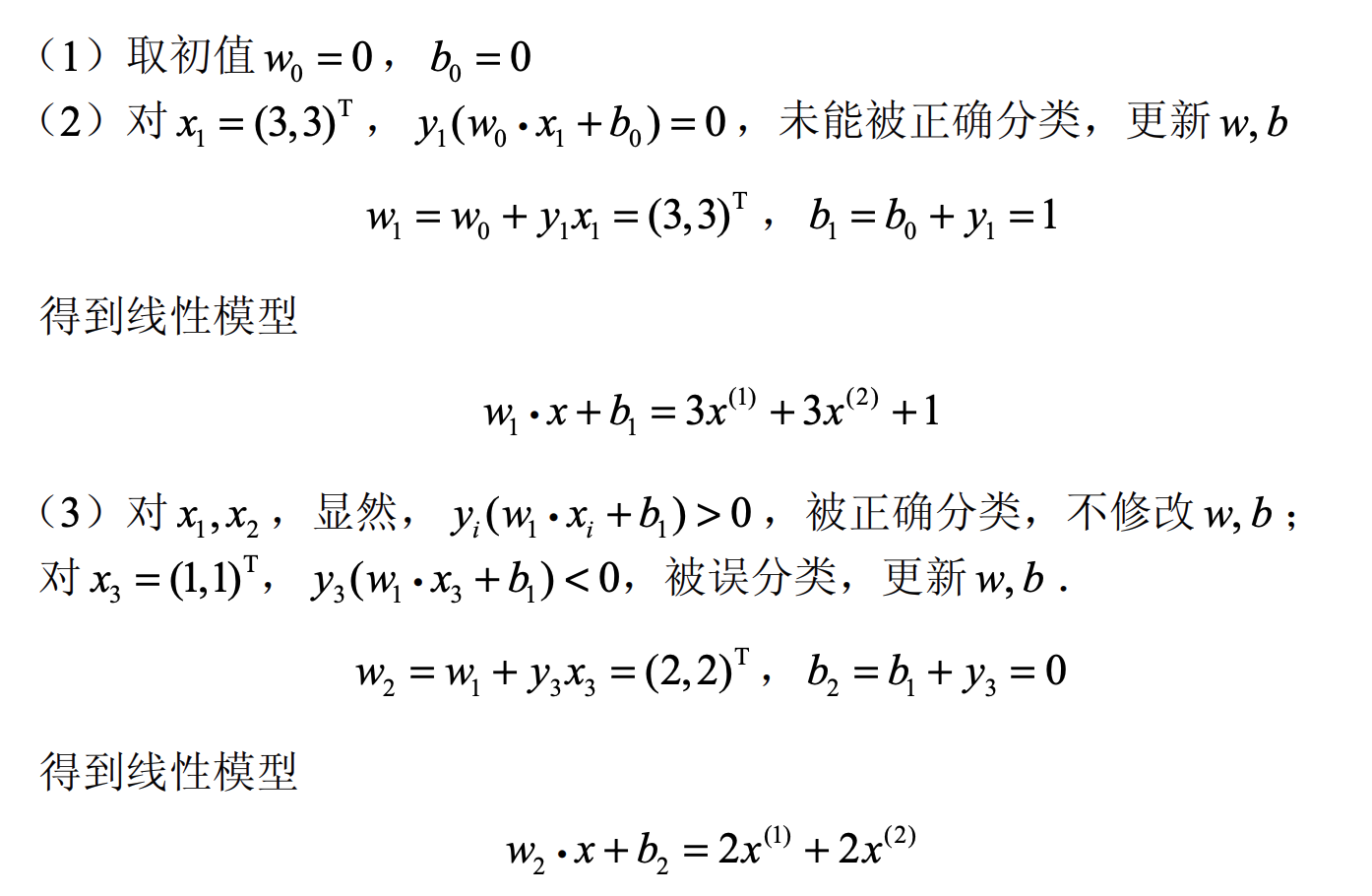

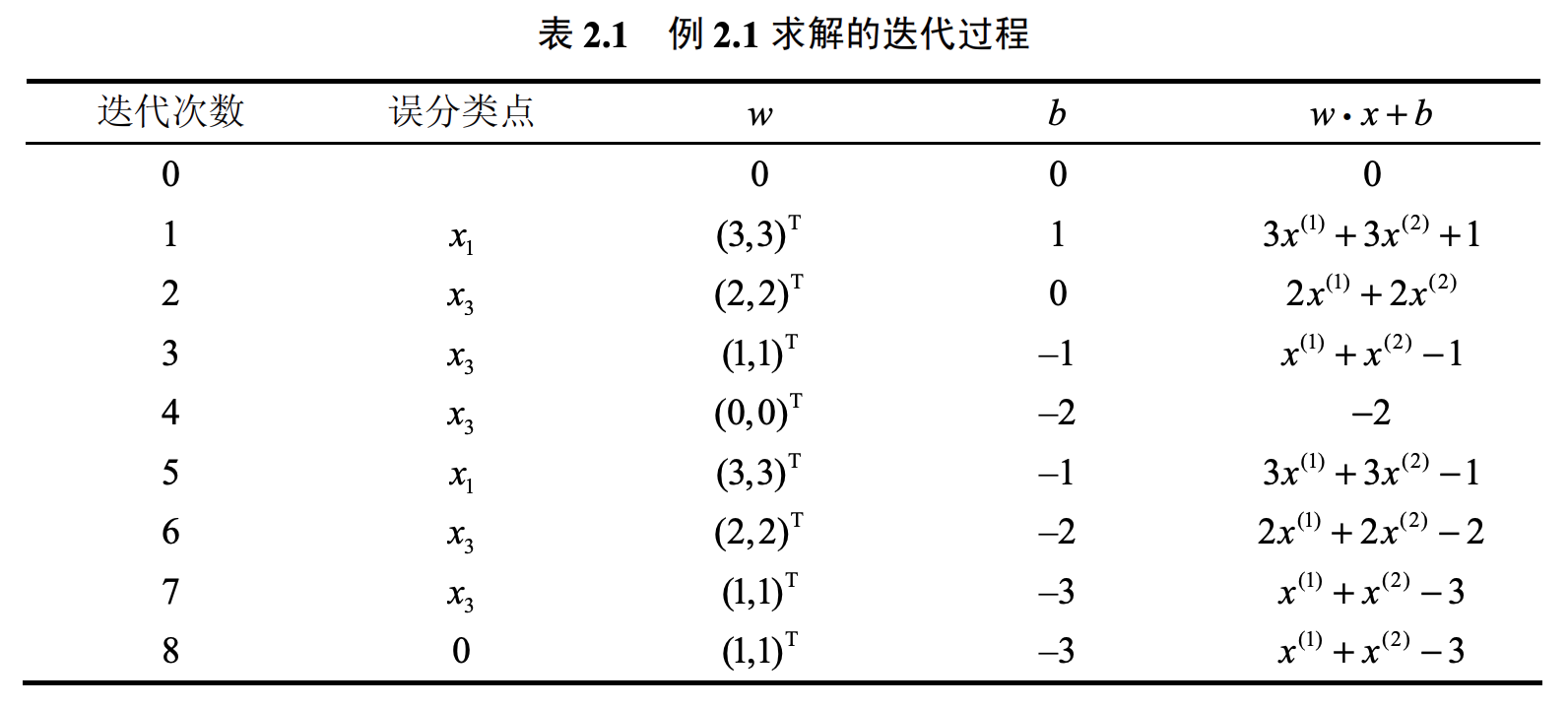

例子

仅对于yi×(w×xi+bi)≤0的点进行w和b的更新,若yi×(w×xi+bi)>0则不更新,直到没有误分类点为止。

yi是题目中一来就给出了的,比如这一道题,因为x1、x2为正实例点,所以y1、y2=1,x3为负实例点,所以y3=-1。

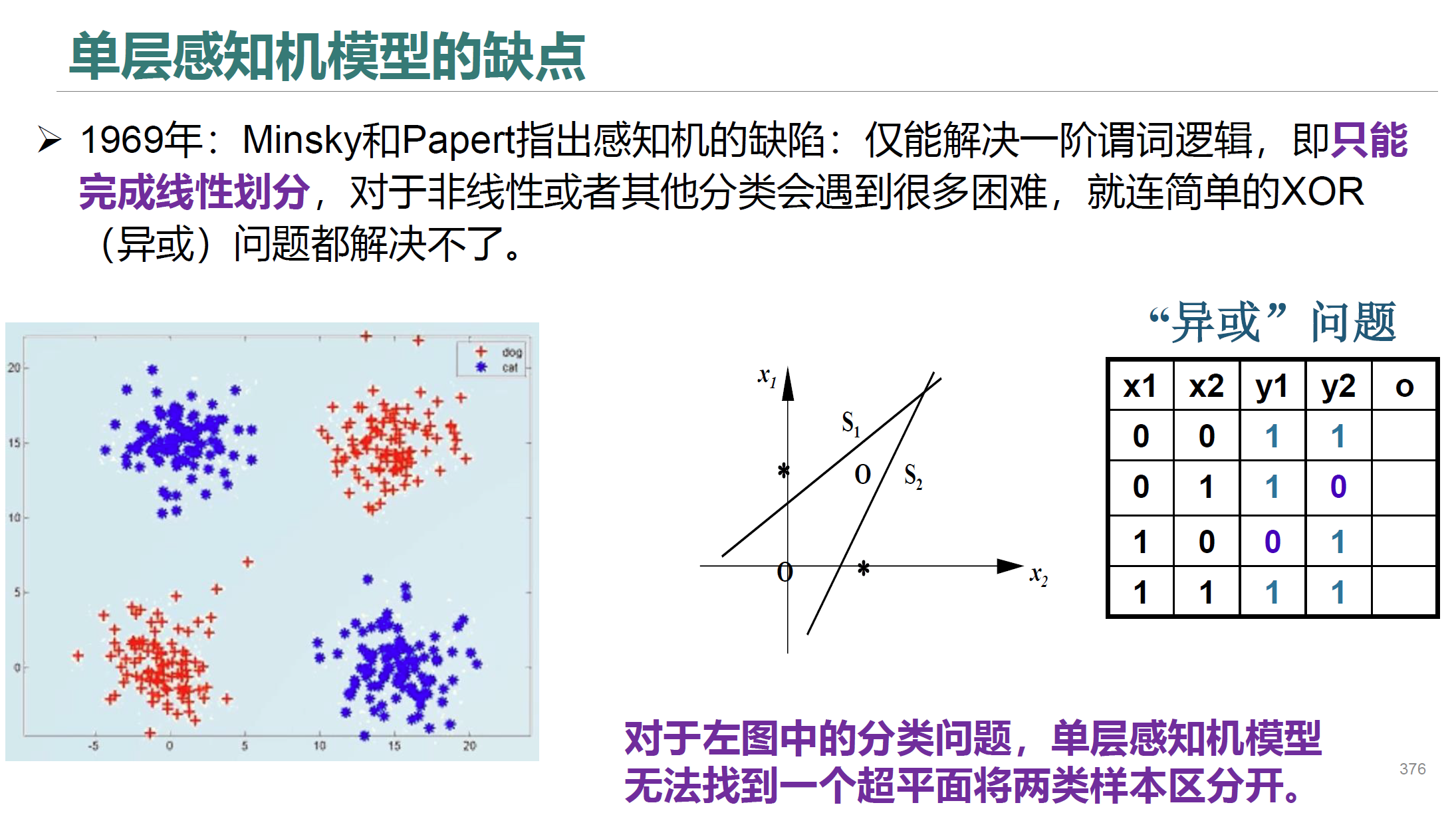

单层感知机模型的缺点

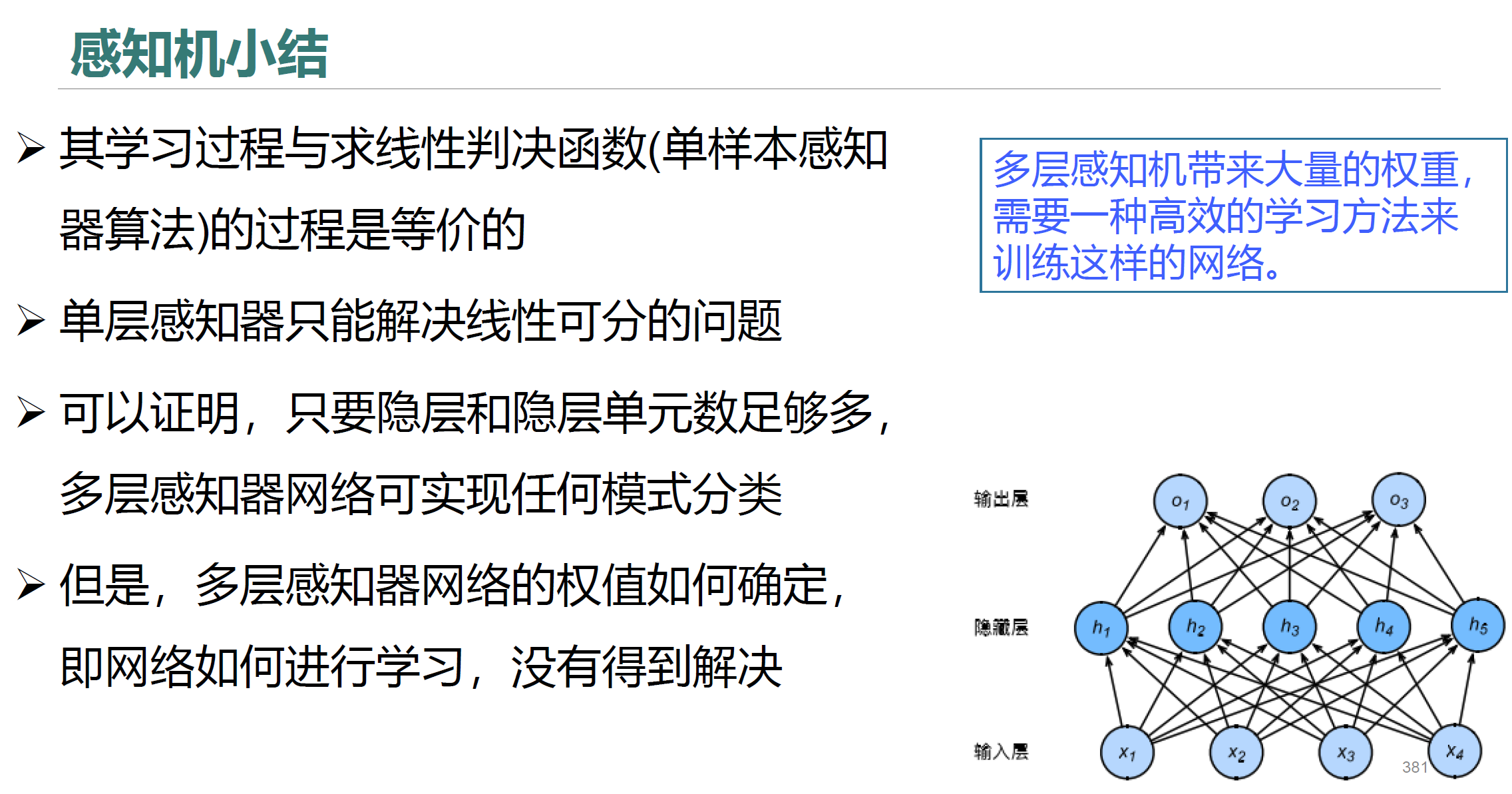

单层感知机处理不了异或问题。

多层感知机

感知机小结

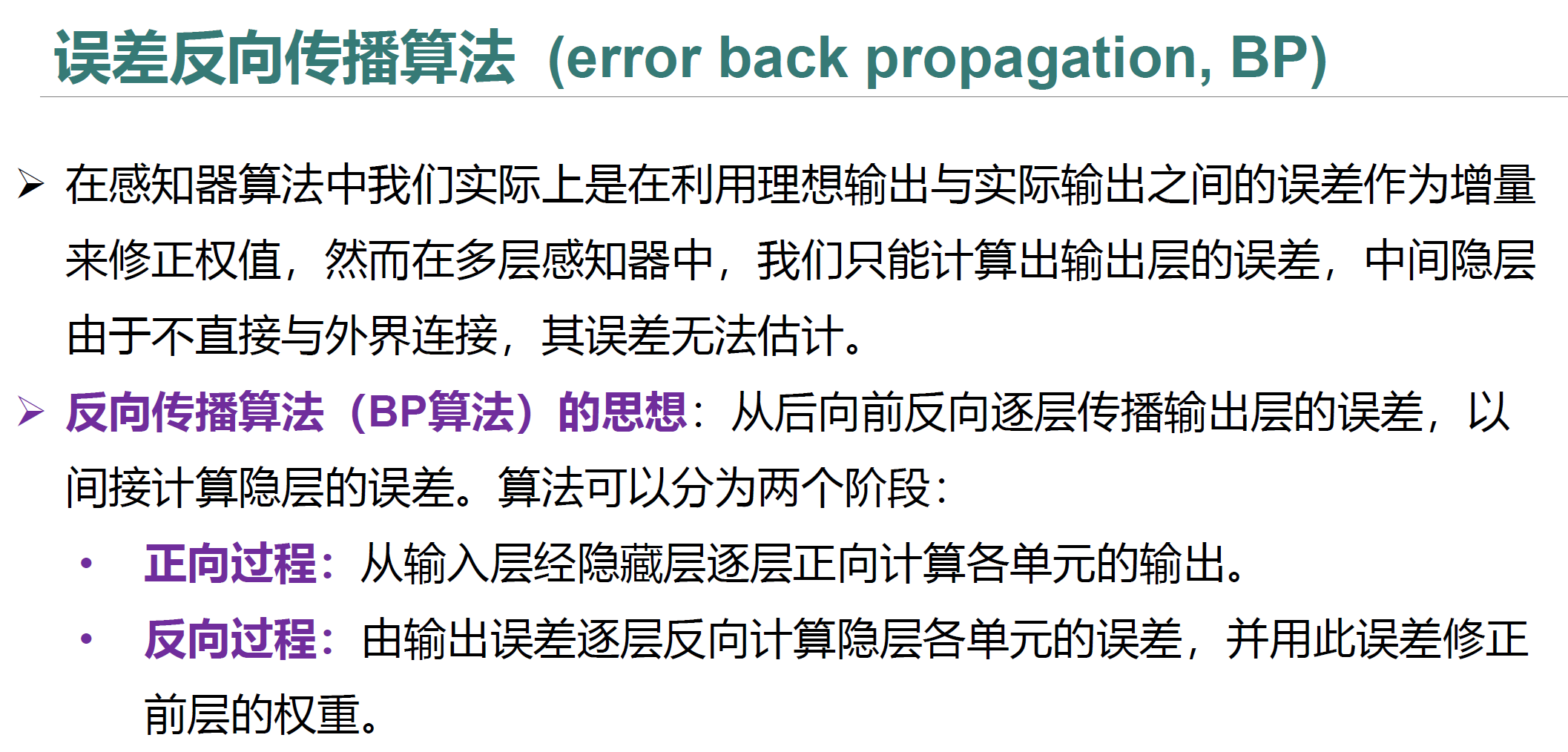

BP神经网络(供了解)

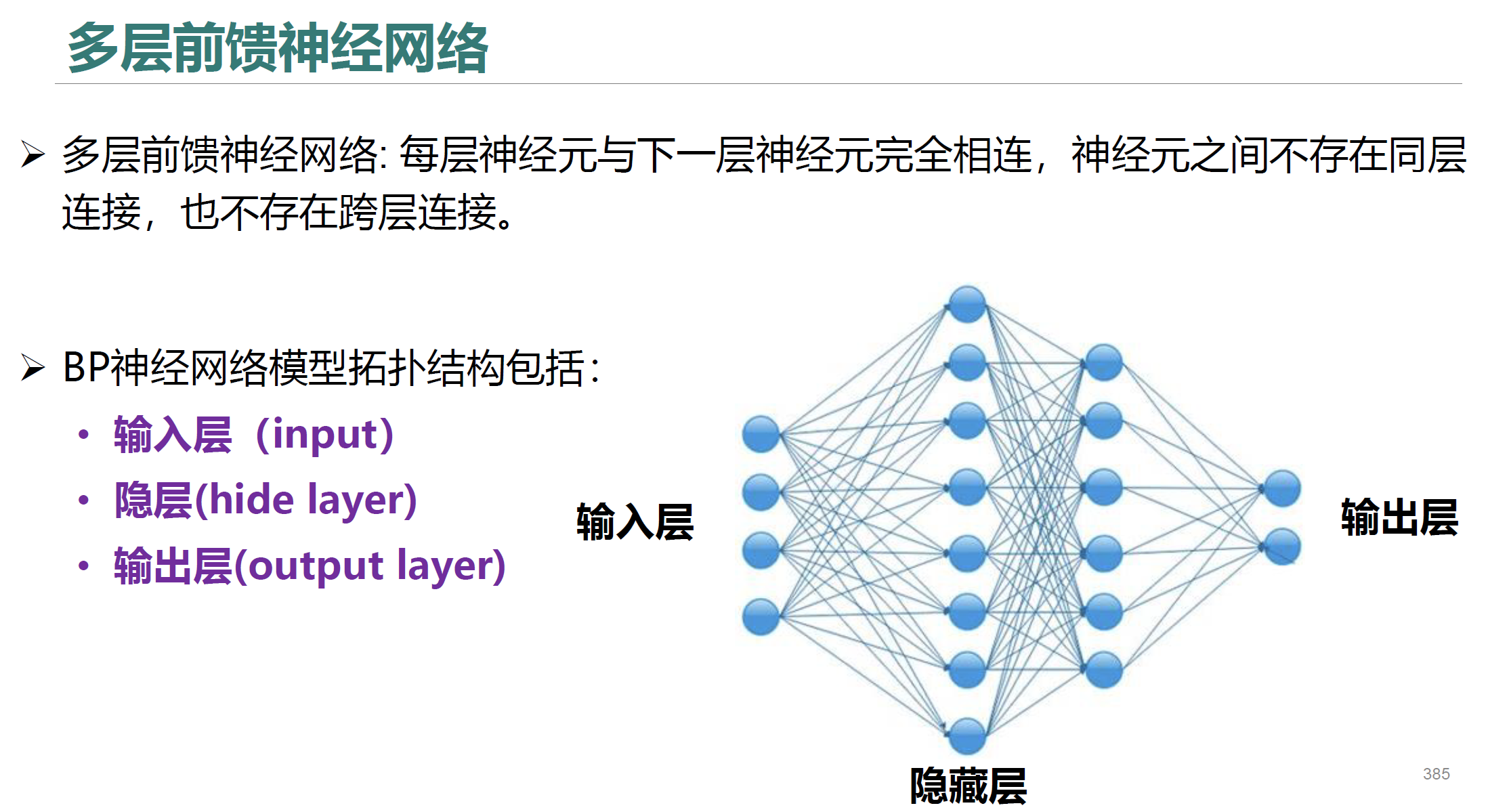

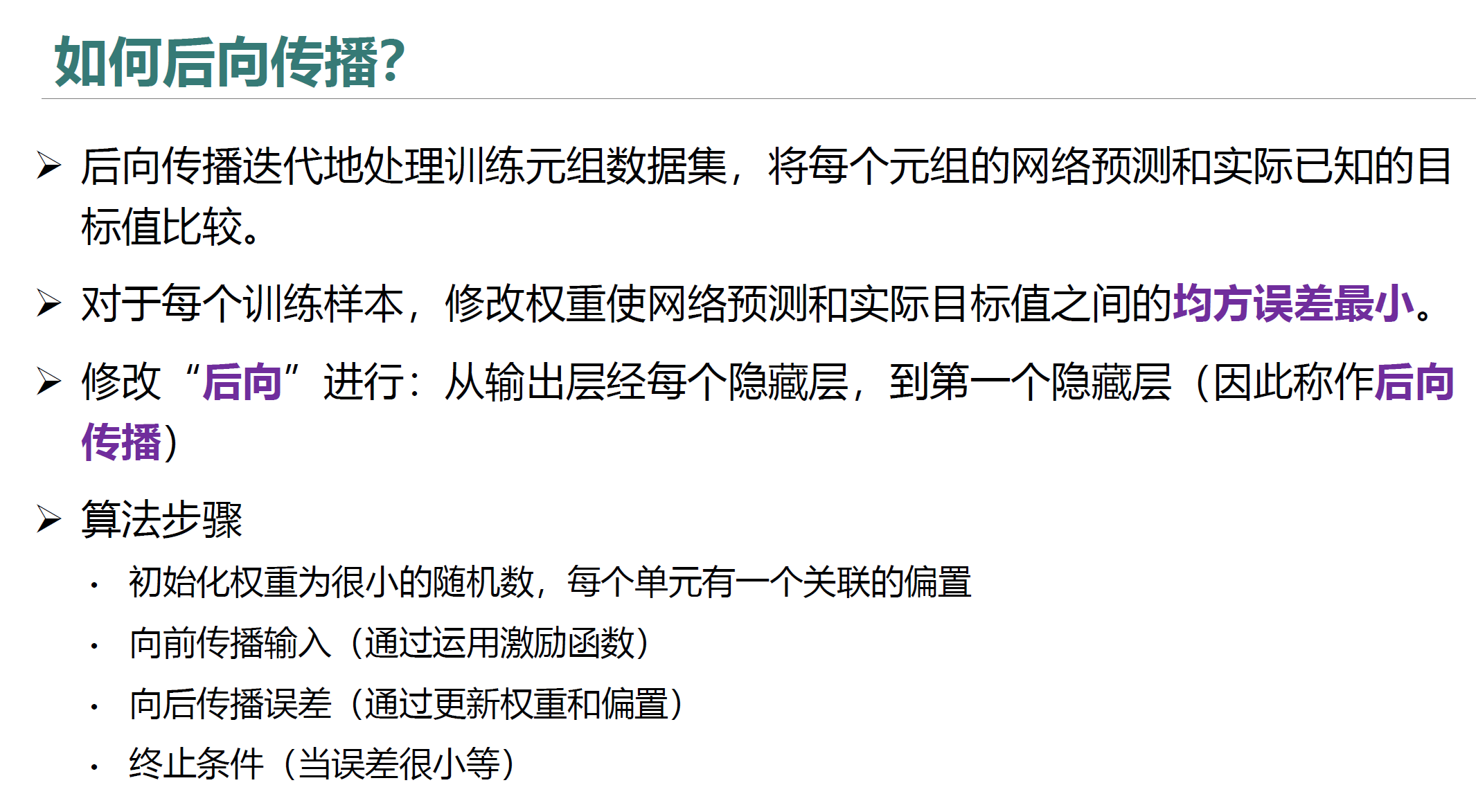

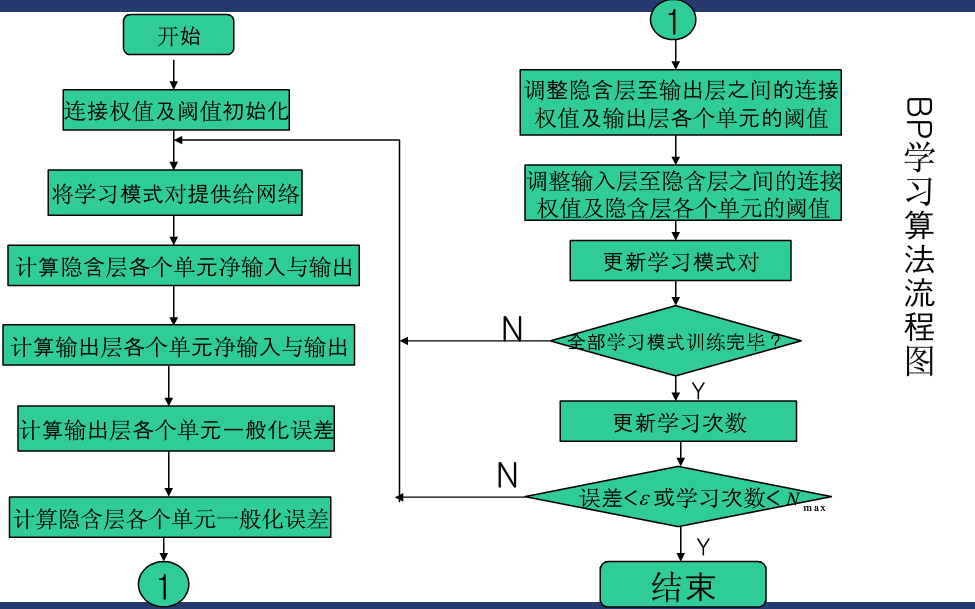

BP(Back Propagation)网络是 1986 年由 Rumelhart 和 McCelland 为首的科学家小组提出,是一种按误差逆传播算法训练的多层前馈神经网络,是目前应用最广泛的神经网络模型之一。

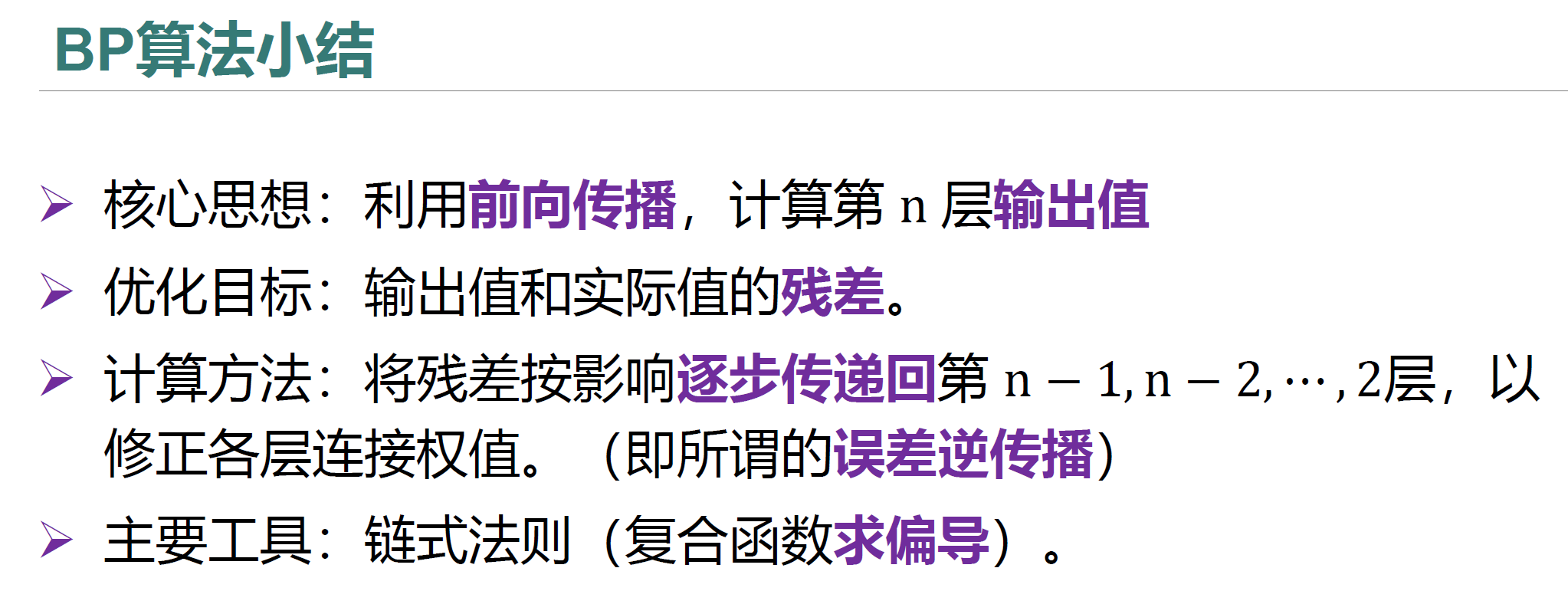

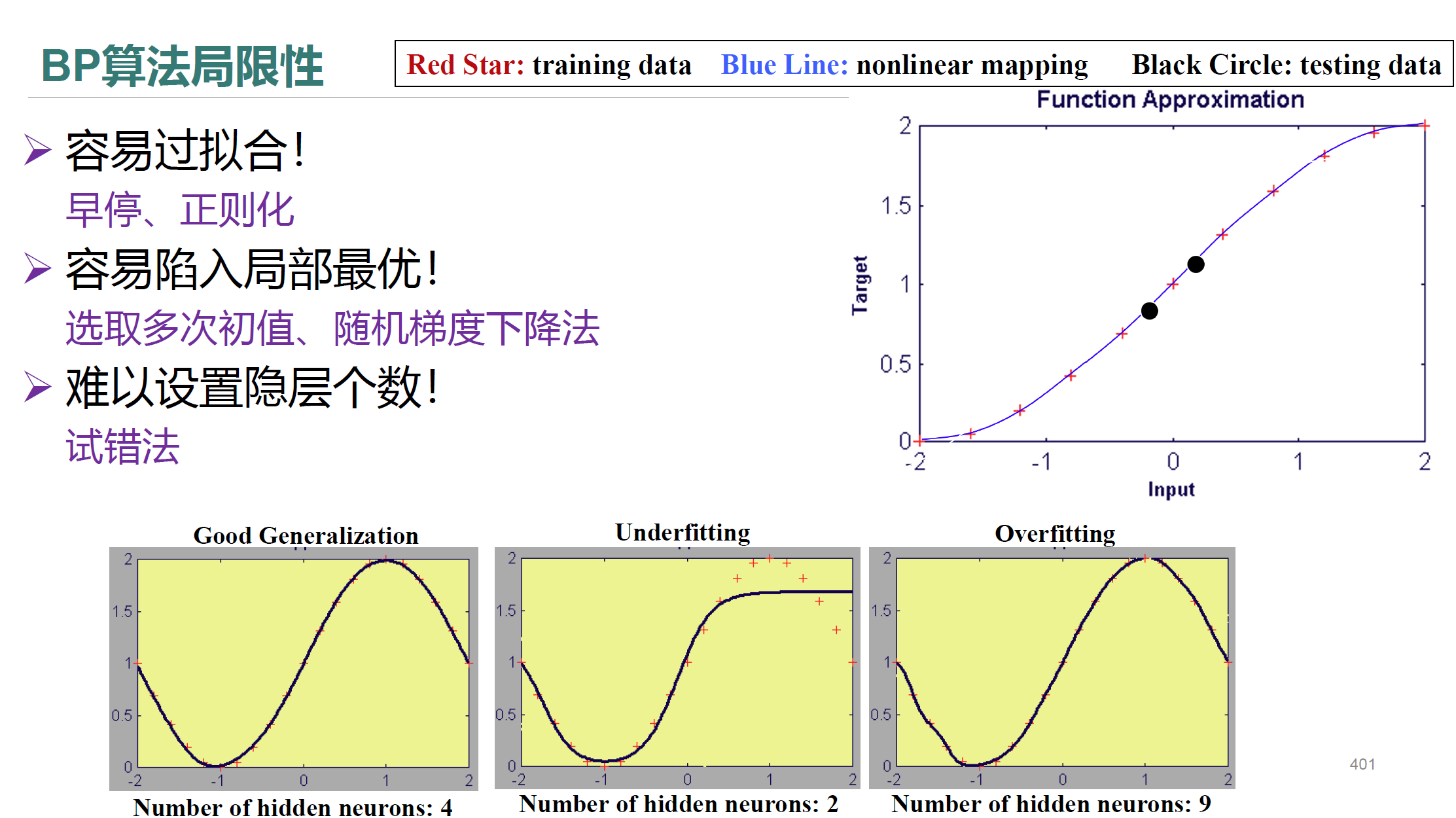

BP算法小结

深度学习

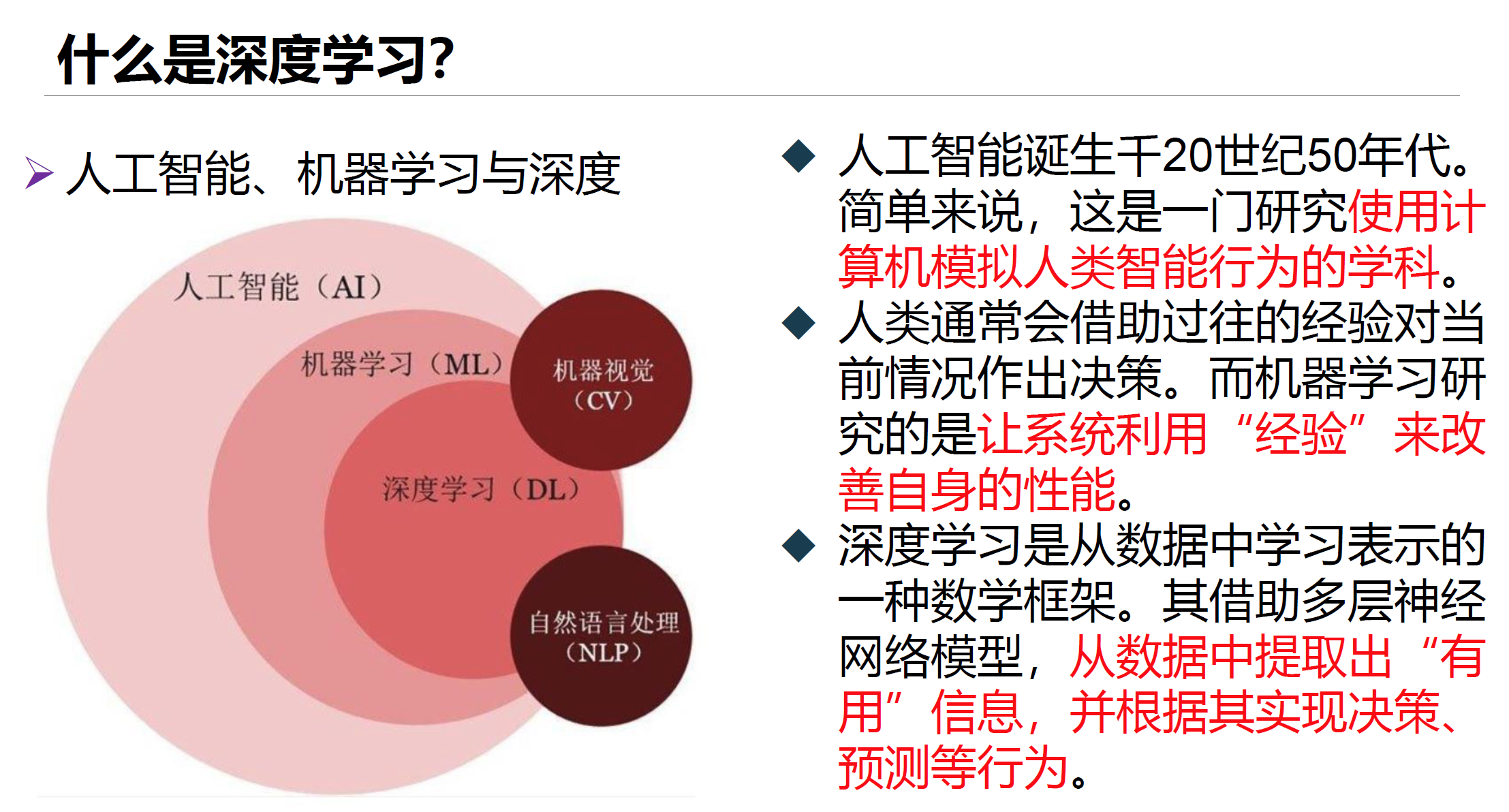

什么是深度学习?

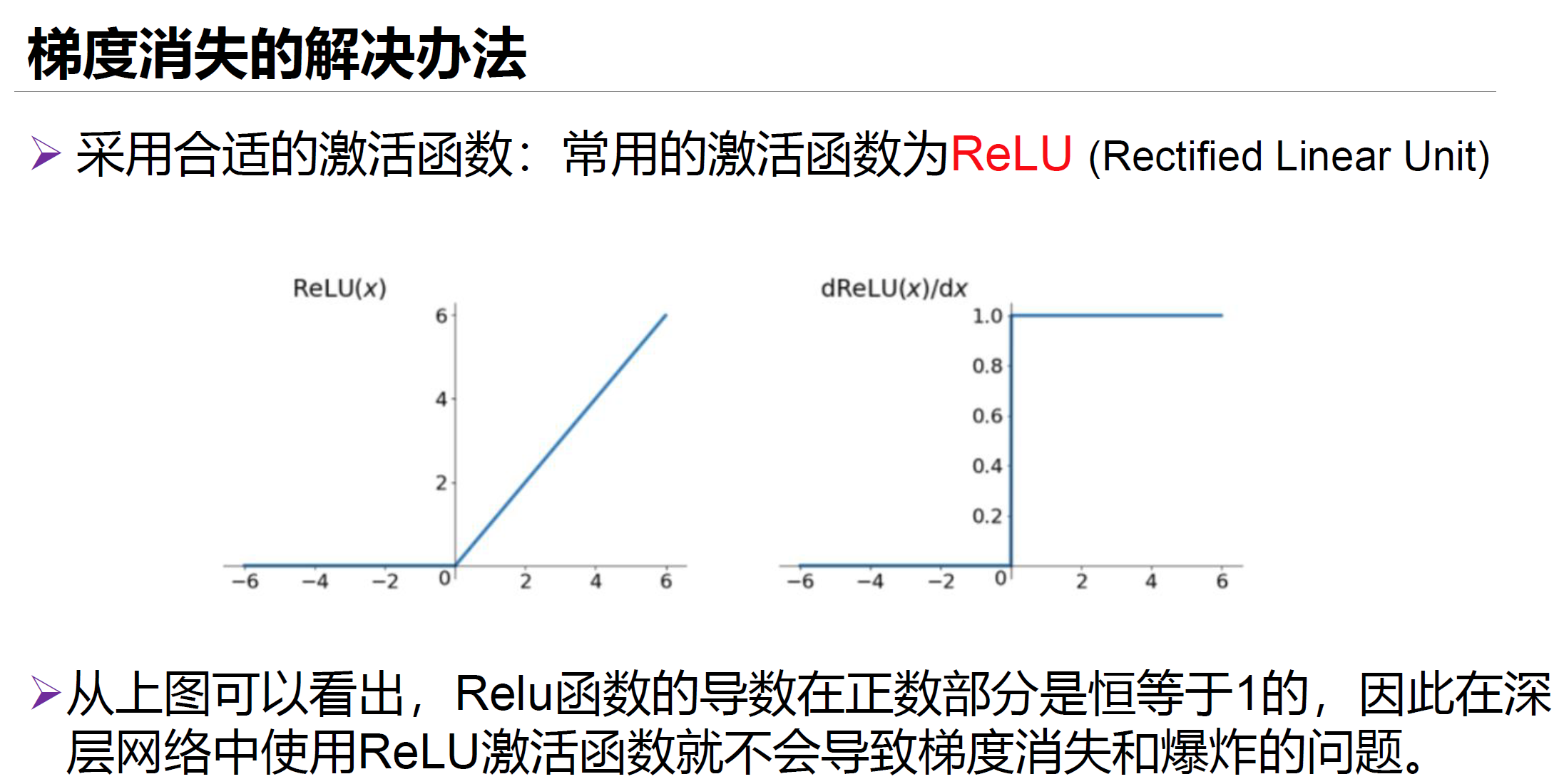

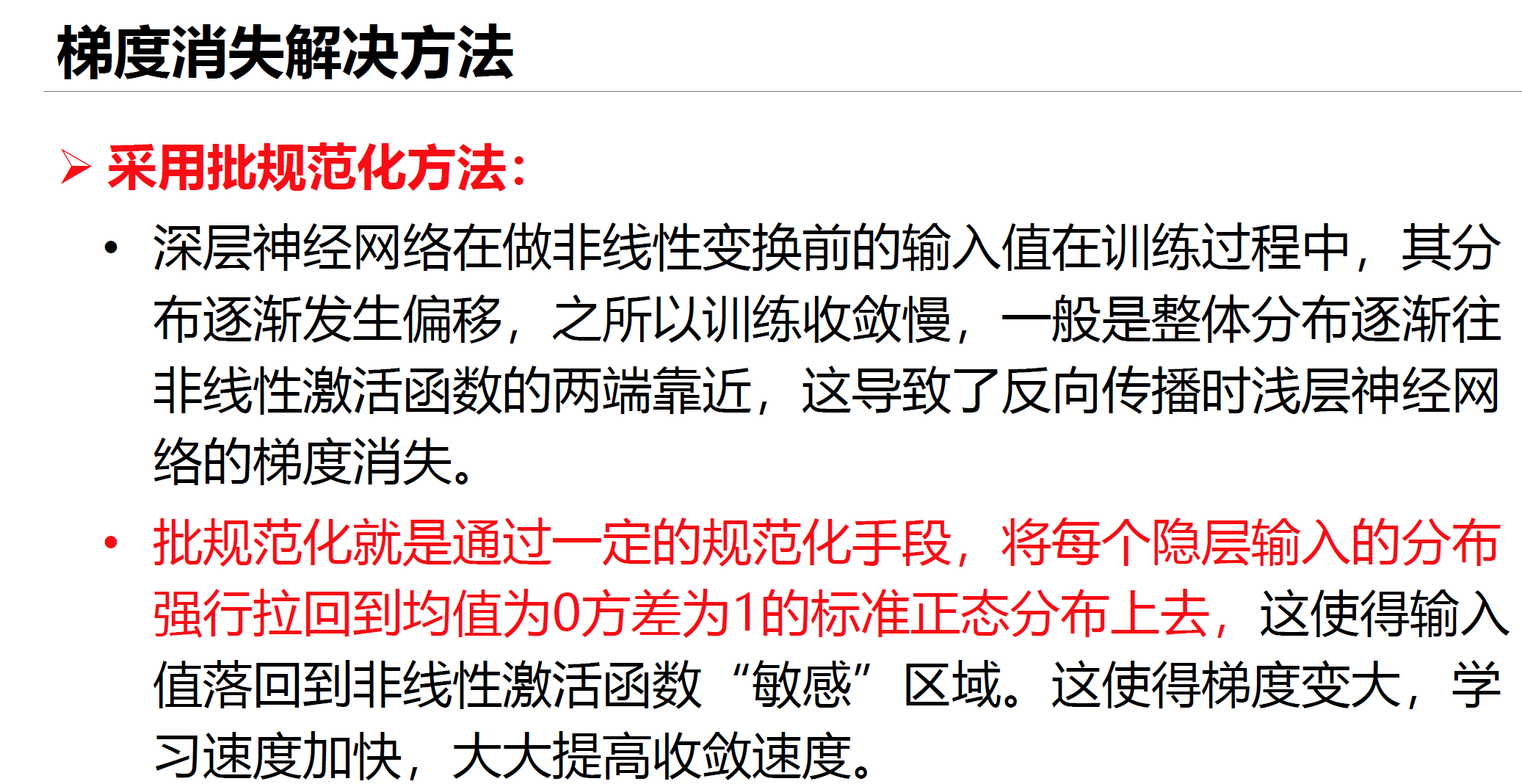

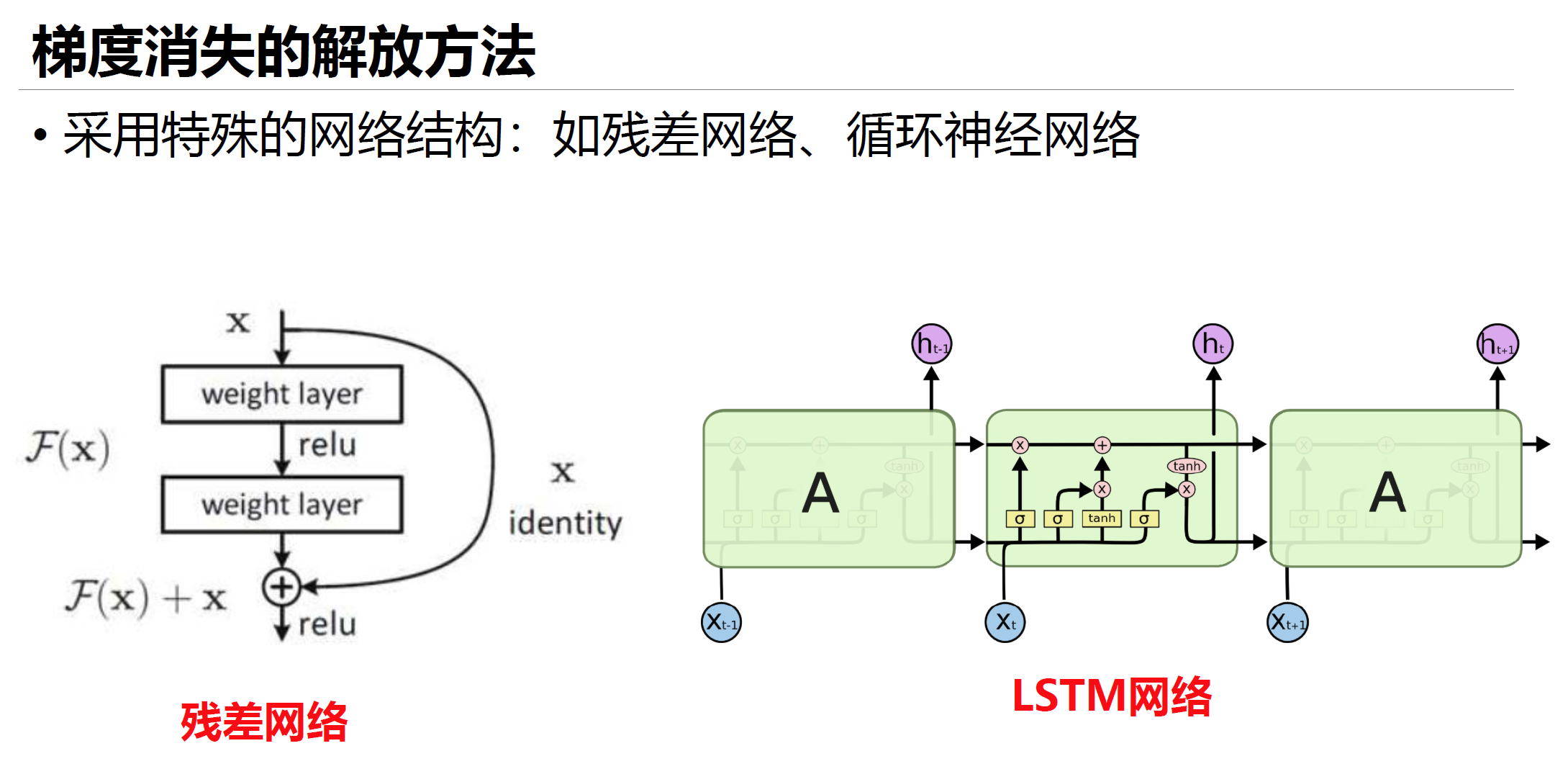

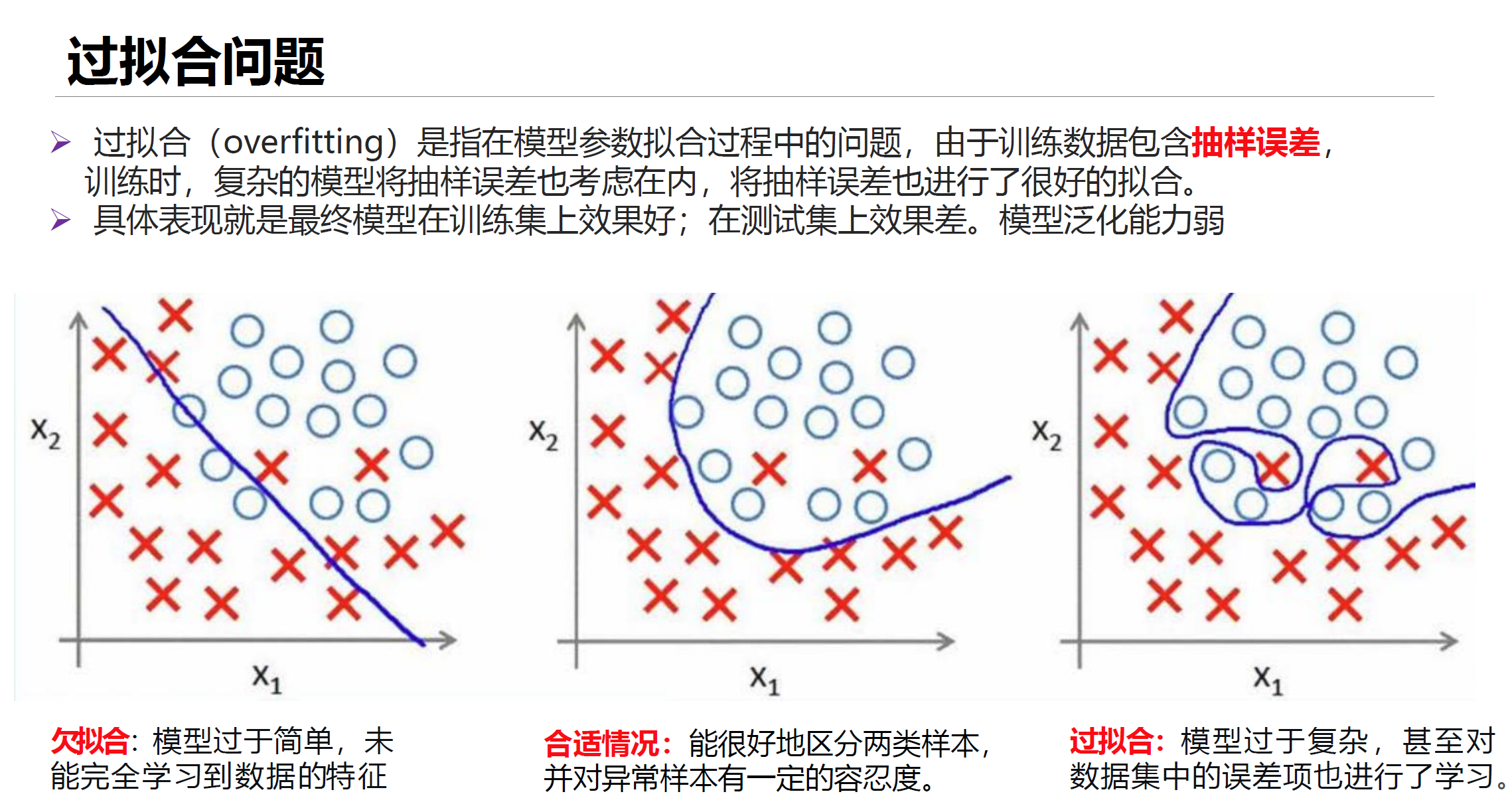

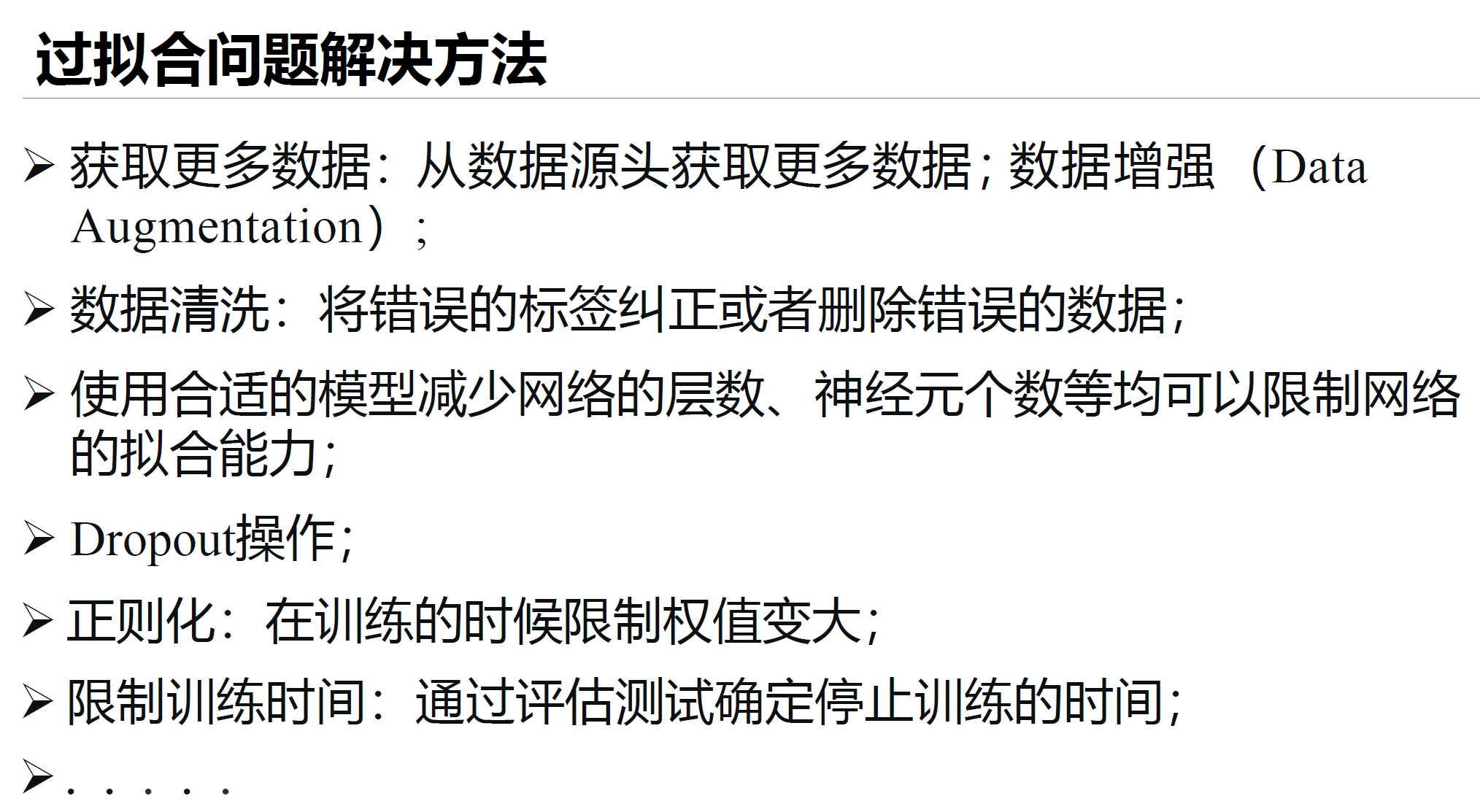

深度学习中的两大问题

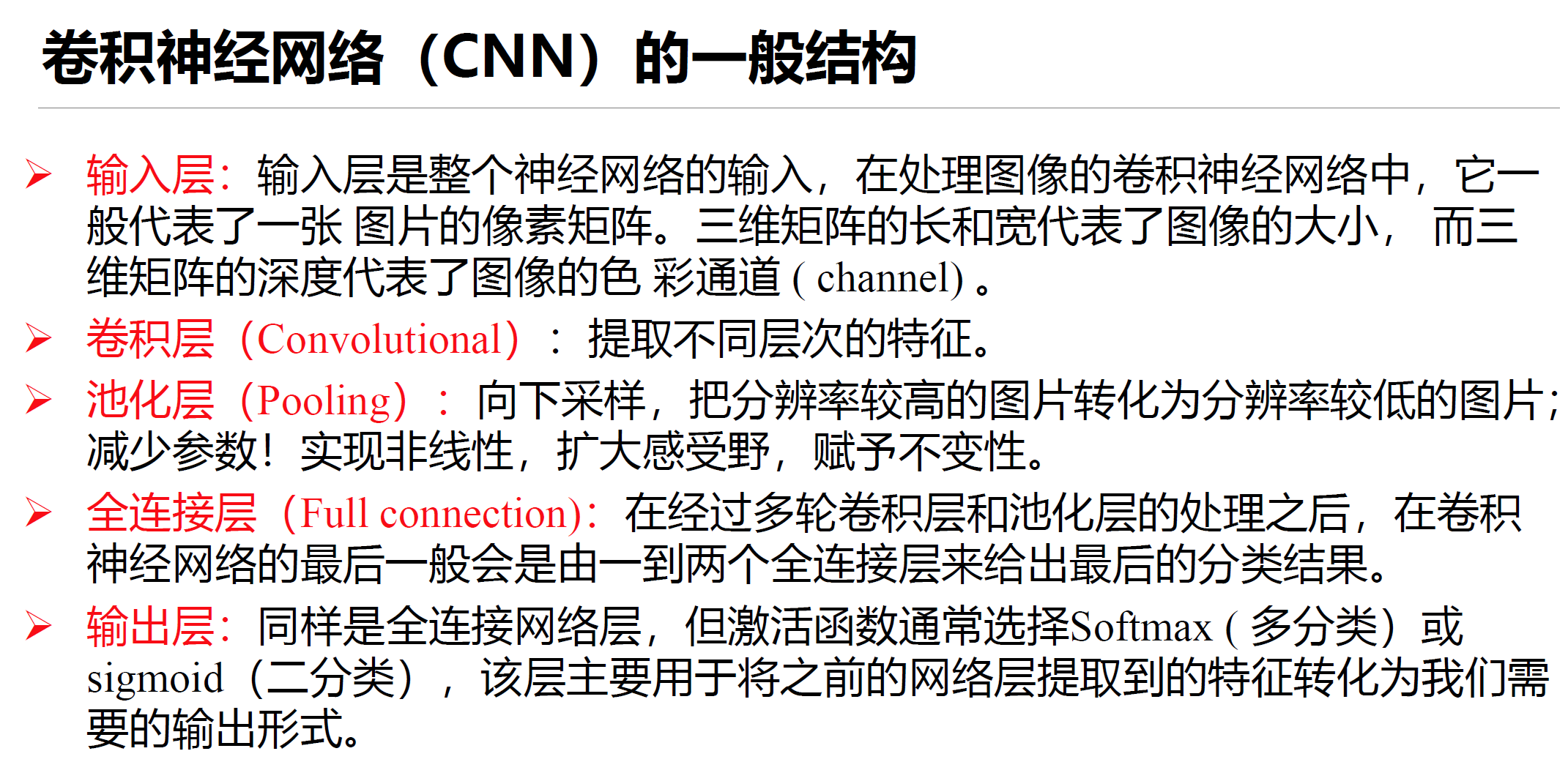

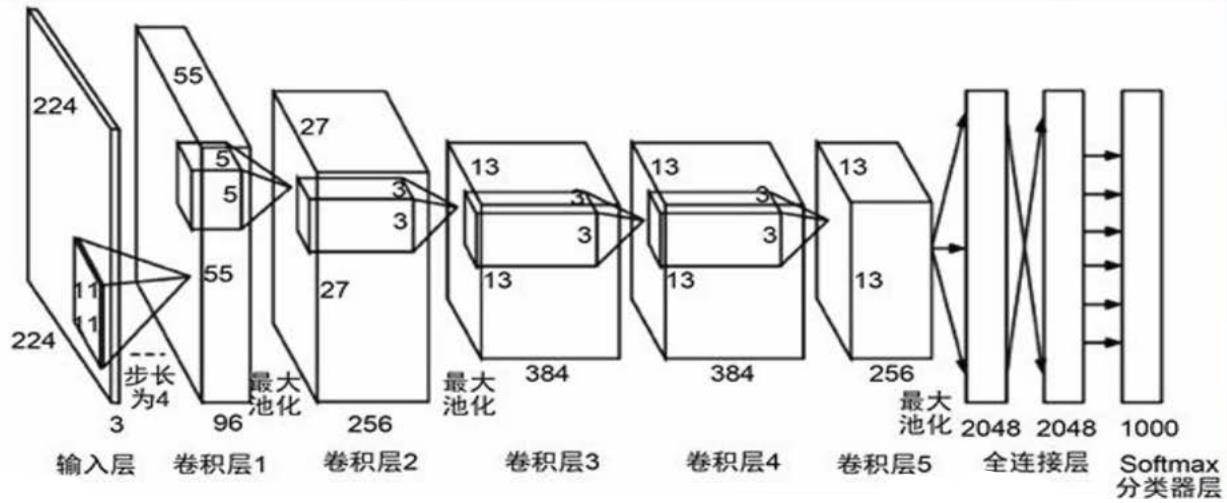

卷积神经网络(CNN)